Anthropic vient d’ajouter une brique inattendue à Claude Code, son assistant de développement orienté terminal : un mode vocal qui permet de piloter l’agent en parlant, plutôt qu’en tapant.

Le geste est moins gadget qu’il n’y paraît : dans un marché saturé d’outils de « coding AI », changer l’interface peut être la manière la plus rapide de se différencier — et de faire basculer des usages.

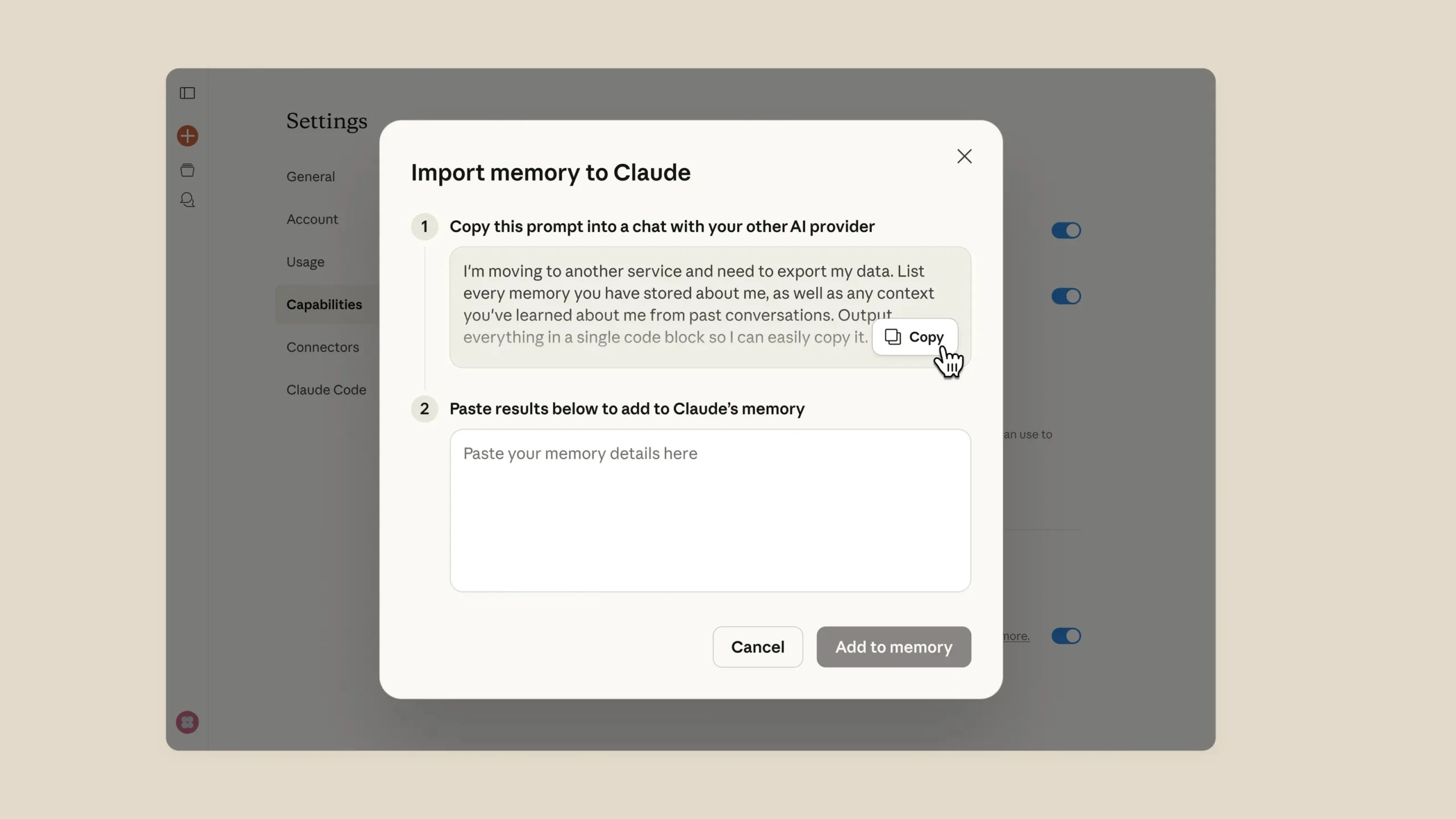

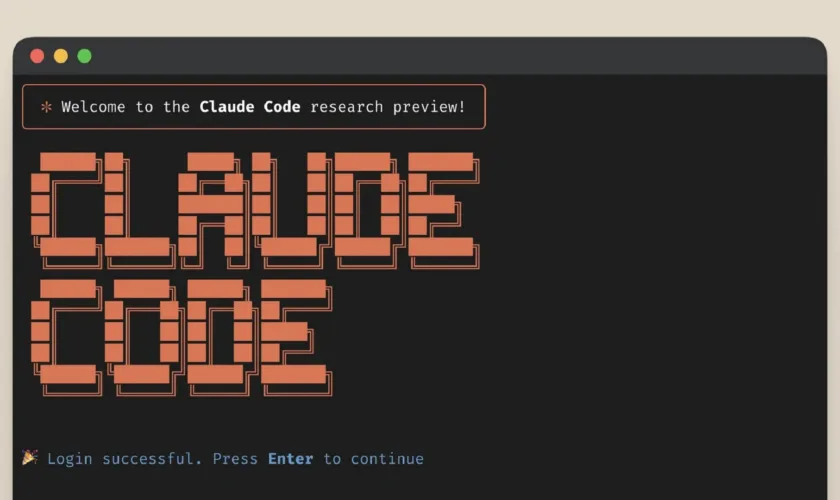

Claude Code : Une fonctionnalité simple à activer, mais lourde de sens

D’après TechCrunch, l’activation se fait directement dans la session Claude Code via une commande : /voice. Une fois enclenché, l’utilisateur dicte des demandes (ex. « refactoriser le middleware d’authentification ») et Claude Code exécute comme s’il s’agissait d’instructions textuelles — lecture/écriture de fichiers, refactor, debugging, etc.

Plusieurs reprises indiquent aussi un mécanisme « push-to-talk » (ex. maintien d’une touche pour parler), signe qu’Anthropic cherche à éviter le piège des assistants « toujours à l’écoute » dans un contexte pro.

Pourquoi ça compte dans la guerre des assistants de dev ?

Le marché est déjà polarisé : GitHub Copilot (Microsoft), Cursor, Windsurf et une constellation de startups se battent sur la vitesse, l’intégration IDE et les agents multi-fichiers. Anthropic, lui, a une carte particulière : le terminal comme interface « native » pour une partie des développeurs — et donc une place légitime pour y greffer une interaction vocale.

En clair : si tout le monde propose « un copilote », la différence peut venir de la façon dont on le pilote.

Voice mode is rolling out now in Claude Code. It’s live for ~5% of users today, and will be ramping through the coming weeks.

You’ll see a note on the welcome screen once you have access. /voice to toggle it on! pic.twitter.com/P7GQ6pEANy

— Thariq (@trq212) March 3, 2026

Le pari ergonomie : moins de friction, moins de fatigue

L’argument productivité est évident : parler va souvent plus vite que taper des consignes longues et précises. Mais, l’argument ergonomique est, lui, potentiellement plus fort : dans une industrie où les troubles musculo-squelettiques existent bel et bien, réduire le volume de frappe pour les tâches « meta » (expliquer, décrire, orchestrer) peut devenir un bénéfice très concret — surtout si l’agent est déjà capable d’agir à travers le système (fichiers, commandes, recherche).

Le point critique : confidentialité, biométrie, conformité

Dès qu’on ajoute la voix, on change la nature des données : ce n’est plus seulement du texte, c’est aussi un signal biométrique potentiel, et des flux audio qui peuvent inquiéter les équipes sécurité. Anthropic a déjà publié des éléments sur la collecte de données liées à la dictée/voix dans ses produits grand public, ce qui donne un point d’appui aux entreprises pour évaluer le risque (stockage, traitement, finalités).

La question qui va décider de l’adoption en entreprise n’est donc pas « est-ce cool ? », mais « où passe l’audio, combien de temps, et avec quelles garanties ? ».

L’histoire des interfaces vocales dans le travail est mitigée : les assistants ont percé dans le grand public, beaucoup moins dans les workflows professionnels. Mais les agents IA changent la donne : on ne dicte plus du texte, on dirige une action. Si Claude Code arrive à comprendre les références implicites (« le bug qu’on vient de voir », « le module auth », « fais-le comme hier »), la voix peut devenir un véritable accélérateur d’orchestration.

Et surtout : si Anthropic prouve que ça marche au terminal, les concurrents devront répondre — ne serait-ce que pour éviter de laisser à Claude Code l’image de l’outil le plus « naturel » à piloter.