Google franchit un cap supplémentaire dans la personnalisation de Gemini. Avec une nouvelle évolution de Personal Intelligence, l’assistant peut désormais s’appuyer sur les données issues d’apps connectées comme Google Photos — combinées au modèle d’image Nano Banana 2 — pour générer des visuels inspirés de votre contexte personnel, de vos goûts et même de vos proches.

Une IA qui ne part plus d’un prompt vide

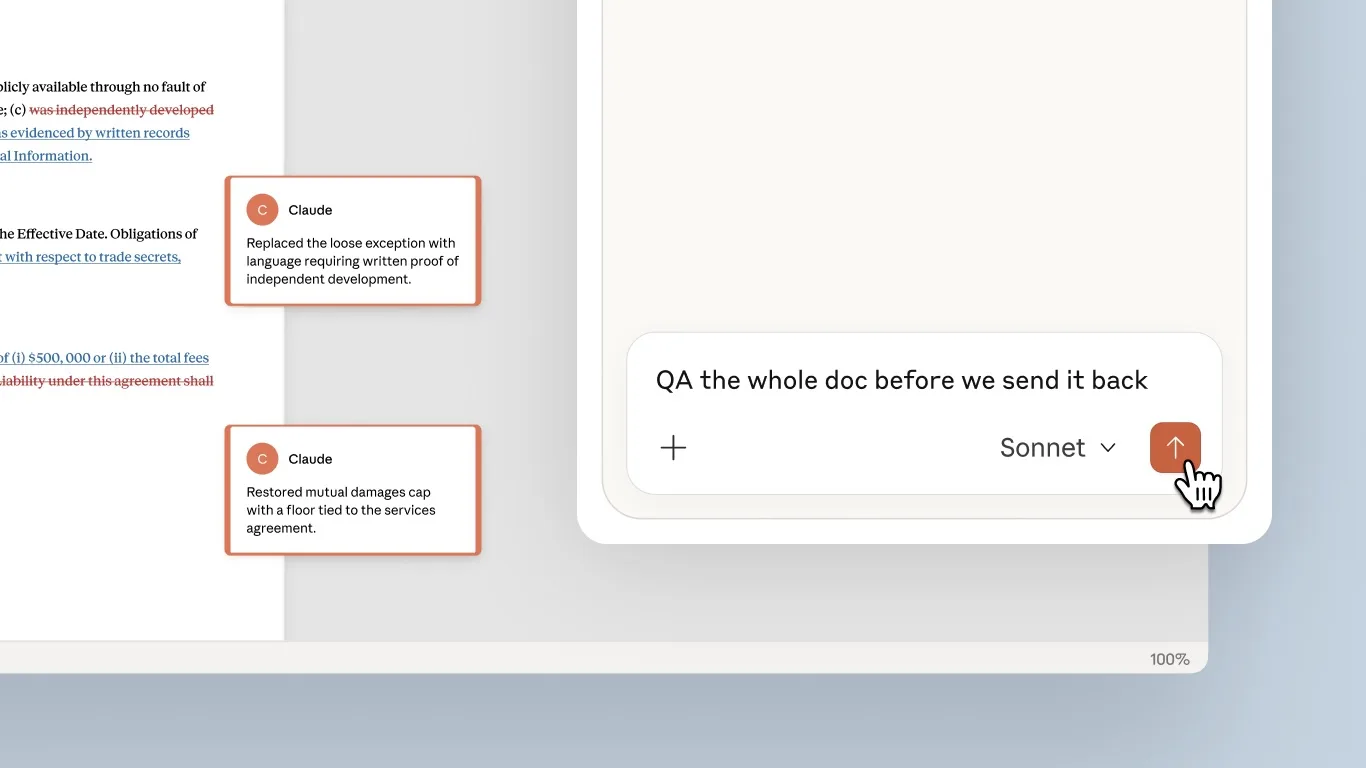

Jusqu’ici, créer une image vraiment personnelle avec un assistant génératif demandait souvent un long prompt, voire l’ajout manuel d’images de référence. Google veut supprimer cette friction.

Dans son article officiel, l’entreprise explique que Gemini peut désormais utiliser le contexte déjà présent dans vos apps connectées pour compléter automatiquement ce que vous ne dites pas explicitement. Des requêtes comme « Concevoir la maison de mes rêves » ou « Créez une image de mes indispensables pour une île déserte » sont censées produire des images qui reflètent votre style de vie et vos préférences sans description détaillée.

Sous le capot, Google s’appuie sur Nano Banana 2, son modèle de génération d’images lancé en février 2026, qu’il présente comme plus rapide et plus contrôlable, avec une meilleure compréhension du monde réel et un rendu textuel plus précis.

Google indique aussi que ce modèle est déjà déployé dans plusieurs produits de son écosystème, dont Gemini.

Google Photos devient une mémoire visuelle pour Gemini

L’aspect le plus révélateur de cette mise à jour est l’intégration avec Google Photos. D’après Google, Gemini peut utiliser votre photothèque connectée pour générer des images où apparaissent « vous et vos proches », sans upload manuel systématique. Le système s’appuie sur les libellés de Google Photos pour identifier des personnes comme vous, vos amis ou votre famille avant de laisser Nano Banana 2 composer l’image.

Cela donne une direction très claire à la stratégie produit de Google : faire de Gemini non plus seulement un assistant généraliste, mais un assistant qui connaît déjà votre univers visuel, vos habitudes et vos références. C’est une évolution importante, car elle rapproche la génération d’images d’un usage beaucoup plus personnel, presque autobiographique.

Privacy first… mais pas sans nuance

Google insiste sur un point sensible : l’entreprise affirme que Gemini ne « s’entraîne » pas directement ses modèles sur votre bibliothèque privée Google Photos. En revanche, elle reconnaît entraîner ses systèmes sur des informations limitées, comme certains prompts saisis dans Gemini et les réponses du modèle. Google rappelle aussi que la connexion des apps à Gemini reste facultative et modifiable à tout moment dans les réglages.

Autrement dit, la promesse de confidentialité existe, mais elle repose sur une distinction importante entre l’usage direct de votre photothèque privée et l’exploitation de signaux dérivés issus de votre interaction avec Gemini.

Pour les utilisateurs, ce sera probablement le vrai point d’attention : la personnalisation progresse, mais elle demande aussi un niveau de confiance plus élevé dans la manière dont Google orchestre ces données.

Déploiement : d’abord les abonnés payants aux États-Unis

Google indique que cette fonction commence à être déployée « au cours des prochains jours » pour les abonnés éligibles Google AI Plus, Pro et Ultra aux États-Unis. L’entreprise précise également qu’elle arrivera ensuite dans Gemini sur Chrome version bureau et auprès d’un public plus large, sans date exacte pour l’instant.

Google fait entrer la génération d’images dans l’ère du contexte personnel

Cette annonce dit quelque chose de plus profond sur l’évolution de l’IA grand public. Pendant longtemps, les générateurs d’images ont été des machines à illustrer des idées. Avec Personal Intelligence, Google essaie d’en faire des outils capables d’illustrer votre vie. Le glissement est majeur : l’IA ne crée plus seulement à partir d’un texte, elle crée à partir d’une mémoire contextuelle.

C’est séduisant, parce que cela réduit énormément l’effort de création. Mais c’est aussi un tournant stratégique. Plus Gemini devient personnel, plus il devient difficile à remplacer par un assistant concurrent qui ne connaît ni vos photos, ni vos goûts, ni votre historique d’usage.

Google ne vend donc pas seulement une meilleure génération d’images ; il construit une dépendance douce à son propre écosystème.