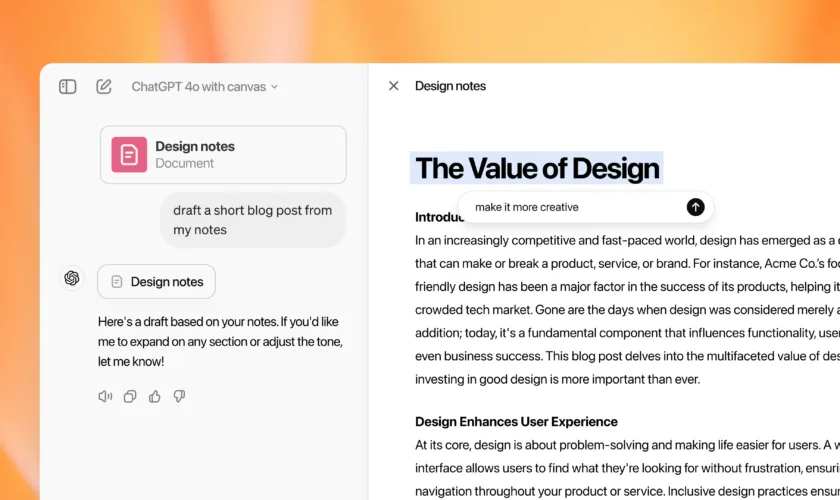

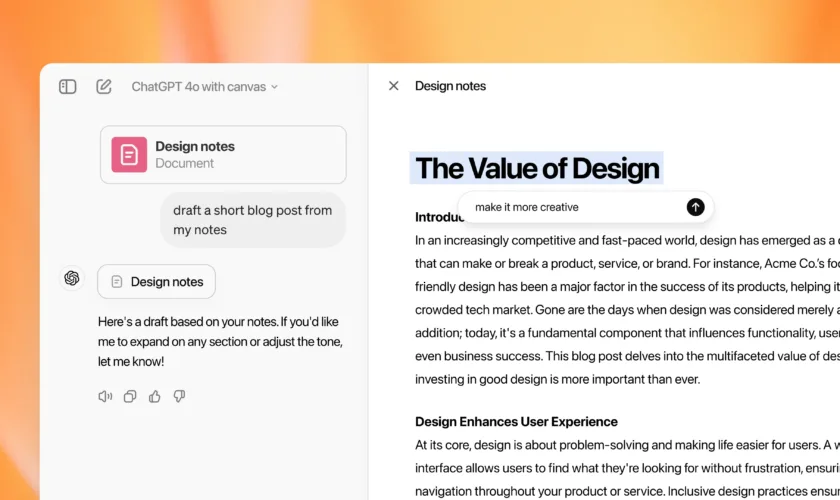

La semaine dernière, OpenAI a lancé Canvas, une nouvelle interface révolutionnaire pour ChatGPT qui transforme la collaboration avec l’IA. Conçu pour simplifier les tâches d’écriture et de codage, Canvas offre un espace de travail interactif où l’utilisateur peut dialoguer avec l’IA en temps réel, modifier ses projets et explorer de nouvelles idées.

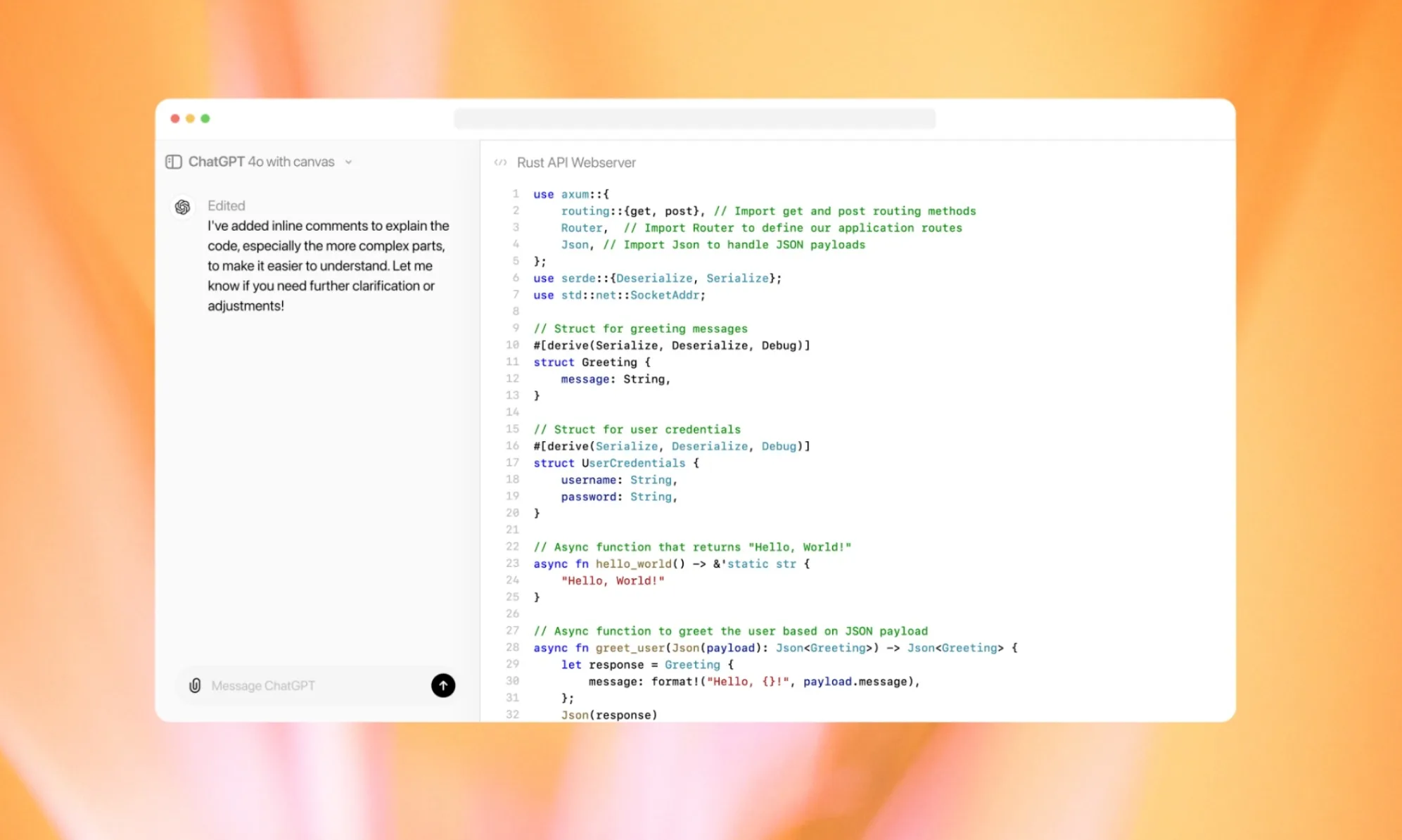

Analogue à la fonctionnalité Artifacts de Claude AI d’Anthropic, Canvas affiche le contenu dans une fenêtre séparée, permettant aux utilisateurs de suivre l’évolution de leurs documents et de leur code en temps réel.

Imaginez travailler avec un collègue expert qui vous fournit instantanément des commentaires et des suggestions pour améliorer votre travail. C’est l’expérience que propose Canvas, en fluidifiant le processus de création et en stimulant la productivité.

Les avantages de la collaboration avec Canvas :

- Feedback instantané de l’IA

- Ajustements et améliorations en temps réel

- Productivité et créativité accrues

- Réduction du temps passé sur les révisions

Comment utiliser Canvas ?

- Sélectionnez Canvas dans le menu déroulant des modèles d’IA en haut de votre espace de travail ChatGPT.

- Canvas s’ouvre automatiquement lorsque ChatGPT détecte un besoin ou lorsque vous utilisez le prompt « utiliser canvas ».

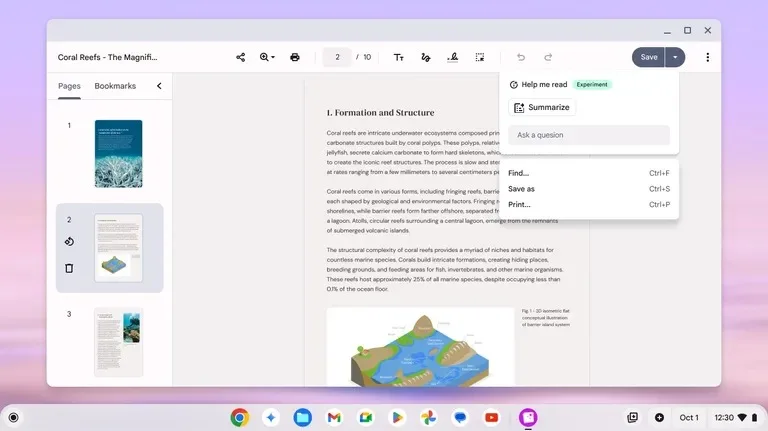

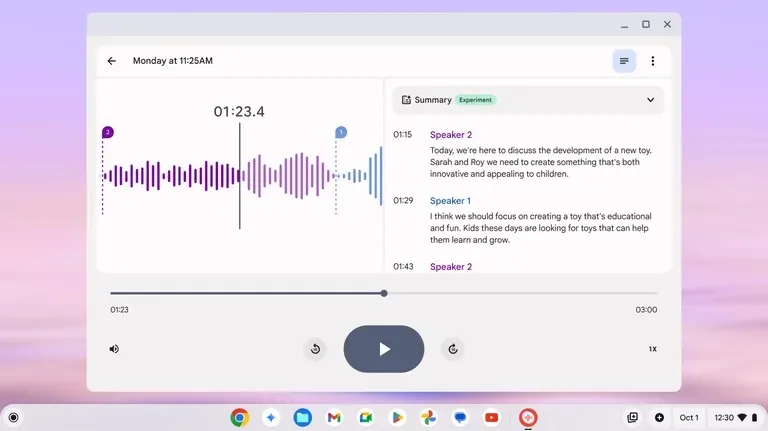

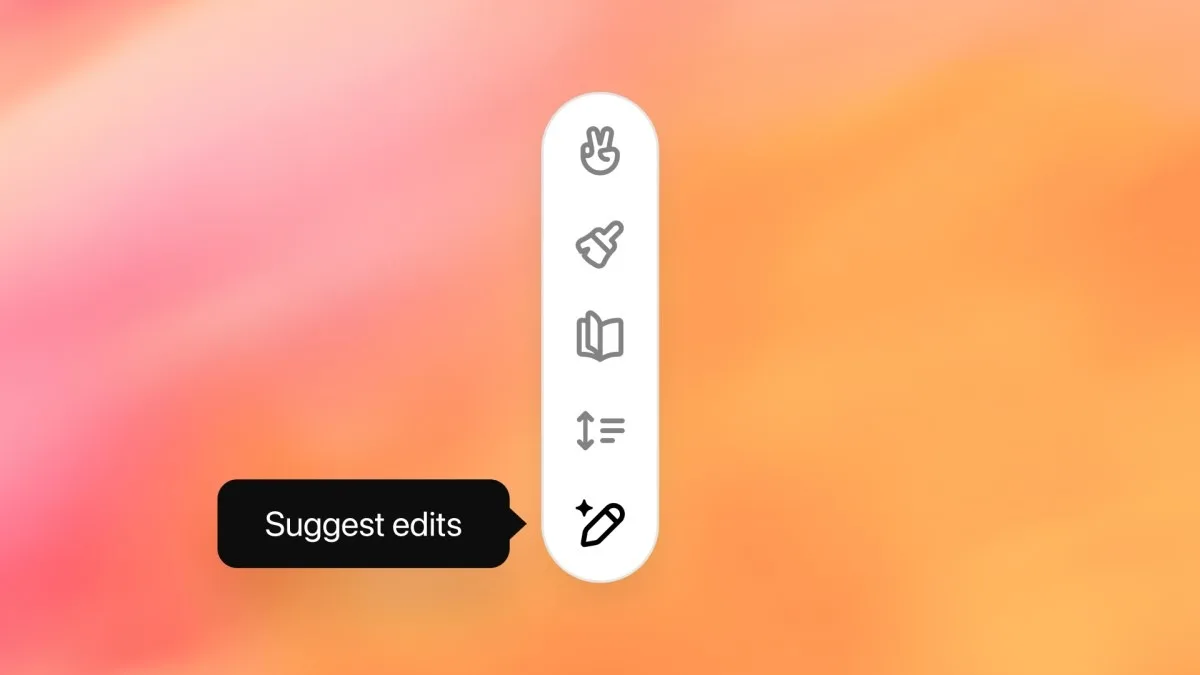

- Modifiez directement le texte ou le code dans l’interface Canvas.

- Mettez en évidence des sections spécifiques pour obtenir des commentaires précis de ChatGPT.

- Utilisez les raccourcis d’écriture et de codage pour des actions rapides.

- Contrôlez les versions de votre document grâce à la fonction de contrôle de version.

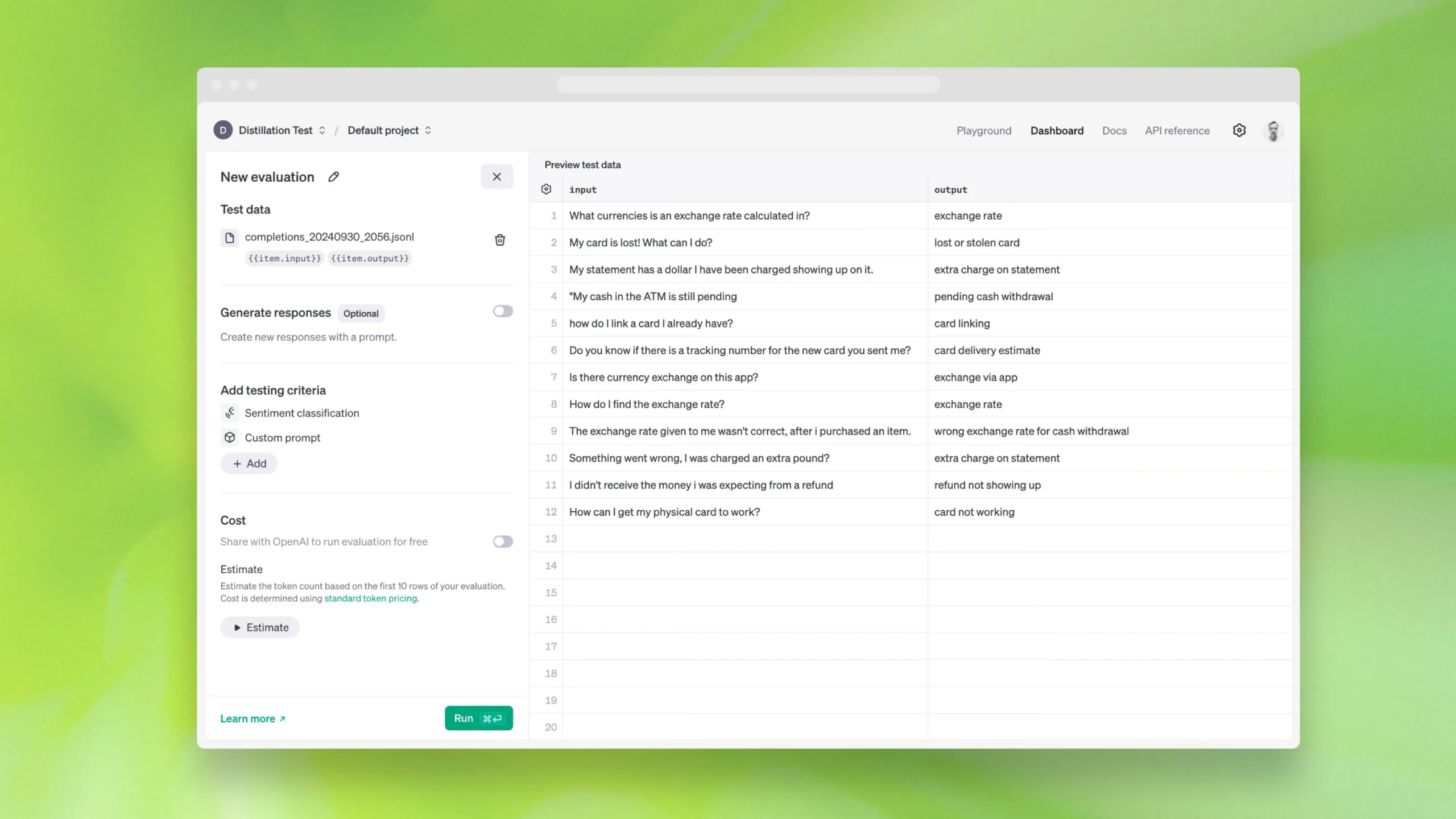

Canvas pour le codage : un outil puissant pour tous les niveaux

Canvas simplifie la création et l’amélioration du code, que vous soyez débutant ou expert. Il prend en charge :

- La revue et l’optimisation du code

- L’identification et la correction des bugs

- La traduction du code dans différents langages

- L’explication de la syntaxe et des bonnes pratiques

Pour le codage, des raccourcis permettent de réviser le code, d’ajouter des commentaires, de corriger des bugs et de traduire le code dans différents langages de programmation (JavaScript, PHP, TypeScript, Python, C++ et Java). Canvas permet de mettre en évidence des sections spécifiques du texte ou du code pour guider ChatGPT. L’IA peut fournir des commentaires et des suggestions en tenant compte de l’ensemble du projet, à la manière d’un correcteur ou d’un relecteur de code. Un bouton « Retour » permet de restaurer facilement les versions précédentes du document.

Canvas pour l’écriture : un assistant complet

Canvas est également un puissant assistant d’écriture, facilitant la recherche, la rédaction et la citation des sources. Ses fonctionnalités d’édition de texte permettent d’améliorer la clarté, d’ajouter de l’humour et d’intégrer de nouvelles informations.

Une interface intuitive et personnalisable

L’interface de Canvas est conçue pour une interaction intuitive, avec des mises en page personnalisables, des outils de formatage faciles à utiliser et des fonctionnalités de collaboration en temps réel.

Canvas pourrait transformer l’apprentissage du codage et de l’écriture en offrant une assistance en temps réel, des tutoriels interactifs et des exercices adaptatifs. Mais, l’utilisation de Canvas soulève des questions éthiques et pratiques. Il est crucial de vérifier l’exactitude du contenu généré par l’IA, de conserver sa propre voix et son style, et de comprendre les limites de l’assistance de l’IA.

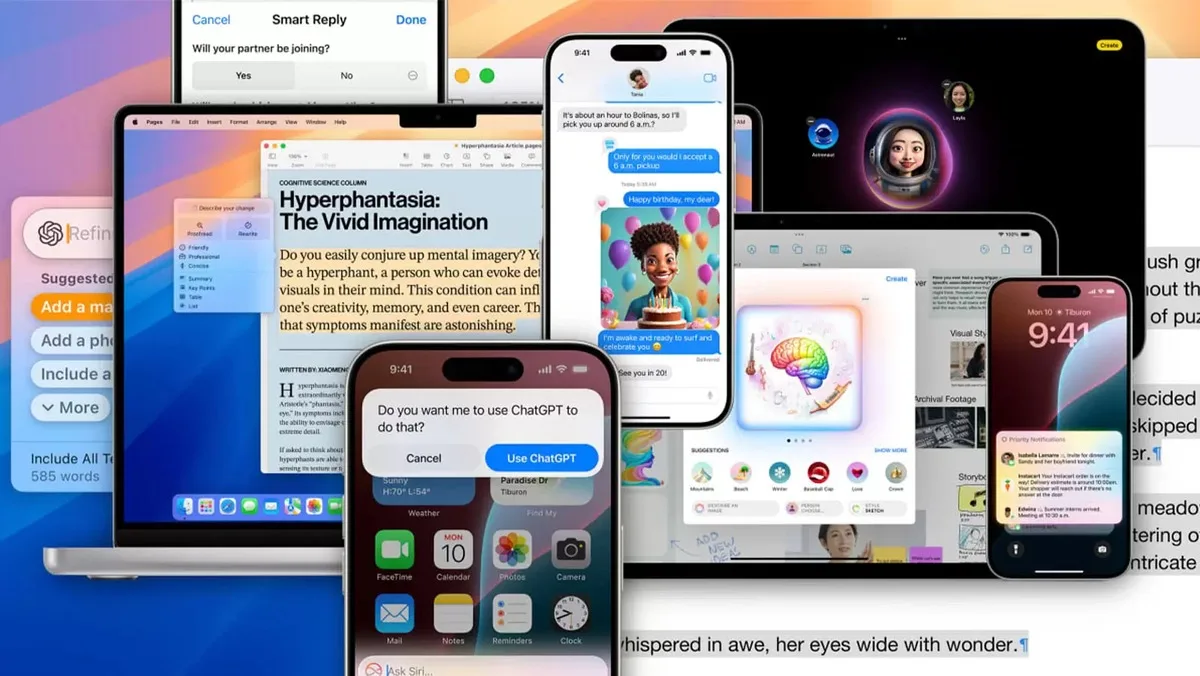

Canvas représente une avancée majeure dans la collaboration homme-machine, offrant un aperçu d’un avenir où l’IA augmentera les capacités humaines dans divers domaines. Le déploiement de Canvas a débuté jeudi dernier pour les abonnés ChatGPT Plus et Teams. Les utilisateurs Enterprise et Education y auront accès cette semaine, et la fonctionnalité sera étendue à tous les utilisateurs gratuits une fois la phase bêta terminée.