Lors de sa conférence Cloud Next ’25, Google a dévoilé une mise à jour majeure de Gemini Code Assist, son assistant de programmation basé sur l’IA. Désormais doté de capacités dites « agentiques », l’outil est capable de gérer des tâches complexes sur plusieurs étapes, à la manière d’un véritable assistant logiciel autonome.

Des agents IA pour automatiser le développement

En preview, Gemini Code Assist peut déployer de nouveaux agents intelligents capables de concevoir des applications complètes à partir de spécifications produit présentes dans un simple document Google Docs, ou encore de convertir du code d’un langage à un autre.

Ces agents vont bien au-delà de la simple suggestion de code : ils peuvent planifier des tâches, exécuter des transformations logicielles, générer de la documentation technique, ajouter de nouvelles fonctionnalités, ou encore effectuer des revues de code et créer des tests unitaires. Le tout peut être supervisé via un tableau Kanban intégré à l’outil.

Gemini Code Assist est désormais intégré à Android Studio, en plus des autres environnements de développement populaires. Une décision stratégique de Google qui vise à renforcer son assistant face à une concurrence de plus en plus féroce.

Une réponse aux concurrents : GitHub Copilot, Cursor, Devin…

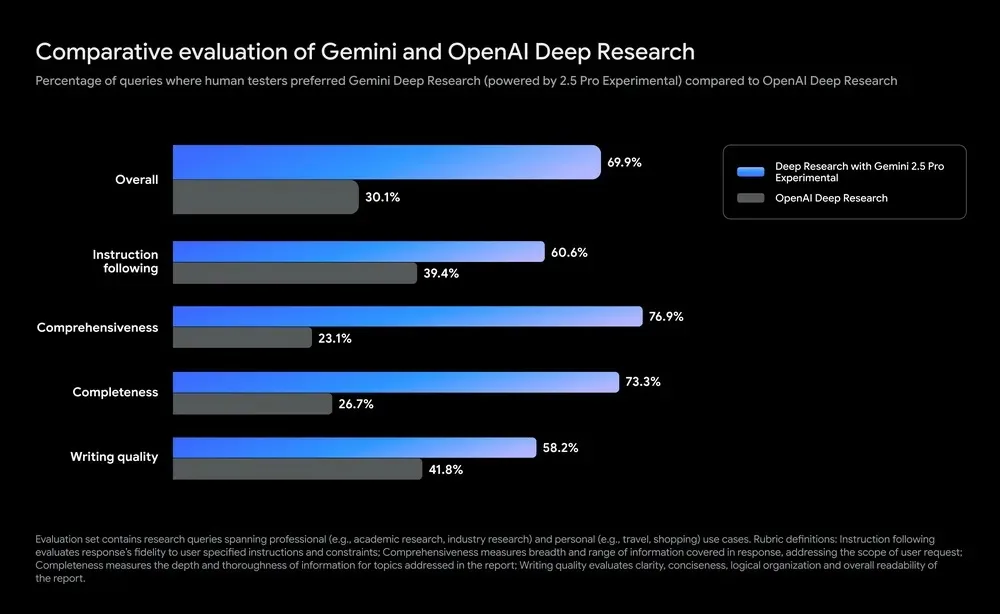

Avec cette évolution, Google entend clairement répliquer aux avancées de GitHub Copilot, Cursor ou encore Devin, l’agent IA développé par Cognition Labs qui a récemment fait sensation. Le marché de l’assistance à la programmation par l’IA devient extrêmement compétitif, porté par les promesses de gains de productivité colossaux.

Mais attention à ne pas céder à l’enthousiasme trop rapidement. Même les meilleurs assistants IA du marché peuvent introduire des bugs ou des failles de sécurité, notamment à cause d’une compréhension encore limitée de la logique et des contraintes spécifiques à chaque langage.

Une étude récente sur Devin a montré que l’agent n’avait réussi que 3 tâches sur 20 dans un benchmark dédié. Il reste donc essentiel de relire et tester systématiquement le code généré, même lorsqu’il provient d’un outil aussi avancé que Gemini Code Assist.

Vers une nouvelle génération d’assistants-développeurs ?

Avec cette mise à jour, Google franchit un cap important : celui de l’automatisation partielle du cycle complet de développement logiciel. Si les agents tiennent leurs promesses, l’IA générative pourrait ne plus se limiter à l’autocomplétion de lignes de code, mais bel et bien assister les équipes dans la planification, l’implémentation, la vérification et la documentation de leurs projets.

Reste à voir si ces agents seront aussi performants qu’ambitieux. Car si l’IA peut déjà accompagner les développeurs, elle ne les remplace pas encore. En tout cas, pas totalement.