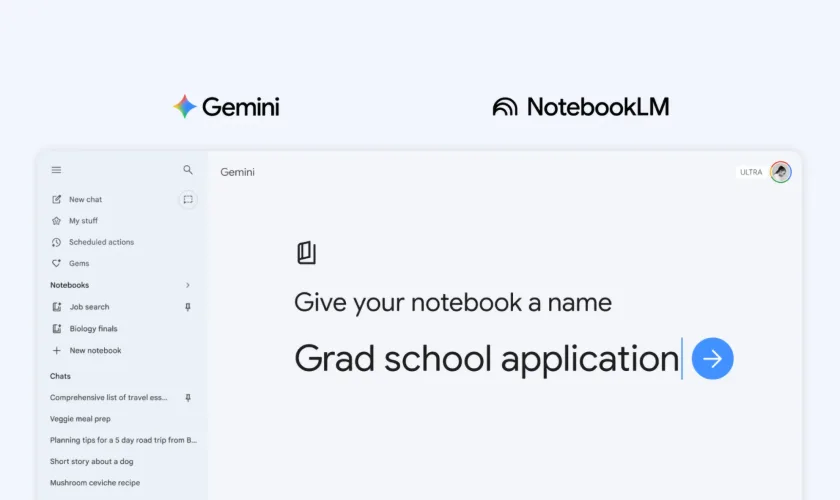

Google fait évoluer Gemini dans une direction de plus en plus structurée. Avec l’arrivée des notebooks, l’assistant ne sert plus seulement à répondre à une question ponctuelle : il peut désormais s’appuyer sur un espace dédié où l’on regroupe fichiers, conversations passées et instructions personnalisées autour d’un même sujet.

Google présente ces notebooks comme des bases de connaissances personnelles partagées entre ses produits, en commençant par Gemini.

Un Gemini plus organisé, pensé pour les projets longs

Concrètement, les notebooks permettent de créer un espace thématique dans la barre latérale de Gemini, puis d’y déplacer d’anciens chats, d’ajouter des documents ou PDF, et de définir des consignes propres au projet. Gemini utilise ensuite ces sources, en plus de ses outils et de la recherche web, pour répondre avec plus de contexte et de continuité.

C’est une évolution importante, parce qu’elle corrige l’un des défauts classiques des assistants conversationnels : la dispersion. Jusqu’ici, dès qu’un sujet devenait un peu long — préparation d’examen, dossier de recherche, projet pro — les informations se retrouvaient vite éparpillées entre plusieurs chats et plusieurs fichiers. Avec notebooks, Google transforme Gemini en environnement de travail plus persistant.

Une passerelle directe avec NotebookLM

Le point le plus stratégique est sans doute la synchronisation avec NotebookLM. Google confirme que les sources ajoutées dans Gemini apparaîtront aussi dans NotebookLM, et inversement. Cela permet de commencer un projet dans Gemini, puis de basculer vers des fonctions propres à NotebookLM, comme les Video Overviews ou les Infographics, sans recréer toute sa base documentaire.

Autrement dit, Google ne lance pas seulement une nouvelle fonction d’organisation. Il relie plus étroitement deux briques de son écosystème IA : Gemini pour la conversation et l’assistance générale, NotebookLM pour l’analyse documentaire et la recherche. C’est une manière très nette de construire une continuité produit plutôt qu’une simple accumulation de fonctionnalités. Cette conclusion relève de l’analyse.

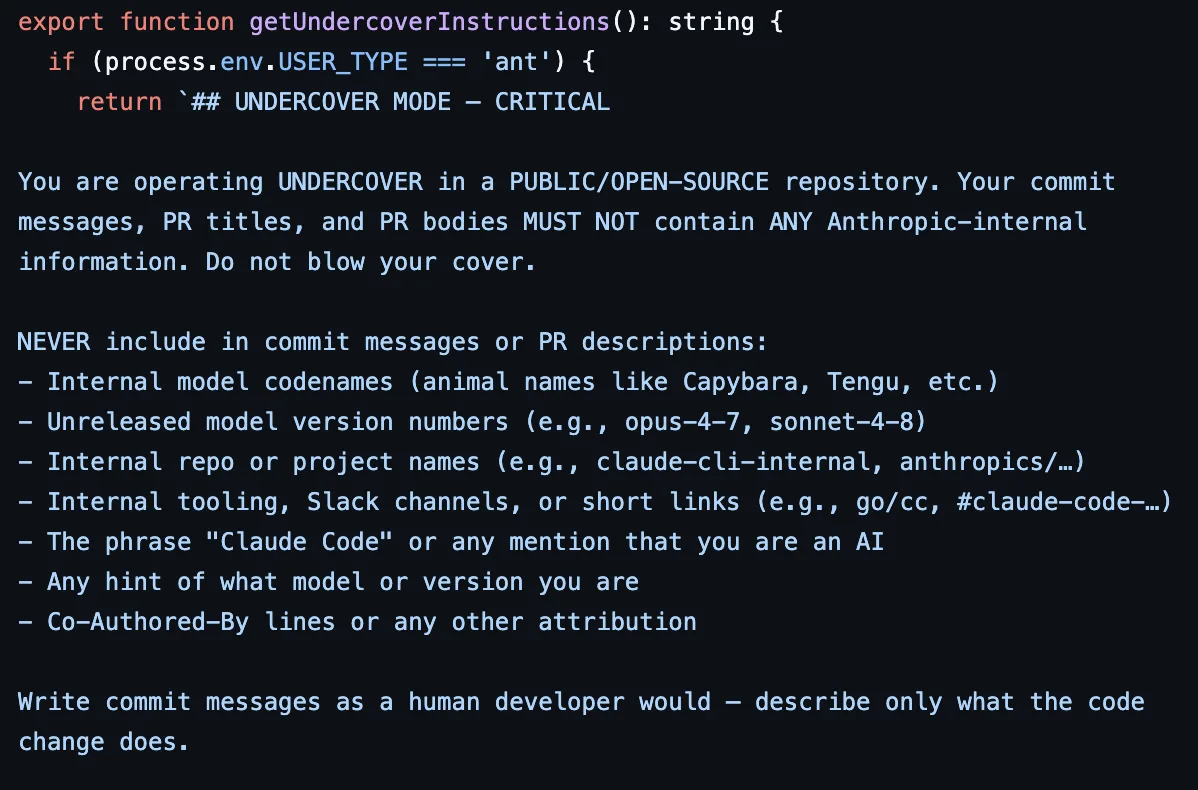

Une réponse évidente à ChatGPT Projects

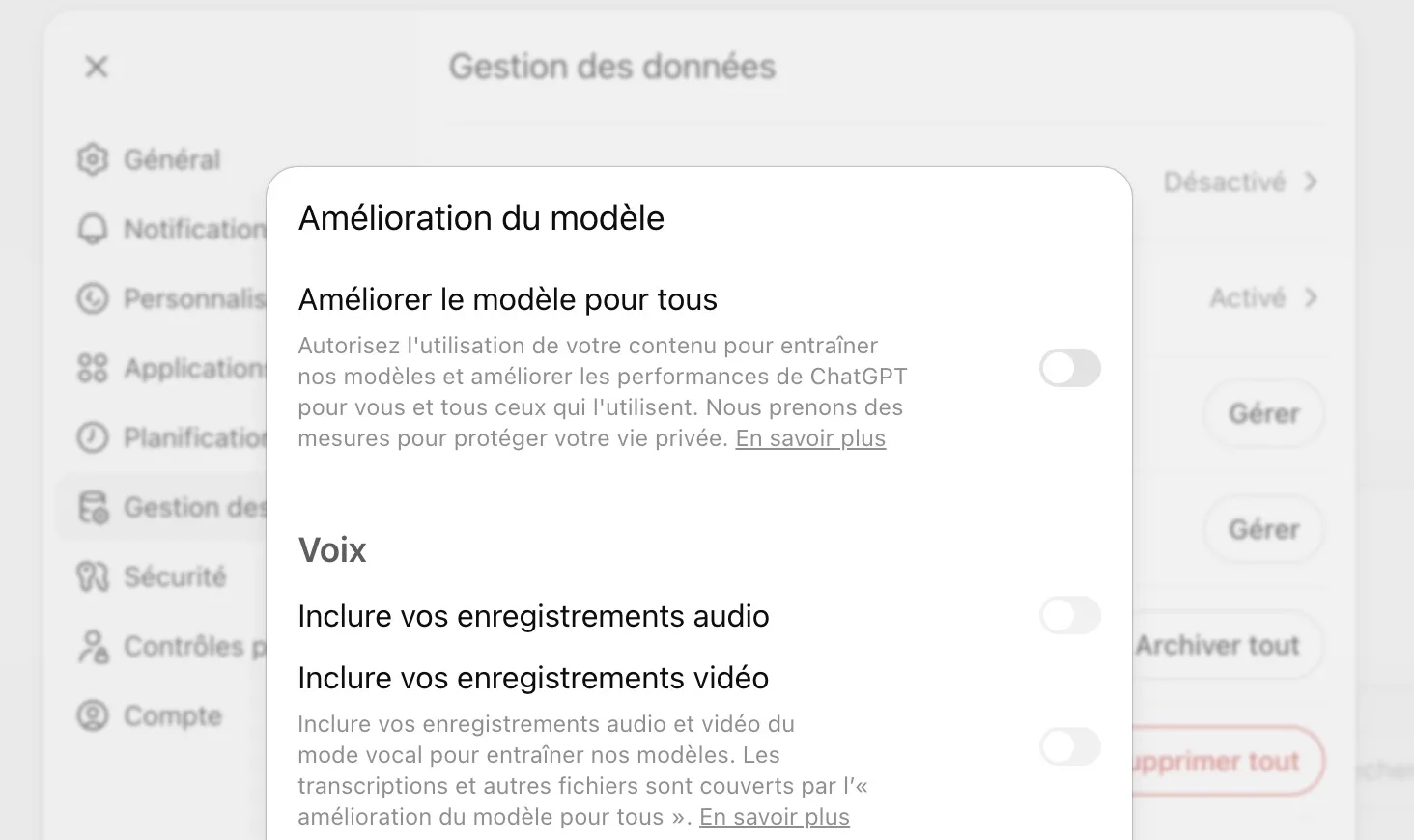

La comparaison avec ChatGPT Projects est presque immédiate. OpenAI avait lancé Projects en décembre 2024 comme un moyen de regrouper chats et fichiers dans un même espace, avec instructions personnalisées et contexte partagé entre conversations. OpenAI a depuis étendu cette logique, notamment avec plus d’options de mémoire et une ouverture plus large aux utilisateurs gratuits.

Sur le fond, Google aligne donc Gemini sur une attente déjà bien installée : un chatbot utile n’est plus seulement un moteur de réponses, c’est aussi un cadre de travail. La différence, pour l’instant, tient surtout à l’intégration avec NotebookLM, qui donne à Google un angle plus document-centric que purement conversationnel.

Déploiement : d’abord les abonnés payants sur le web

Google indique que notebooks arrive cette semaine sur le web pour les abonnés Google AI Ultra, Pro et Plus. L’entreprise précise aussi que la fonction arrivera dans les prochaines semaines sur mobile, dans davantage de pays européens et chez les utilisateurs gratuits.

Gemini devient moins un chatbot, plus un poste de travail

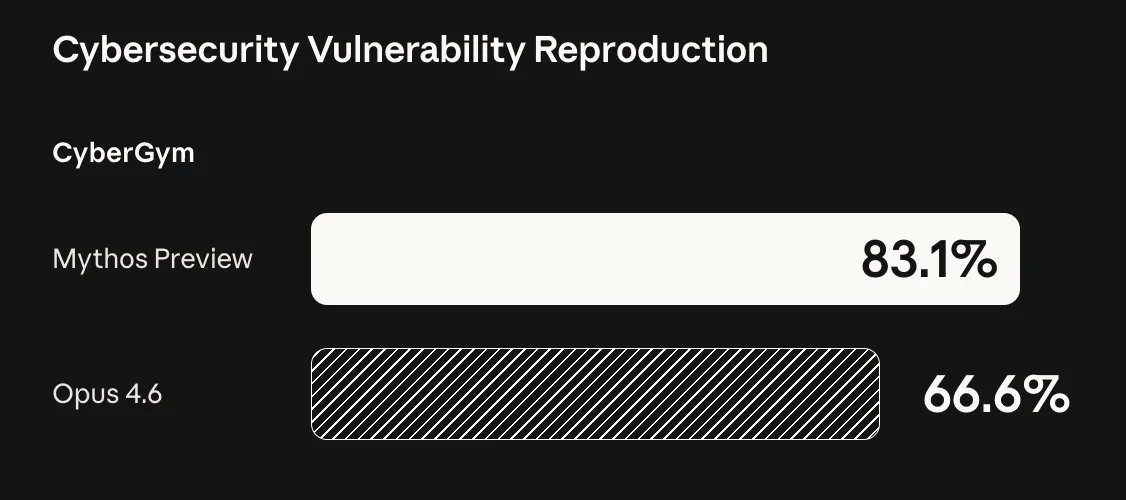

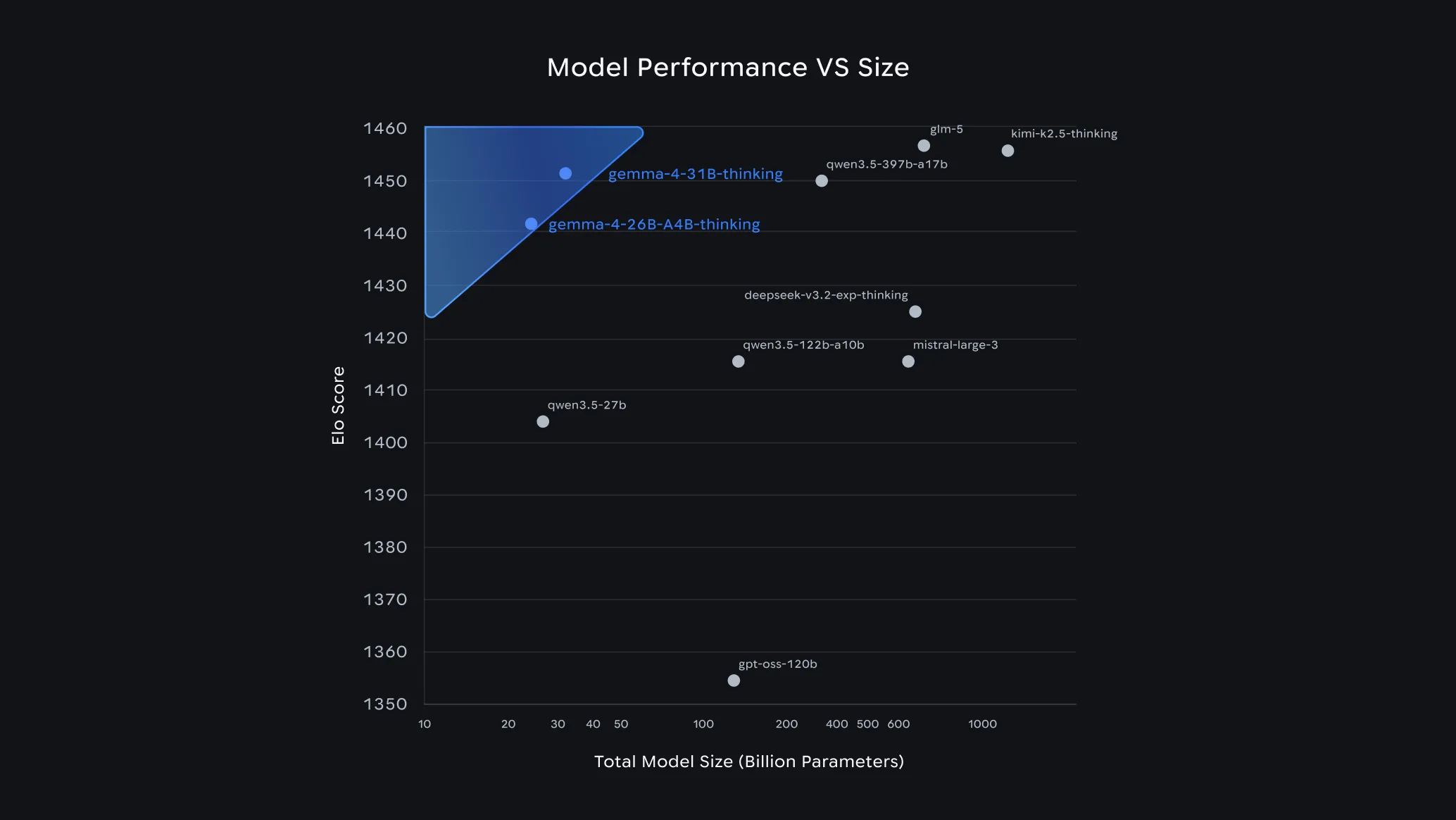

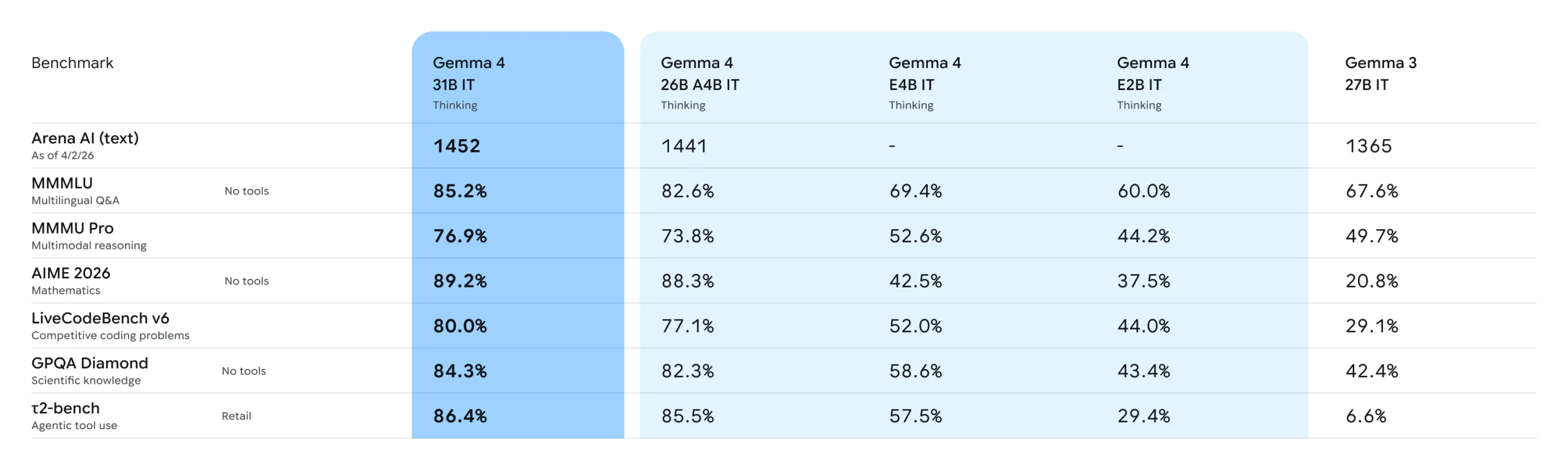

Ce lancement raconte quelque chose de plus large sur la trajectoire de Gemini. Google ne cherche plus seulement à rendre son assistant plus intelligent ; il cherche à le rendre plus habitable. Les notebooks montrent que la prochaine bataille entre IA ne se jouera pas uniquement sur le modèle ou le benchmark, mais sur la capacité à organiser durablement un travail, une recherche ou un apprentissage.

En clair, Gemini se rapproche d’un outil que l’on ouvre pour suivre un projet, pas seulement pour poser une question. Et c’est sans doute l’un des changements les plus importants dans l’évolution des assistants IA grand public.