L’IA n’a jamais été aussi accessible… du moins en théorie. Entre les modèles open source, les alternatives locales à ChatGPT, les outils de clonage vocal ou encore les générateurs 3D, on vit une période d’explosion créative. Mais, il reste un frein énorme : installer ces modèles IA est souvent une galère monumentale.

Environnement virtuel, dépendances, UI impossible à trouver, erreurs obscures… Résultat : beaucoup abandonnent avant même d’avoir testé quoi que ce soit.

C’est exactement là que Pinokio change la donne.

L’auto-hébergement IA est devenu incroyablement puissant… si vous arrivez à le faire tourner

Il y a quelques années, générer une vidéo grotesque de Will Smith mangeant des spaghettis demandait presque un data center.

Aujourd’hui, un PC gamer ou un Mac M 2/M 3 avec suffisamment de RAM unifiée suffit pour créer des images réalistes en quelques secondes, fabriquer vos propres voix de synthèse, générer des modèles 3D complets, ou même héberger votre ChatGPT privé, entièrement hors-ligne.

Les possibilités sont délirantes : assistant maison façon Alexa, livres lus par n’importe quelle voix, automatisations perso… Seule limite : votre matériel — et votre patience lors de l’installation.

Pinokio : l’outil gratuit et open source qui automatise tout

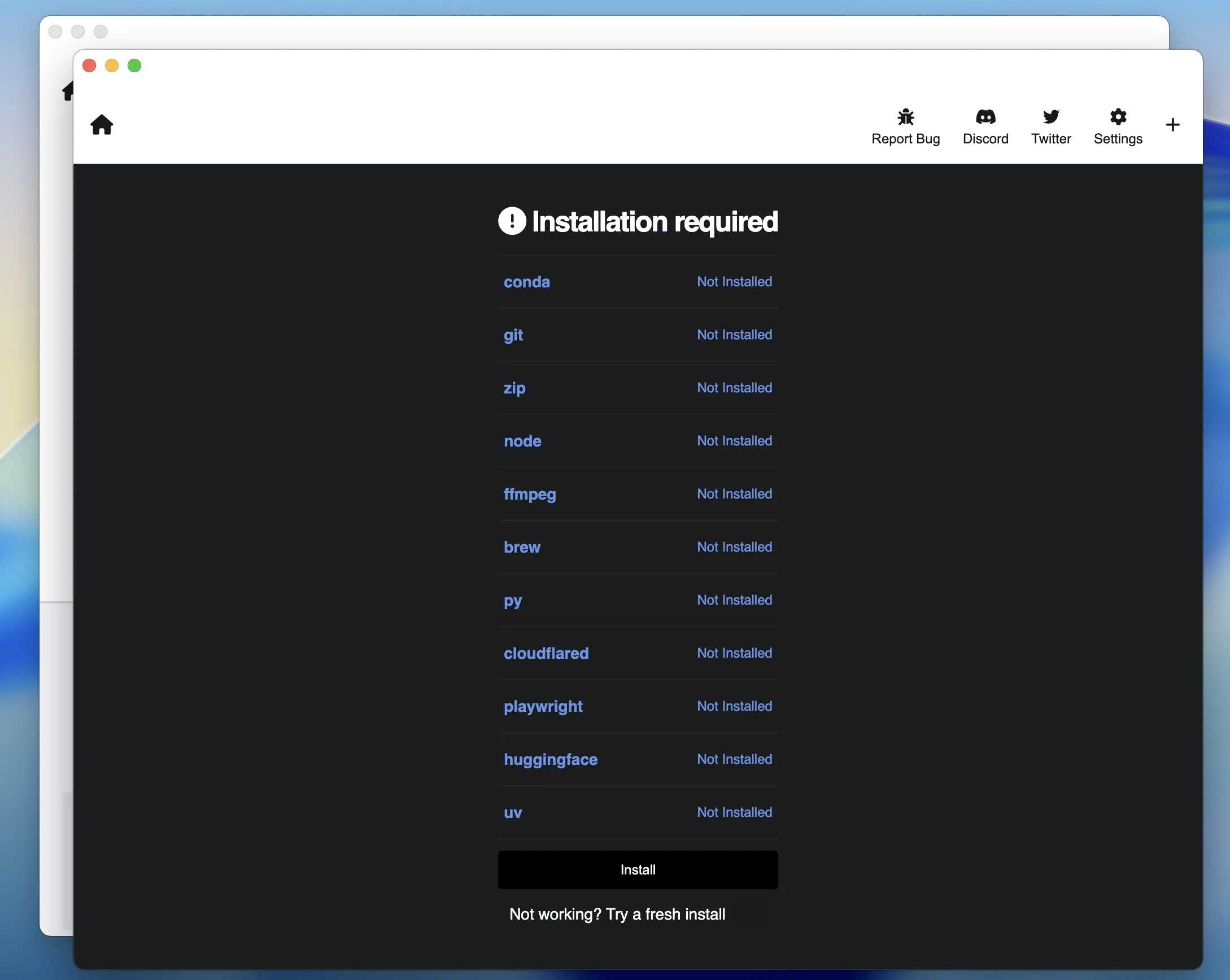

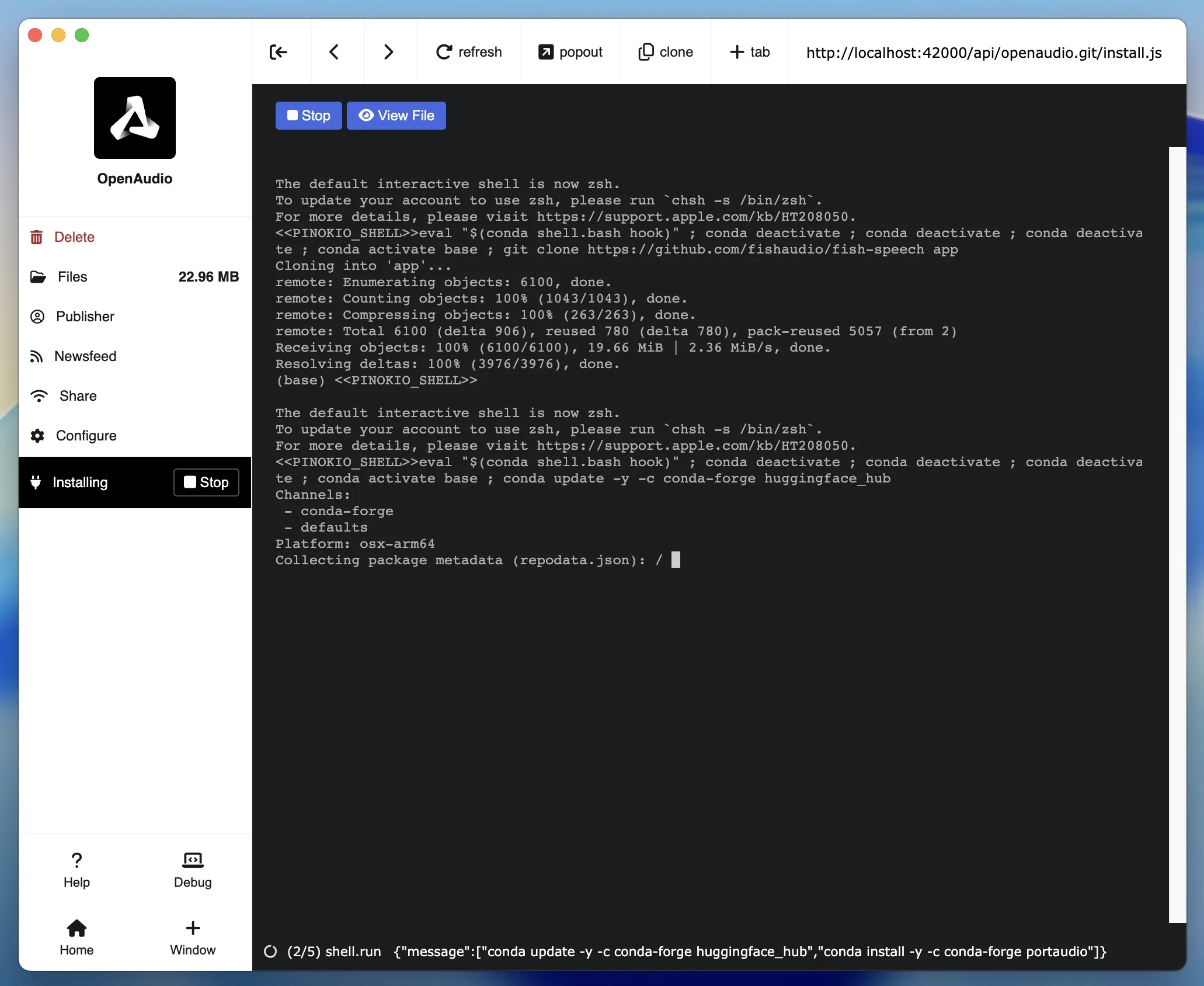

Pinokio est une application open source qui sert d’installateur universel pour modèles IA. Le principe est simple : pour chaque IA, une script recipe automatise absolument tout.

- Installation

- Téléchargement des dépendances

- Configuration de l’UI

- Lancement en un clic

- Et même désinstallation propre

Vous n’avez rien à configurer. Vous cliquez, Pinokio installe, et ça tourne. C’est littéralement l’App Store de l’IA locale.

L’application Pinokio est supportée pour les principaux systèmes d’exploitation. Il existe une version pour Windows, macOS et Linux.

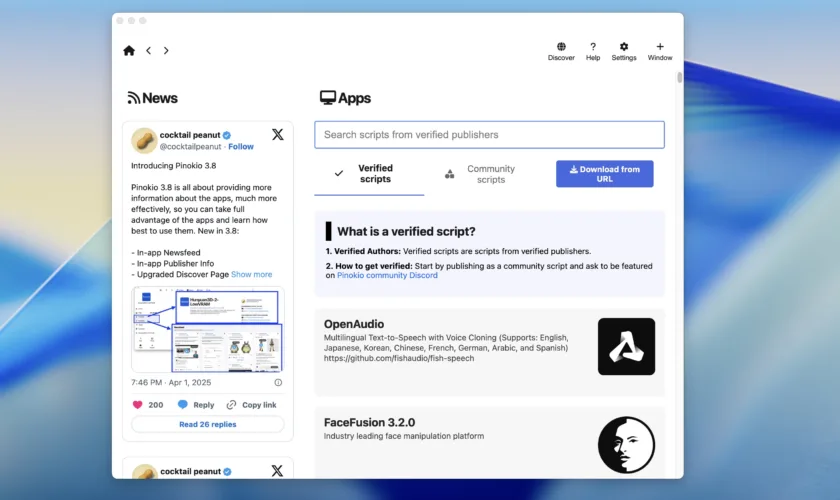

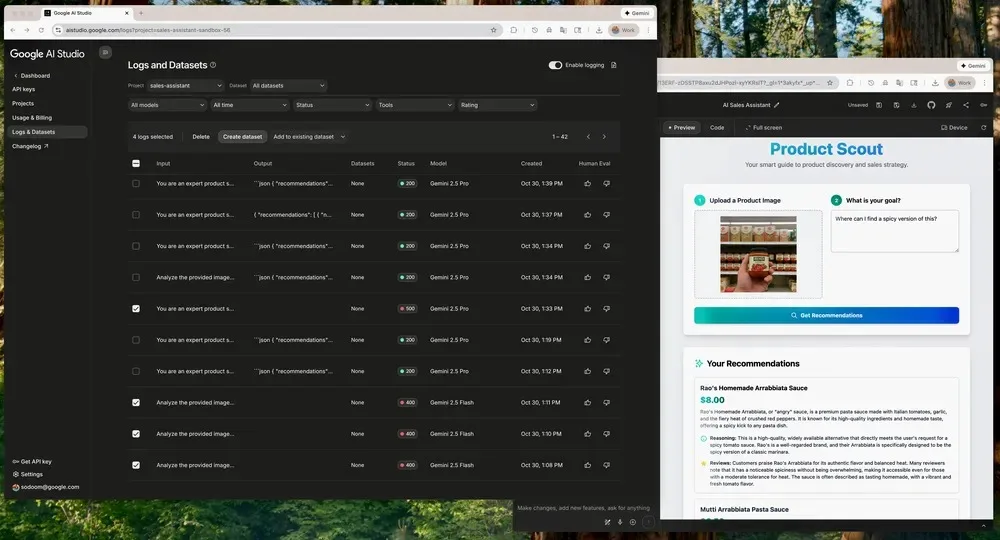

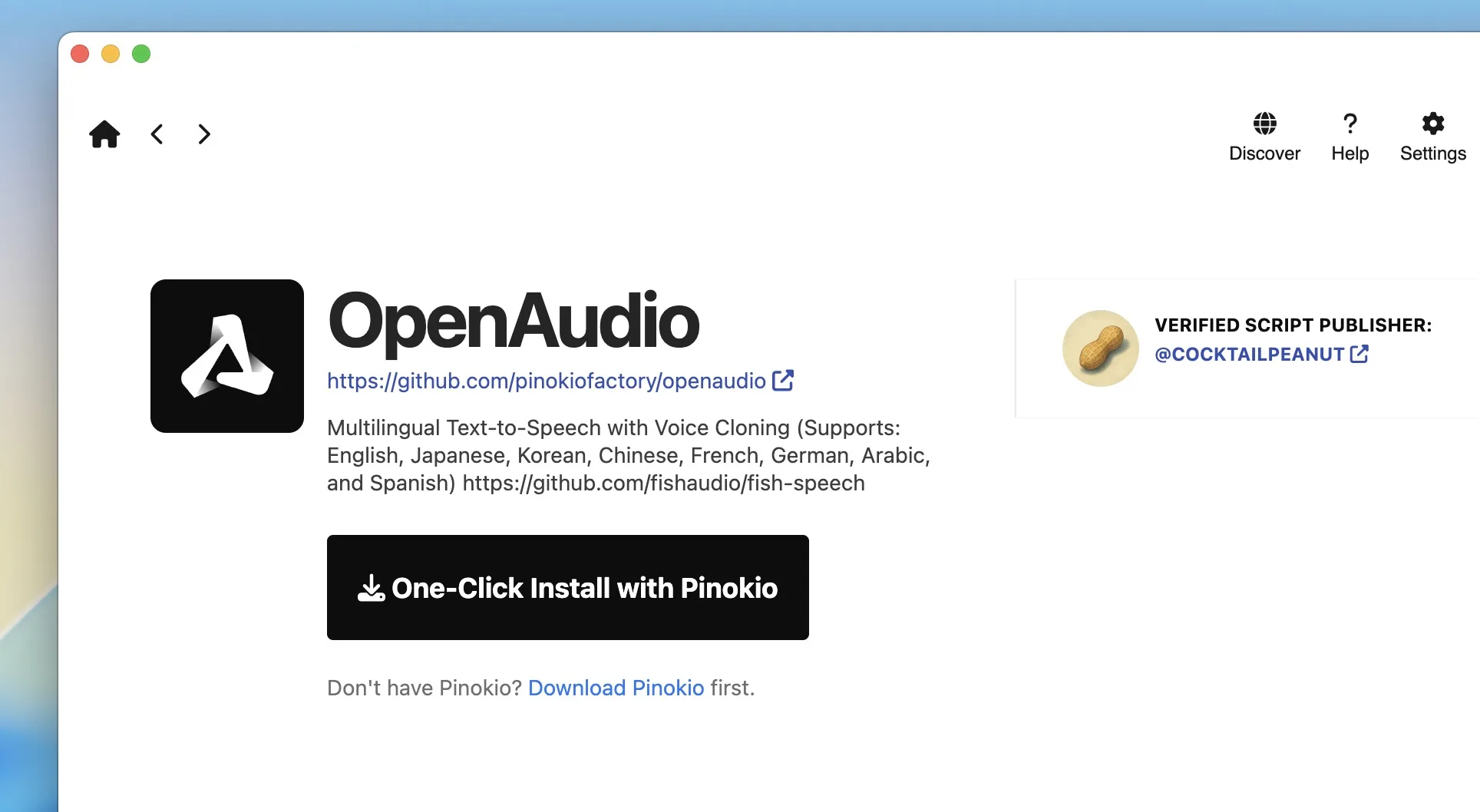

Explorer et installer des IA dans Pinokio

Quand l’app est lancée :

- onglet Discover,

- section Verified (fortement recommandée pour commencer).

Chaque modèle propose un bouton : « One-Click Install with Pinokio ». Ensuite, laissez-faire : les modèles IA peuvent peser 10 à 40 Go, et il faut laisser du temps au script.

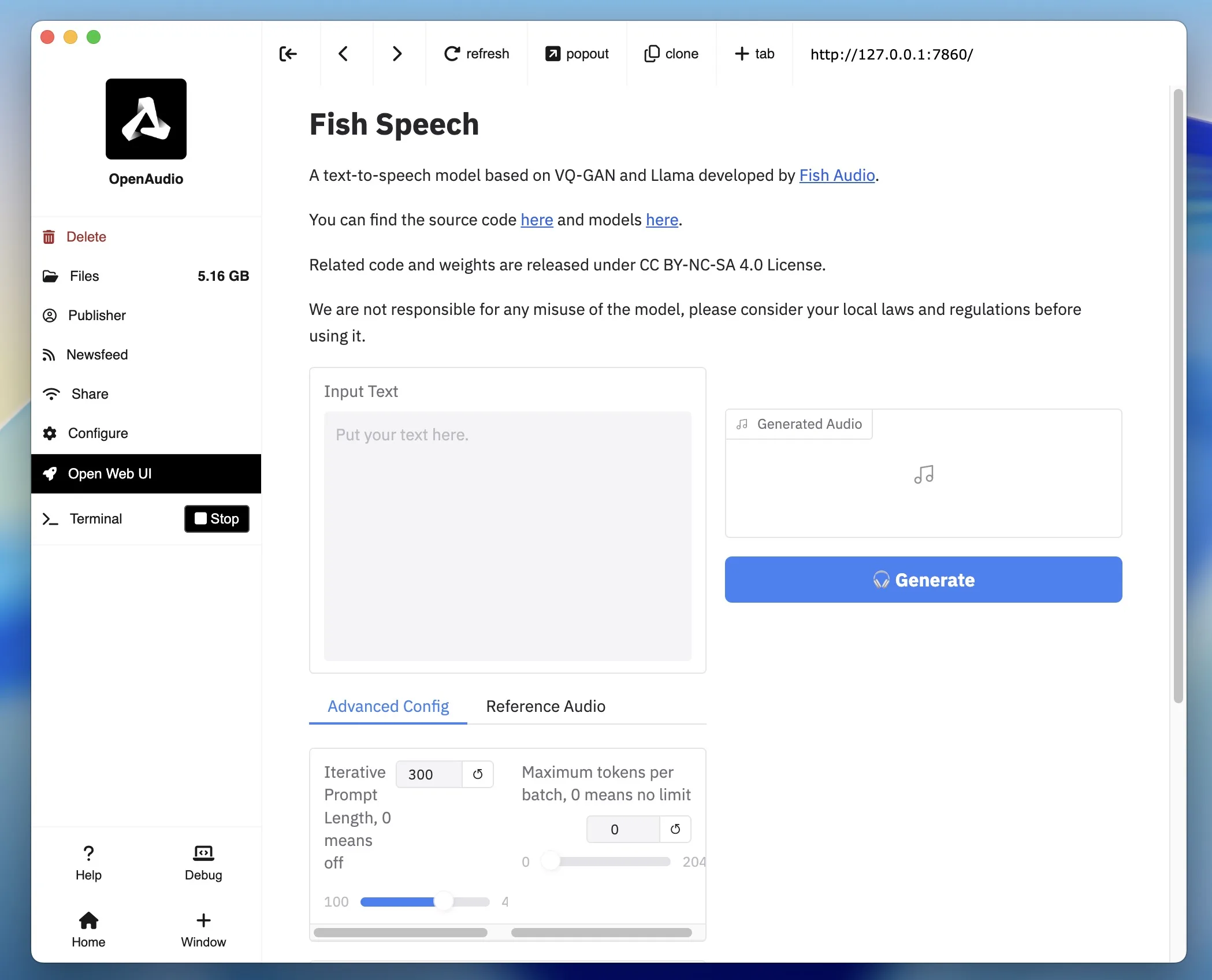

L’interface finale dépend du modèle : par exemple, OpenAudio (clonage vocal) ouvre son propre panneau UI automatiquement.

Désinstaller proprement — ou corriger les installations ratées

Un bug ? Une install corrompue ? Le modèle ne vous convient plus ? Pinokio s’en occupe : bouton Delete, et les fichiers et dépendances sont supprimés proprement.

Pinokio est-il sûr ?

Comme tout projet communautaire : risque potentiel = oui. Mais, les scripts sont simples et faciles à auditer, la communauté est ultra-active, les modèles populaires sont surveillés, et un script malveillant serait repéré très vite.

En pratique, la communauté le considère comme raisonnablement sûr, surtout en utilisant les modèles vérifiés.

Attention : l’espace de stockage est votre futur ennemi

Les modèles modernes (Gemma, Qwen, Mistral, etc.) peuvent dépasser :

- 8 Go (petits modèles)

- 20–40 Go (moyens)

- +100 Go (monstres 70B)

Si vous comptez héberger plusieurs IA, prévoyez un SSD NVMe de 2 To minimum, ou un dédié uniquement aux modèles. C’est probablement l’investissement le plus important dans une config IA locale.

Pinokio est ce qu’il manquait pour démocratiser l’IA locale

Grâce à Pinokio, tester un clone vocal, une IA type ChatGPT, un générateur vidéo, un modèle 3D, un outil d’automatisation IA ou encore un assistant maison devient enfin accessible à n’importe qui, même sans compétences techniques.

C’est peut-être l’outil qui fera réellement exploser l’auto-hébergement IA dans le grand public.