OpenAI s’apprête à renforcer sa pile technologique. OpenAI a récemment annoncé l’acquisition de Rockset, une startup spécialisée dans l’analyse d’entreprise, dans le but de « renforcer notre infrastructure de récupération à travers nos produits, » selon un article de blog publié vendredi.

Bien que les termes de l’accord n’aient pas été divulgués, OpenAI a confirmé qu’elle intégrerait les capacités d’indexation et d’interrogation de Rockset afin de renforcer son infrastructure de recherche pour l’ensemble de ses produits. L’entreprise a également ajouté que toute l’équipe de Rockset sera transférée à OpenAI dans le cadre de l’acquisition.

Il s’agit de la deuxième acquisition majeure annoncée publiquement par OpenAI, après celle de la startup new-yorkaise Global Illumination, Inc. l’année dernière.

We’ve acquired Rockset, a leading real-time analytics database that provides world-class data indexing and querying capabilities. We’ll integrate Rockset’s technology across our products, empowering companies to transform their data into actionable intelligence.…

— OpenAI (@OpenAI) June 21, 2024

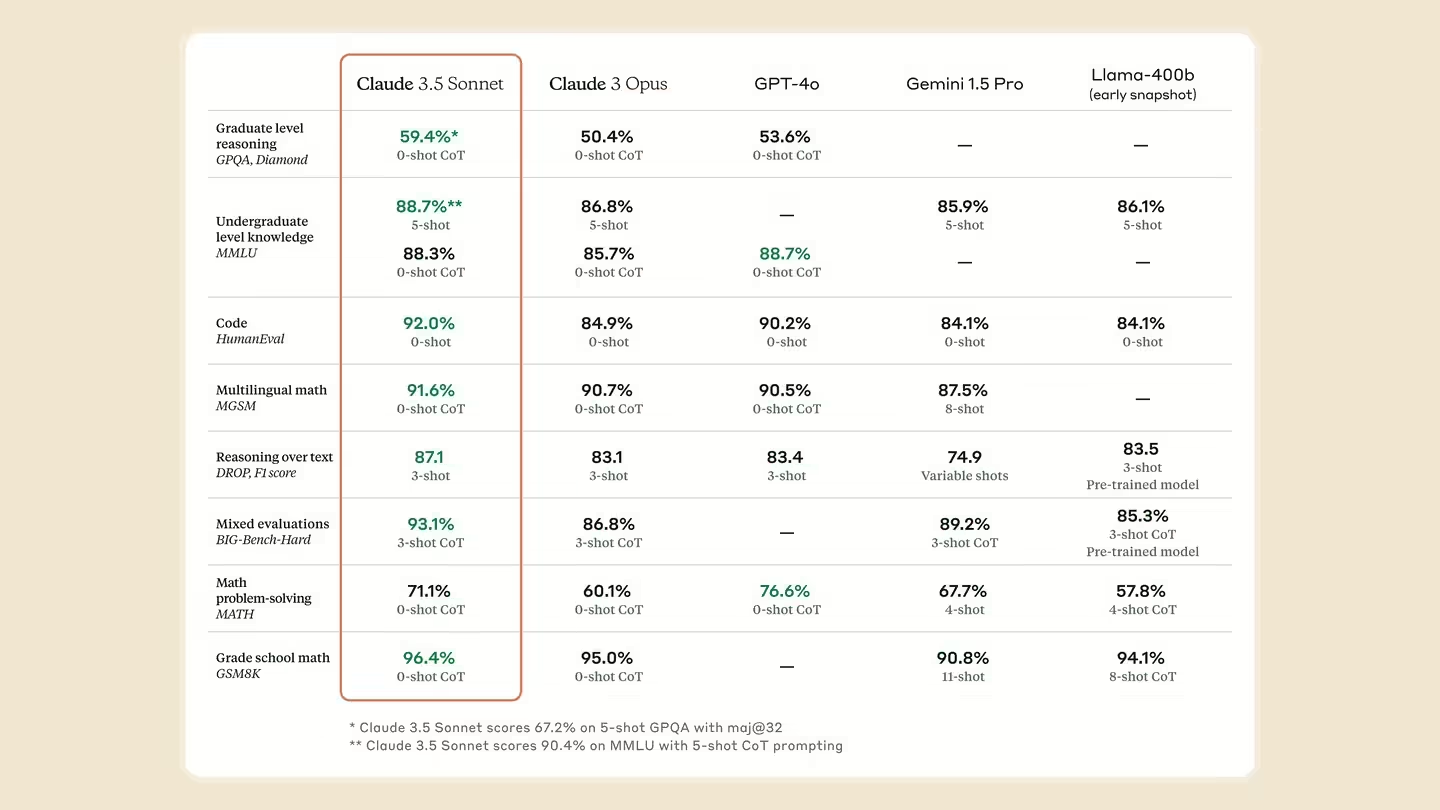

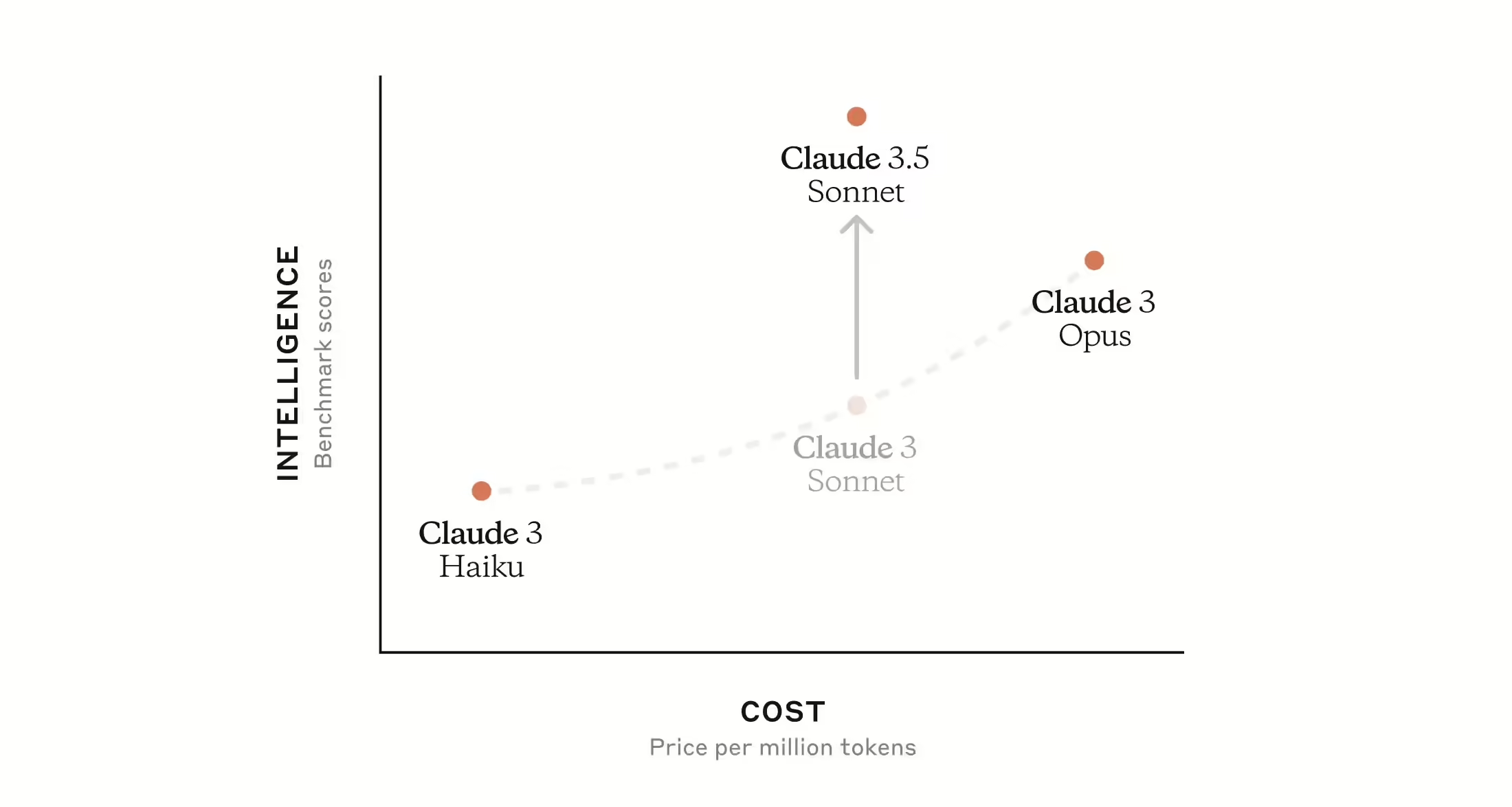

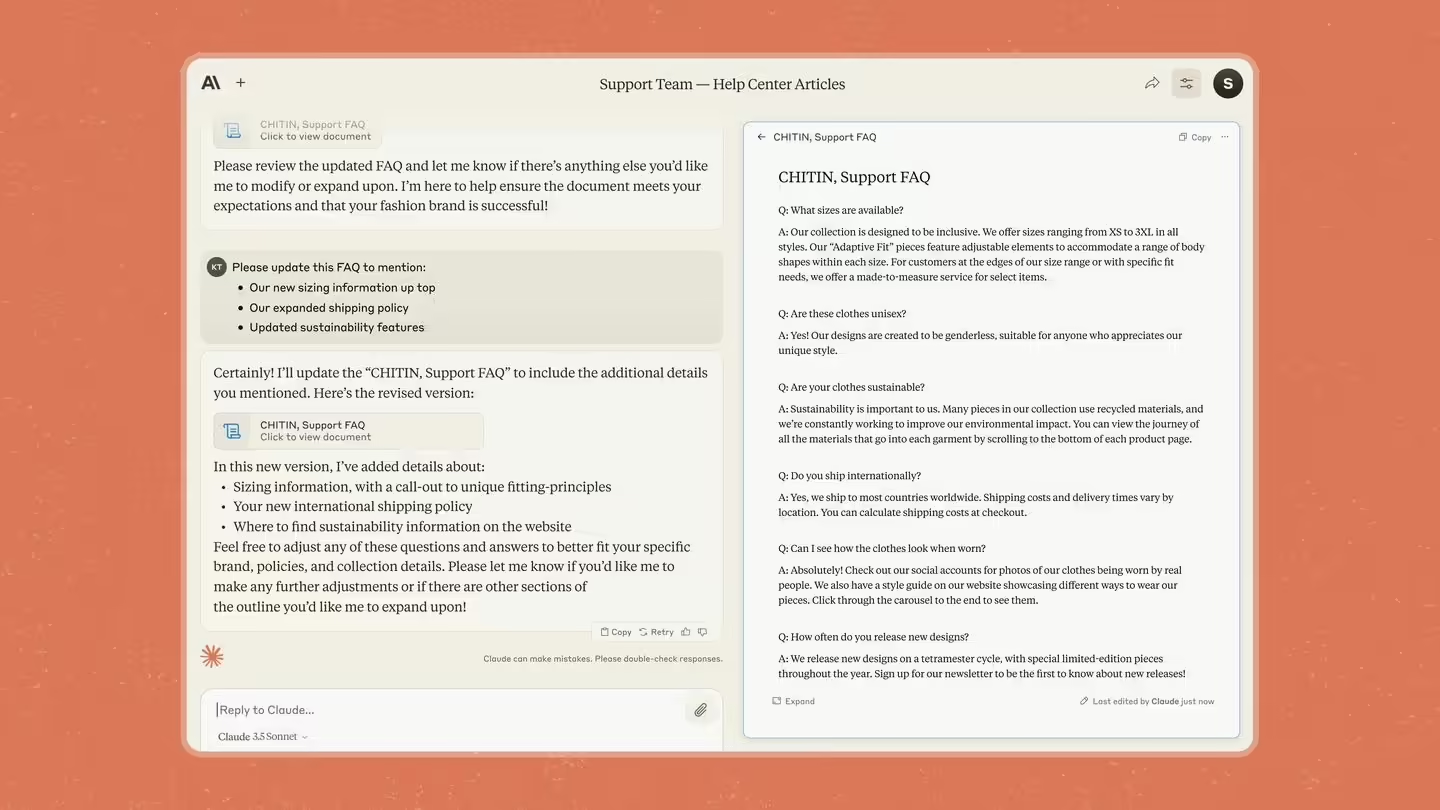

Cette décision intervient également alors que la concurrence dans le domaine de l’IA générique continue de s’intensifier. Cette semaine encore, Anthropic, l’un des principaux concurrents d’OpenAI, a publié Claude 3.5 Sonnet, un puissant LLM qui surpasse de manière convaincante le GPT-4o récemment publié par OpenAI sur les bancs d’essai.

Comment Rockset va-t-il alimenter OpenAI ?

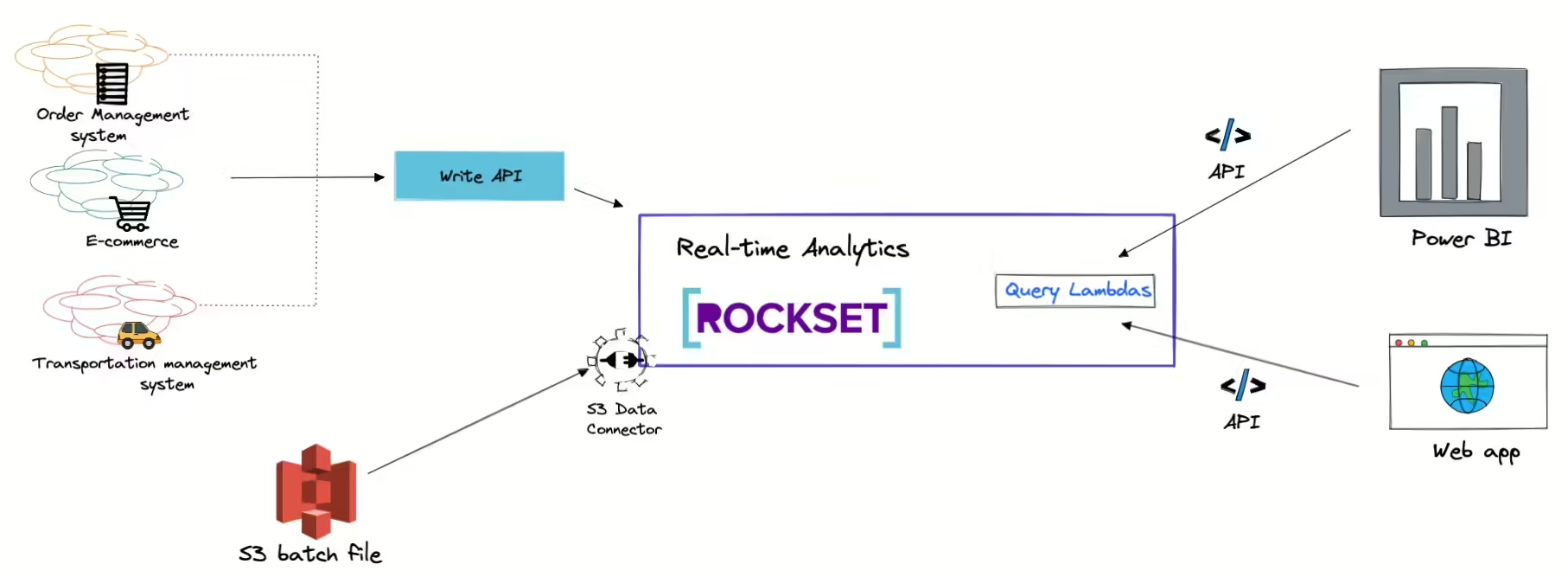

Fondée en 2016, Rockset fournit aux entreprises une base de données analytique en temps réel basée sur le cloud qui permet aux développeurs de créer des applications à forte intensité de données, telles que celles destinées à la personnalisation et à l’automatisation informatique, à l’échelle.

Le produit ingère et indexe en permanence des données provenant de sources telles que Kafka, MongoDB, DynamoDB et S3, ce qui permet de disposer d’informations et d’effectuer des requêtes en temps réel. Il peut exécuter des requêtes SQL en moins d’une seconde sur des données semi-structurées, sans nécessiter de schéma prédéfini.

Au cœur de Rockset se trouve la base de données intégrée hautes performances pour les données clé-valeur RocksDB, créé par Meta (anciennement Facebook). Il agit comme un index secondaire externe pour les bases de données OLTP, les data lakes et les plateformes de streaming, accélérant les requêtes analytiques en temps réel et fournissant une isolation des performances pour les systèmes transactionnels primaires. Tout au long de l’année 2023, l’entreprise a amélioré son produit avec des capacités visant à alimenter les cas d’utilisation de l’IA.

Maintenant, avec l’acquisition par OpenAI, la pile technologique construite par Rockset, en particulier les capacités d’indexation et d’interrogation « de classe mondiale », alimentera la pile de recherche d’OpenAI.

Une bonne nouvelle pour les utilisateurs ?

Les deux entreprises n’ont pas encore communiqué les détails exacts de cette intégration, mais une chose est sûre : Rockset permettra aux produits d’OpenAI de répondre aux questions des clients avec les informations les plus récentes et les plus pertinentes, plus rapidement que jamais.

« L’infrastructure de Rockset permet aux entreprises de transformer leurs données en informations exploitables. Nous sommes ravis d’apporter ces avantages à nos clients en intégrant les fondations de Rockset dans les produits OpenAI », a déclaré Brad Lightcap, COO d’OpenAI, dans un communiqué.

Cette acquisition marque une étape significative pour OpenAI, renforçant sa capacité à offrir des solutions d’IA plus robustes et évolutives.