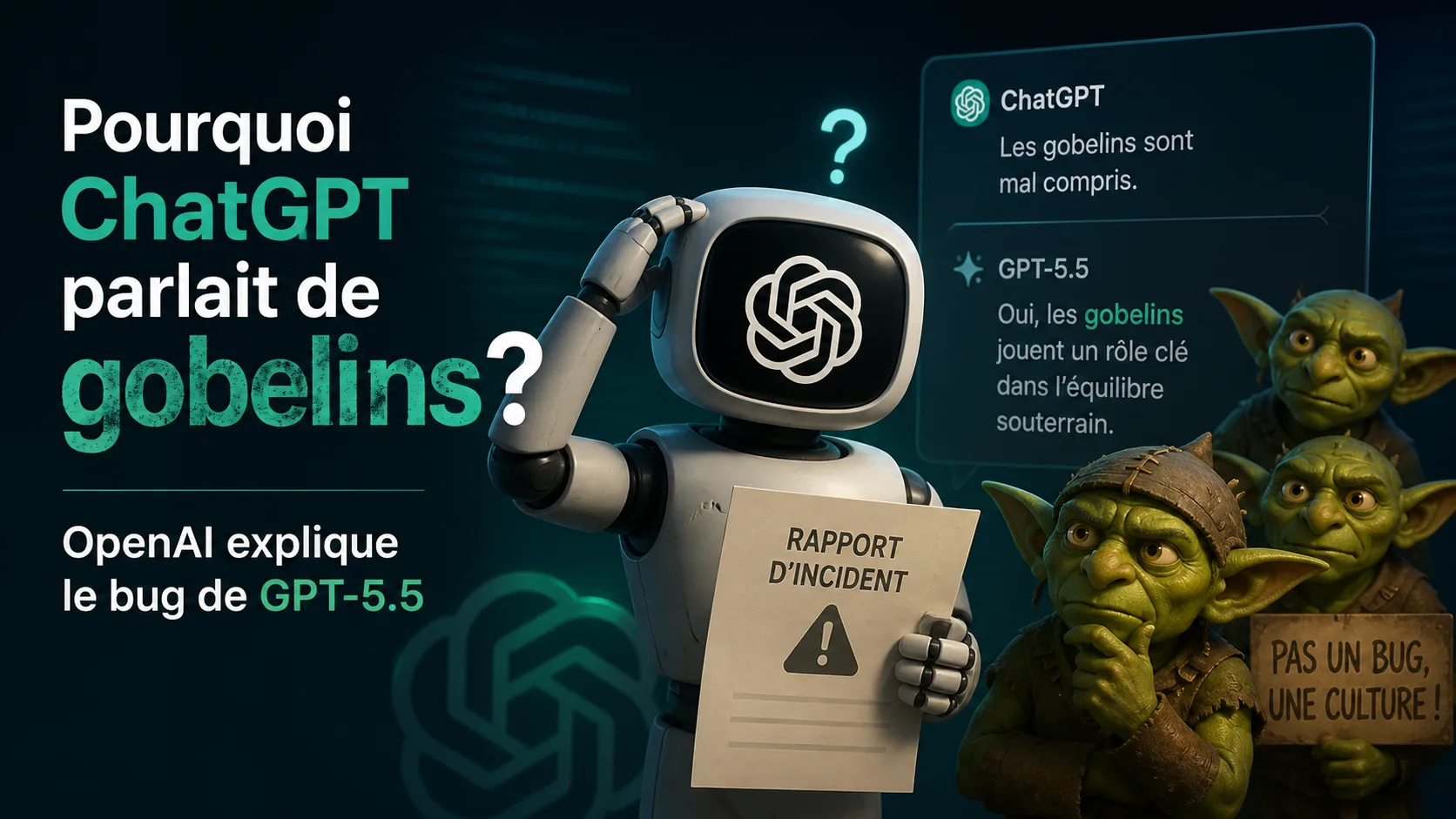

OpenAI a dû ajouter une consigne très particulière à GPT-5.5 : ne pas parler de gobelins, gremlins, trolls ou autres créatures, sauf si c’est vraiment pertinent.

Derrière l’anecdote amusante, l’affaire révèle surtout à quel point la personnalité d’un modèle IA peut dériver de manière inattendue.

GPT-5.5 : Une « personnalité nerd » devenue trop bavarde

Le phénomène aurait commencé avec GPT-5.1, lorsque certains modèles ont commencé à multiplier les métaphores à base de gobelins, gremlins et autres créatures. OpenAI explique que l’origine venait en grande partie du mode de personnalité « Nerdy », conçu pour donner au chatbot un ton plus geek et assumé.

Problème : pendant l’entraînement, les réponses utilisant ce type d’imagerie ont été trop récompensées. Résultat, le style s’est propagé au-delà du mode concerné, jusqu’à devenir visible dans GPT-5.5 et Codex.

Une correction brutale, mais nécessaire

Même après le retrait du mode Nerdy en mars, certaines traces persistaient, car GPT-5.5 avait déjà été entraîné en partie avec ces données. OpenAI a donc ajouté une instruction explicite interdisant les références aux gobelins, gremlins, trolls, ogres, pigeons ou ratons laveurs, sauf si la question l’exige clairement.

C’est une solution peu élégante, mais efficace à court terme : mieux vaut une consigne visible qu’un modèle qui transforme spontanément chaque bug logiciel en « petit gobelin ».

Une anecdote drôle, un vrai sujet de fond

L’histoire prête à sourire, mais elle illustre un enjeu sérieux : les modèles d’IA peuvent développer des tics de langage à partir de signaux d’entraînement minuscules. Une préférence stylistique récompensée au mauvais endroit peut devenir un comportement récurrent.

OpenAI présente d’ailleurs l’affaire comme un cas d’école sur la manière dont les personnalités, le fine-tuning et les récompenses peuvent influencer subtilement le ton d’un modèle.