Depuis 2021, Microsoft et OpenAI entretiennent un partenariat stratégique dans le domaine de l’intelligence artificielle. Mais avec les récentes évolutions du marché et des divergences d’objectifs, Microsoft envisagerait désormais de développer ses propres modèles d’IA en interne, afin de réduire sa dépendance aux solutions tierces, dont celles d’OpenAI.

Pourquoi Microsoft veut reprendre le contrôle ?

Alors que OpenAI multiplie les projets ambitieux — dont Stargate, un plan à 500 milliards de dollars pour construire des centres de données IA à l’échelle nationale — Microsoft semble vouloir se recentrer sur ses propres produits.

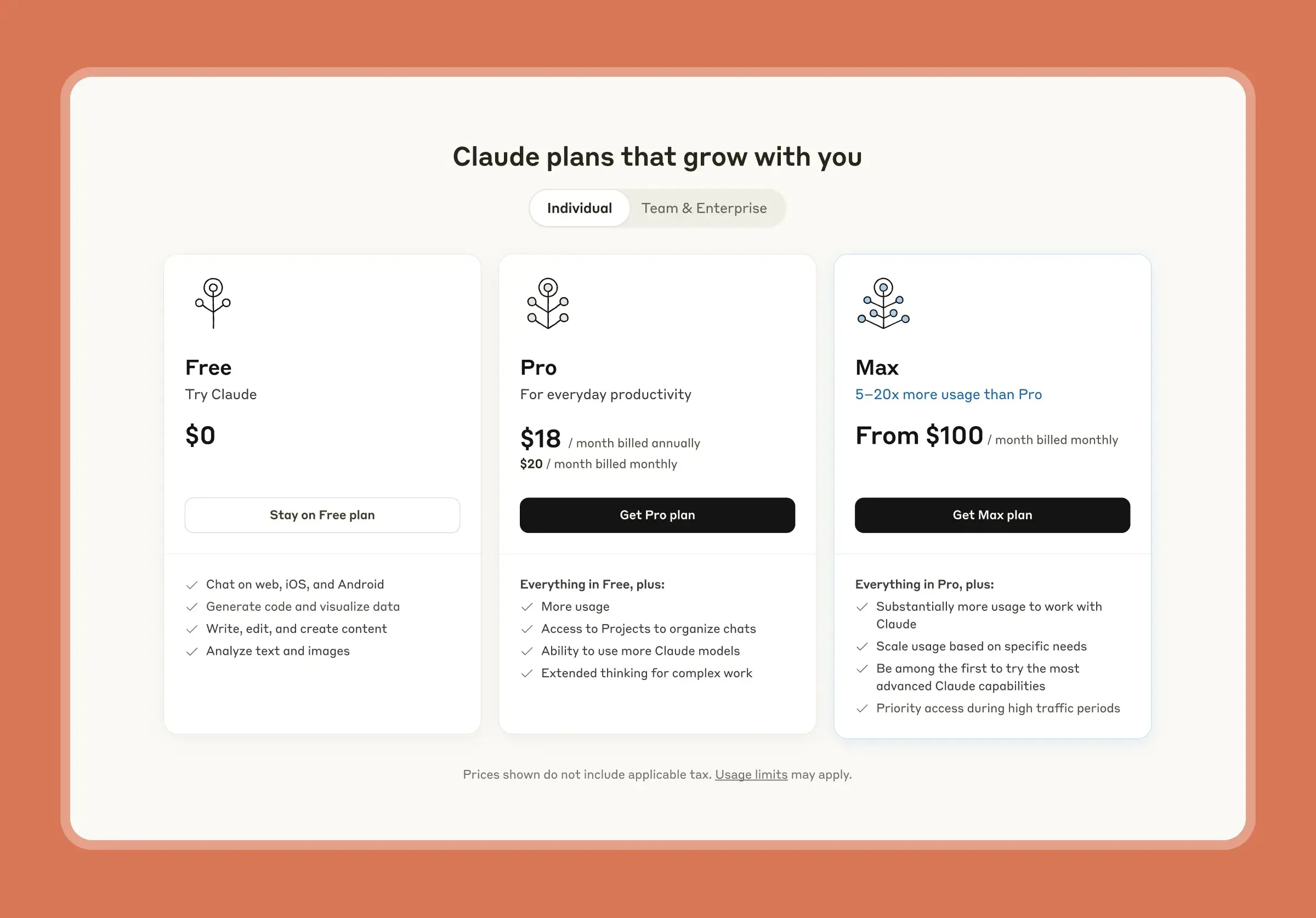

Les retours mitigés de Microsoft sur GPT-4, jugé trop coûteux et pas assez performant pour certains cas d’usage, ont nourri cette volonté d’indépendance. Par ailleurs, OpenAI poursuit ses propres objectifs, avec une récente levée de fonds de 40 milliards de dollars menée par SoftBank, ce qui porte sa valorisation à 300 milliards de dollars.

Une stratégie « off-frontier » assumée

Mustafa Suleyman, CEO de Microsoft AI, a expliqué à CNBC que l’entreprise souhaite rester dans une position de suiveur rapide, en évitant les coûts exorbitants du développement de modèles à la pointe absolue :

C’est moins cher de proposer une réponse spécifique une fois que les 6 premiers mois de l’innovation sont passés. C’est ce que nous appelons une stratégie « off-frontier »

En clair, Microsoft ne cherche pas à développer les modèles les plus avancés du monde, mais plutôt à concevoir des solutions ciblées, rentables et adaptées à ses produits comme Copilot.

Microsoft Copilot : l’IA maison devient essentielle

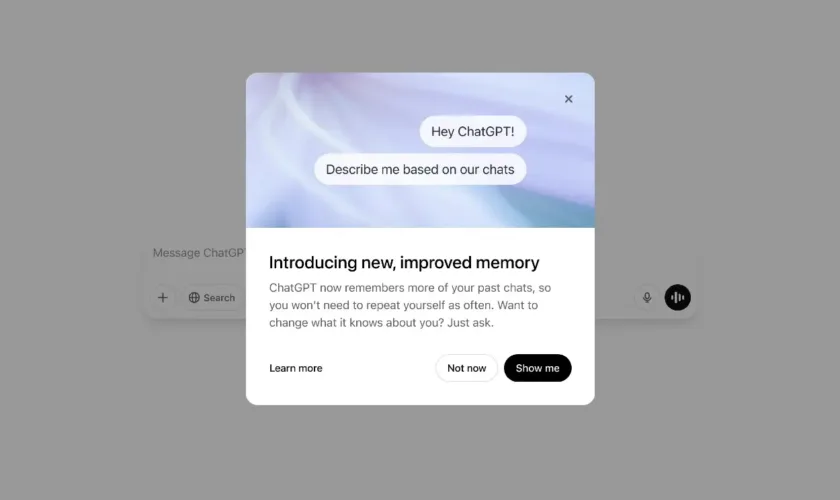

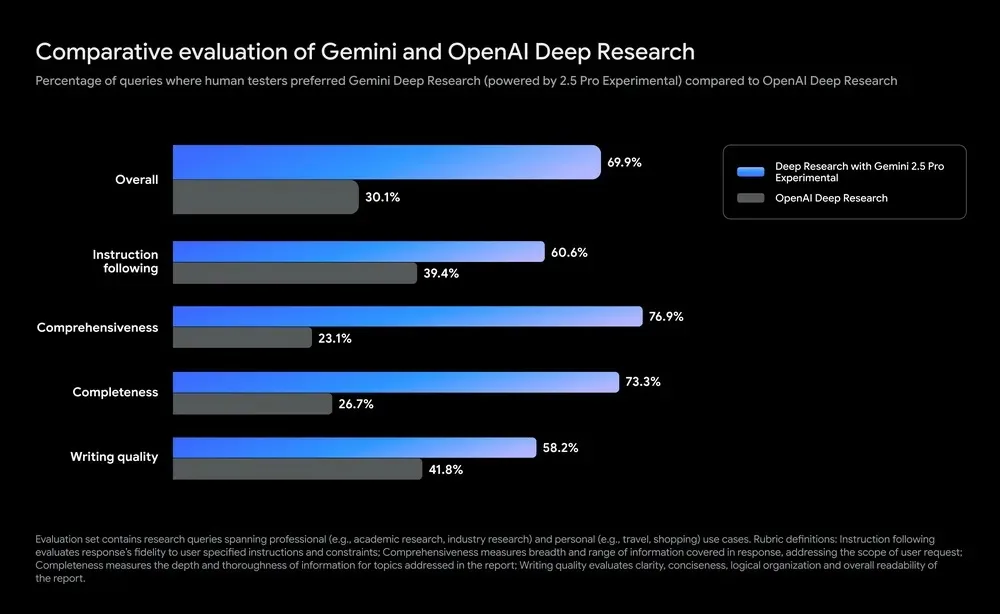

Lors de son événement des 50 ans, Microsoft a dévoilé de nombreuses nouveautés autour de Copilot : Vision, Memory, Pages, Deep Research… Autant de fonctions qui bénéficieraient directement d’une maîtrise interne des modèles d’IA.

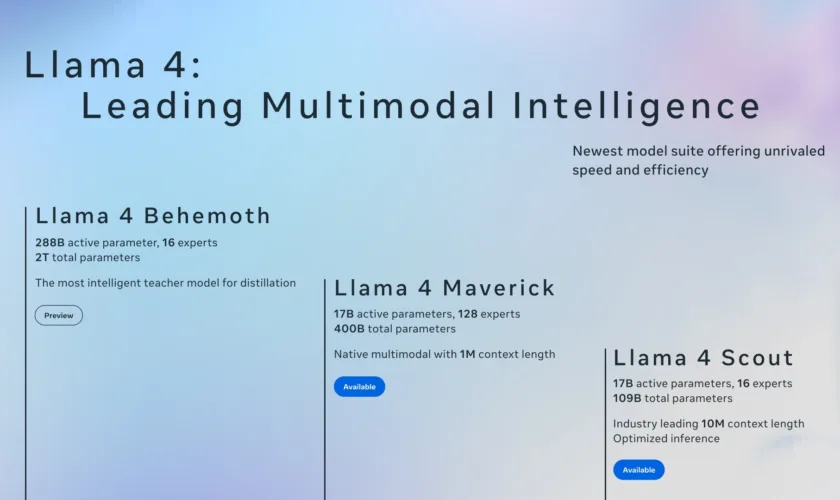

En parallèle, Microsoft a rapidement intégré des modèles alternatifs comme DeepSeek R1 à sa plateforme Azure, soulignant son souhait de diversifier ses sources d’IA et de renforcer son indépendance vis-à-vis d’OpenAI.

Une collaboration qui dure… mais qui évolue

La relation entre Microsoft et OpenAI n’est pas rompue : leur contrat se poursuit jusqu’en 2030. Mais, Microsoft prépare l’après, en intégrant plus de modèles tiers dans ses services et en explorant ses propres pistes technologiques.

Cette transition ne signifie pas l’abandon de GPT ou de ChatGPT, mais plutôt l’émergence d’un écosystème hybride, où Microsoft reste maître de ses choix technologiques.

Avec cette nouvelle stratégie, Microsoft cherche à s’imposer non pas en tant que pionnier absolu de l’IA, mais comme un acteur pragmatique, agile et autonome. Une vision qui pourrait bien faire la différence dans la course actuelle à l’intelligence artificielle.