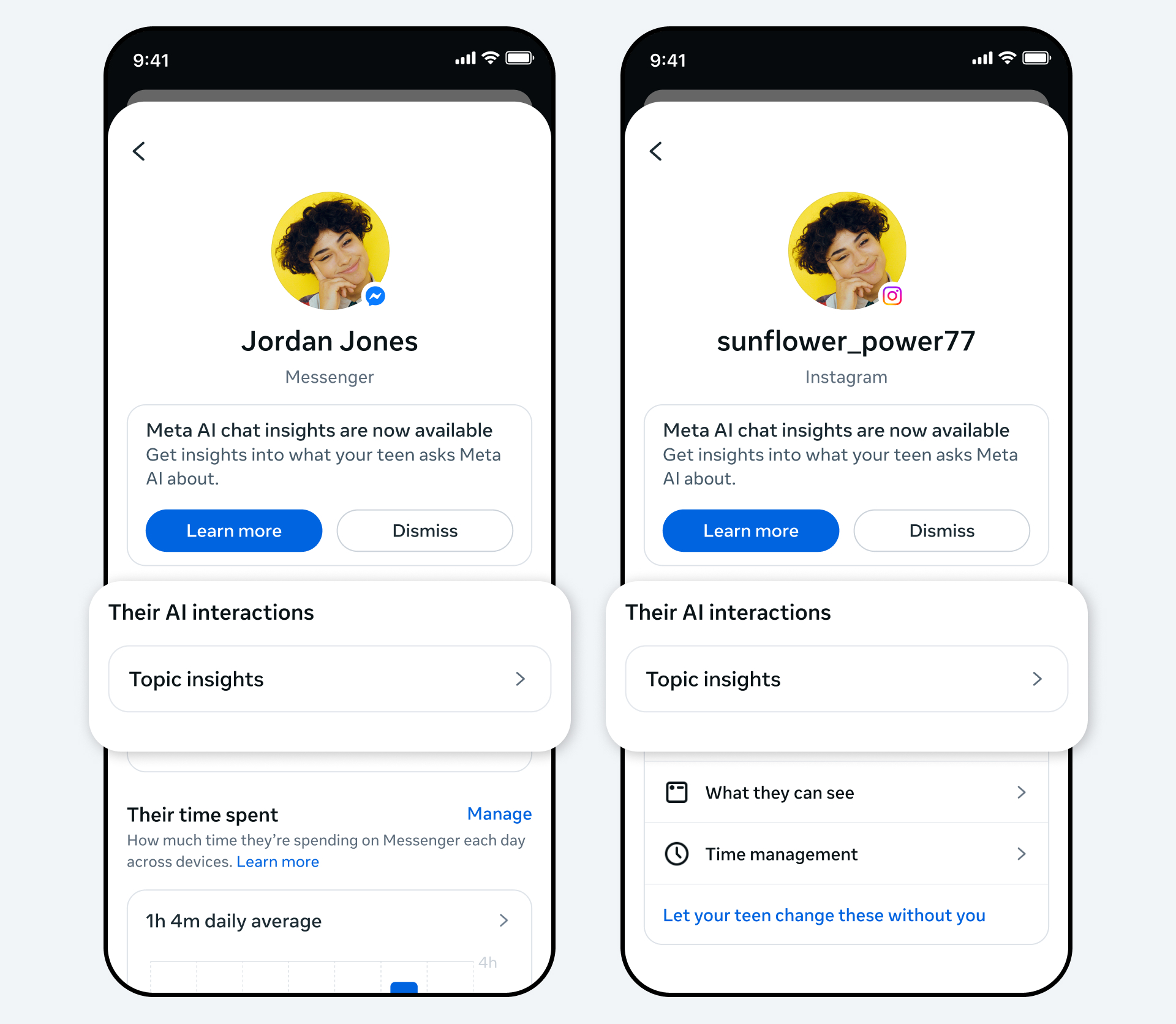

Après des mois de pression réglementaire et médiatique, Meta commence à structurer une réponse concrète autour de la sécurité des adolescents face à l’IA. Le groupe déploie une nouvelle fonctionnalité baptisée « Insights », intégrée à son hub de supervision, sur Instagram, Facebook et Messenger.

L’objectif est clair : donner aux parents une visibilité — sans aller jusqu’à la surveillance totale — sur les interactions de leurs enfants avec Meta AI.

Une visibilité sans accès direct aux conversations

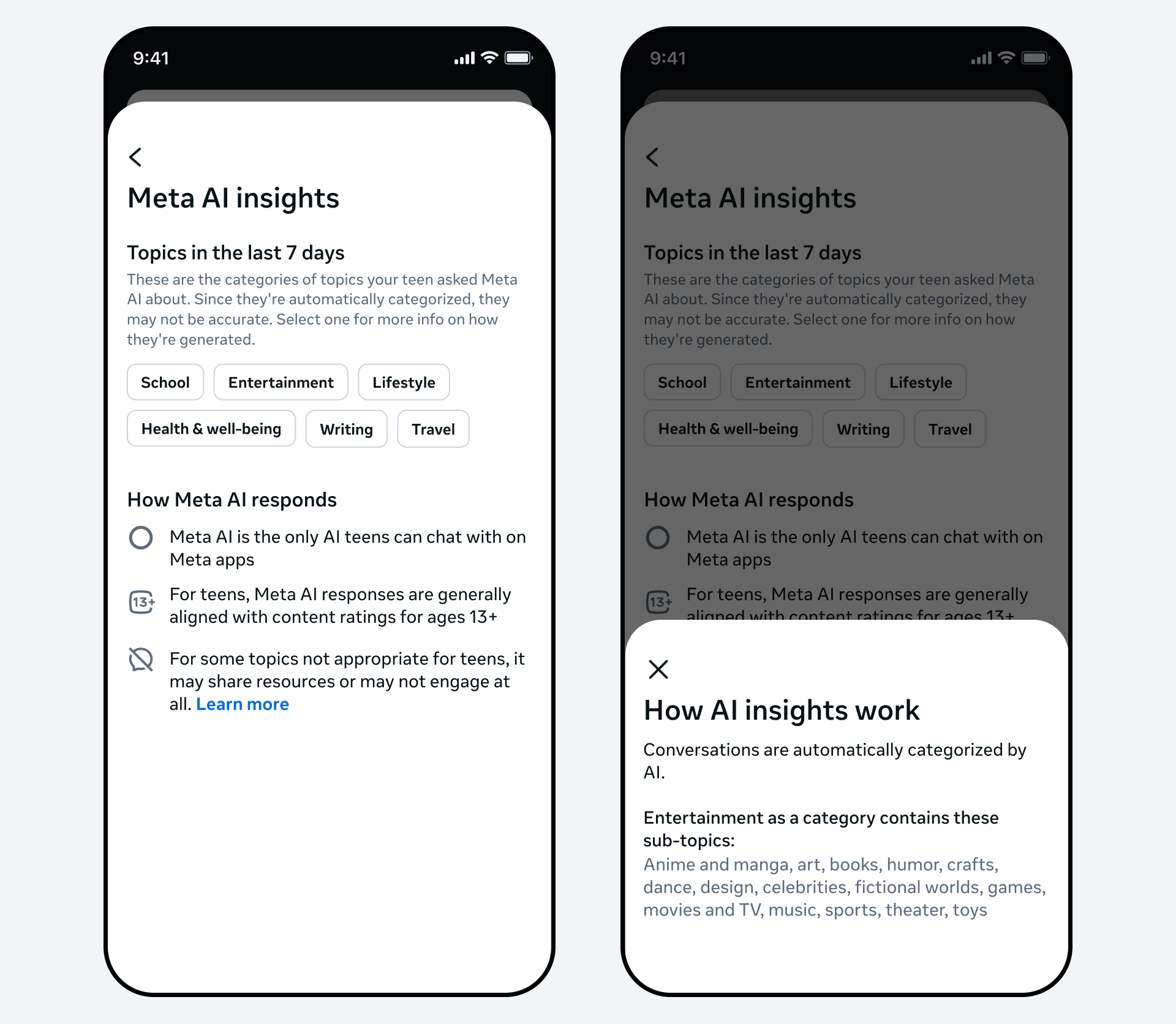

Contrairement à ce que certains pourraient craindre, le système ne donne pas accès aux conversations complètes. À la place, Meta propose des résumés hebdomadaires par thématiques.

Les parents peuvent ainsi voir si leur adolescent interagit avec des sujets comme : l’école, le divertissement, le lifestyle, les voyages, ou encore la santé et le bien-être. Chaque catégorie est elle-même subdivisée, permettant d’identifier des tendances sans exposer le contenu exact des échanges.

Ce choix n’est pas anodin. Meta tente ici de naviguer entre deux exigences opposées : protéger les jeunes utilisateurs, et respecter leur intimité numérique.

Plutôt que de livrer un accès brut aux messages, l’entreprise opte pour une lecture contextuelle et agrégée. Une approche qui rappelle certaines tendances actuelles dans la modération IA : détecter des signaux faibles sans surveiller chaque mot.

Mais, cet équilibre reste fragile. Trop de contrôle peut briser la confiance. Trop peu peut exposer à des risques.

Des contrôles plus fins sur l’usage de l’IA

Au-delà de la simple visibilité, Meta ajoute des outils de contrôle : possibilité de limiter ou désactiver certains personnages IA, option de bloquer les conversations avec des bots tout en conservant l’assistant pour des usages neutres (devoirs, questions du quotidien), ou encore une personnalisation de l’environnement IA accessible à l’adolescent.

On passe ainsi d’un simple outil de surveillance à une gestion active de l’expérience IA.

Vers des alertes sur les sujets sensibles

C’est probablement la fonctionnalité la plus importante — et la plus sensible. Meta travaille sur un système d’alertes dédiées aux sujets critiques. En cas de conversations liées à l’automutilation, la dépression sévère, ou le suicide, les parents pourraient être directement notifiés.

Si cette fonctionnalité tient ses promesses, elle pourrait devenir un standard de l’industrie, tant la détection précoce de signaux faibles est un enjeu majeur dans les environnements numériques.

Un déploiement progressif… sous pression

Pour l’instant, cette fonctionnalité est disponible dans plusieurs marchés clés : les États-Unis, le Royaume-Uni, l’Australie, le Brésil, ou encore le Canada. Un déploiement global est attendu dans les prochaines semaines.

Mais, il est difficile d’ignorer le contexte. Entre enquêtes, critiques sur la sécurité des jeunes et pression des régulateurs, Meta agit aussi pour répondre à une nécessité politique et juridique. La collaboration avec le Cyberbullying Research Center pour proposer des guides de discussion parents-ados s’inscrit dans cette logique.

Meta tente de reprendre la main sur un sujet devenu critique

Ce lancement dépasse la simple fonctionnalité. Il s’inscrit dans une bataille plus large : celle de la responsabilité des plateformes face à l’IA conversationnelle.

Avec Insights, Meta introduit trois idées clés :

- surveiller sans espionner,

- intervenir sans bloquer totalement,

- alerter sans dramatiser systématiquement.

Reste à voir si cette approche suffira. Car, le vrai test ne sera pas technique, mais social : les parents utiliseront-ils réellement ces outils ? les adolescents les accepteront-ils ? et surtout, les signaux détectés seront-ils pertinents ?

Si Meta réussit son pari, cette fonctionnalité pourrait redéfinir la manière dont les plateformes encadrent l’usage de l’IA par les mineurs.

Car dans un monde où les adolescents parlent autant à des agents IA qu’à leurs amis, la question n’est plus « faut-il surveiller ? », mais « comment le faire intelligemment ? ».