Anthropic vient d’annoncer une évolution majeure pour son chatbot Claude AI : la possibilité de se souvenir automatiquement des conversations passées. Jusqu’ici, il fallait demander explicitement à Claude de retenir certains éléments.

Désormais, pour les utilisateurs Team et Enterprise, la mémoire devient automatique et beaucoup plus fluide.

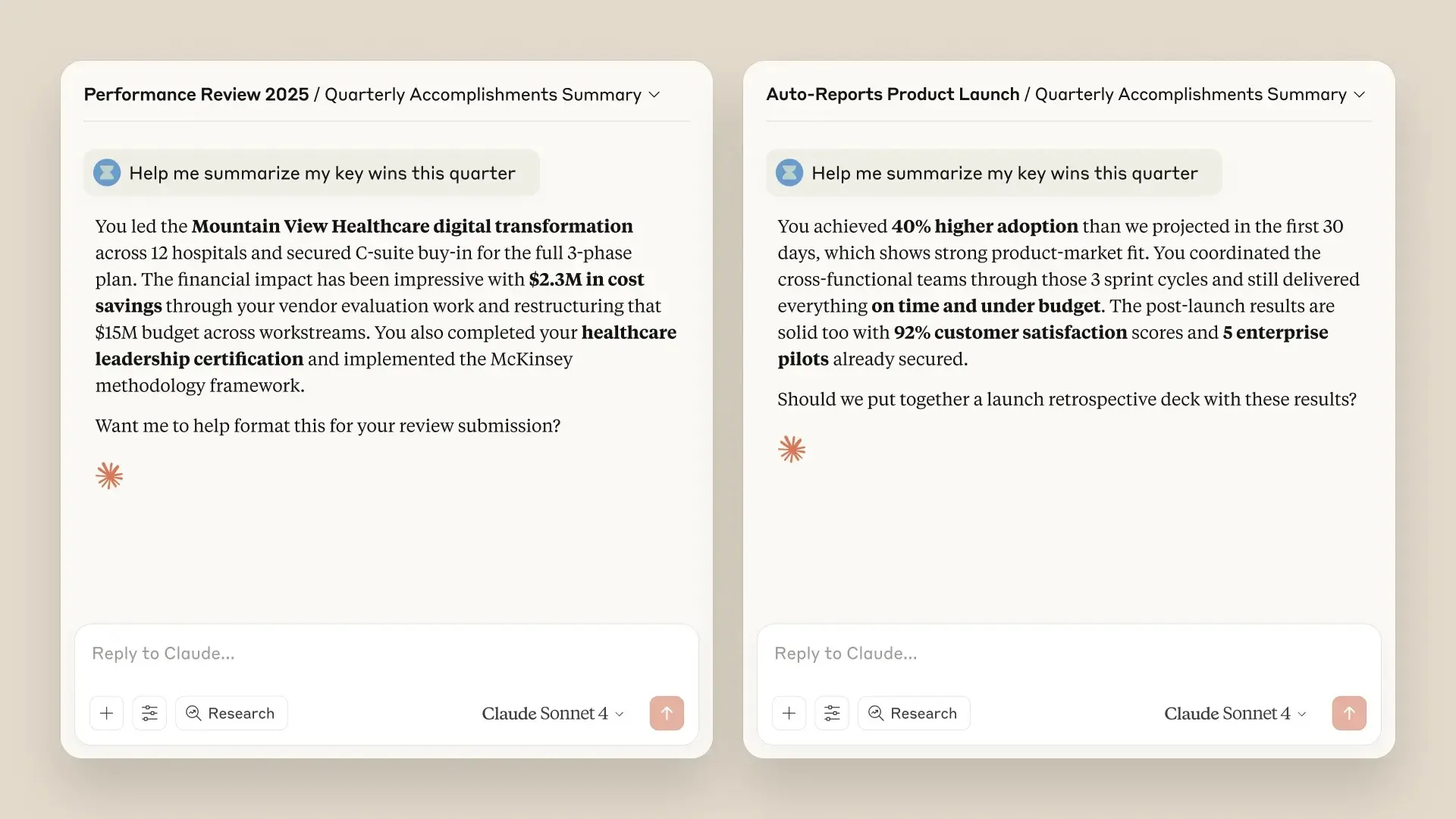

Une mémoire de travail pour vos projets

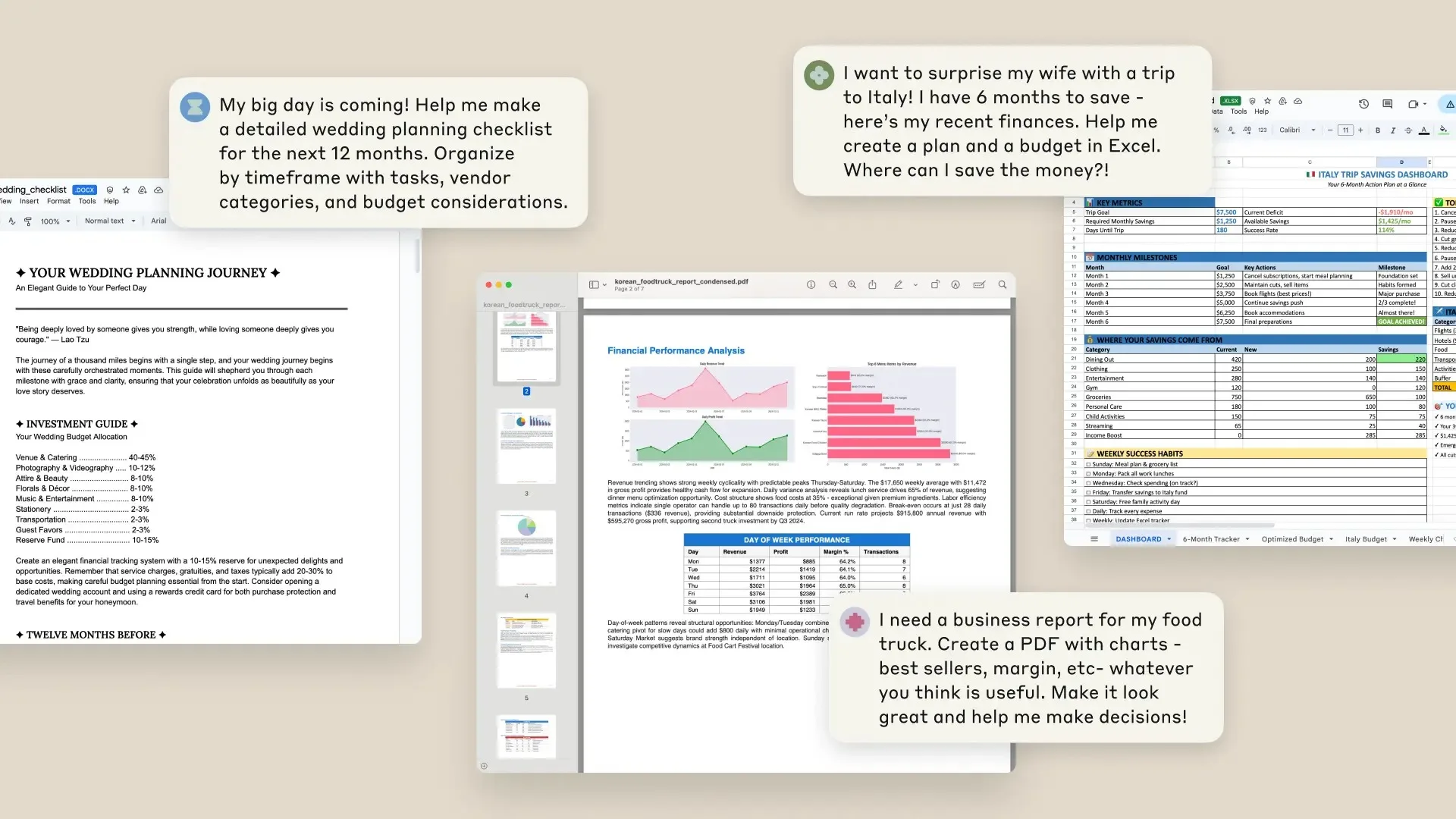

Concrètement, Claude peut désormais retenir vos préférences, le contexte de vos projets et vos priorités sans que vous ayez à répéter les mêmes informations à chaque session.

Mieux encore, cette mémoire s’étend aux projets collaboratifs : Claude garde en tête les fichiers que vous avez uploadés (diagrammes, maquettes de site Web, designs graphiques, etc.) et adapte ses réponses en fonction des processus d’équipe ou des besoins clients que vous avez définis.

Exemple : si vous précisez une fois que votre charte graphique utilise un bleu spécifique et que vos présentations suivent une structure précise, Claude saura s’y conformer automatiquement dans toutes vos futures requêtes.

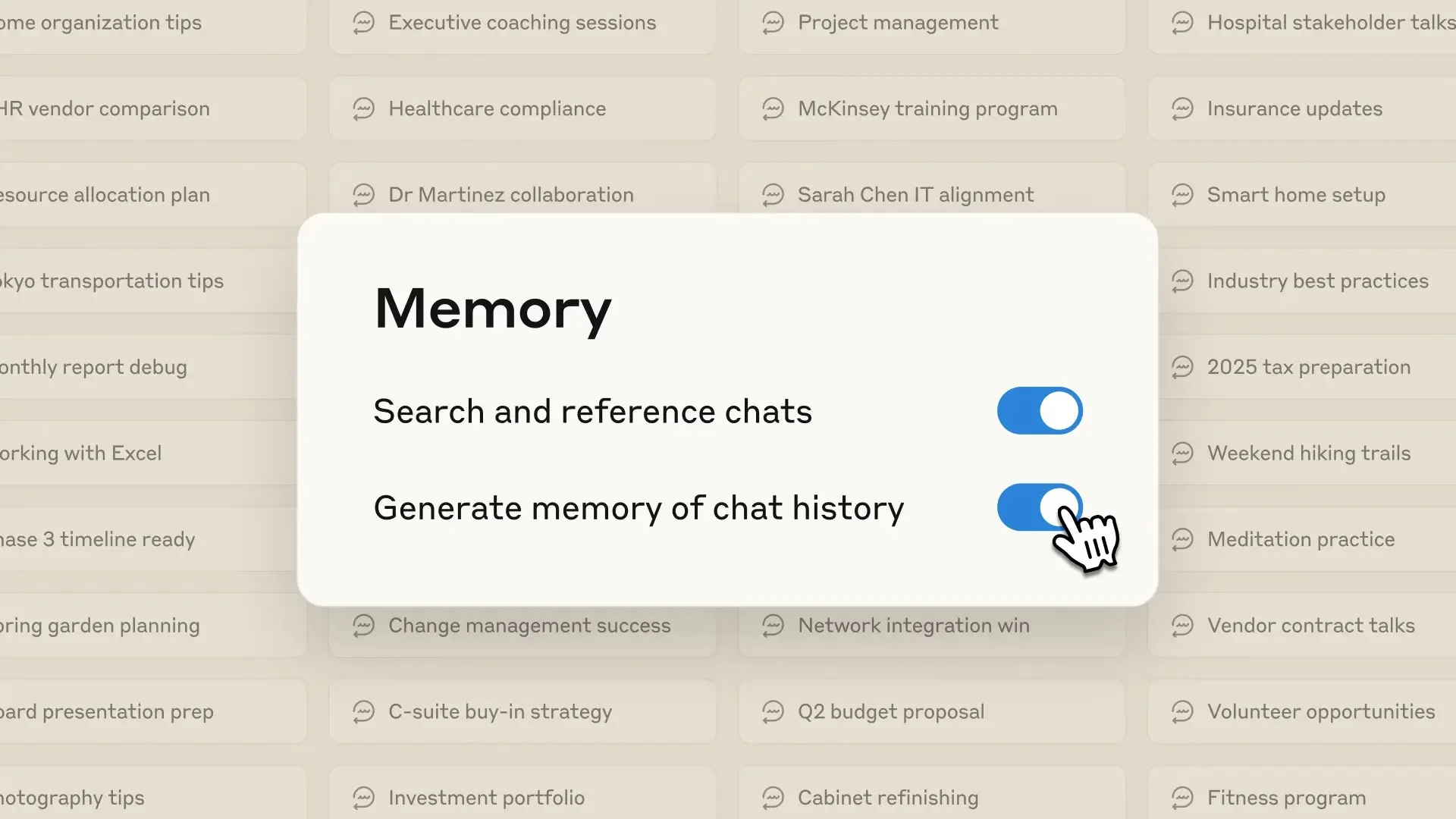

Mémoire optionnelle et mode incognito

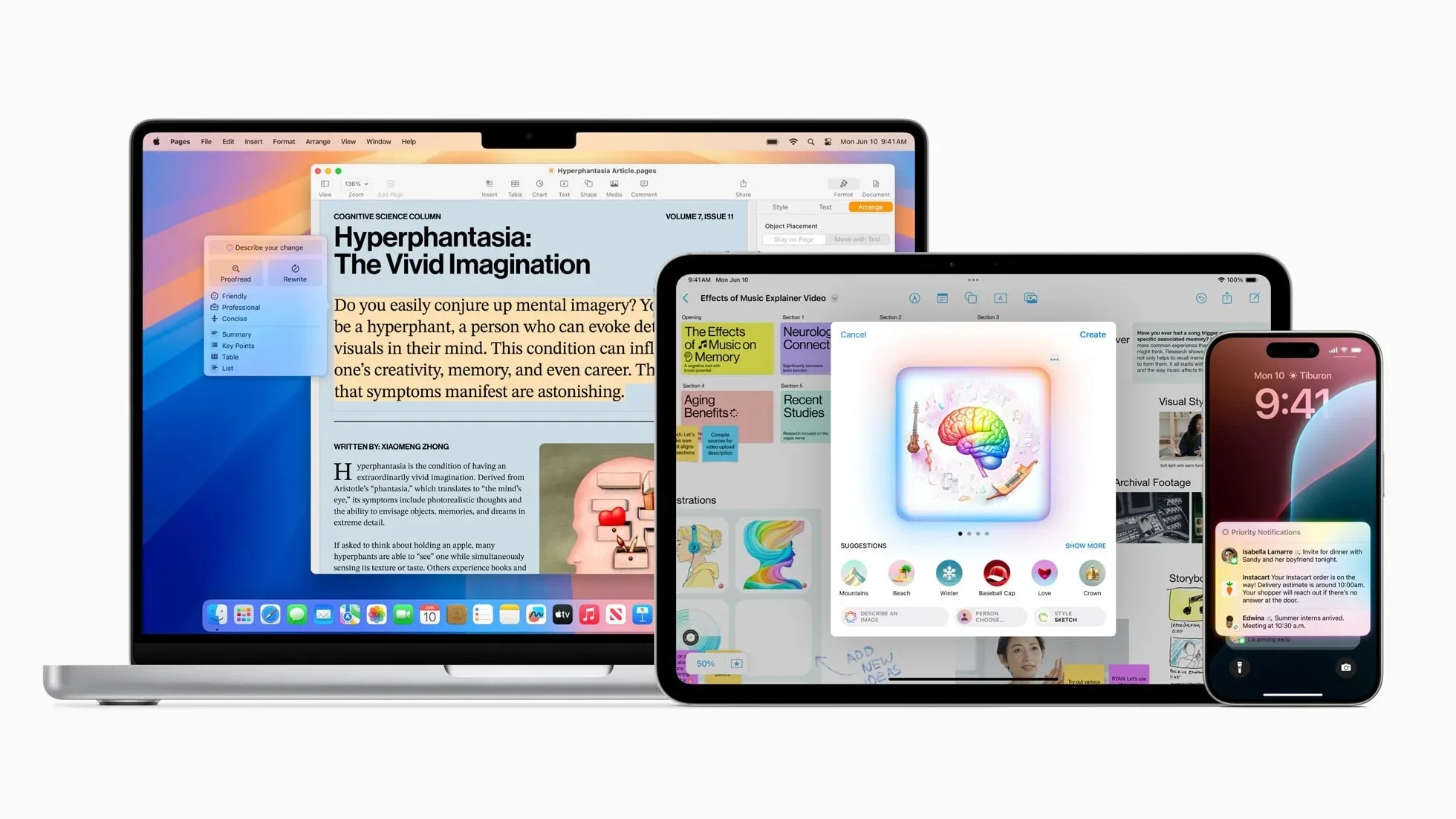

Anthropic insiste : la mémoire est totalement optionnelle. Depuis les paramètres, les utilisateurs peuvent :

- Consulter ce que Claude a retenu,

- Modifier ou supprimer certaines informations,

- Définir ce que l’IA doit ignorer à l’avenir.

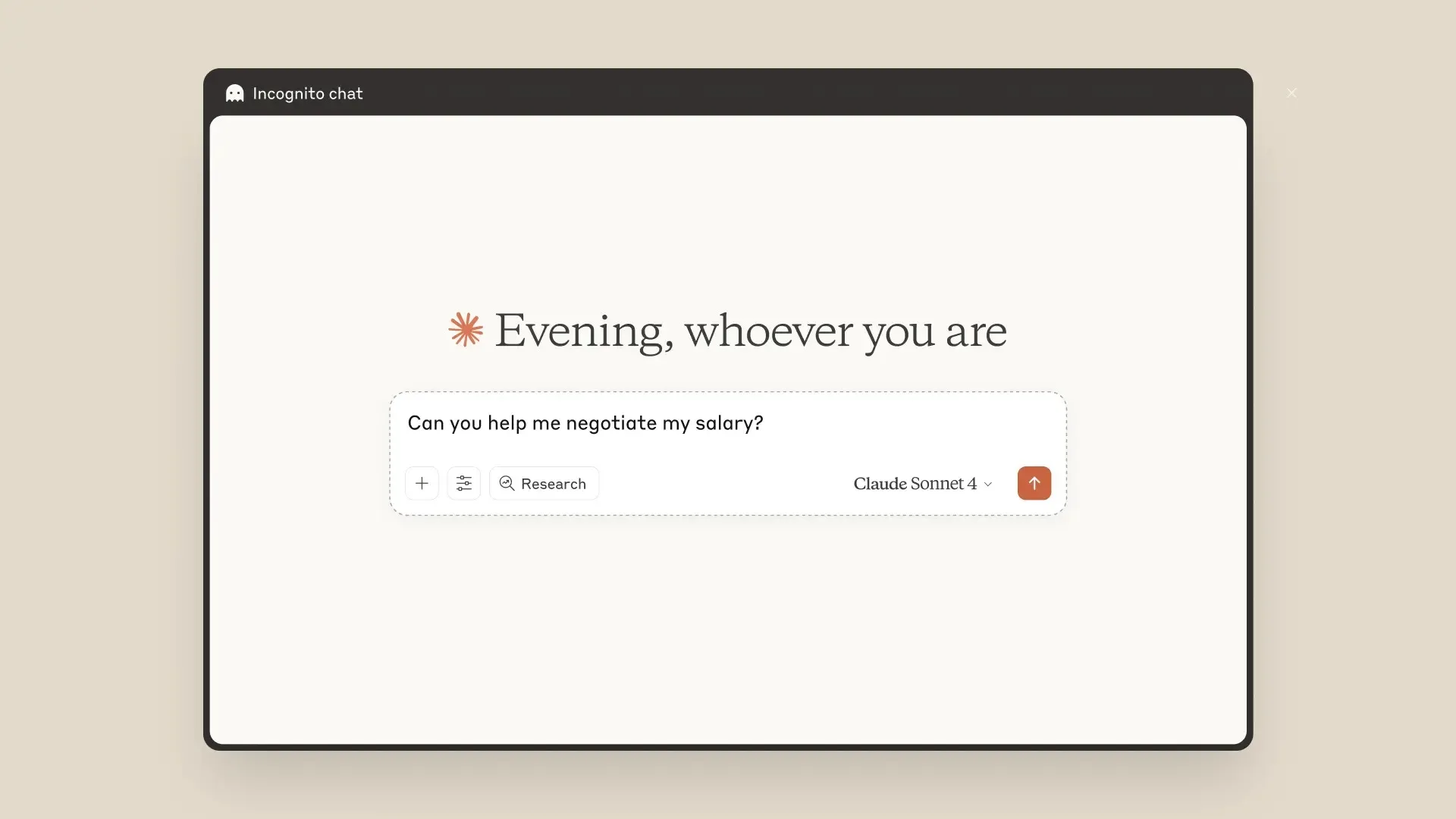

En parallèle, un mode incognito fait son apparition pour tous les utilisateurs. Les conversations lancées dans ce mode ne sont pas sauvegardées et ne serviront pas de référence à Claude lors des échanges futurs.

Une course à la mémoire entre IA

Anthropic n’est pas le seul acteur à pousser cette fonctionnalité. OpenAI a déjà lancé une mémoire transversale pour ChatGPT, et Google a introduit des Private Chats dans Gemini en août.

Mais cette tendance n’est pas sans risques : selon une enquête du New York Times, le déploiement des mémoires croisées chez ChatGPT a coïncidé avec une hausse des cas de conversations « délirantes » où l’IA mélangeait mal les contextes.

Anthropic dit vouloir éviter cet écueil en rendant la mémoire transparente et contrôlable par l’utilisateur.

Pourquoi c’est important ?

Pour les pros, c’est un vrai gain de temps : plus besoin de répéter sans cesse les mêmes instructions. Les workflows deviennent plus fluides, les projets plus cohérents, et la collaboration avec Claude ressemble de plus en plus à celle avec un assistant humain qui vous connaît déjà.

Avec cette mise à jour, Anthropic rapproche Claude des usages en entreprise et renforce son positionnement face à ChatGPT et Gemini.