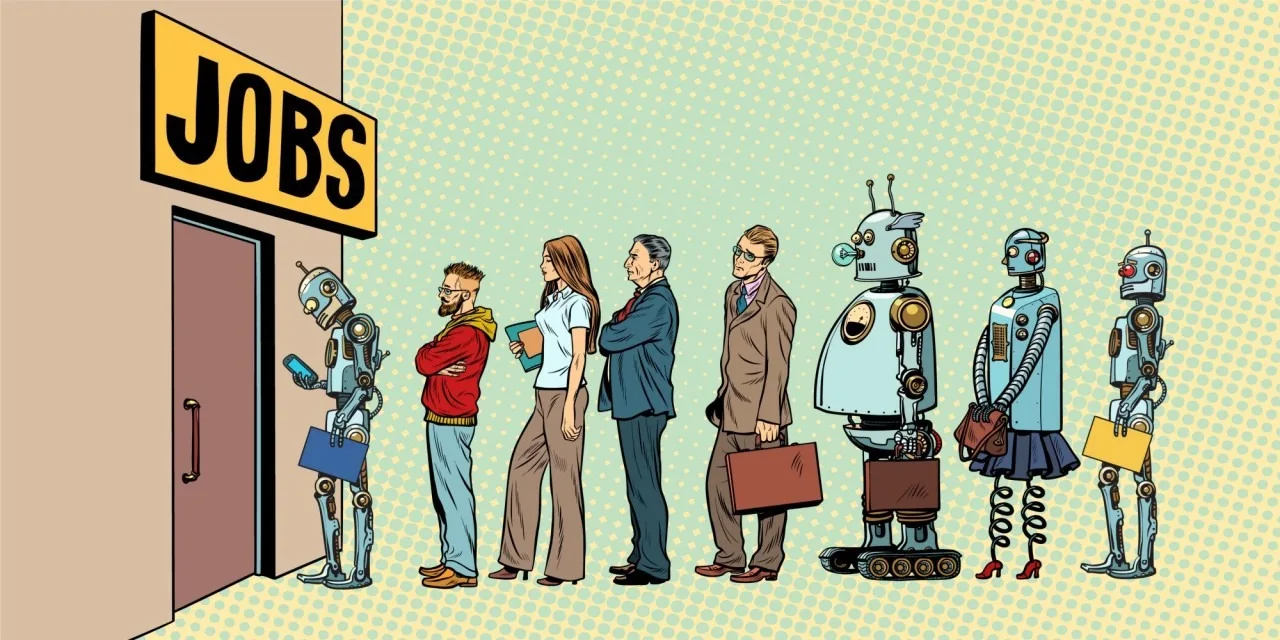

Les préoccupations liées à l’impact de l’intelligence artificielle (IA) sur l’emploi sont de plus en plus répandues. Bien que l’IA puisse transformer radicalement certains secteurs grâce à ses capacités d’automatisation et de traitement des données, la réalité pourrait être moins alarmante qu’on ne le pense.

En effet, si certaines professions évolueront inévitablement, de nombreuses analyses suggèrent que l’IA ne remplacera pas autant de postes que les pessimistes l’anticipent. Voici un tour d’horizon des principales réflexions autour de ce débat.

La crainte d’être remplacé par des machines n’est pas nouvelle. Elle remonte au 19ᵉ siècle, avec l’apparition des métiers à tisser automatisés qui ont suscité des rébellions parmi les ouvriers textiles. Bien que ces peurs aient semblé légitimes à l’époque, elles se sont révélées exagérées avec le recul. Les machines n’ont pas éliminé le travail humain, elles ont modifié sa nature. Les ouvriers sont passés de rôles purement manuels à des postes axés sur la supervision et la maintenance des machines.

Plus récemment, les travailleurs de l’industrie manufacturière ont exprimé des inquiétudes similaires face aux robots et à l’automatisation des chaînes de production. Bien que certains emplois aient effectivement disparu, de nombreux ouvriers ont évolué vers des tâches nécessitant des compétences plus spécialisées.

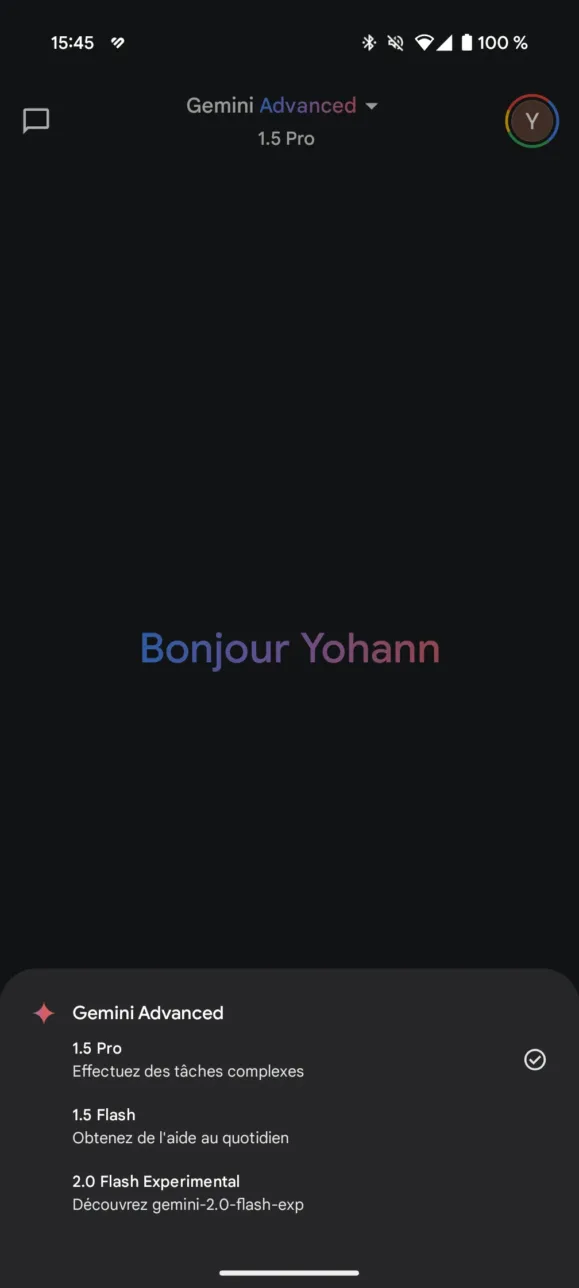

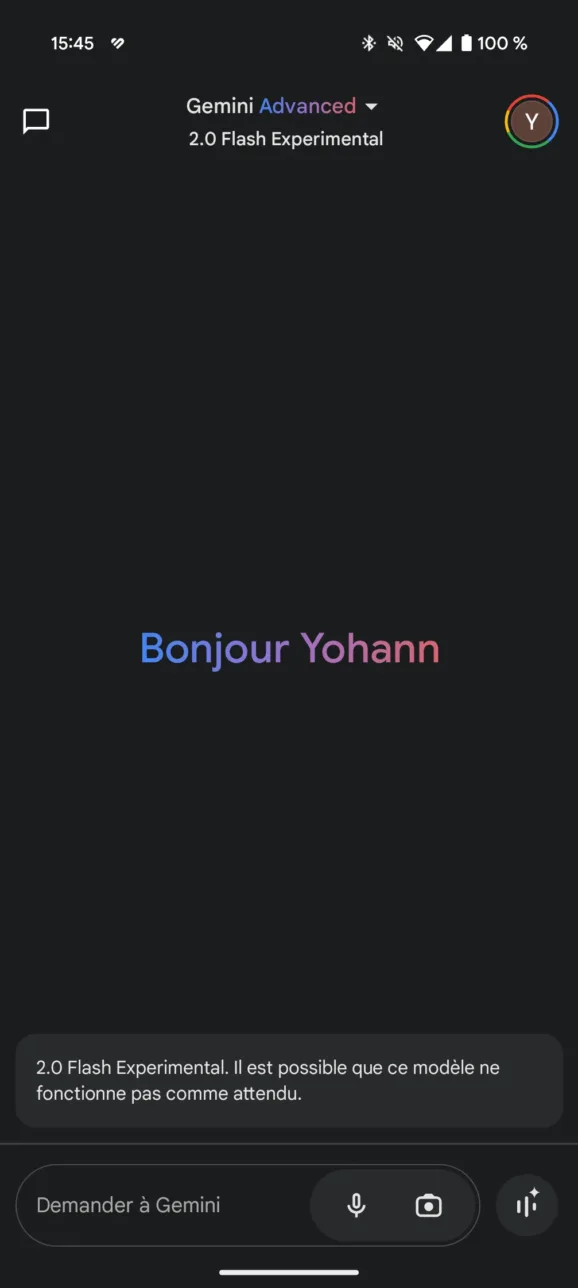

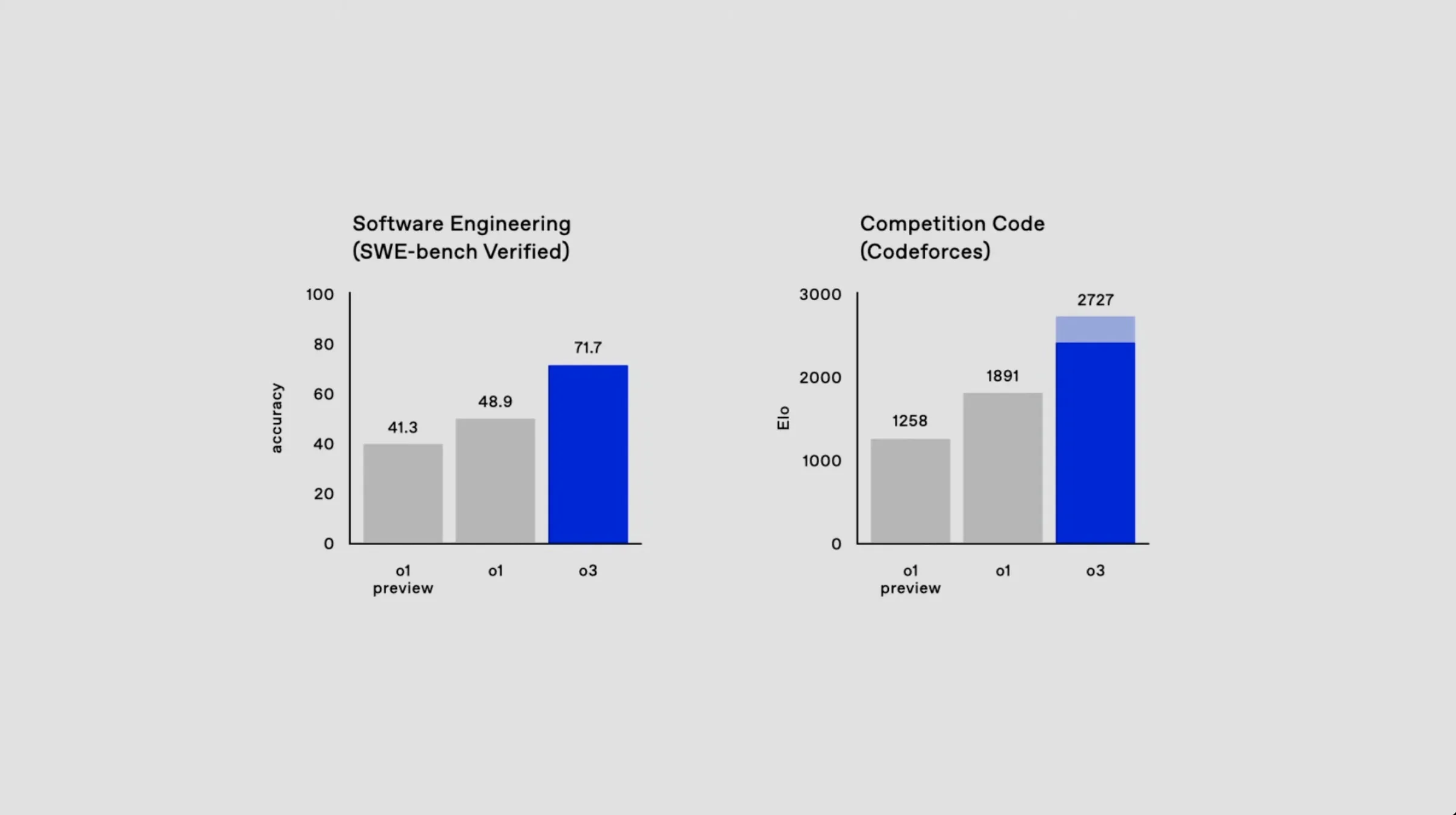

L’enthousiasme entourant l’IA a été amplifié par des promesses parfois exagérées de développeurs et de visionnaires. Des scénarios de science-fiction, tels que l’émergence d’une intelligence surhumaine menaçant l’humanité, ont contribué à alimenter les craintes. Cependant, les capacités actuelles de l’IA montrent des limitations importantes.

Malgré des avancées remarquables, les modèles d’IA, y compris les plus récents, souffrent de problèmes comme les hallucinations (informations inventées) ou l’incapacité à répondre à des requêtes complexes. Ces obstacles montrent que, même si l’IA est puissante, elle est encore loin de remplacer l’intelligence humaine dans de nombreux domaines.

L’efficacité limitée de l’automatisation par l’IA

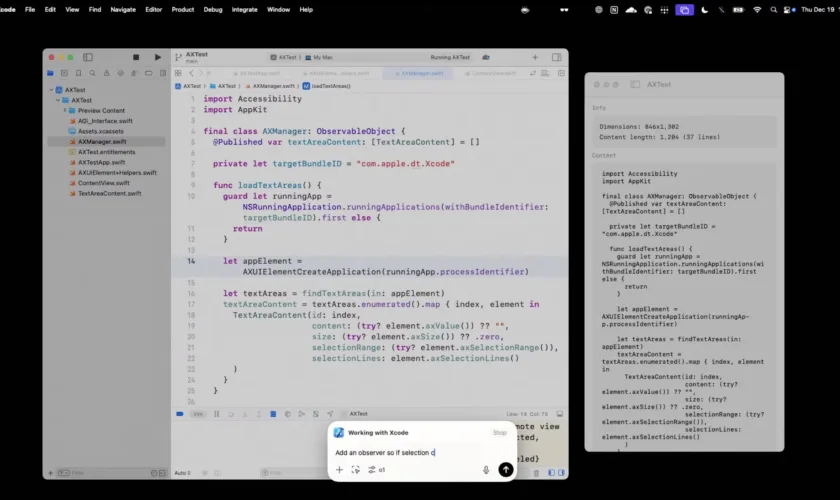

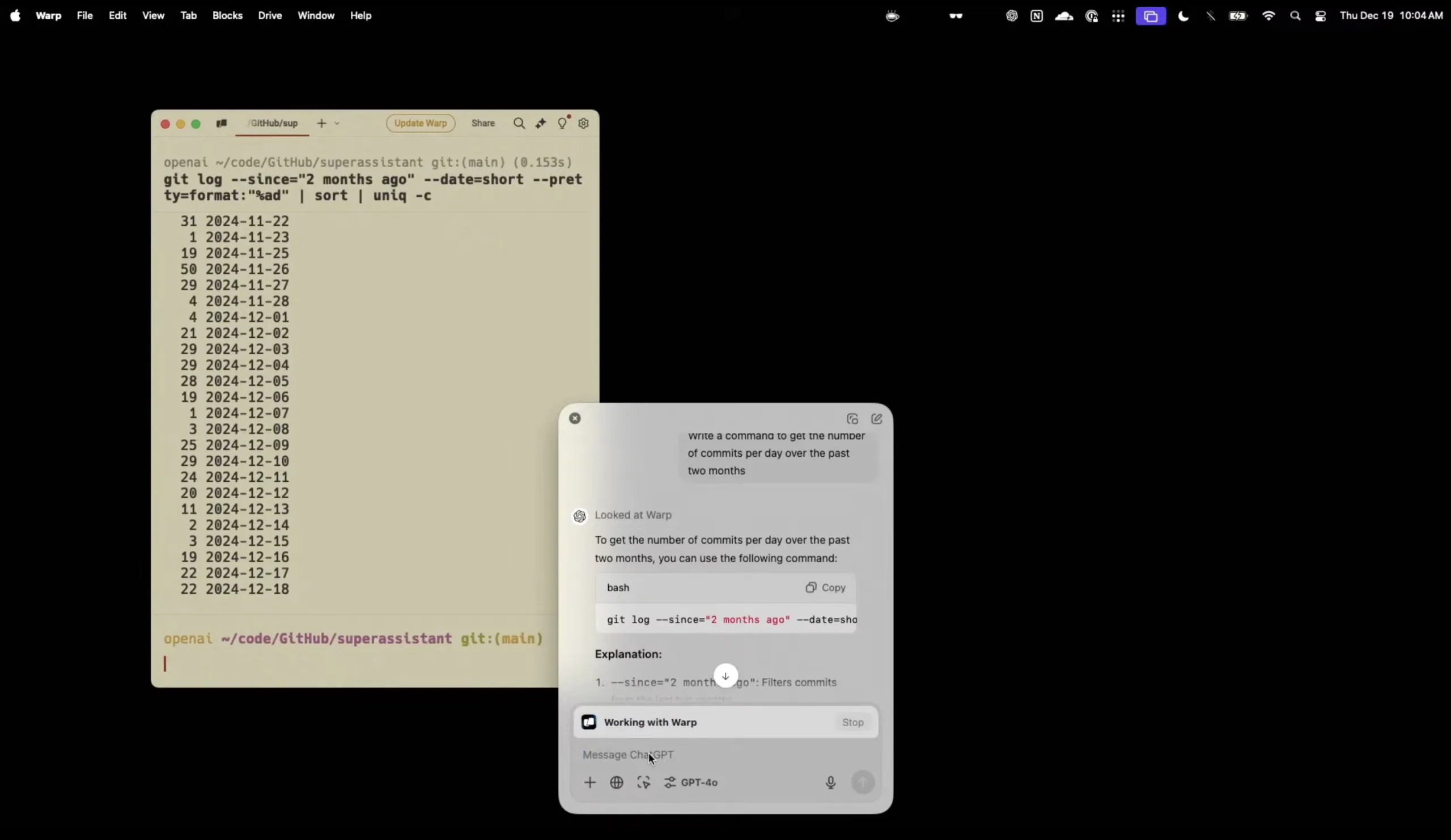

L’IA excelle dans le traitement des données, surpassant les humains dans des tâches nécessitant de grandes capacités de calcul ou d’analyse. Par exemple, certains systèmes d’IA peuvent rivaliser avec des médecins pour établir des diagnostics précis. Cependant, l’IA ne fonctionne pas de manière autonome. Elle nécessite des humains pour la guider et interpréter ses résultats.

De plus, la supervision humaine reste essentielle pour garantir la qualité et l’exactitude des résultats produits par l’IA. En d’autres termes, l’IA n’est pas une solution complète, mais plutôt un outil complémentaire qui nécessite une collaboration avec des humains.

Des transformations plutôt que des remplacements

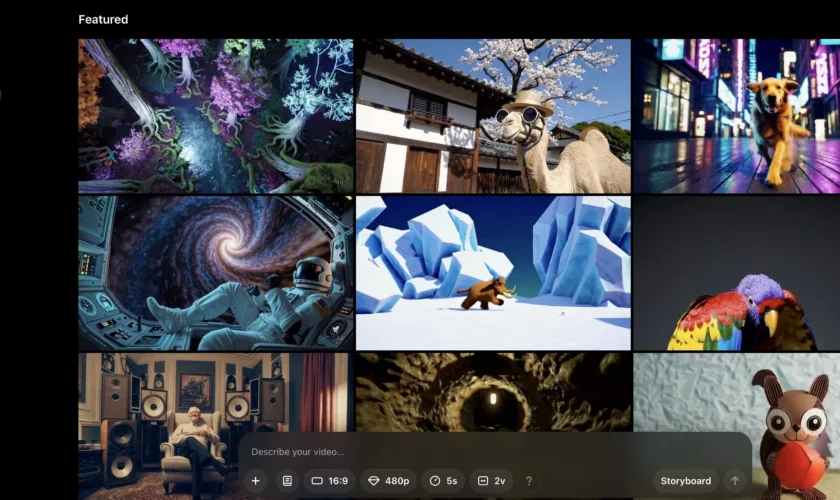

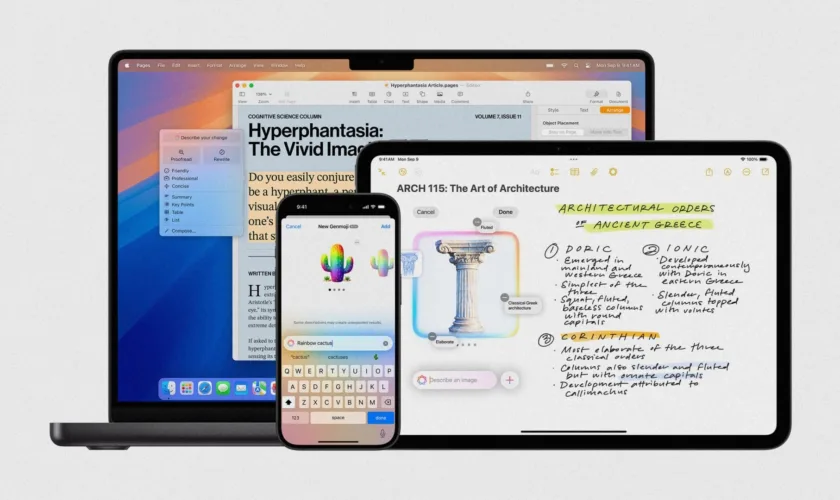

Au lieu de se concentrer sur la disparition de certains emplois, il est plus pertinent de parler de transformation. L’IA améliore les outils à disposition des professionnels, permettant de travailler de manière plus rapide et efficace. Par exemple, les médecins peuvent utiliser l’IA pour affiner leurs diagnostics, et les artistes peuvent s’appuyer sur des outils génératifs pour enrichir leurs créations.

Certains postes peu qualifiés risquent de disparaître, mais la majorité des rôles évolueront pour inclure de nouvelles compétences. Les travailleurs devront apprendre à collaborer avec ces technologies pour rester pertinents sur le marché du travail.

Même si l’IA devenait capable de reproduire toutes les compétences humaines, la préférence pour les interactions humaines persisterait dans de nombreux domaines. Dans des secteurs sensibles, comme la santé, les patients privilégient des échanges empathiques avec des professionnels plutôt que des réponses standardisées fournies par une machine.

Cette préférence pour l’humain s’étend également aux arts et à d’autres industries où la créativité et la subjectivité jouent un rôle essentiel. Les œuvres créées par des humains sont souvent perçues comme ayant plus de valeur que celles produites par des machines.

De nouvelles opportunités et industries

Enfin, l’essor de l’IA ouvre des perspectives inédites. De nouveaux rôles, comme celui d’ingénieur en prompt (instructions données aux IA), émergent pour répondre aux besoins de collaboration avec ces technologies. Des industries entièrement nouvelles pourraient apparaître, stimulant la demande de compétences spécialisées.

Si l’IA a déjà remplacé certains emplois et continuera de le faire, son impact global sur le marché du travail est souvent surestimé. L’histoire montre que les peurs liées à la technologie sont rarement à la hauteur des transformations réelles. Plutôt que de céder à l’inquiétude, il est crucial de se préparer aux changements en acquérant de nouvelles compétences et en intégrant ces outils dans notre quotidien professionnel.

L’IA n’est pas une menace insurmontable, mais une opportunité de repenser nos façons de travailler et de créer, tout en préservant la place unique et irremplaçable de l’humain.