Un mois seulement après le lancement de Lyria 3, Google passe déjà à la vitesse supérieure. Avec Lyria 3 Pro, la firme de Mountain View affine sa stratégie dans la musique générative : produire non seulement plus de contenu, mais surtout du contenu plus structuré, plus contrôlable et plus exploitable dans des contextes créatifs professionnels.

Une évolution rapide qui illustre à quel point la bataille de l’IA musicale s’intensifie.

Lyria 3 Pro : Des morceaux enfin pensés comme de vraies compositions

La première évolution est simple, mais déterminante : la durée. Là où Lyria 3 se limitait à des extraits d’environ 30 secondes, Lyria 3 Pro permet désormais de générer des morceaux allant jusqu’à 3 minutes. Un changement qui rapproche l’outil d’un format réellement utilisable, que ce soit pour du contenu vidéo, des démos ou des projets créatifs plus aboutis.

Mais l’essentiel se joue ailleurs. Google insiste sur une meilleure compréhension de la structure musicale. L’utilisateur peut désormais préciser des éléments comme l’intro, le couplet, le refrain ou le pont directement dans le prompt.

L’IA ne se contente plus de produire une ambiance sonore : elle commence à composer.

Plus de contrôle, moins de hasard

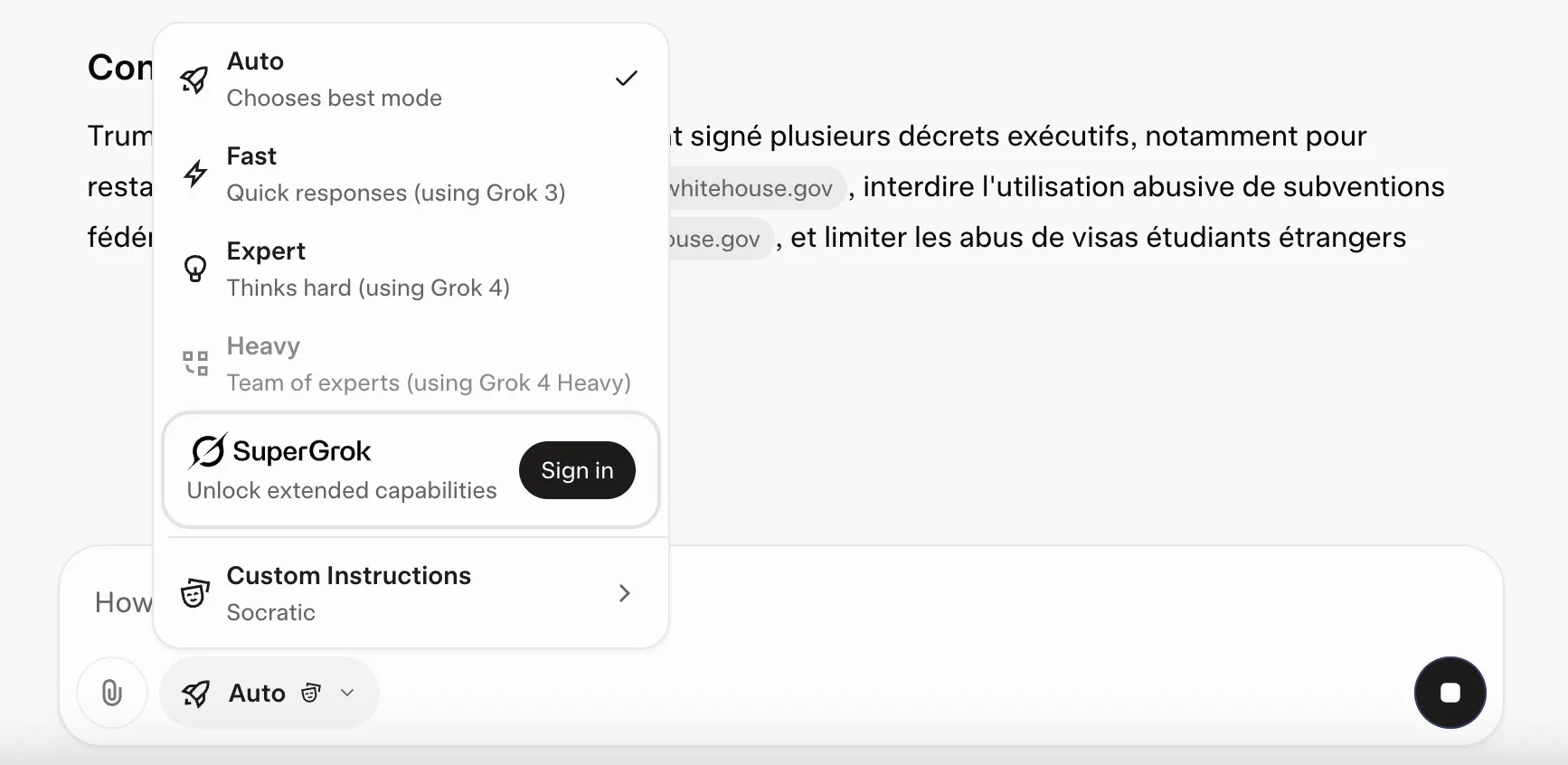

Avec Lyria 3 Pro, Google cherche clairement à réduire l’effet « boîte noire » souvent associé à la génération musicale. Le modèle promet un niveau de personnalisation plus fin, permettant d’ajuster les différentes sections d’un morceau, son rythme narratif ou son évolution. C’est un point clé dans l’évolution de ces outils. La musique générative ne vise plus seulement à produire rapidement des pistes d’ambiance, mais à devenir un véritable outil de création assistée, capable de s’intégrer dans un workflow professionnel.

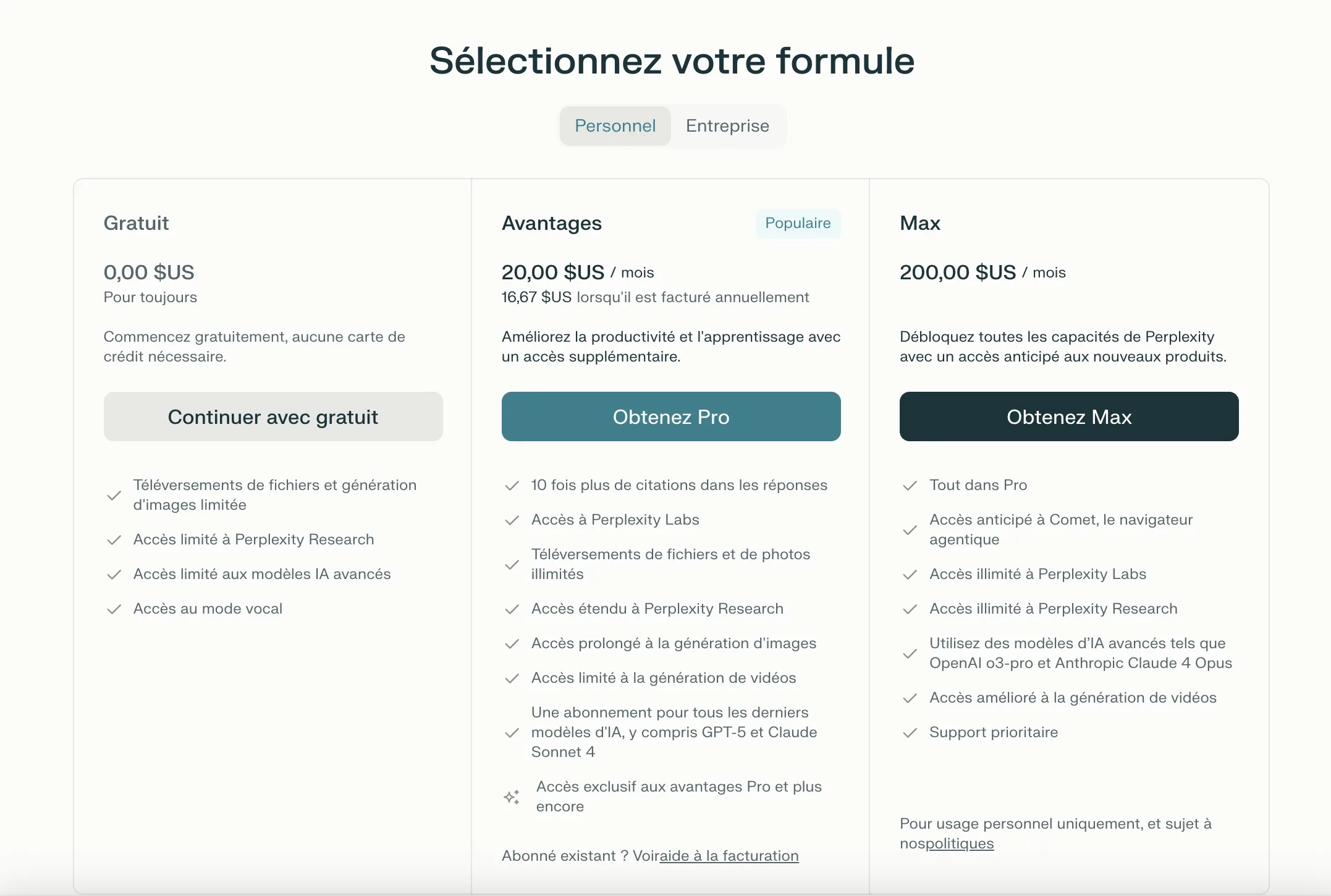

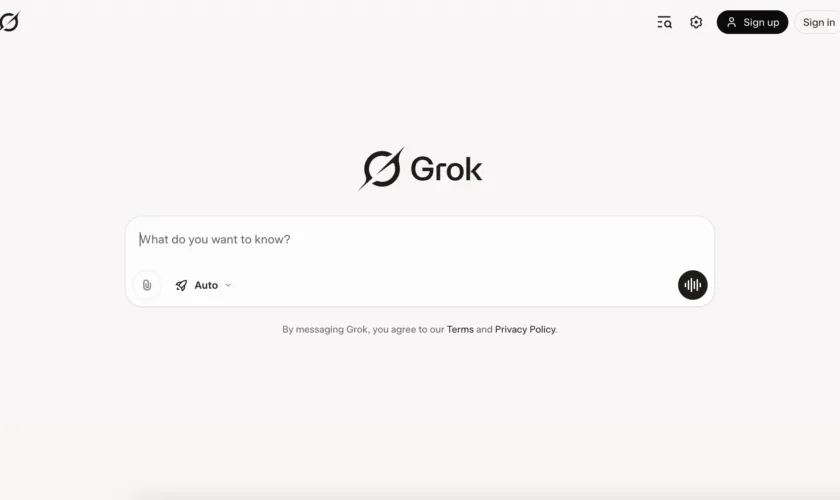

Google ne se contente pas de lancer un modèle : il l’intègre immédiatement dans son écosystème. Gemini accueille Lyria 3 Pro pour les abonnés payants, tandis que Google Vids et ProducerAI en profitent également.

Côté entreprise, Google pousse encore plus loin avec une disponibilité via Vertex AI, l’API Gemini et AI Studio. Autrement dit, Lyria 3 Pro n’est pas seulement un gadget créatif : c’est une brique technologique que Google veut voir utilisée dans des produits, des services et des pipelines professionnels.

Un terrain sensible : droits, artistes et authenticité

Comme tous les modèles génératifs, Lyria 3 Pro s’inscrit dans un contexte délicat. Google affirme avoir utilisé des données autorisées issues de partenaires et de ses propres plateformes, notamment YouTube. La firme précise également que le modèle ne reproduit pas directement un artiste, mais peut s’en inspirer de manière générale si l’utilisateur le mentionne dans un prompt.

Chaque morceau généré est par ailleurs marqué avec SynthID, un système de watermarking destiné à identifier les contenus créés par IA. Une réponse directe aux préoccupations croissantes autour de la traçabilité.

Ce mouvement s’inscrit dans une dynamique plus large. Spotify a récemment introduit des outils pour détecter les morceaux publiés frauduleusement sous le nom d’artistes, tandis que Deezer développe des technologies pour identifier la musique générée par IA. Le secteur tente encore de trouver un équilibre entre innovation et protection.

La musique générative entre dans sa phase « utilisable »

Avec Lyria 3 Pro, Google franchit un cap important. La génération musicale quitte progressivement le stade de démonstration pour entrer dans celui de l’usage réel. Des morceaux plus longs, une structure maîtrisée, une intégration dans des outils créatifs : tout converge vers une adoption plus concrète.

Mais cette montée en puissance pose aussi une question centrale : à mesure que ces outils deviennent capables de produire des morceaux complets, où se situe encore la frontière entre assistance et création ?

Une chose est sûre : dans cette nouvelle phase, la musique générative ne cherche plus seulement à impressionner. Elle cherche à s’insérer durablement dans la chaîne de production.