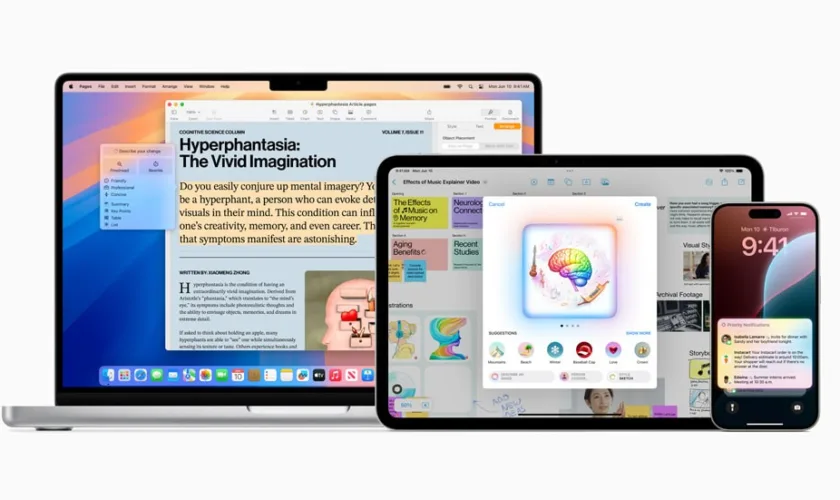

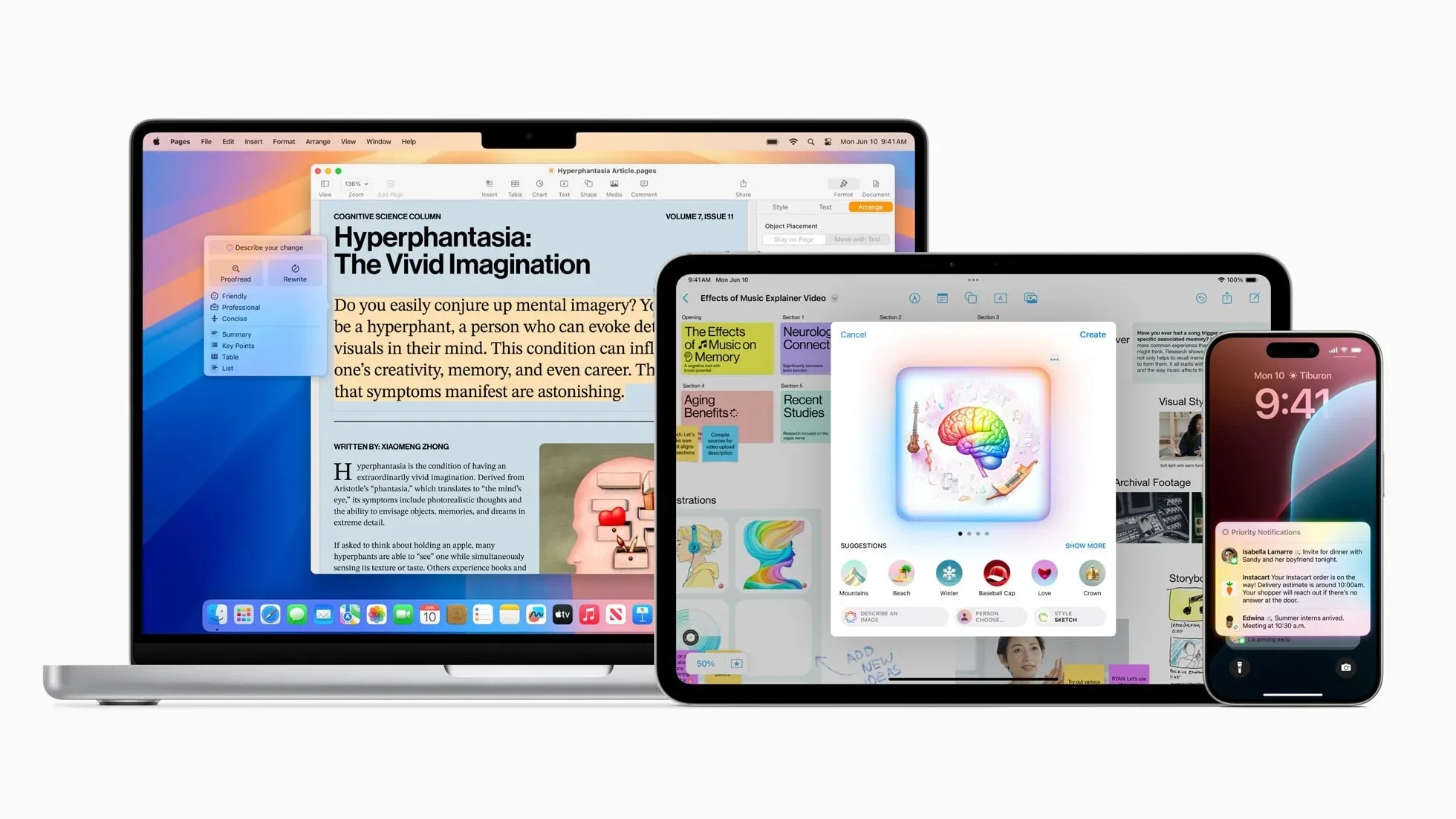

On s’attendait à voir Apple frapper fort sur l’IA lors de sa keynote de septembre. Pourtant, si la firme a bel et bien dévoilé la nouvelle gamme iPhone 17, les annonces autour d’Apple Intelligence ont été minimes.

En résumé, seules deux nouvelles fonctionnalités ont été confirmées :

- Zoom selfie automatique : l’IA ajuste désormais le cadrage de vos autoportraits.

- Mode d’alimentation adaptatif : l’iPhone optimise la consommation d’énergie selon vos usages, un point crucial pour l’ultra-fin iPhone 17 Air.

Toujours pas de « nouveau Siri » associé à Apple Intelligence

Annoncé dès la WWDC 2024 mais repoussé à plusieurs reprises, le Siri nouvelle génération n’a pas été mentionné. Ce futur assistant multimodal (capable de comprendre la voix, le texte et même l’image) utiliserait des modèles d’IA modernes pour mieux comprendre le contexte et répondre de façon plus pertinente. Mais pour l’instant, silence radio.

Lors de l’événement, Apple a glissé quelques allusions à son IA, affirmant qu’elle rendrait l’iPhone 17 « meilleur ». Mais sans démonstrations concrètes, difficile d’y croire.

Beaucoup pensent que la firme attend peut-être de finaliser le rachat d’une startup spécialisée avant de relancer sérieusement la communication autour d’Apple Intelligence.

Où en est Apple face à la concurrence ?

Soyons clairs : si vous envisagez de passer à l’iPhone uniquement pour l’IA, ce n’est pas le bon choix pour le moment.

Google Pixel 10 et Samsung Galaxy S25 proposent aujourd’hui des expériences bien plus avancées et abouties dans ce domaine, avec une IA déjà intégrée au quotidien.