À l’occasion du 50e anniversaire de Microsoft, le géant de Redmond a dévoilé un grand nombre de fonctionnalités pour Copilot. Microsoft Copilot se dote de la mémoire, des actions, de la vision, de la recherche approfondie, des podcasts, des pages et bien plus encore.

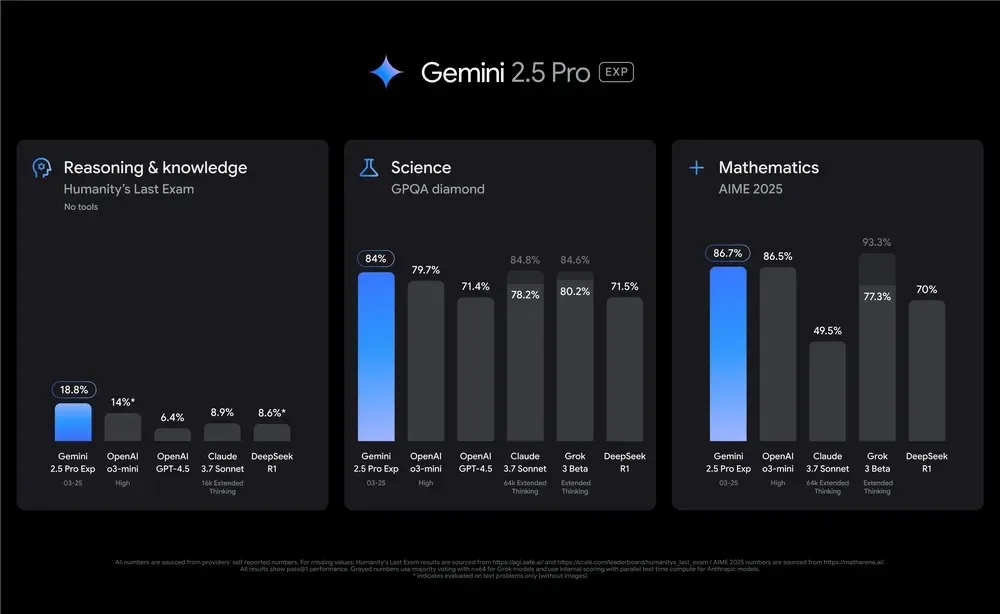

Avec toutes ces nouvelles fonctionnalités, Microsoft rend Copilot presque aussi performant que ChatGPT ou Gemini.

Voici toutes les nouvelles fonctionnalités annoncées par Microsoft pour Copilot.

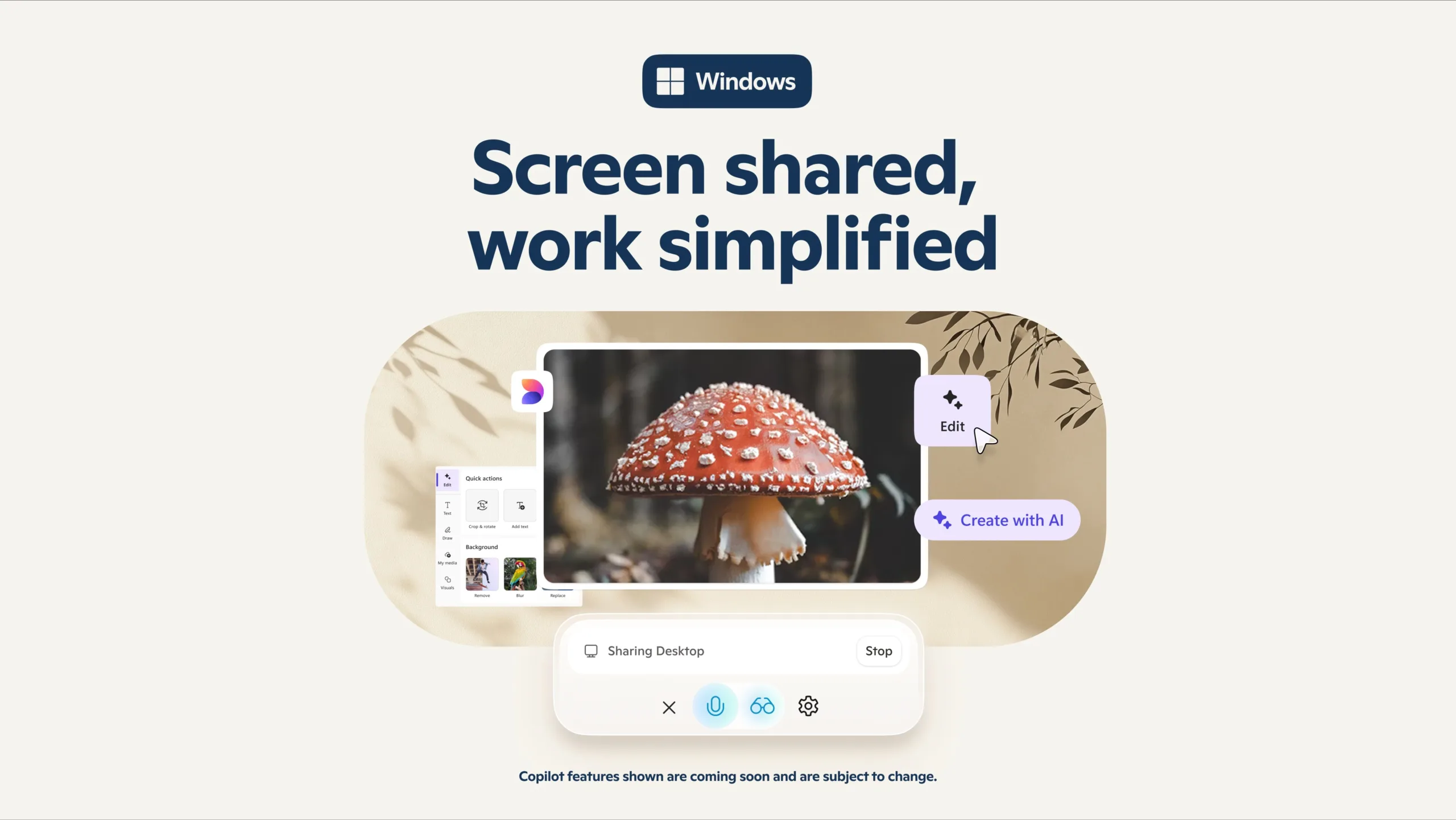

Copilot Vision

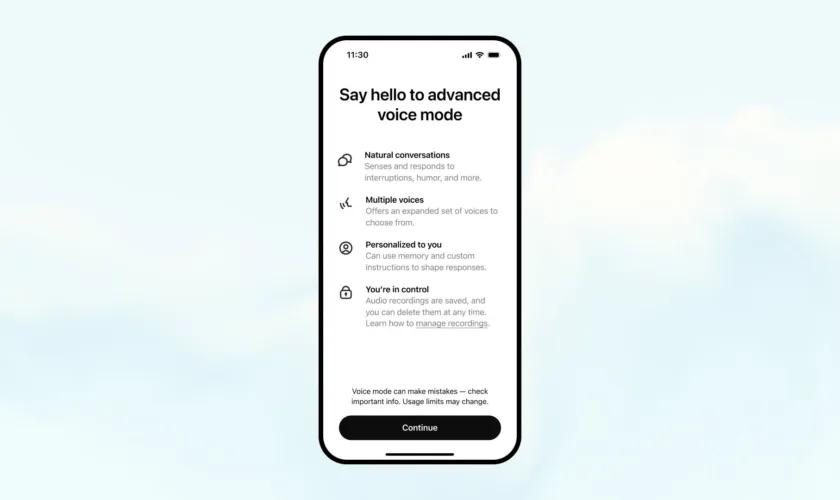

Commençons par Copilot Vision. Copilot Vision est capable de voir à travers la caméra et d’analyser votre écran pour interagir en temps réel par le biais d’un chat vocal. Copilot Vision a déjà été déployé sur le Web, mais Microsoft l’étend désormais à Android et iOS. De plus, grâce à l’application Copilot native sur Windows, vous pouvez utiliser la fonctionnalité Vision sur toutes les applications Windows.

En ce qui concerne la disponibilité, Copilot Vision est déployé sur Android et iOS à partir d’aujourd’hui. Et Vision sera disponible pour les Windows Insiders à partir de la semaine prochaine.

Copilot Actions

Ensuite, Copilot a reçu un support pour les Actions, ce qui le rend agentique dans une certaine mesure. Les Copilot Actions peuvent prendre des mesures en votre nom. Par exemple, vous pouvez demander à Copilot de réserver des billets pour un événement ou une table dans un restaurant. Il fonctionne avec la plupart des sites Web, mais Microsoft s’est associé à de nombreux sites web pour rendre l’expérience transparente.

Voici les sites Web optimisés pour les actions Copilot : Flowers.com, Booking.com, Expedia, Kayak, OpenTable, Priceline, Tripadvisor, Skyscanner, Viator et Vrbo.

Mémoire et personnalisation

En outre, Microsoft Copilot s’améliore en matière de personnalisation, grâce à la prise en charge de la mémoire. Copilot se souvient de vos préférences lors des conversations et personnalise votre expérience en fonction de ce qu’il a appris sur vous. Par exemple, au fil de la conversation, il apprend quel type de film vous aimez, où vous vivez, quel type de nourriture vous appréciez, etc. Si vous souhaitez que Copilot oublie certains souvenirs, vous pouvez les supprimer ou désactiver complètement la fonction.

Par ailleurs, Microsoft expérimente la possibilité de donner aux utilisateurs le contrôle de la création d’une apparence pour Copilot. Ainsi, vous pouvez concevoir et personnaliser l’apparence de Copilot pour créer un personnage divertissant.

Deep Research

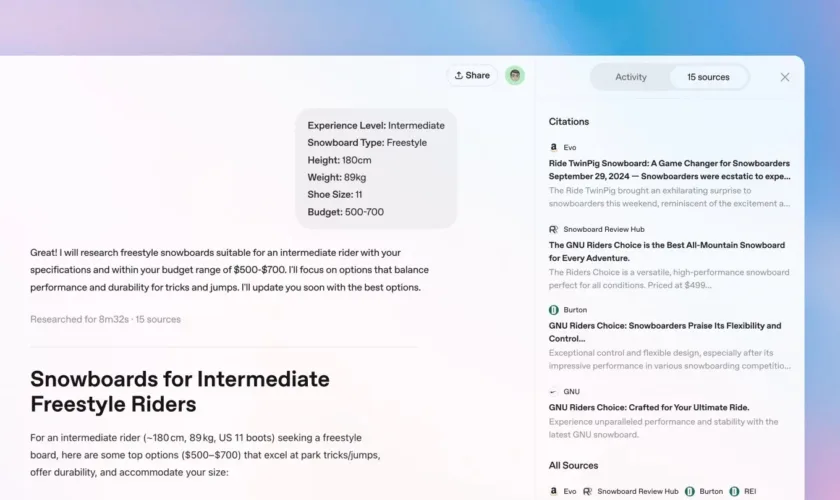

Deep Research est un outil d’intelligence artificielle qui sera intégré à Copilot et qui vous permettra d’effectuer des recherches en plusieurs étapes en quelques minutes. Il peut naviguer sur le Web, recueillir des informations à partir de sources multiples et extraire des informations de documents et d’images volumineux. Il analyse ensuite toutes les informations et crée pour vous un document de recherche de niveau expert. Cet agent est similaire à l’agent Deep Research disponible sur ChatGPT et Gemini.

Copilot Pages

Les Pages sont une autre fonctionnalité de Copilot. Vous pouvez créer des pages dans Copilot où vous pouvez jeter vos pensées, vos notes de recherche et votre contenu, et Copilot les organise de manière ordonnée. Vous pouvez utiliser les pages pour réfléchir, planifier, écrire, étudier et organiser vos notes éparses. Avec l’aide de Copilot, vous pouvez affiner et itérer vos notes dans Pages de manière transparente.

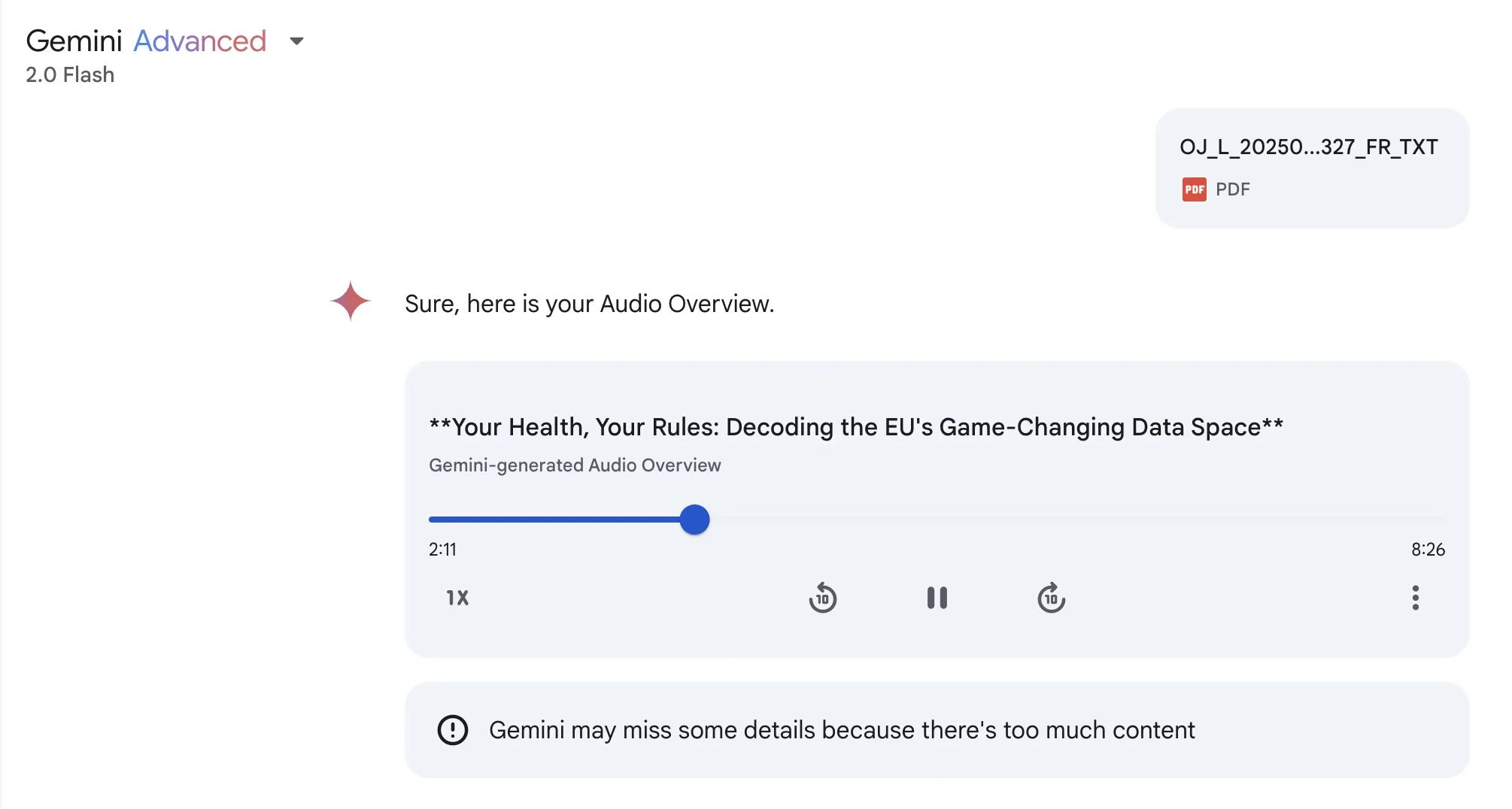

Podcasts

Microsoft apporte également à Copilot des podcasts alimentés par l’IA. Copilot peut générer des podcasts personnalisés en fonction de vos centres d’intérêt, tout comme NotebookLM. Vous pouvez également fournir vos notes ou votre matériel d’étude, et Copilot crée un podcast alimenté par l’IA pour vous. Le plus intéressant, c’est que vous pouvez également interagir avec le podcast généré et parler pour en savoir plus sur le sujet. En fait, vous pouvez créer un podcast IA interactif sur tout et n’importe quoi.

Shopping

Microsoft veut faire de Copilot votre acheteur personnel. Par exemple, vous pouvez simplement demander à Copilot de vous suggérer des tasses élégantes. Il effectue les recherches pour vous et vous propose des articles correspondant à votre budget. Vous pouvez consulter les détails et acheter l’article directement sur Copilot, mais notez que cette expérience n’est prise en charge que sur les sites web partenaires. En outre, Copilot peut suivre les baisses de prix et comparer les produits pour vous.

Recherche Copilot dans Bing

À l’instar des AI Overviews de Google, Microsoft intègre Copilot Search à Bing. Lorsque vous effectuez une recherche sur Bing, Copilot Search parcourt le Web et compile les informations des sites Web pertinents pour vous présenter une réponse détaillée. Il ajoute également des citations afin que vous puissiez vérifier les informations.

Microsoft indique que la nouvelle expérience Copilot Search dans Bing est déployée dès aujourd’hui. Toutefois, il s’agit d’un déploiement limité et dans les semaines et mois à venir, davantage d’utilisateurs auront accès à Copilot Search dans Bing.