Imaginez un seul outil capable de coder, générer des images, faire de la recherche avancée, tout en apprenant et s’améliorant au fil de son utilisation. Ce n’est plus de la science-fiction : ChatGPT Agent, l’agent intelligent développé par OpenAI, ambitionne de devenir votre assistant numérique ultime, et peut-être bien plus encore.

Loin d’un simple assistant conversationnel, ChatGPT Agent se positionne comme un véritable collaborateur numérique, capable de gérer des tâches complexes, de centraliser des outils disparates et de fluidifier vos workflows.

Il est aussi une démonstration de ce que l’intelligence artificielle peut apporter dans la transformation du monde professionnel, tout en soulevant des questions majeures : comment encadrer son usage de manière responsable et éthique ?

ChatGPT Agent : Un outil polyvalent aux fonctions avancées

Conçu pour intégrer plusieurs outils IA dans une interface unifiée, ChatGPT Agent permet d’éliminer les frictions habituelles liées au multitâche entre applications. Il repose sur des techniques d’apprentissage par renforcement (reinforcement learning), ce qui signifie qu’il devient plus précis, plus pertinent et plus efficace à chaque utilisation.

Parmi ses fonctionnalités phares :

- Exécution de code : il automatise les tâches de programmation, du débogage à l’optimisation de scripts.

- Génération d’images : il crée des visuels sur mesure pour des projets créatifs ou professionnels.

- Recherche approfondie : il mène des analyses complexes, utiles en science, finance, veille concurrentielle ou journalisme.

Toutes ces opérations se déroulent dans un environnement isolé sécurisé (sandbox), garantissant que vos données et vos systèmes restent protégés.

Un assistant pour développeurs, chercheurs, créatifs… et au-delà

L’agent excelle dans divers secteurs, notamment la science des données, le développement logiciel, ou encore l’analyse financière. Sa capacité à traiter des volumes massifs de données et à fournir des rapports structurés en fait un outil d’aide à la décision stratégique.

Mais attention, il n’est pas infaillible. Lorsqu’il s’agit de tâches très nuancées ou créatives — comme l’analyse contextuelle de documents complexes ou la gestion avancée de tableaux financiers — l’expertise humaine reste irremplaçable. C’est dans cette complémentarité entre IA et humain que réside sa vraie puissance.

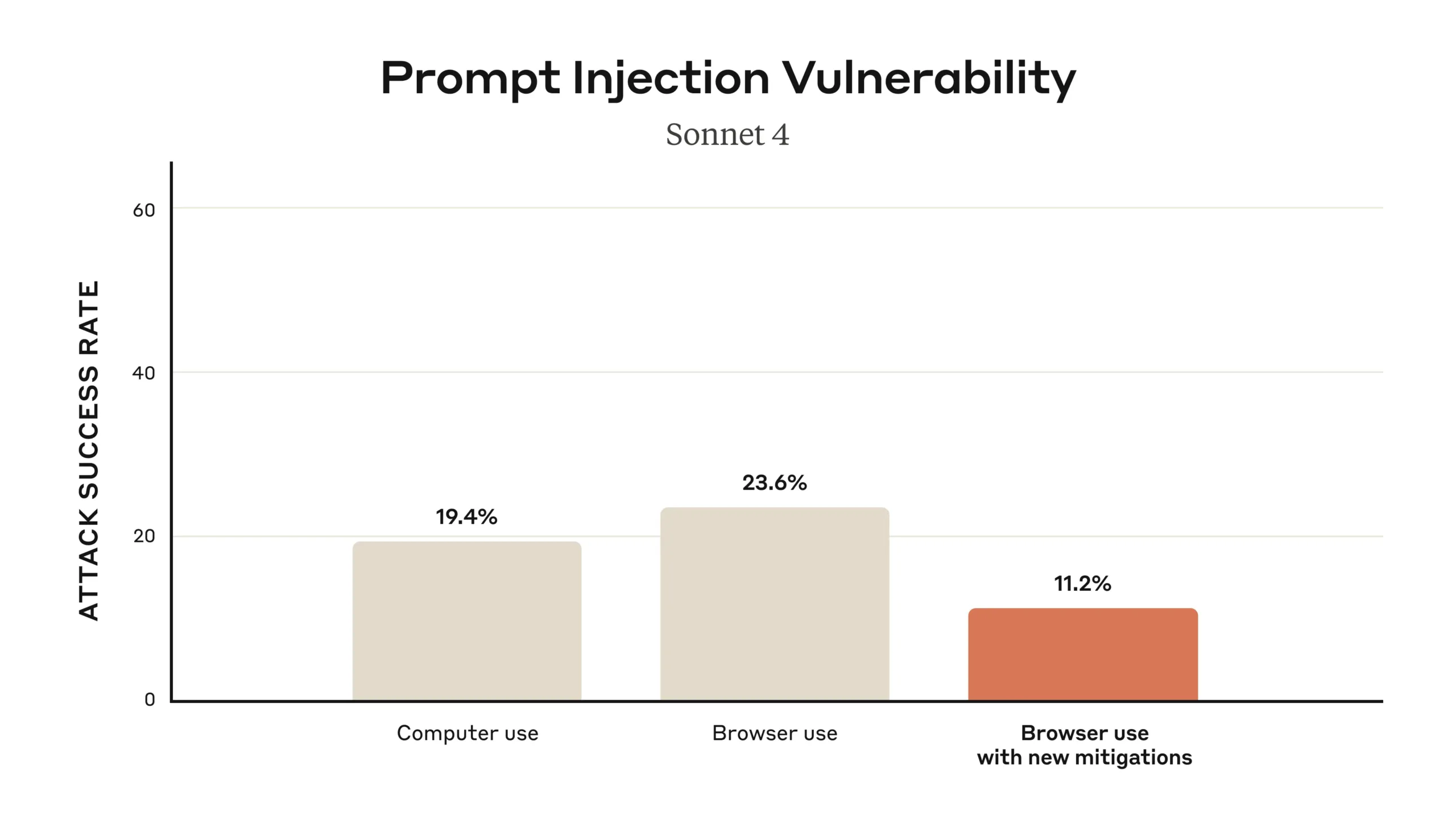

Sécurité et éthique : des enjeux centraux

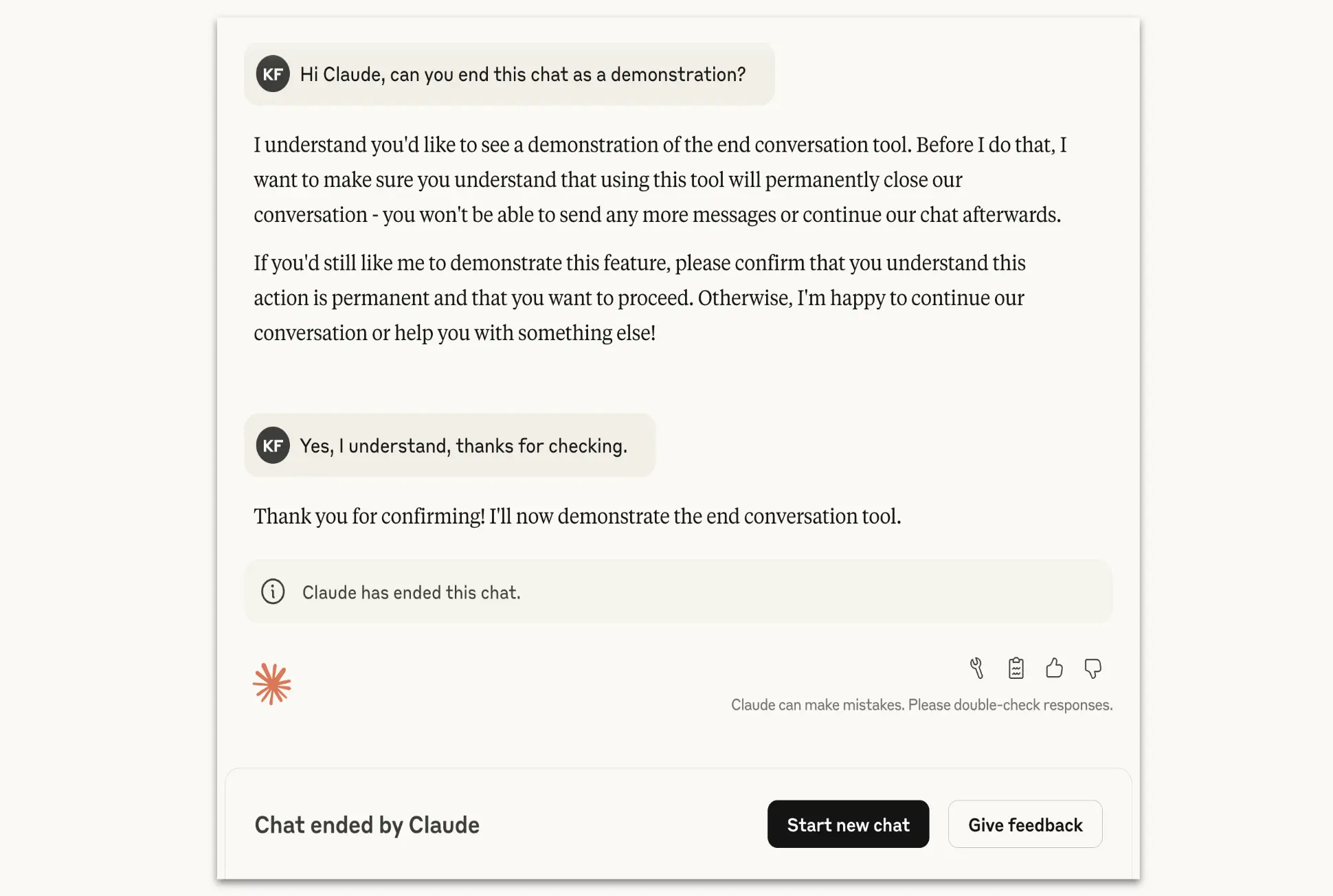

OpenAI a pensé la sécurité dès la conception de ChatGPT Agent. Chaque tâche est exécutée sous surveillance de l’utilisateur, et aucune action sensible n’est entreprise sans autorisation explicite.

Cela dit, la puissance de l’outil implique une grande vigilance. Donner à un agent IA l’accès à des données sensibles, des comptes privés ou à votre environnement de travail nécessite une compréhension claire des risques : fuites de données, biais dans les réponses, usage non éthique… Ce sont des réalités à ne pas sous-estimer.

L’utilisateur doit donc adopter une posture de :

- Maîtrise des droits d’accès,

- Surveillance régulière des usages,

- Respect des principes éthiques en matière d’IA (vie privée, consentement, transparence…).

Une IA qui apprend, s’adapte et se développe

ChatGPT Agent n’est pas un outil figé. Il évolue activement avec l’ajout de nouvelles fonctionnalités, comme l’agent de recherche (Deep Research), qui remplace désormais l’ancien outil « Operator ». Des versions futures pourraient également intégrer des modules spécialisés en droit, santé ou ingénierie.

Accessible aux abonnés Pro, Plus et Teams, l’agent bénéficie de limites d’utilisation étendues pour les abonnés haut de gamme, avec une expérience optimisée pour les professionnels exigeants.

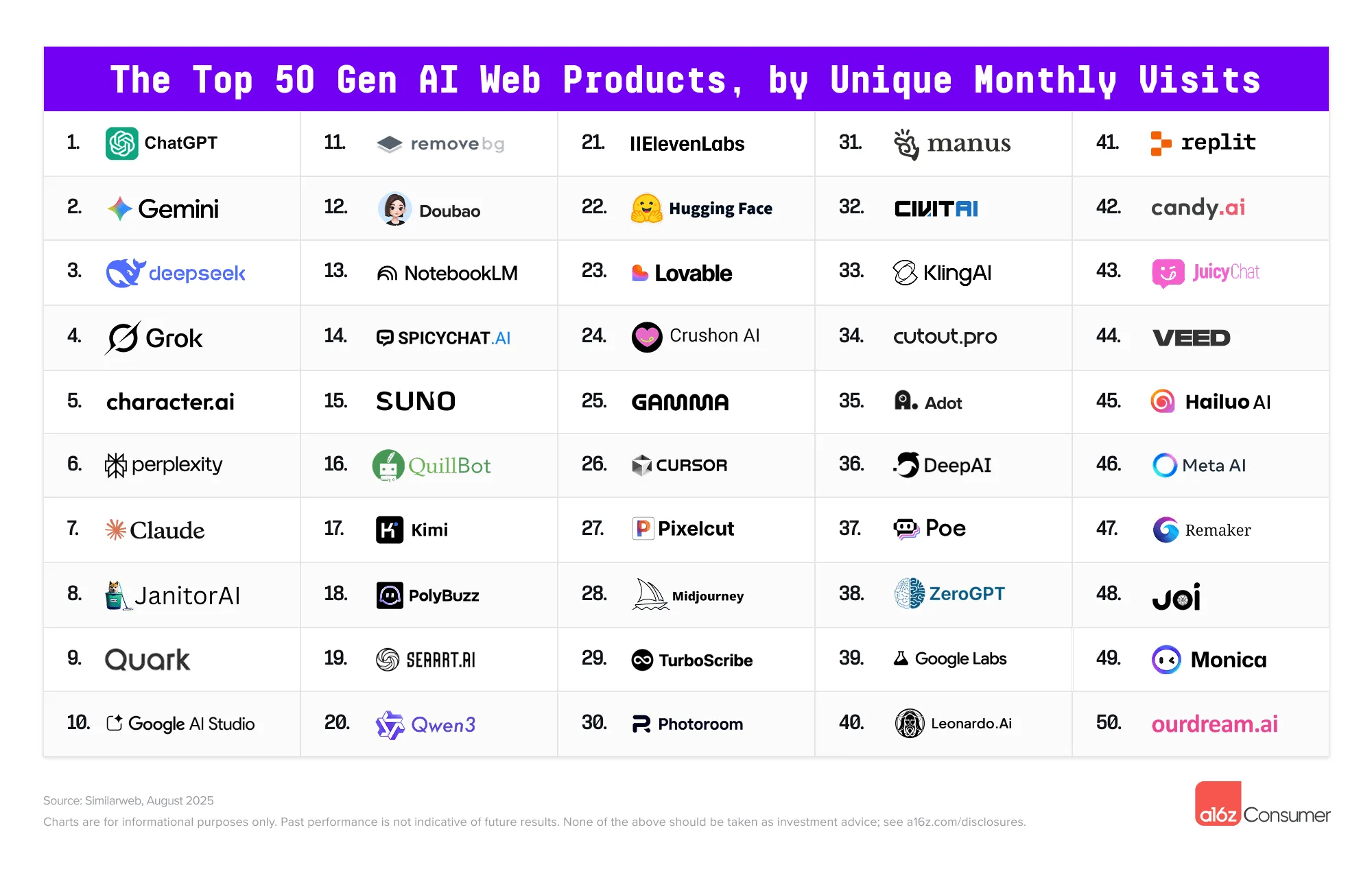

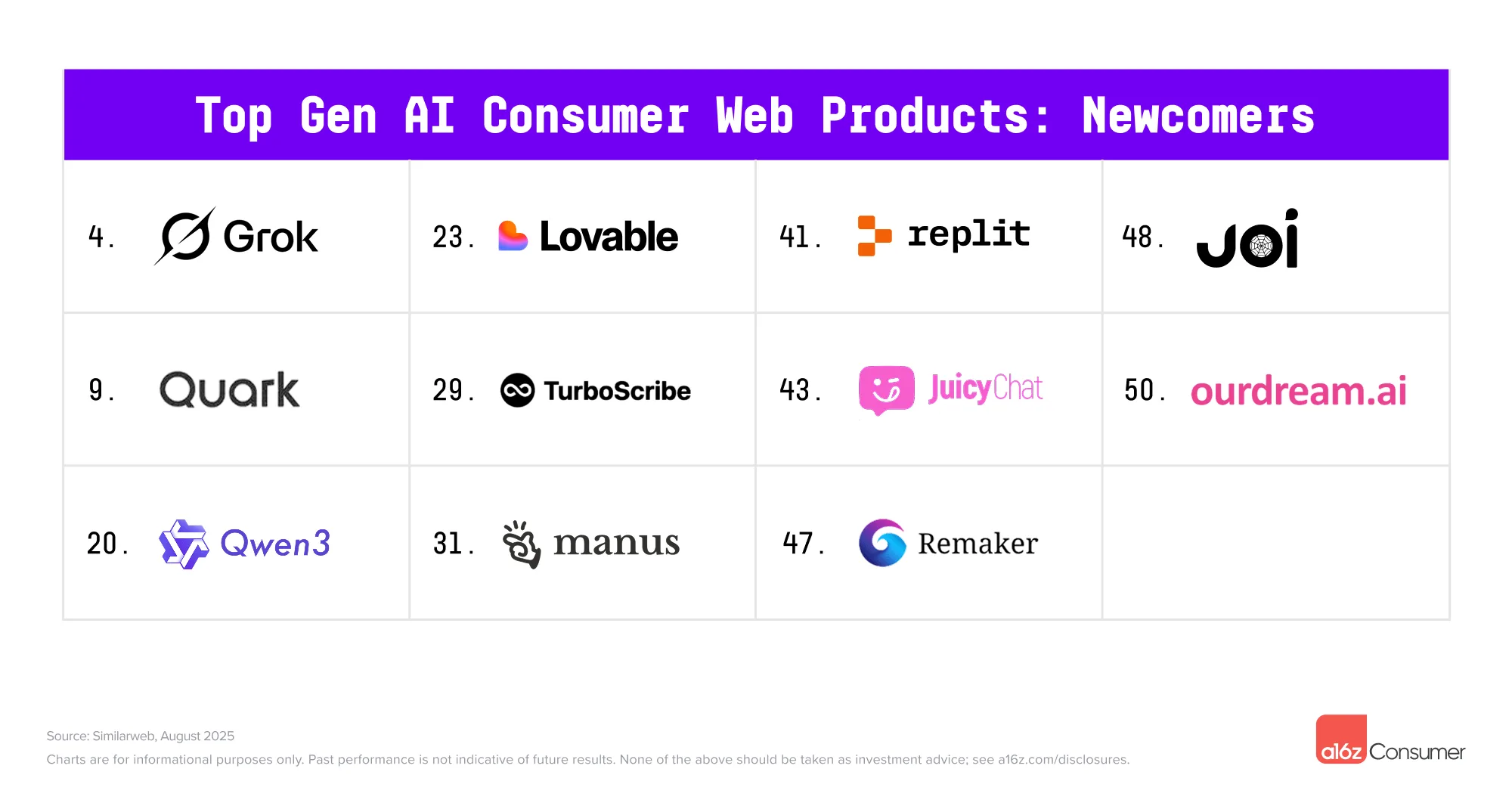

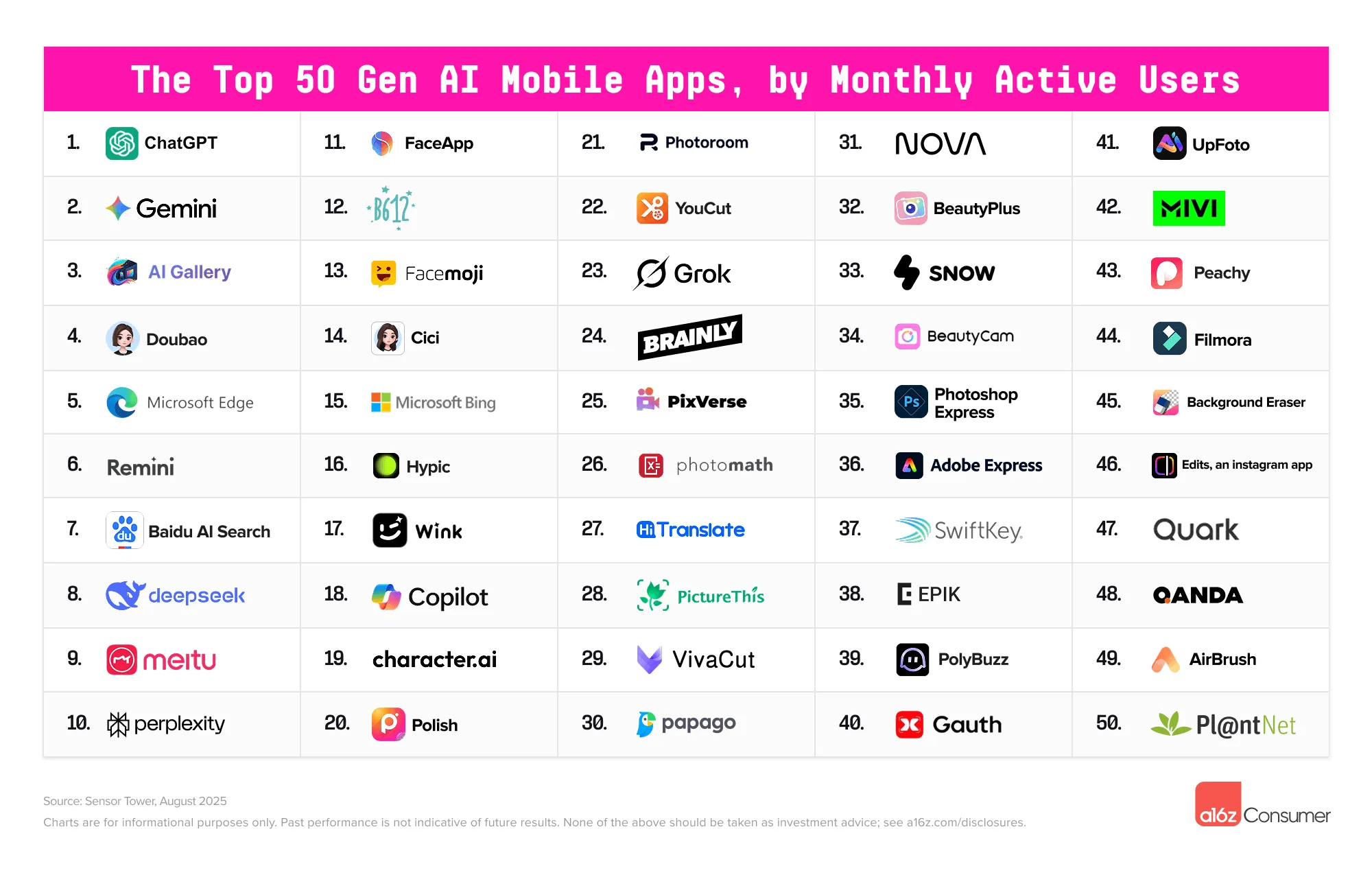

ChatGPT Agent face à la concurrence : vers un avenir centré sur l’IA

OpenAI n’est pas seul sur ce terrain. Des alternatives comme Google Mariner se positionnent aussi sur le créneau des agents intelligents multiformes, capables d’automatiser des tâches complexes. La concurrence stimule l’innovation, mais impose aussi une responsabilité partagée : les entreprises doivent anticiper les dérives possibles et favoriser un déploiement éthique et réglementé.

En parallèle, l’émergence de ces outils transforme les métiers : automatisation des processus, génération de contenus, assistance à la décision… La frontière entre outil et collaborateur devient floue, imposant une nouvelle vision du travail numérique.

Entre promesse et responsabilité

ChatGPT Agent représente une étape majeure dans l’évolution de l’IA appliquée au quotidien professionnel. Il améliore l’efficacité, réduit les frictions, et ouvre des possibilités nouvelles. Mais cet outil n’est pas magique. Il exige de comprendre ses limites, de respecter les règles de sécurité et d’adopter une utilisation responsable.

Utilisé avec discernement, le ChatGPT Agent peut devenir un levier stratégique pour gagner en productivité, améliorer la qualité des livrables et dégager du temps pour les tâches à forte valeur ajoutée.