OpenAI, la société derrière ChatGPT, franchit une étape majeure : pour la première fois, elle propose des programmes de certification officiels destinés aux travailleurs et aux enseignants. Cette initiative, regroupée sous la nouvelle OpenAI Academy, vise un objectif ambitieux : certifier 10 millions d’Américains aux compétences IA d’ici 2030.

Deux formations inédites : un certificat pour les pros, un pour les enseignants

1. AI Foundations — la formation principale

Objectif : maîtriser des compétences IA pratiques et utiles au travail.

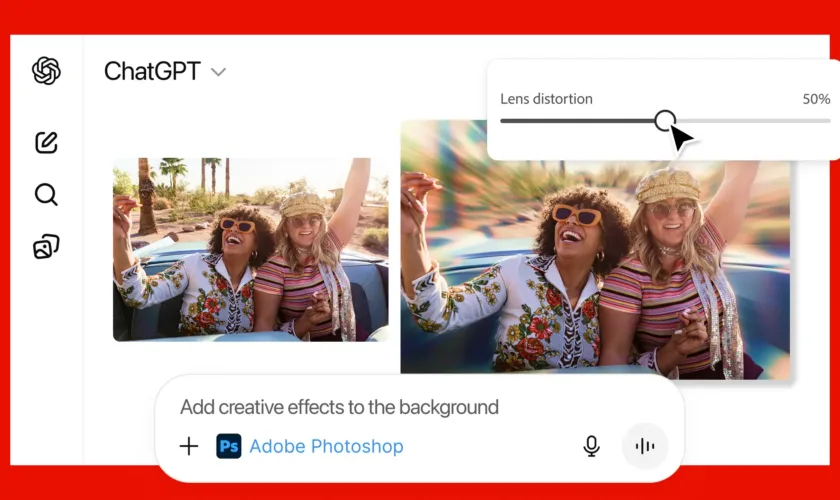

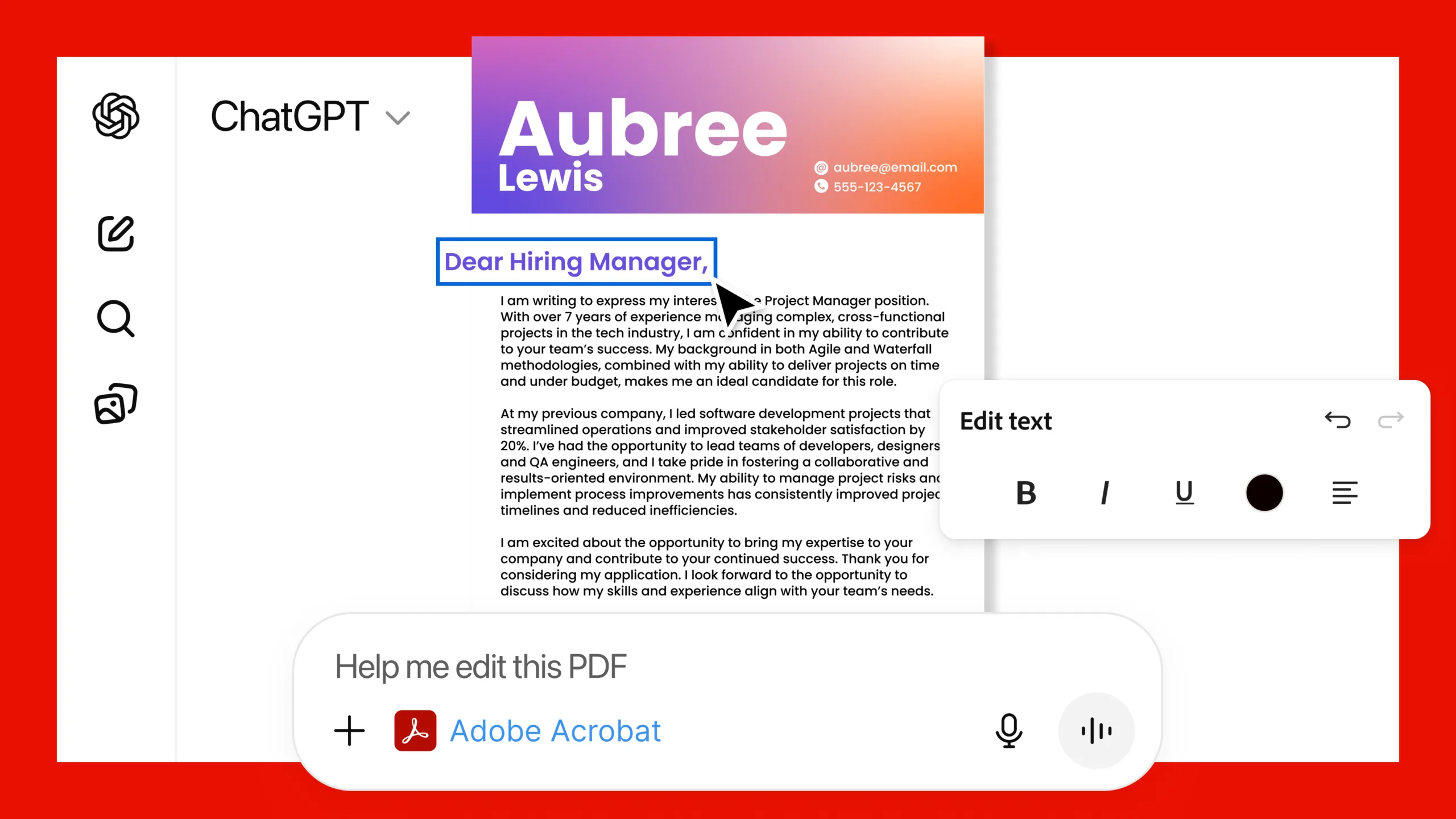

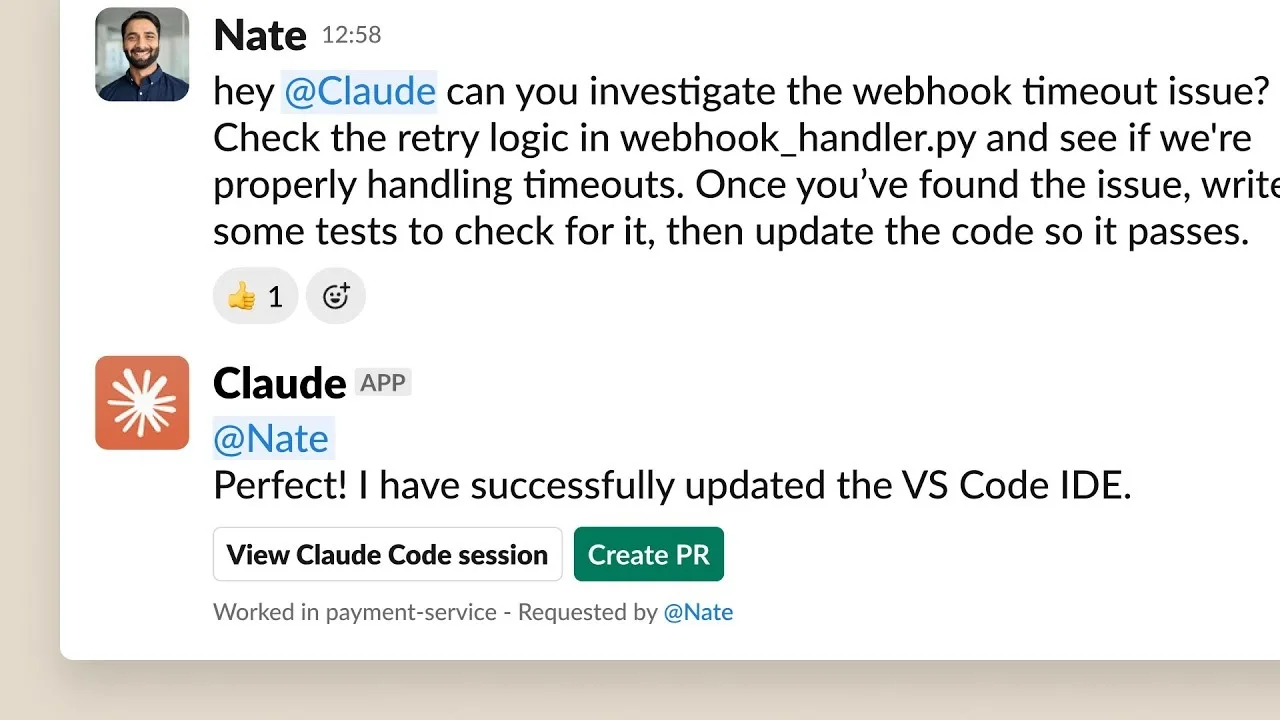

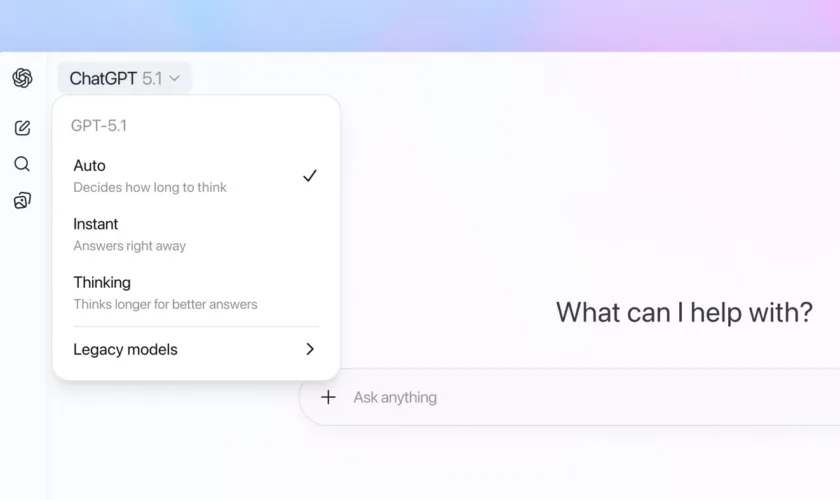

- Disponible directement dans ChatGPT, via un mode d’apprentissage dédié.

- Permet de pratiquer des tâches réelles, avec retours immédiats du chatbot.

- Débouche sur une certification officielle OpenAI.

- Pensée pour améliorer :

- la productivité,

- l’automatisation de tâches,

- la prise de décision assistée par IA,

- la rédaction, l’analyse, la synthèse, l’organisation…

L’accès est pour l’instant limité à des pilotes avec de grands employeurs comme : Walmart, Boston Consulting Group, Upwork, Accenture… avant une ouverture plus large.

2. ChatGPT Foundations for Teachers — spécial enseignants K-12

Objectif : intégrer l’IA dans l’enseignement et l’administration scolaire.

- Disponible sur Coursera, immédiatement accessible à tous.

- Niveau débutant, 7 modules, environ 4 heures de formation.

- Enseigne comment :

- utiliser ChatGPT pour créer des leçons,

- préparer des activités pédagogiques,

- gérer l’administratif (planning, rapports, notes…),

- guider les élèves dans un usage responsable de l’IA.

OpenAI prévoit déjà de nouveaux certificats dédiés au monde de l’éducation.

Pourquoi c’est important ?

C’est la première fois que OpenAI propose des formations structurées et certifiantes. Historiquement, l’entreprise se concentrait sur la création d’outils, laissant les utilisateurs apprendre seuls.

Mais le monde du travail change :

- Les entreprises recherchent des employés maîtrisant l’IA.

- Les enseignants doivent guider les élèves dans un environnement où l’IA fait partie du quotidien.

- Les individus, eux, veulent comprendre et utiliser des outils comme ChatGPT de manière efficace.

Obtenir un certificat OpenAI devient ainsi un avantage concret sur un CV, un signe de compétence vérifiée.

Pour les écoles : une révolution pédagogique en marche

Avec cette formation, les enseignants pourront créer plus rapidement des supports de cours, concevoir des activités différenciées pour élèves en difficulté, automatiser des tâches chronophages, et encadrer l’usage de l’IA de façon éthique.

Cela s’inscrit dans une tendance plus large où l’IA devient un nouvel outil éducatif, au même titre que les ordinateurs ou les tablettes il y a 15 ans.

Pour les entreprises : une nouvelle norme de compétence

Les employeurs bénéficieront d’une évaluation normalisée de la maîtrise des IA, d’employés mieux formés aux workflows IA, et d’une productivité accrue via l’automatisation.

OpenAI veut ainsi créer un standard de compétences IA, comparable à des certifications comme Google Career Certificates ou Microsoft Learn, mais centré sur ses propres technologies.

Et la suite ?

OpenAI développe également un nouveau programme de certificats pour un public plus large, d’autres modules spécialisés (industrie, administration, communication, santé…), une plateforme d’emploi IA prévue pour mi-2026, visant à connecter travailleurs et entreprises cherchant des compétences IA.

Avec ces nouvelles formations, OpenAI passe du statut d’éditeur d’outils à acteur de l’éducation et de la formation professionnelle. Ce changement pourrait transformer à la fois le marché du travail, les méthodes d’enseignement, et la relation des individus à l’IA.