Google pousse encore plus loin les capacités de son IA avec l’introduction de Gemini-Exp-1206, un modèle expérimental accessible aux abonnés Gemini Advanced. Cette nouveauté arrive peu après le lancement du modèle expérimental Gemini 2.0 Flash, témoignant de la cadence rapide à laquelle Google enrichit son offre en IA générative.

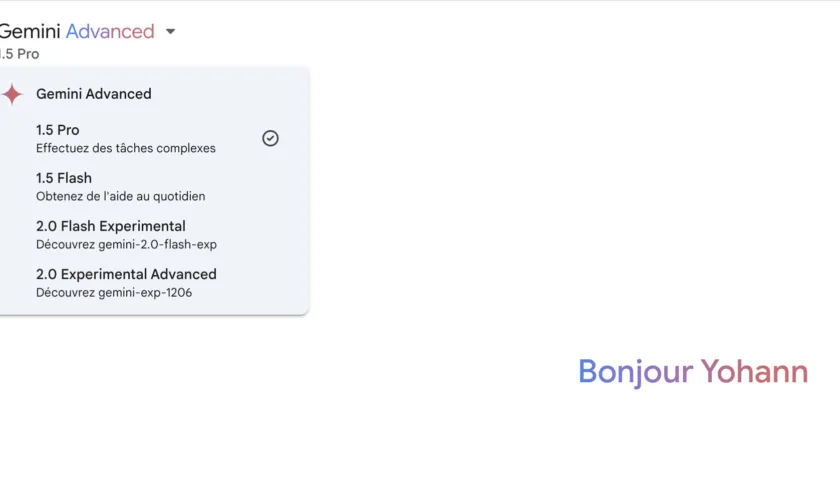

Dans le sélecteur de modèles accessible sur les plateformes Web (mais pas encore via l’application mobile), une nouvelle option baptisée « 2.0 Experimental Advanced » permet de tester le modèle Gemini-Exp-1206. Selon Google, ce modèle se distingue particulièrement dans les domaines suivants :

- Codage : meilleur traitement des bases de code complexes.

- Mathématiques : résolution avancée de problèmes et calculs multi-étapes.

- Raisonnement : capacité accrue à fournir des réponses précises sur des sujets exigeant une réflexion approfondie.

- Instruction sur mesure : génération de plans d’affaires personnalisés ou instructions détaillées pour des projets complexes.

Ce modèle Gemini-Exp-1206 promet des améliorations significatives en termes de performance et d’efficacité, bien que Google précise qu’il est encore en phase de « prévisualisation précoce ». Cela signifie que certaines fonctionnalités existantes de Gemini ne sont pas encore compatibles et que le modèle n’a pas accès à des informations en temps réel.

Élargir l’écosystème Gemini

Depuis son lancement, Gemini Advanced a introduit plusieurs modèles puissants, notamment les versions 1.0 Ultra et 1,5 Pro. Il est possible que Gemini-Exp-1206 devienne la version 2.0 Pro ou une variante encore plus avancée, préparant ainsi le terrain pour un développement futur.

En outre, Google prévoit de déployer plus de tailles de modèles Gemini 2.0 en janvier 2025, incluant la disponibilité de Gemini 2.0 Flash pour les développeurs. Ces évolutions marquent une nouvelle étape dans l’expansion de la plateforme Gemini et confirment l’ambition de Google de rivaliser avec des leaders comme OpenAI dans le domaine de l’IA générative.

Coût et accès

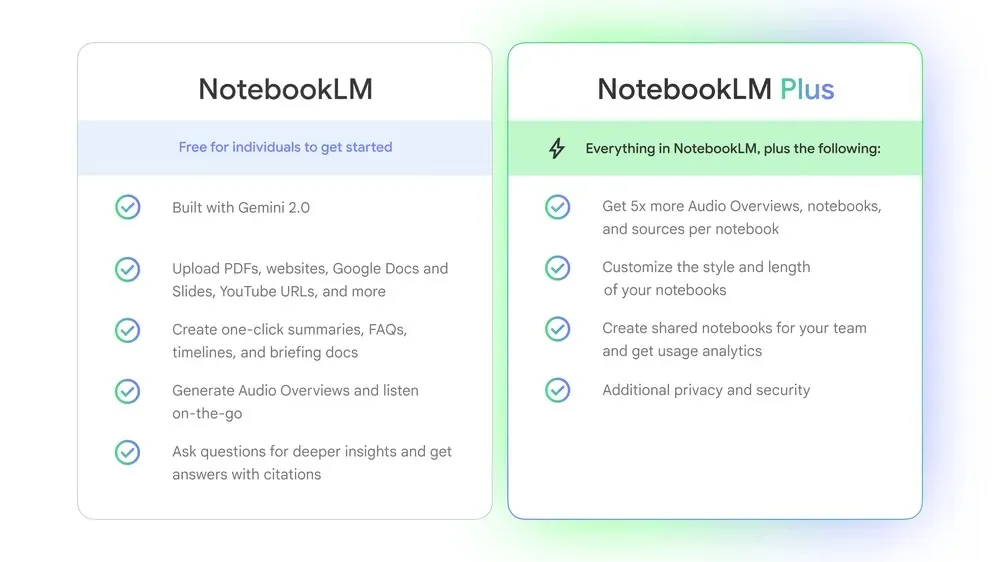

Pour explorer Gemini-Exp-1206, les utilisateurs doivent souscrire à l’abonnement Gemini Advanced via l’offre Google One AI Premium, au tarif de 21,99 euros par mois. Cet abonnement donne accès à des modèles d’IA hautement performants, ainsi qu’aux nouvelles fonctionnalités expérimentales.

Ce modèle témoigne du potentiel croissant des technologies d’IA générative. Bien que Gemini-Exp-1206 soit encore en phase de test, ses capacités dans des domaines complexes montrent à quel point l’IA peut transformer des tâches techniques en solutions accessibles et puissantes.

L’avenir s’annonce passionnant pour les amateurs de technologie et les professionnels qui dépendent de ces outils avancés. Alors que Google continue d’affiner et d’étendre sa gamme Gemini, il sera intéressant de voir comment ces innovations redéfiniront le paysage de l’IA générative dans les années à venir.