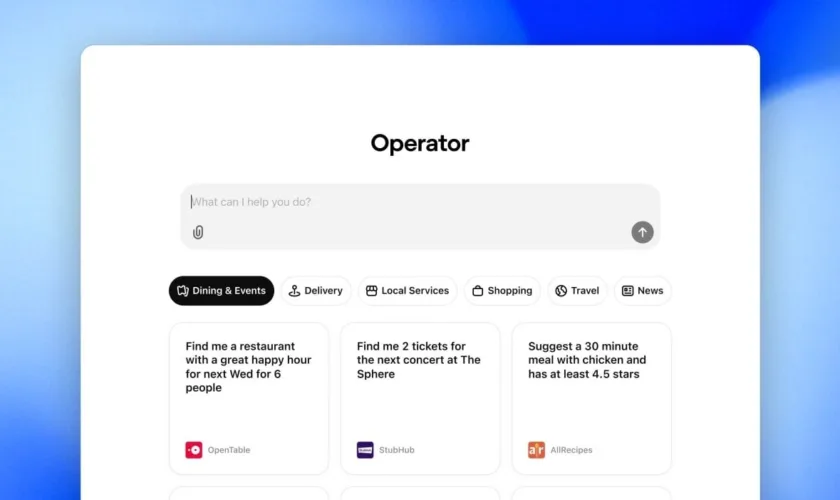

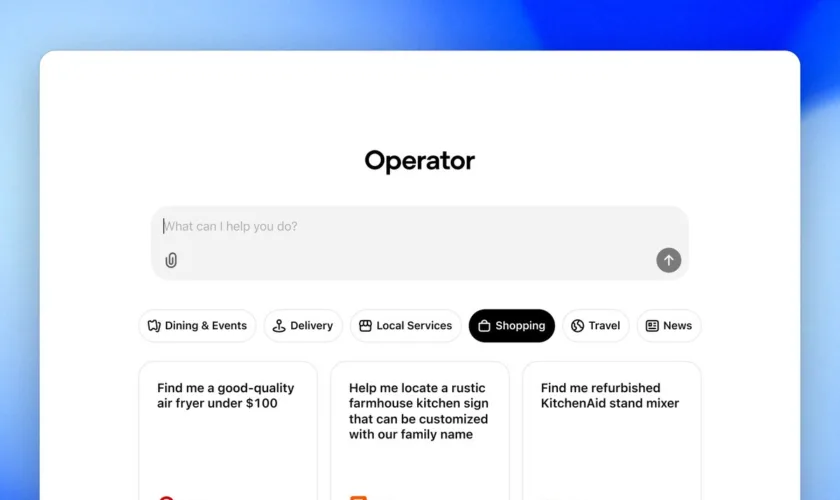

OpenAI a officiellement lancé Operator, son nouvel outil d’agent AI, sous forme de « recherche en avant-première ». Basé sur le modèle GPT-4o, cet agent informatique (Computer Using Agent — CUA) se distingue par ses capacités multimodales, notamment la recherche Web avancée et la compréhension des résultats pour effectuer des tâches complexes. Toutefois, ce lancement n’est pas exempt de critiques et de limites.

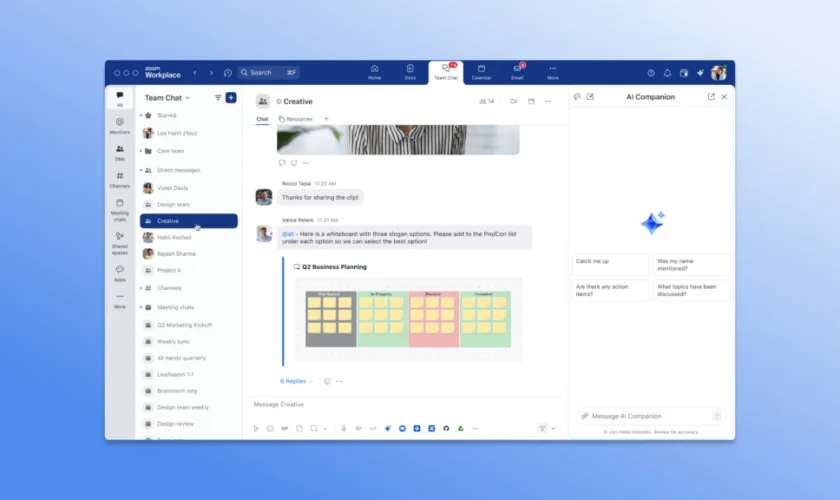

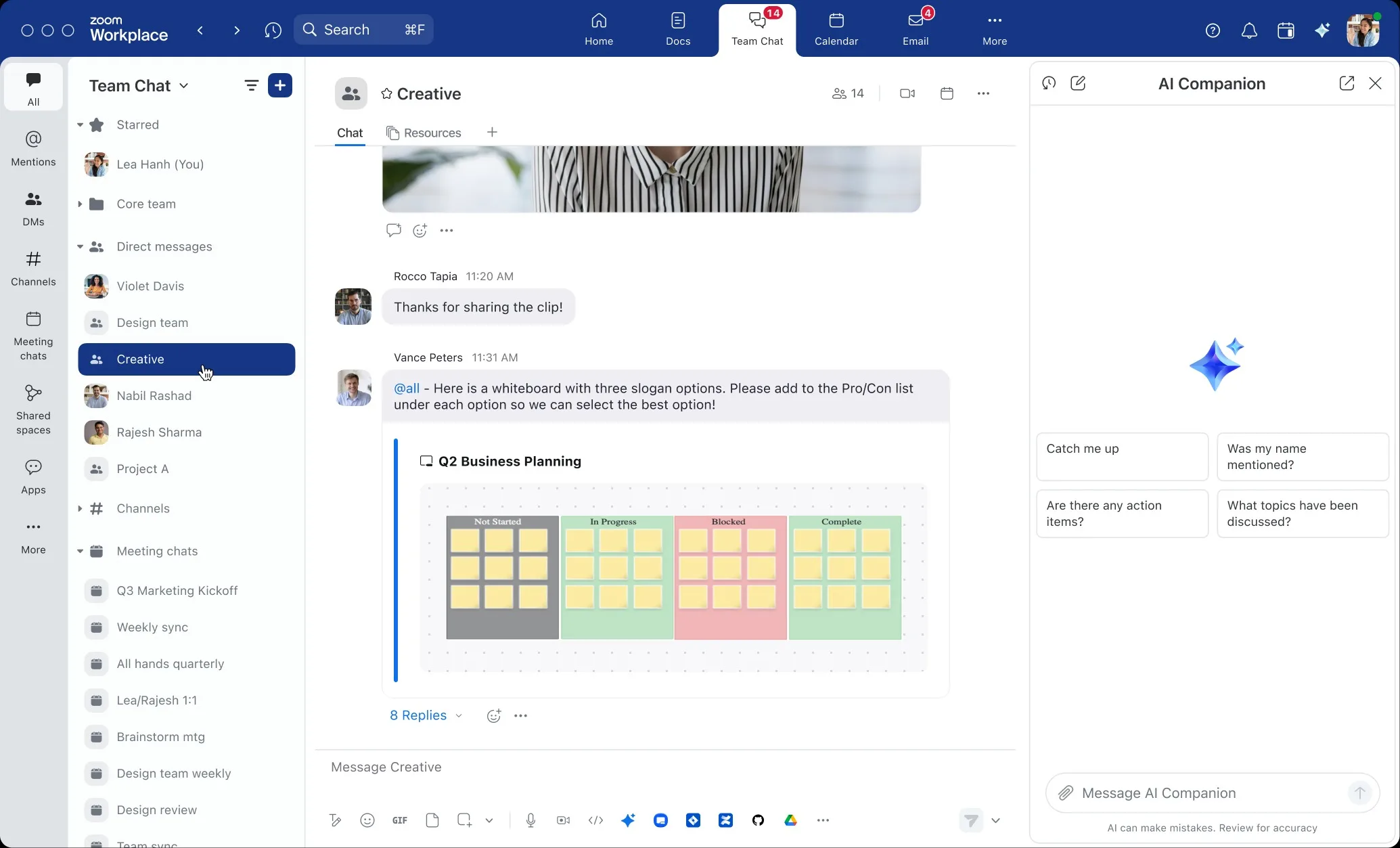

Operator a été conçu pour aller au-delà des capacités classiques des chatbots comme ChatGPT. En plus d’exécuter des tâches complexes, il peut rechercher, cliquer, faire défiler des pages et interagir avec des interfaces Web. Lors d’une démonstration en ligne, OpenAI a mis en avant des fonctionnalités fascinantes, telles que la capacité d’interpréter et de répondre en fonction du contexte des recherches effectuées.

Cependant, cet enthousiasme a été tempéré par les retours des premiers utilisateurs.

Les premières critiques : Bugs et problèmes de performances

Plusieurs utilisateurs ayant testé Operator ont signalé des bugs et des incohérences par rapport à la fluidité observée lors de la démonstration. Parmi les problèmes évoqués :

- Temps de réponse lent, ce qui rend l’outil moins pratique dans un usage en temps réel.

- Hallucinations similaires à celles observées avec ChatGPT, où l’agent fournit des réponses incorrectes ou inventées.

Un utilisateur sur X a mentionné des erreurs lors de l’interaction d’Operator avec un site d’actualités, attirant l’attention du CEO d’OpenAI, Sam Altman, qui a promis une correction rapide. Cependant, certains problèmes pourraient être liés à des hallucinations générées par l’IA elle-même.

Un coût élevé qui limite l’accessibilité

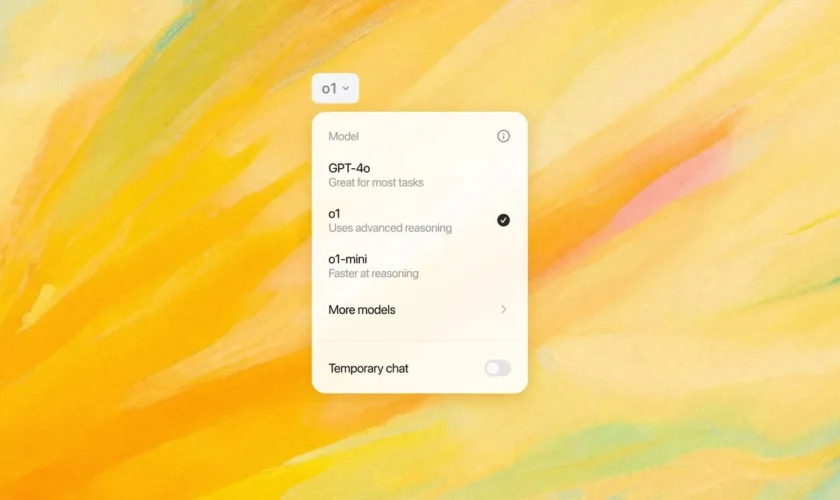

L’un des principaux obstacles à l’adoption d’Operator est son prix élevé. L’outil est actuellement disponible via l’abonnement ChatGPT Pro à 200 dollars par mois, rendant l’accès réservé à une niche d’utilisateurs.

Des abonnés à ChatGPT Plus, qui coûte 20 dollars par mois, ont exprimé leur frustration face à ce prix prohibitif. Selon OpenAI, Operator pourrait être inclus à l’avenir dans les offres Plus, Team et Enterprise, rendant l’outil plus accessible.

Disponibilité géographique restreinte

Actuellement, Operator est exclusivement disponible aux États-Unis, ce qui a suscité des critiques de la part des utilisateurs européens, qui se sentent exclus. Cette restriction géographique pourrait limiter l’adoption mondiale de l’outil, surtout dans un contexte où la concurrence pour les agents AI s’intensifie.

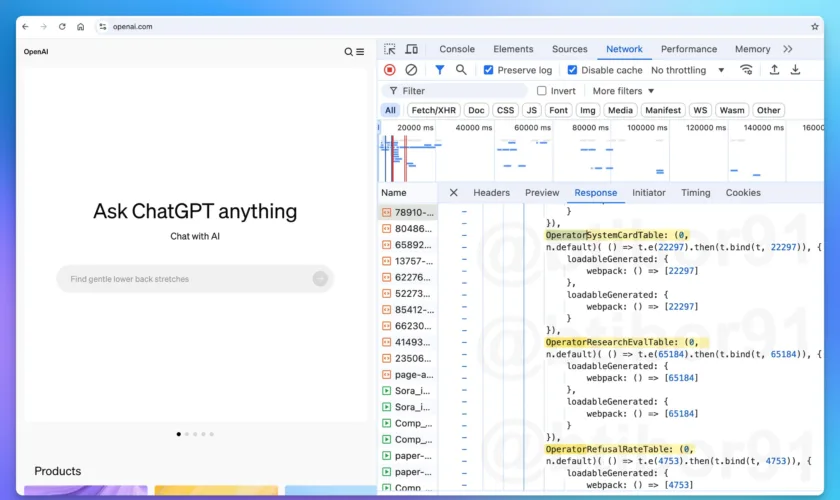

Comme le souligne ComputerWorld, les agents IA comme Operator posent des risques de sécurité uniques :

- Ils pourraient être exploités pour des attaques automatisées, comme la surcharge de trafic ou le contournement des systèmes CAPTCHA.

- Ces outils risquent de perturber les moteurs de recherche existants, comme Google, dont les algorithmes et stratégies de traitement des données pourraient entrer en conflit avec des actions automatiques d’agents AI.

Bien qu’OpenAI affirme avoir renforcé la sécurité d’Operator, des chercheurs estiment que des failles pourraient subsister, en particulier dans des environnements automatisés complexes.

Malgré les défis initiaux, Operator représente une avancée majeure dans l’univers des agents IA. Avec le temps, OpenAI pourrait améliorer les performances, élargir l’accès international, et ajuster son modèle économique pour attirer un public plus large. Mais pour l’instant, le coût élevé et les problèmes techniques freinent son adoption.

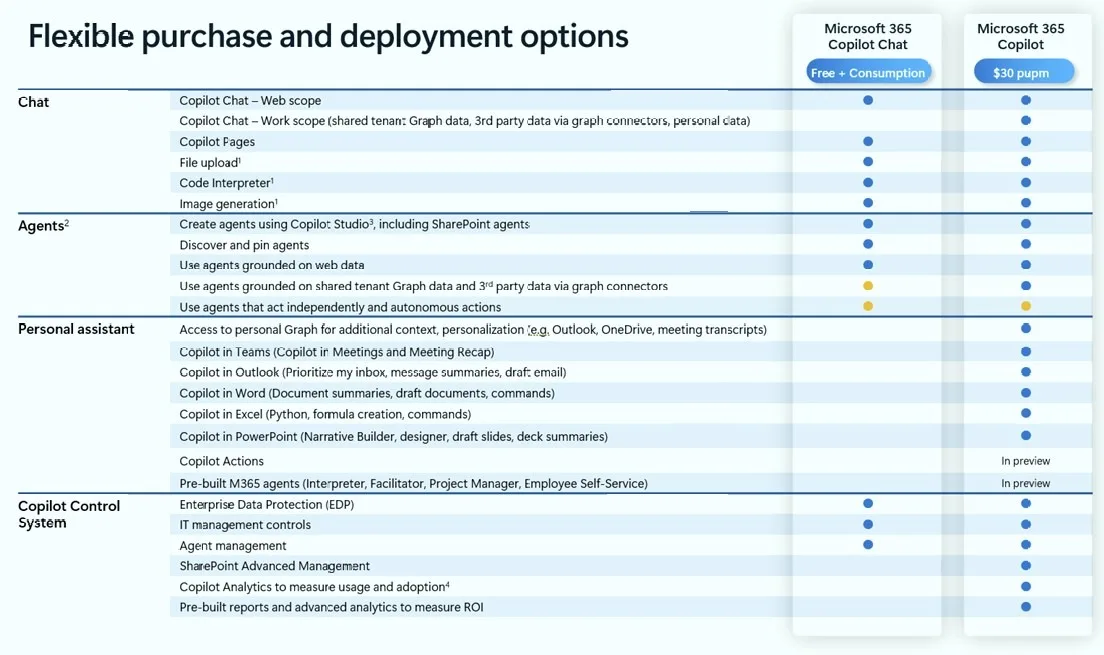

Alors que d’autres acteurs majeurs, comme Google et Microsoft, intensifient leurs efforts dans ce domaine, OpenAI devra travailler dur pour maintenir son avance et répondre aux attentes des utilisateurs.