Google prépare-t-il discrètement une révolution dans l’univers du jeu vidéo ? C’est ce que laissent entendre plusieurs messages énigmatiques postés sur X par des figures clés de DeepMind, l’unité de recherche en IA du géant américain. En réponse à un message demandant à pouvoir « jouer dans les vidéos générées par Veo 3 », Demis Hassabis, PDG de DeepMind, a répondu avec malice : « Now wouldn’t that be something » (« Ce ne serait pas quelque chose »).

now wouldn’t that be something… https://t.co/WBeCMQye91

— Demis Hassabis (@demishassabis) July 2, 2025

Veo 3 : plus qu’un générateur vidéo classique

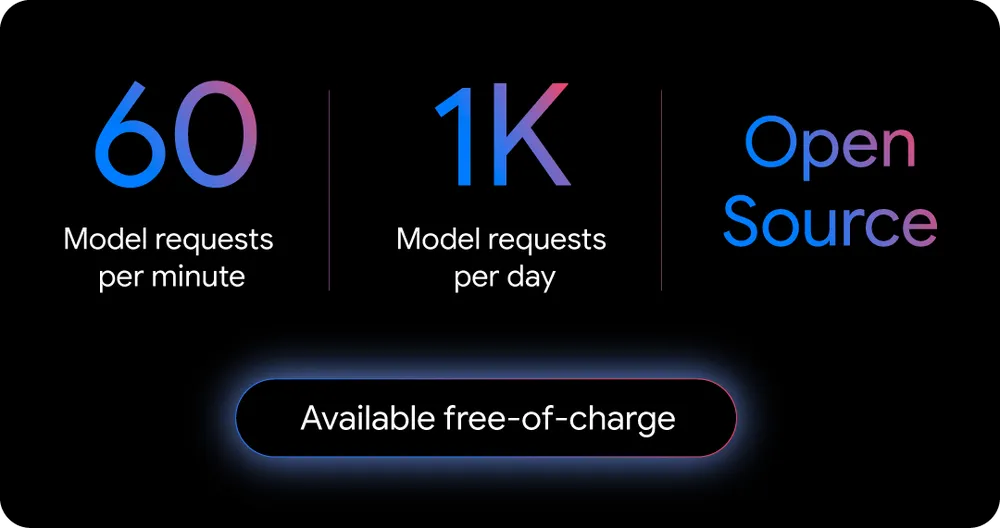

Veo 3, actuellement en aperçu public, est le dernier modèle de génération vidéo de Google. Capable de créer non seulement des séquences visuelles ultra-réalistes mais aussi des pistes sonores (bruits, musiques, voix), il intègre une simulation des mouvements basée sur des lois physiques réalistes.

Mais attention : Veo 3 n’est pas encore ce qu’on appelle un modèle monde (world model). Il génère des vidéos passivement, sans interaction, à la différence des simulateurs actifs capables de réagir en temps réel aux actions d’un utilisateur.

La distinction est cruciale. Un générateur vidéo, comme Veo 3, crée des séquences à partir de requêtes textuelles ou visuelles. Un modèle monde, lui, simule dynamiquement un environnement, permettant à un agent (ou à un joueur) de tester des actions et en observer les conséquences, en temps réel.

C’est le principe des moteurs de jeu, mais poussé à l’extrême par l’IA : l’environnement n’est plus codé à la main, il est généré et animé par un réseau de neurones.

Google mise gros sur les mondes simulés

Google ne cache plus ses ambitions : faire évoluer Gemini 2.5 Pro, son modèle fondation multimodal, vers une IA capable de simuler des aspects du cerveau humain. En parallèle, DeepMind a présenté fin 2024 Genie 2, un modèle capable de générer une infinité de mondes jouables.

Depuis janvier 2025, l’entreprise a aussi formé une équipe dédiée au développement de modèles monde, orientés jeux vidéo et simulations interactives.

Vers des jeux IA hybrides : Veo + Genie ?

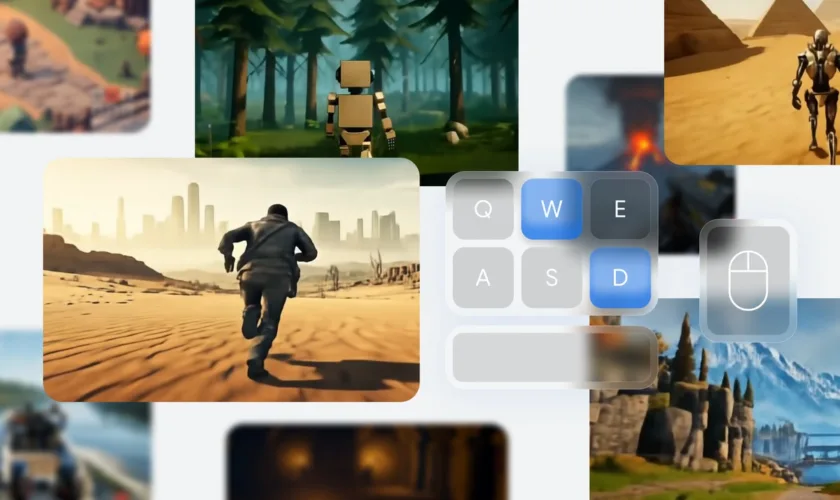

À ce stade, Veo 3 pourrait surtout servir à créer des éléments cinématiques de jeu : cutscenes, trailers, animations narratives… Mais à l’avenir, Google pourrait combiner Veo (pour l’esthétique) avec Genie (pour la logique et la jouabilité) afin de produire des expériences de jeu entièrement générées par IA.

Cela représenterait une rupture majeure dans le game design, avec des jeux créés à la volée en fonction des actions du joueur et un contenu infini, mais cohérent.

Une course technologique déjà lancée

Google n’est pas seul sur ce créneau. Microsoft, Runway, Scenario, Pika, et bien sûr OpenAI avec son très attendu modèle Sora travaillent tous sur des systèmes de génération vidéo avancée. Mais aucun n’a encore réussi à créer un modèle monde pleinement interactif, en temps réel et sans bugs.

L’expertise de DeepMind en simulation (notamment via AlphaGo, AlphaStar et MuZero), associée aux moyens colossaux de Google, place l’entreprise en pole position pour dominer le futur des jeux IA.

Les déclarations énigmatiques de Demis Hassabis et Logan Kilpatrick ouvrent la porte à une révolution vidéoludique alimentée par l’intelligence artificielle. Si Veo 3 n’est pour l’instant qu’un générateur vidéo, son intégration future avec des modèles comme Genie pourrait bien donner naissance à des mondes jouables générés en temps réel, où l’imagination du joueur serait la seule limite.

Le jeu vidéo, tel qu’on le connaît, pourrait être sur le point de basculer dans une nouvelle ère… générée par IA.