Google franchit une nouvelle étape dans la course à l’intelligence artificielle avec le lancement officiel de ses modèles Gemini 2.5 Pro et Gemini 2.5 Flash, désormais disponibles en version stable.

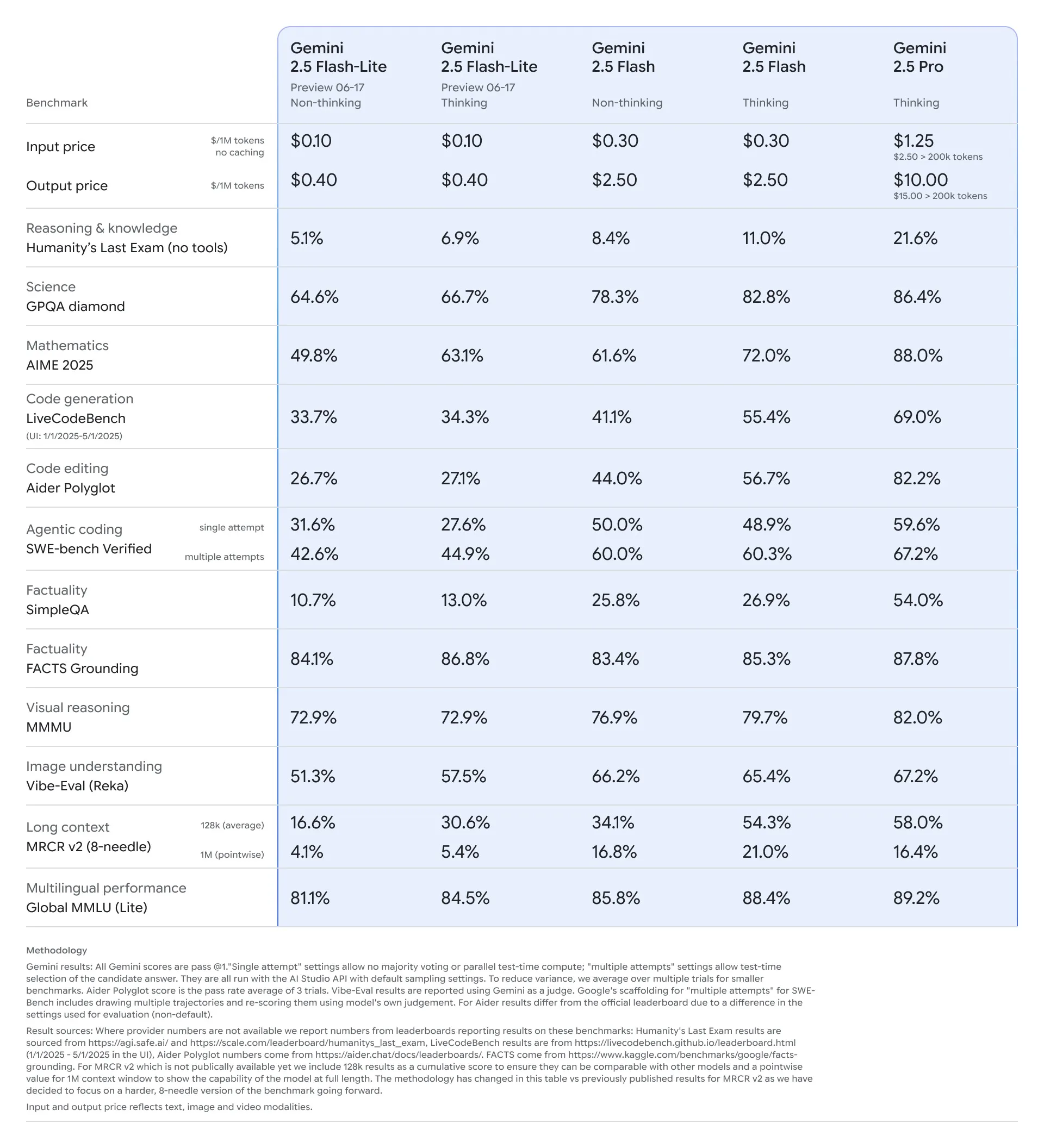

En parallèle, la firme de Mountain View dévoile Gemini 2.5 Flash-Lite, une version allégée conçue pour répondre aux besoins à haut volume tout en réduisant les coûts.

Gemini 2.5 Pro : la puissance raisonnée au service de la complexité

Le modèle Gemini 2.5 Pro est désormais généralement disponible, après une période de test et d’optimisation intense. Conçu pour les tâches complexes, telles que la résolution de problèmes mathématiques, la génération de code, l’analyse scientifique ou encore la synthèse de textes, il représente le modèle IA le plus avancé jamais proposé par Google.

Bien que les utilisateurs gratuits y aient accès avec certaines limitations, les abonnés Pro peuvent utiliser jusqu’à 100 prompts par jour, tandis que les clients AI Ultra bénéficient d’un accès complet. Gemini 2.5 Pro est disponible via Google AI Studio, Vertex AI ou l’application Gemini sur mobile.

Gemini 2.5 Flash : pour des réponses ultra-rapides

Plus léger, mais toujours performant, Gemini 2.5 Flash se distingue par sa rapidité de traitement, idéale pour les tâches quotidiennes. Cette version est également disponible en version stable (build 04–17) et propose des temps de réponse optimisés pour les utilisateurs ayant besoin de résultats immédiats.

Avec son coût réduit et sa flexibilité, Flash cible particulièrement les développeurs ou entreprises souhaitant intégrer l’IA dans leurs services tout en maîtrisant leur budget.

Gemini 2.5 Flash-Lite : l’IA à faible coût pour les gros volumes

En preview, Gemini 2.5 Flash-Lite s’adresse aux environnements nécessitant une grande scalabilité. Google le présente comme son modèle le plus rapide et le plus économique à ce jour. Il est jusqu’à trois fois moins coûteux que Flash pour les entrées (texte, image, vidéo) et six fois moins cher pour les sorties en tokens.

Bien qu’il soit moins performant pour des tâches complexes, Flash-Lite s’avère idéal pour la traduction, la classification de texte ou les usages simples à très forte fréquence.

Une IA pensée pour tous les cas d’usage

Tous les modèles Gemini 2.5 partagent des fonctionnalités avancées : prise en charge multimodale, budgets de raisonnement ajustables, support de jusqu’à un million de tokens, et intégration avec des outils comme Google Search, l’exécution de code ou encore l’environnement Vertex AI.

Ils sont déjà utilisés par des entreprises comme Snap, SmartBear ou Spline, et s’intègrent progressivement dans les produits Google, notamment dans Search, où Flash et Flash-Lite sont activés dans les réponses générées par IA.

Google muscle sa gamme IA avec Gemini 2.5

Avec ces lancements, Google consolide son offre d’intelligence artificielle face à OpenAI et Microsoft. En multipliant les modèles adaptés à différents besoins — des tâches intensives à l’ultra-économie —, le géant californien veut rendre l’IA accessible à tous, tout en gardant une longueur d’avance sur la performance et la flexibilité.

Les utilisateurs professionnels et développeurs peuvent d’ores et déjà intégrer Gemini 2.5 Pro, Flash ou Flash-Lite dans leurs projets. Et pour les particuliers, l’IA Gemini continue d’évoluer dans l’application mobile avec des fonctionnalités toujours plus riches et intelligentes.