C’est la fin d’un chapitre pour Sunshine, la startup de logiciels grand public cofondée par Marissa Mayer. Sept ans après son lancement, l’ancienne patronne de Yahoo tourne la page et transfère les actifs de l’entreprise à une nouvelle structure baptisée Dazzle, dédiée à l’intelligence artificielle.

Sunshine: une ambition, des obstacles, puis une transition

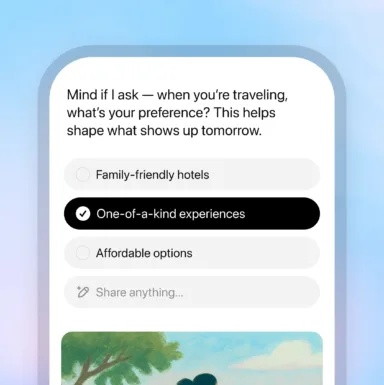

Fondée en 2018 sous le nom Lumi Labs, Sunshine promettait de simplifier la gestion des contacts et d’automatiser les tâches quotidiennes. Malgré l’aura de Mayer — ancienne ingénieure chez Google et figure incontournable de la Silicon Valley — l’entreprise n’a jamais réellement trouvé son public.

Manque d’adoption, repositionnements produits, marché saturé… Sunshine a connu un parcours qualifié de « chaotique » par plusieurs observateurs du secteur.

De Sunshine à Dazzle : une vente validée par les actionnaires

D’après TechCrunch, le transfert des actifs vers Dazzle est soumis à l’approbation des investisseurs… mais celle-ci serait déjà acquise à 99 %. Parmi les parties prenantes : des fonds de capital-risque renommés, le cofondateur Enrique Muñoz Torres, et bien sûr Marissa Mayer, actionnaire majoritaire.

Dans un e-mail adressé aux actionnaires, Mayer affirme que cette décision est « la meilleure voie à suivre » pour capitaliser sur les acquis de Sunshine.

Dazzle: un nouveau départ dans l’intelligence artificielle

Dazzle, récemment incorporée par Mayer, pourrait se concentrer sur des applications IA plus avancées, destinées aux consommateurs ou aux entreprises. Elle devrait notamment tirer parti des algorithmes de gestion de contacts développés par Sunshine, mais avec une vision plus ambitieuse et tournée vers le futur.

Ce virage illustre bien la tendance actuelle : face aux difficultés du marché des startups IA — burn rates élevés, concurrence féroce — les repositionnements stratégiques deviennent la norme.

Un reflet des réalités du secteur tech

Sunshine rejoint la liste grandissante des startups prometteuses ayant peiné à décoller malgré un solide pedigree. Mayer, qui avait quitté Yahoo après avoir supervisé sa vente à Verizon en 2017, ambitionnait avec Sunshine de repenser les interactions numériques du quotidien (partage de photos, gestion d’événements…).

Mais en sept ans, le contexte a changé : la bulle IA est montée en flèche, et la marge de manœuvre pour les nouveaux entrants s’est considérablement réduite.

Quid des investisseurs ?

Les détails financiers de la transaction n’ont pas été révélés, mais cette vente permettrait de préserver la valeur des actifs accumulés par Sunshine, notamment les technologies IA développées en interne. Un choix stratégique qui évite une dissolution pure et simple, et qui pourrait donner un second souffle à ces innovations via Dazzle.

Sur les réseaux sociaux, les réactions sont partagées : certains saluent la résilience de Mayer, d’autres y voient une nouvelle illustration des pivots en série auxquels elle nous a habitués. Mais pour beaucoup, ce repositionnement montre une approche lucide de l’entrepreneuriat : savoir mettre fin à un projet quand il le faut, pour mieux rebondir ailleurs.

Leçon de persévérance ou fuite en avant ?

La fermeture de Sunshine et la naissance de Dazzle rappellent une règle immuable du monde tech : évoluer ou disparaître. Pour Marissa Mayer, cette manœuvre pourrait bien marquer un retour stratégique dans la course à l’IA, un secteur où elle espère, cette fois, transformer ses ambitions en succès durable.