Alors que OpenAI continue d’étendre l’usage de ChatGPT à l’échelle mondiale, l’entreprise explore de nouvelles sources de revenus — et la publicité n’est plus un tabou. Dans une interview accordée à The Verge, Nick Turley, responsable de ChatGPT, a évoqué la possibilité d’intégrer des publicités, tout en insistant sur la nécessité d’une approche « très réfléchie et de bon goût ».

La publicité dans ChatGPT : pas exclue, mais pas immédiate

Selon Turley, la publicité pourrait ne pas convenir à ChatGPT tel qu’il est actuellement conçu, car l’expérience utilisateur repose sur une alignement précis avec les objectifs de l’utilisateur. Toutefois, d’autres produits OpenAI à venir pourraient intégrer des formats publicitaires adaptés à leur usage.

Sam Altman, PDG d’OpenAI, a exprimé par le passé une certaine réticence : « L’idée de mélanger publicité et IA me met un peu mal à l’aise, » avait-il déclaré à Harvard en 2024.

Mais il a récemment tempéré sa position, affirmant en juin 2025 dans un podcast qu’il n’était « pas entièrement opposé » à la publicité, si elle est bien encadrée.

Croissance explosive, mais rentabilité encore lointaine

Malgré un succès phénoménal, OpenAI n’est pas encore rentable. D’après Bloomberg, l’entreprise devrait générer 12,7 milliards de dollars de revenus en 2025, contre 3,7 milliards en 2024. Pourtant, elle ne prévoit pas de flux de trésorerie positif avant 2029.

Quelques chiffres clés :

- 700 millions d’utilisateurs au total

- 20 millions d’abonnés payants (avril 2025)

- La majorité des utilisateurs restent sur la version gratuite

Turley y voit une opportunité de conversion vers des abonnements premium.

« Commerce in ChatGPT » : vers la recommandation de produits

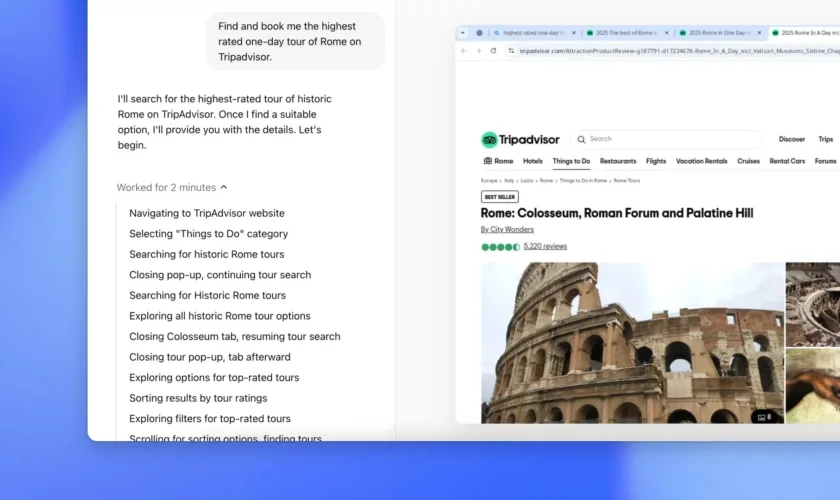

OpenAI teste actuellement une nouvelle fonctionnalité de monétisation nommée « Commerce in ChatGPT ». L’objectif ? Permettre à l’IA de suggérer des produits, avec une commission potentielle à la clé. Turley insiste : « Nous ne voulons pas que des revenus d’affiliation influencent les recommandations ».

Le système devra donc rester objectif et indépendant, sous peine de perdre la confiance des utilisateurs.

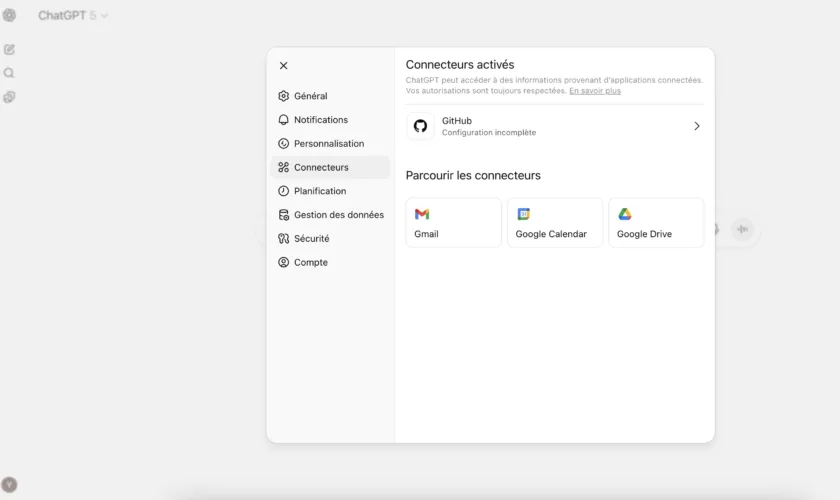

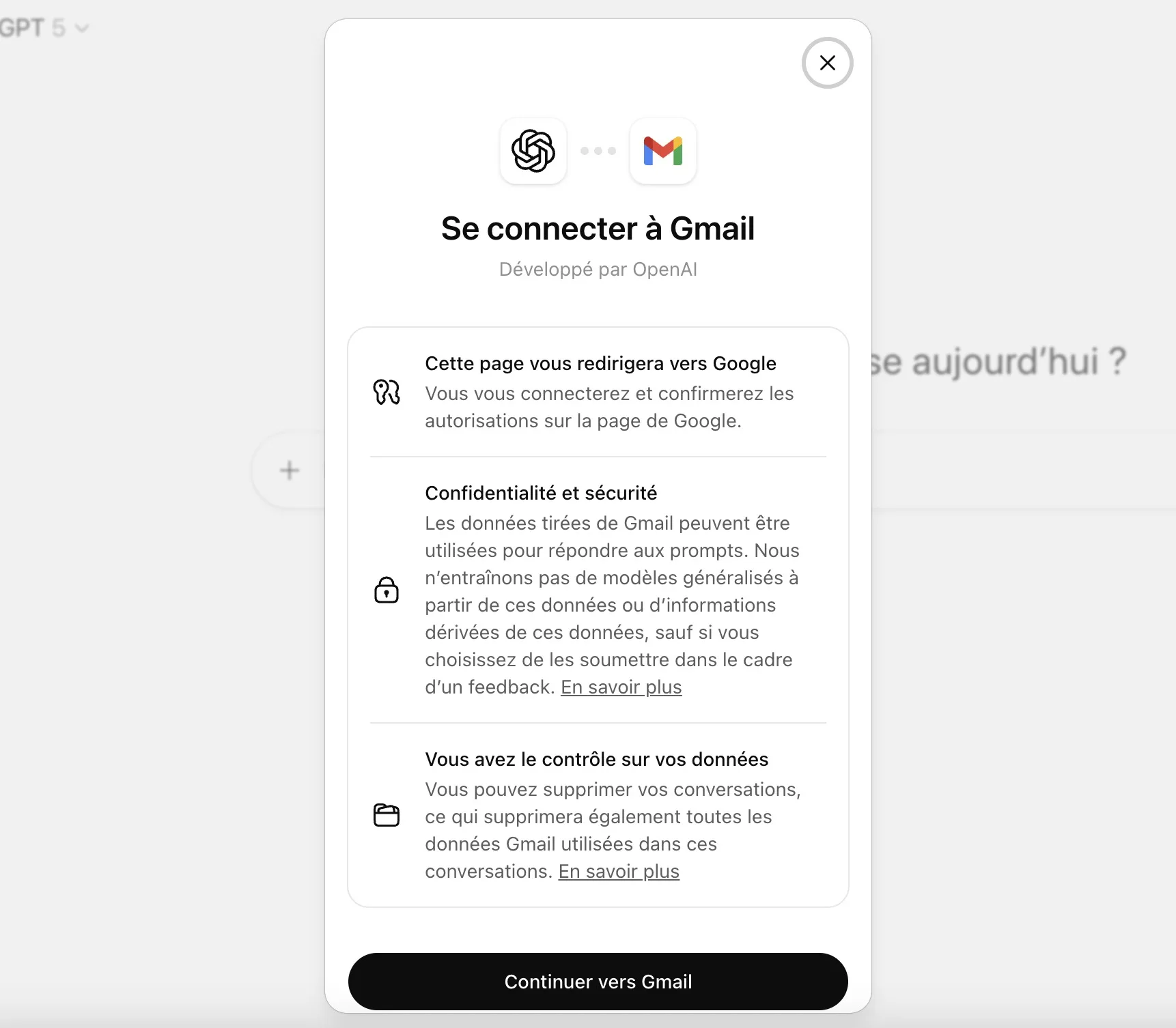

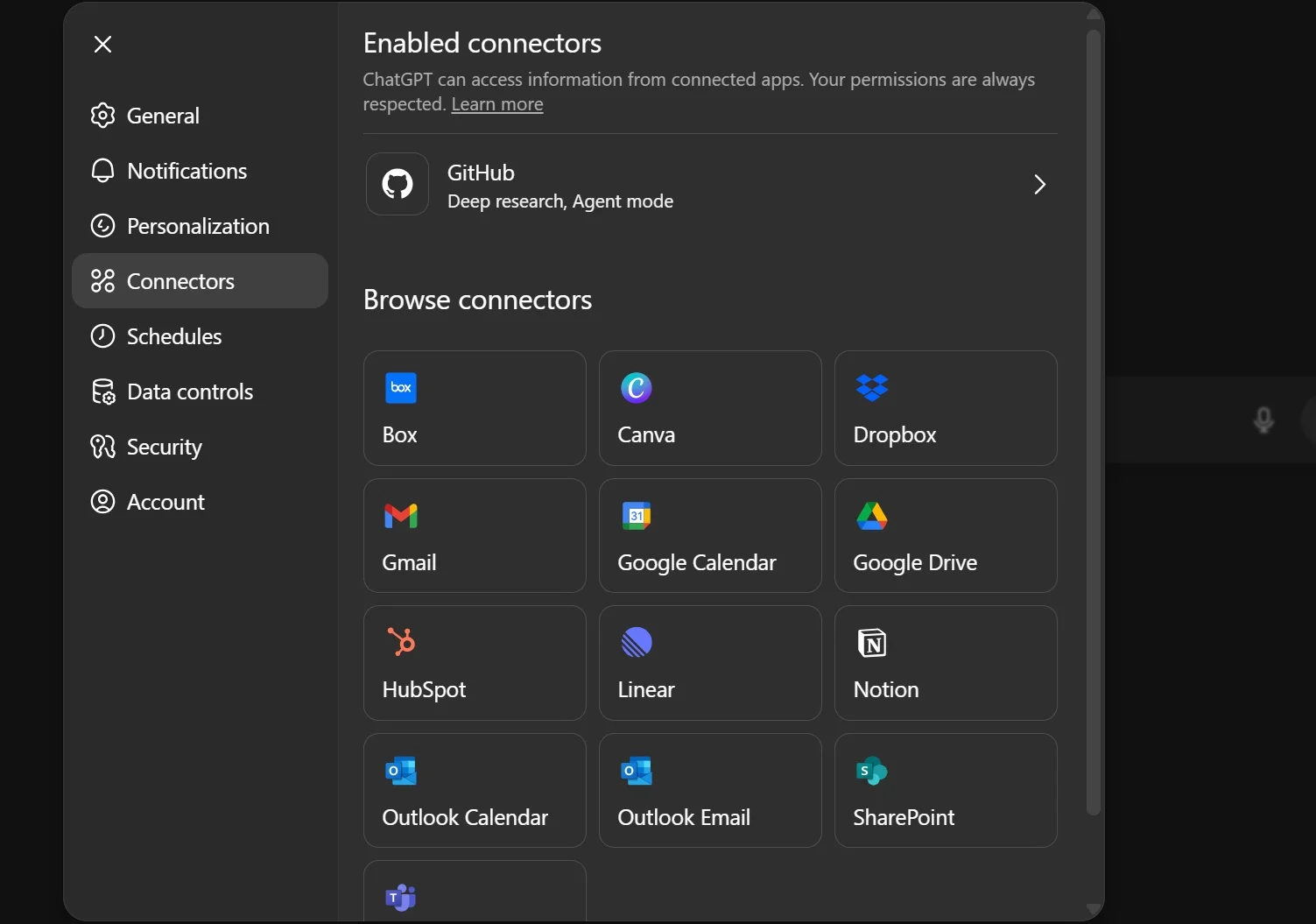

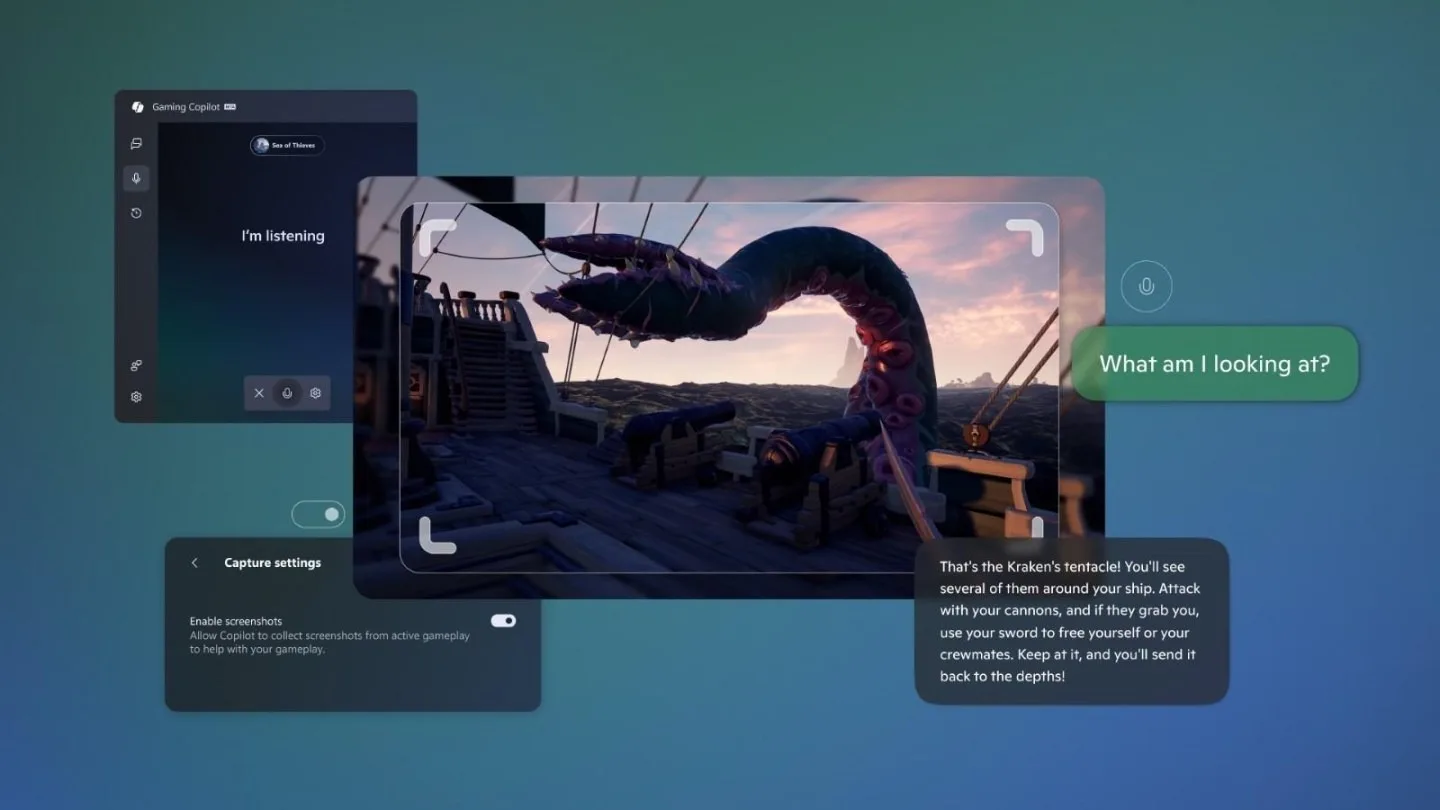

OpenAI explore aussi des formes d’outils plus intégrés, au-delà du simple chatbot. Turley évoque la possibilité que ChatGPT devienne un assistant de productivité, voire un outil B2B, avec des modèles économiques spécifiques.

Alors que l’écosystème de l’IA se structure à vitesse grand V, OpenAI semble vouloir diversifier ses sources de revenus sans nuire à l’expérience utilisateur. Si la publicité devait arriver dans ChatGPT, elle le fera avec précaution… mais elle n’est désormais plus exclue.