OpenAI continue son expansion agressive dans le domaine de l’intelligence artificielle. OpenAI a annoncé le rachat de Statsig, une plateforme d’expérimentation spécialisée dans l’A/B testing et le feature flagging, pour un montant estimé à 1,1 milliard de dollars.

En parallèle, plusieurs changements majeurs sont opérés au sein de sa direction, confirmant une stratégie d’accélération et de diversification.

Statsig, un renfort stratégique pour OpenAI

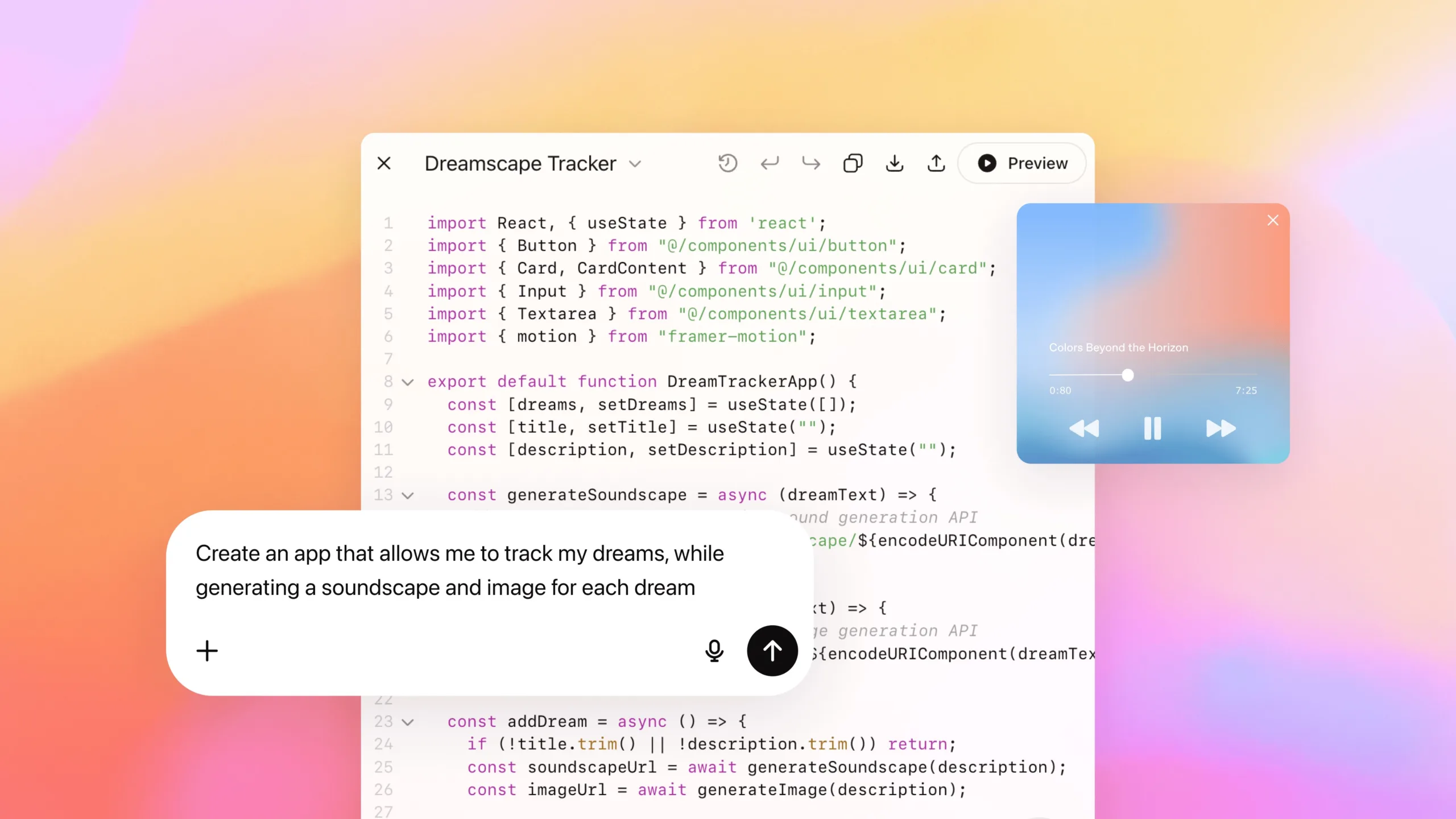

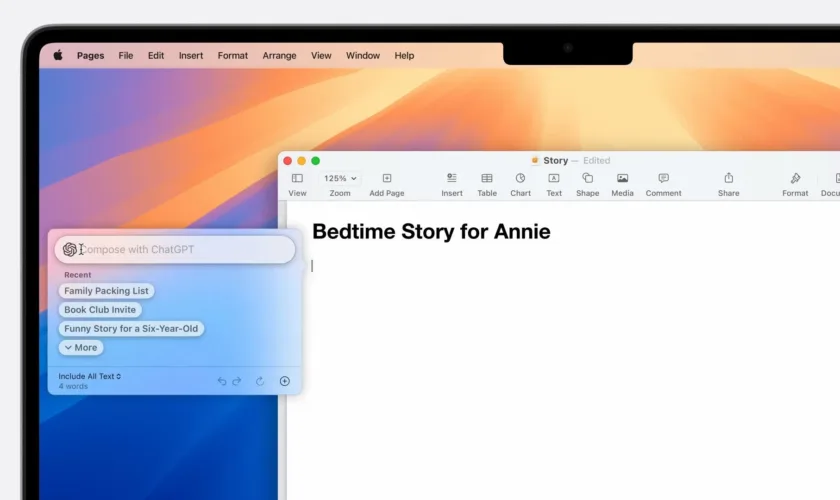

Fondée en 2021 par Vijaye Raji, ancien ingénieur de Facebook, Statsig s’est imposée comme une référence dans l’optimisation produit. Ses outils permettront à OpenAI d’accélérer l’expérimentation et le déploiement de nouvelles fonctionnalités, d’optimiser la performance de ses modèles, comme GPT-5, et de renforcer ses capacités en analytique produit pour ChatGPT, Codex et les API développeurs.

Vijaye Raji rejoint OpenAI en tant que CTO of Applications, sous la responsabilité directe de Fidji Simo, ancienne PDG d’Instacart, désormais CEO des Applications chez OpenAI.

L’entreprise précise que Statsig conservera son bureau de Seattle et continuera à servir ses clients existants, tout en intégrant progressivement les projets d’OpenAI.

Réorganisation interne : de nouveaux rôles stratégiques

En parallèle de cette acquisition, OpenAI a officialisé plusieurs nominations clés :

- Srinivas Narayanan, ancien responsable de l’ingénierie, devient CTO of B2B Applications. Il pilotera toutes les applications à destination des entreprises, startups et gouvernements, sous la supervision du COO Brad Lightcap.

- Kevin Weil, jusque-là CPO, bascule du côté recherche en tant que VP of AI for Science. Il travaillera aux côtés de Mark Chen, directeur scientifique, pour explorer l’application de l’IA à la recherche scientifique. Son ancienne équipe produit, dont Nick Turley (ChatGPT), reportera désormais à Fidji Simo.

Ces évolutions traduisent une volonté d’OpenAI de mieux séparer les pôles produits commerciaux, applications B2B et recherche scientifique, tout en renforçant son équipe de direction.

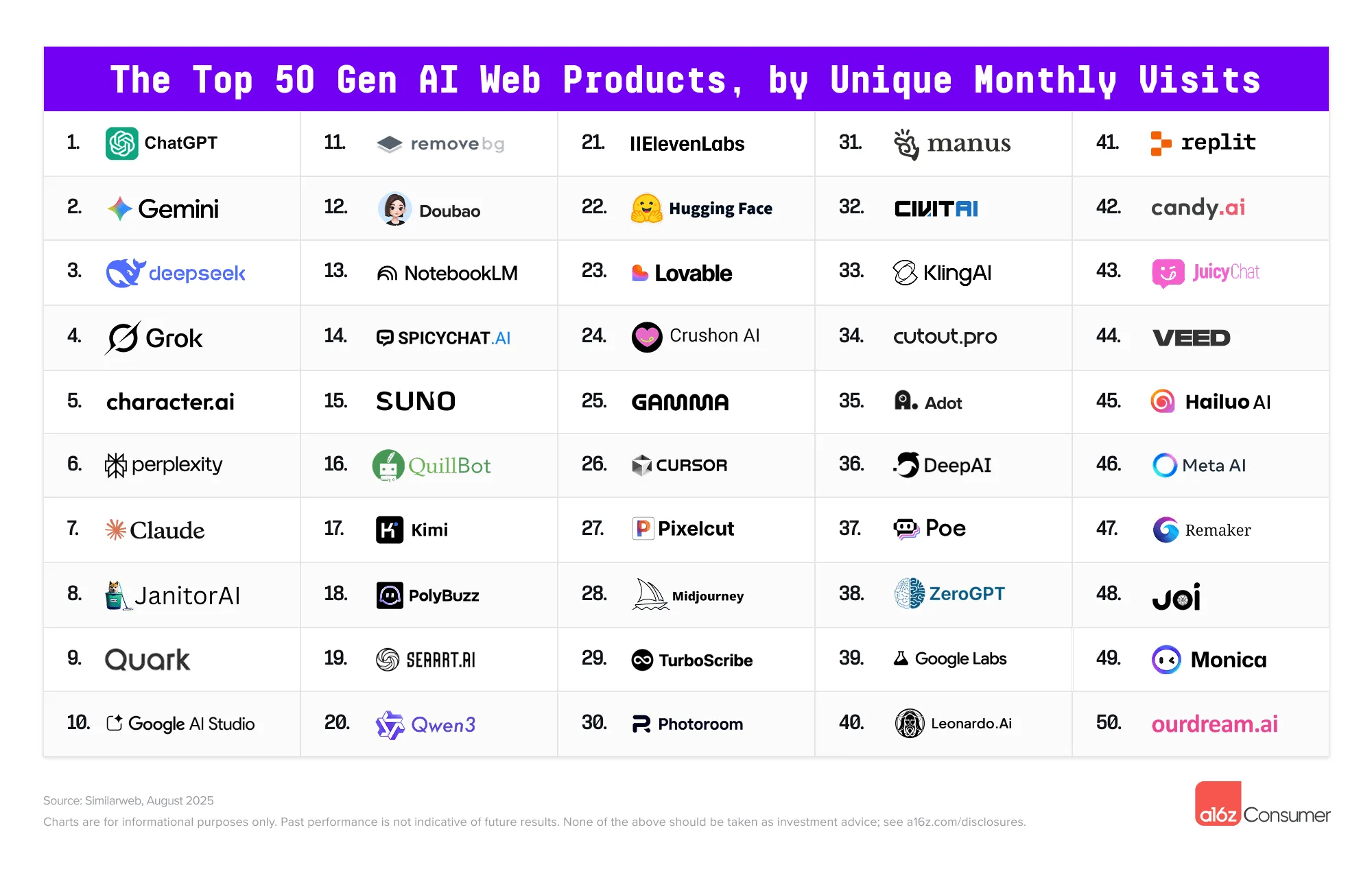

Une course à l’IA de plus en plus intense

Cette acquisition s’inscrit dans une guerre des talents et des technologies où les rachats se multiplient. OpenAI avait récemment tenté d’acquérir la startup de code IA Windsurf, mais l’opération avait échoué au profit de Google. En revanche, l’entreprise a bien réussi à absorber io Products Inc., fondée par Jony Ive, pour développer du matériel IA propriétaire.

OpenAI investit massivement pour rester en tête face à Google, Meta, Anthropic ou encore xAI, dans un marché où la compétition est féroce et les valorisations parfois qualifiées de « bulle » par Sam Altman lui-même.

OpenAI muscle ses applications et prépare l’avenir

Avec le rachat de Statsig et la montée en puissance de profils expérimentés comme Fidji Simo et Vijaye Raji, OpenAI confirme sa volonté de structurer ses activités autour de pôles complémentaires : recherche, applications B2C (ChatGPT), applications B2B et infrastructure.

Si l’intégration réussit, l’entreprise pourrait accélérer le rythme d’innovation de ses produits phares tout en renforçant sa compétitivité face aux autres géants de la tech.