Plusieurs investisseurs ont remis des chèques importants à des startups pour profiter de ce qui a attiré l’attention de la Silicon Valley au cours de l’année écoulée : la course à la création d’une IA plus importante et de meilleure qualité s’est intensifiée.

Aujourd’hui, la start-up d’intelligence artificielle xAI de l’entrepreneur milliardaire Elon Musk est en pourparlers pour lever jusqu’à 6 milliards de dollars.

La start-up cherche à obtenir de l’argent auprès de riches fonds de placement au Moyen-Orient et a eu des discussions avec des bureaux familiaux à Hong Kong, selon un article de Reuters qui cite plusieurs personnes ayant connaissance de la situation.

Pour cette nouvelle levée de fonds, Elon Musk a également contacté des investisseurs en Corée du Sud et au Japon, bien que son bureau n’ait pas répondu à une demande de commentaire.

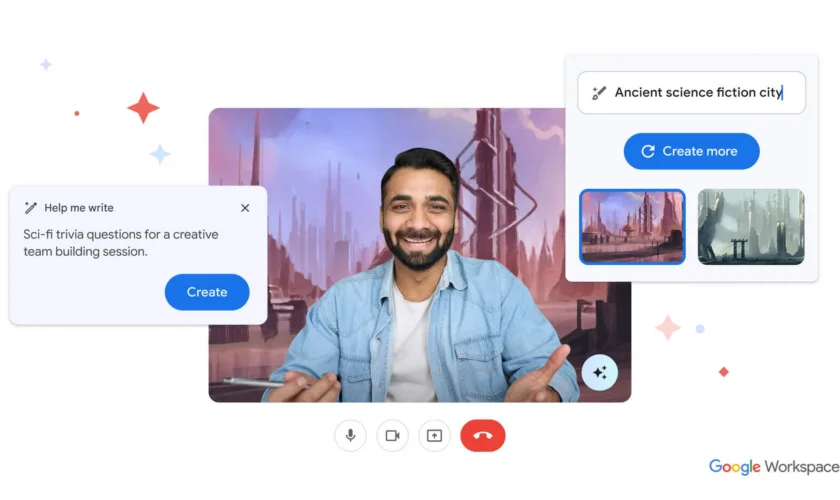

Elon Musk n’a jamais caché son intention de construire une IA plus sûre. xAI a fait les gros titres l’année dernière lors de la présentation de « Grok », un chatbot qui se positionne comme un adversaire du ChatGPT d’OpenAI. Musk a souvent souligné l’importance de développer l’IA de manière responsable. Il a récemment mis en garde contre le développement de la robotique et de l’intelligence artificielle (IA) en dehors de Tesla jusqu’à ce qu’il ait acquis plus d’influence sur les décisions de l’entreprise. Musk a exprimé son inquiétude quant à la possibilité de diriger Tesla vers l’intelligence artificielle sans avoir obtenu 25 % des voix.

La puissance de l’IA

Pour la petite histoire, OpenAI, la société derrière ChatGPT, a été fondée et établie en 2015 à San Francisco par Elon Musk (Tesla, X, xAI), Llya Sutskever, Wojciech Azremba, Greg Brockman et l’actuel PDG de ChatGPT, Sam Altman. Musk a quitté OpenAI en 2018, invoquant un conflit d’intérêts avec l’IA dans son entreprise Tesla. En juillet 2023, Musk a déclaré que xAI chercherait à « comprendre la véritable nature de l’univers ». Depuis qu’il a quitté OpenAI, Musk n’a cessé de prononcer des discours et de prôner la prudence dans l’innovation en matière d’IA.

Les startups ont connu un marché morose pendant un certain temps, mais grâce à l’IA et à ses points forts tels que ChatGPT, de nombreuses startups dans ce domaine bénéficient d’un excellent environnement de financement.