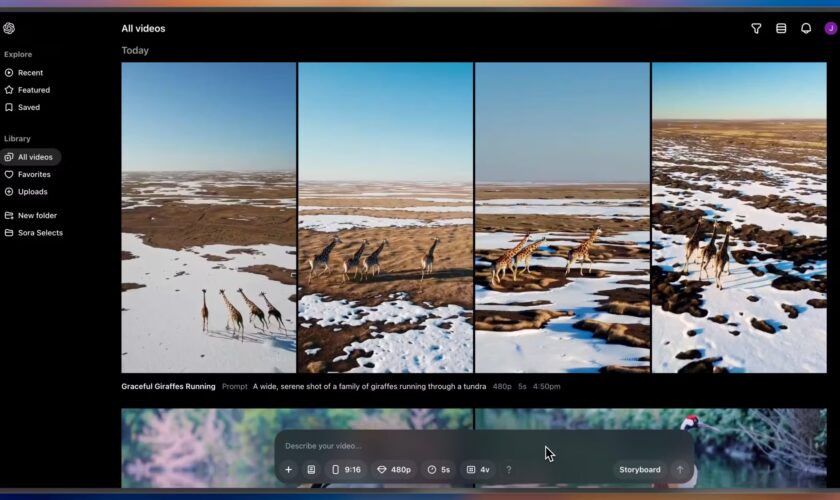

Dans le cadre de son événement « 12 Days of OpenAI », également surnommé « ship-mas », OpenAI a officiellement lancé Sora, son modèle avancé de génération vidéo par IA.

Disponible dès aujourd’hui sur sora.com pour les abonnés ChatGPT Plus et Pro aux États-Unis et dans de nombreux pays, ce lancement marque une étape majeure dans l’innovation text-to-video.

Sora Turbo : des fonctionnalités avancées pour des créations IA riches

La version améliorée, appelée Sora Turbo, ajoute plusieurs fonctionnalités puissantes :

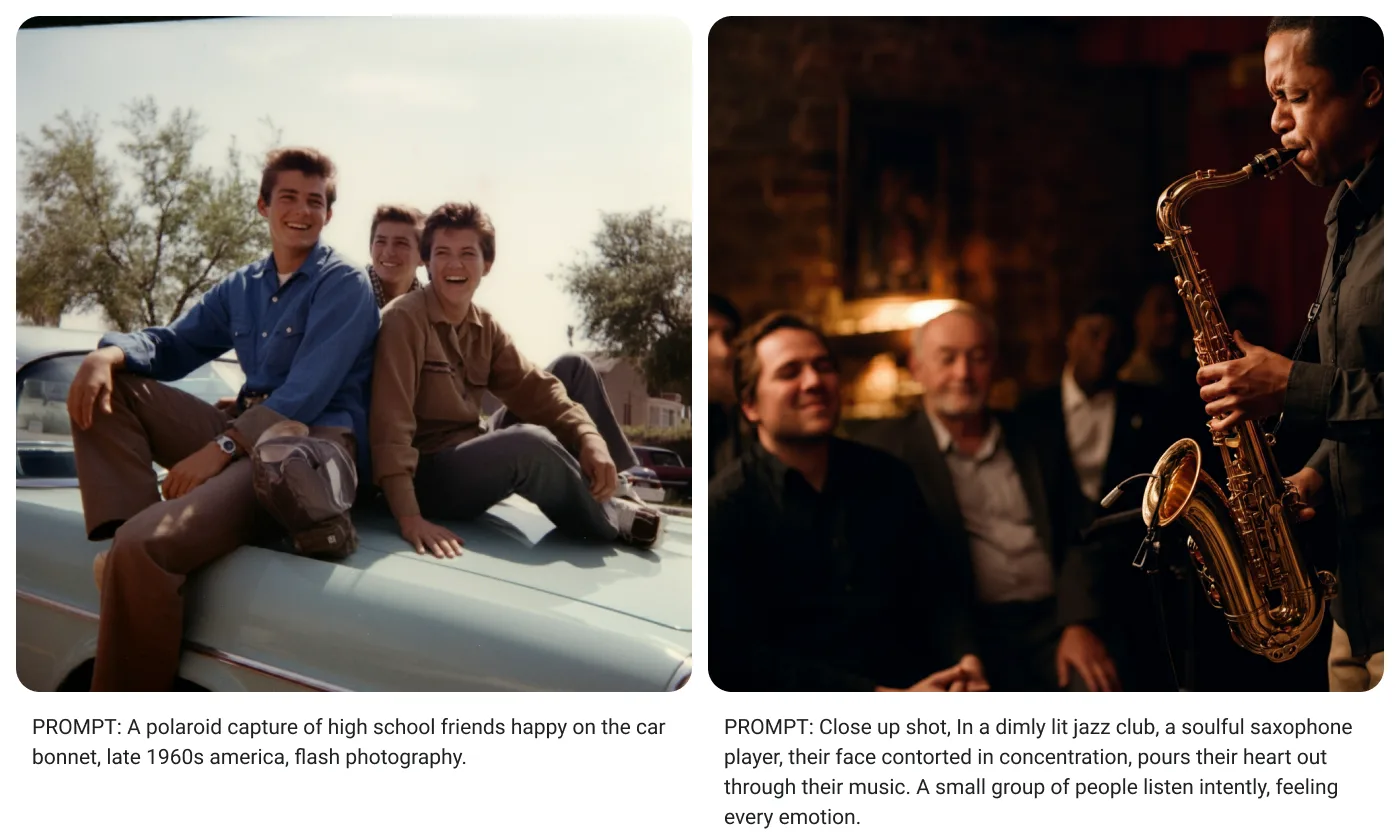

- Génération vidéo à partir de texte : Créez des clips vidéo à partir de descriptions textuelles.

- Animation d’images : Transformez des photos en vidéos animées.

- Remix vidéo : Modifiez les résultats générés par Sora avec des invites textuelles ou fusionnez des scènes en utilisant l’intelligence artificielle.

Capacités des abonnements ChatGPT

1. Abonnement Plus (20 dollars/mois)

- Génération jusqu’à 50 vidéos prioritaires (1 000 crédits).

- Résolutions allant jusqu’à 720p.

- Durée des vidéos limitée à 5 secondes.

2. Abonnement Pro (200 dollars/mois)

- Générations illimitées avec jusqu’à 500 vidéos prioritaires.

- Résolutions jusqu’à 1080p.

- Durées vidéo étendues à 20 secondes.

- Téléchargements sans watermark.

- Jusqu’à cinq générations simultanées pour des projets plus intensifs.

Des outils interactifs pour libérer la créativité

Page Explore

Une nouvelle page Explore permet aux utilisateurs de parcourir un flux de vidéos générées par d’autres membres de la communauté Sora. Ce partage vise à inspirer les créateurs et à montrer l’étendue des possibilités du modèle.

Storyboards et remix

- Mode Storyboards : Génération de vidéos à partir d’une séquence de prompts textuels, avec des transitions fluides entre les scènes.

- Outil Remix : Ajustez les vidéos générées en affinant les résultats avec de nouvelles instructions textuelles.

- Fonction Blend : Fusionnez deux scènes pour une transition harmonieuse, idéale pour les narrations complexes.

Transparence et modération : une approche prudente

Toutes les vidéos générées via Sora incluront des watermarks visibles et des métadonnées C2PA pour indiquer leur origine IA. Lors du téléchargement de médias (images ou vidéos), les utilisateurs doivent accepter des conditions strictes :

- Aucune personne mineure, contenu explicite ou matériel protégé par des droits d’auteur.

- Les abus peuvent entraîner la suspension ou le bannissement du compte.

Aditya Ramesh, vice-président de la recherche chez OpenAI, a reconnu l’importance d’une modération équilibrée : « Nous avons un grand défi à relever, car nous voulons empêcher les abus tout en permettant une expression créative. Nous débutons avec prudence, mais nous sommes ouverts aux retours pour nous améliorer ».

Limitations géographiques

Si Sora est disponible aujourd’hui aux États-Unis et dans de nombreux autres pays, l’Europe et le Royaume-Uni devront attendre. Selon Sam Altman, PDG d’OpenAI, cela pourrait prendre un certain temps avant que le modèle ne soit lancé dans ces régions en raison de réglementations spécifiques.

Une semaine avant le lancement, des artistes participant au programme alpha de Sora ont diffusé le modèle en ligne en signe de protestation contre ce qu’ils ont qualifié de travail non rémunéré pour la R&D et le marketing d’OpenAI.

Avec Sora, OpenAI redéfinit la création vidéo par IA en offrant des outils puissants et accessibles pour les créateurs. Malgré ses limitations géographiques et techniques initiales, l’intégration de fonctionnalités comme le remix, les storyboards et l’animation d’images ouvre de nouvelles possibilités créatives.

Cependant, les défis de modération, la concurrence accrue et les critiques sur le programme de testeurs alpha rappellent qu’OpenAI doit encore affiner son approche pour garantir un succès durable. Pour l’instant, Sora Turbo pose les bases d’une innovation qui pourrait transformer la vidéo générée par IA.