La start-up spécialisée dans l’intelligence artificielle, Anthropic, vient de dévoiler deux nouvelles fonctionnalités ambitieuses pour son assistant Claude : Integrations, une méthode pour connecter Claude à des outils tiers, et Advanced Research, une capacité de recherche approfondie désormais étendue.

Ces ajouts sont dès à présent disponibles en bêta pour les abonnés aux formules Claude Max, Team, Enterprise, et bientôt Claude Pro.

Integrations: connectez vos applications directement à Claude

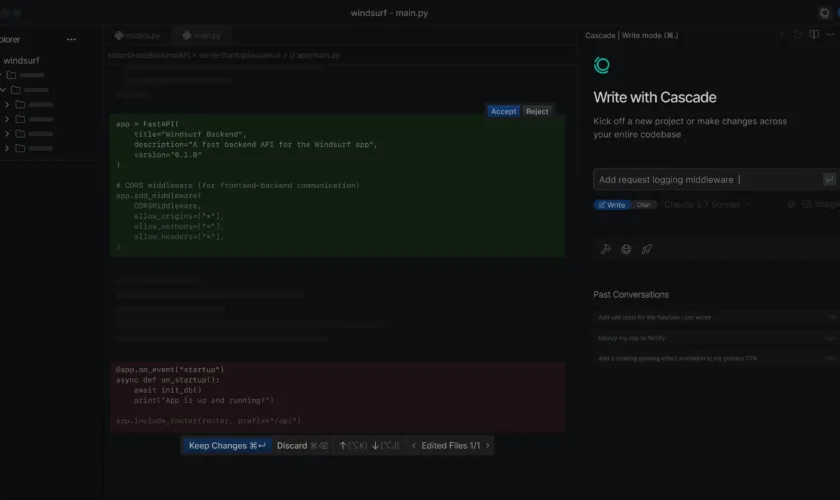

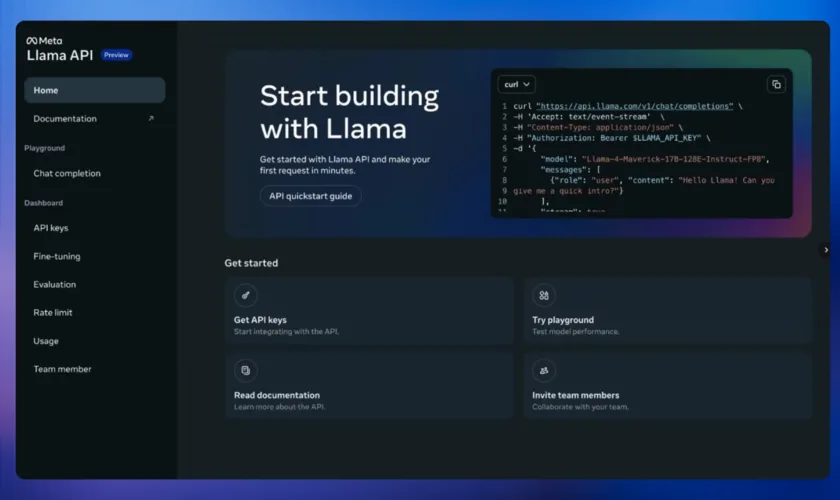

La fonctionnalité Integrations s’appuie sur le protocole MCP développé par Anthropic, qui permet à Claude d’interagir avec des données issues de logiciels métier, de plateformes de développement et de bibliothèques de contenus.

Grâce à cette infrastructure, les développeurs peuvent créer des serveurs d’applications personnalisés, que Claude peut explorer et connecter à sa logique conversationnelle.

Selon Anthropic, cette capacité permet à Claude d’obtenir un contexte profond sur votre environnement de travail : historiques de projets, états de tâches, ou encore accès à des données organisationnelles confidentielles. En pratique, cela permet à Claude non seulement de comprendre, mais aussi d’agir sur des outils professionnels.

Exemples d’intégrations disponibles :

- Atlassian : création et résumé automatique de pages dans Confluence

- Zapier : exécution de workflows automatisés entre applications

- Cloudflare, Intercom, Square, PayPal, entre autres partenaires

Advanced Research: une IA qui explore en profondeur

La seconde nouveauté, Advanced Research, permet à Claude de réaliser des recherches complexes sur des sujets, en explorant des centaines de sources internes et externes pour livrer un rapport structuré et documenté.

Cette fonction est activable via le bouton « Research », et permet à Claude de découper une requête complexe en sous-problèmes, qu’il analyse un à un avant de synthétiser une réponse globale. Les résultats sont disponibles entre 5 et 45 minutes, selon la complexité du sujet, et sont toujours accompagnés de sources et de citations claires.

Advanced Research peut s’appuyer sur :

- Les connecteurs MCP

- Les disques locaux de l’utilisateur via l’app Claude Desktop (macOS, Windows)

- Les données issues des nouvelles Integrations connectées

Une réponse à Gemini, ChatGPT et Grok

Cette offensive d’Anthropic s’inscrit dans un contexte de concurrence intense entre les géants de l’IA générative. Google (avec Gemini), Microsoft (avec Copilot) et xAI (avec Grok) proposent déjà des outils de recherche poussée, alimentés par des modèles dits « de raisonnement », capables de structurer une pensée complexe et de vérifier leurs sources.

Jusqu’ici, l’outil Research de Claude était rapide, mais restait en surface sur les sujets. Avec Advanced Research, Anthropic franchit un cap en apportant profondeur, fiabilité, et connectivité aux réponses de Claude, tout en conservant une logique d’explicabilité chère à ses concepteurs.

Objectifs de croissance ambitieux

Anthropic vise un chiffre d’affaires de 34,5 milliards de dollars d’ici 2027, mais son revenu annualisé n’était encore que de 1,4 milliard début mars. Avec des fonctionnalités aussi poussées que celles dévoilées aujourd’hui, la start-up espère accélérer son adoption en entreprise, un secteur-clé pour son développement.

Avec Integrations et Advanced Research, Anthropic dote Claude de capacités avancées qui le positionnent en véritable assistant professionnel connecté, capable d’interagir avec des écosystèmes logiciels et d’effectuer des recherches complexes avec rigueur et efficacité. Un pas décisif pour rester dans la course face à OpenAI et Google.