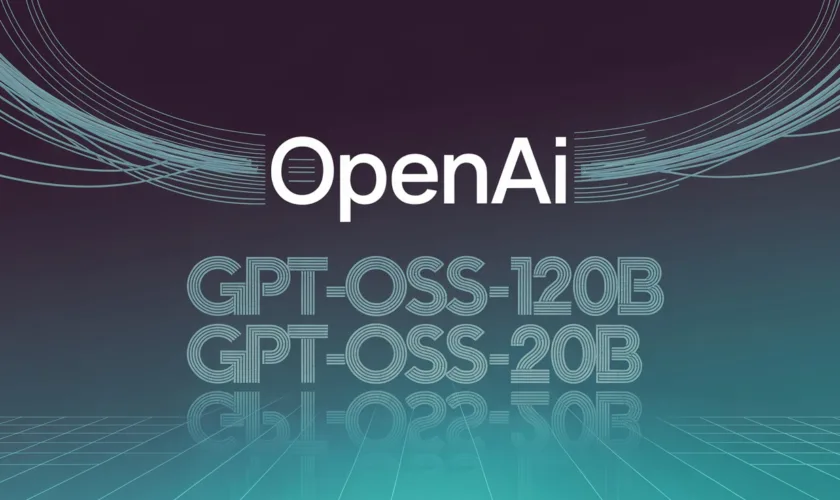

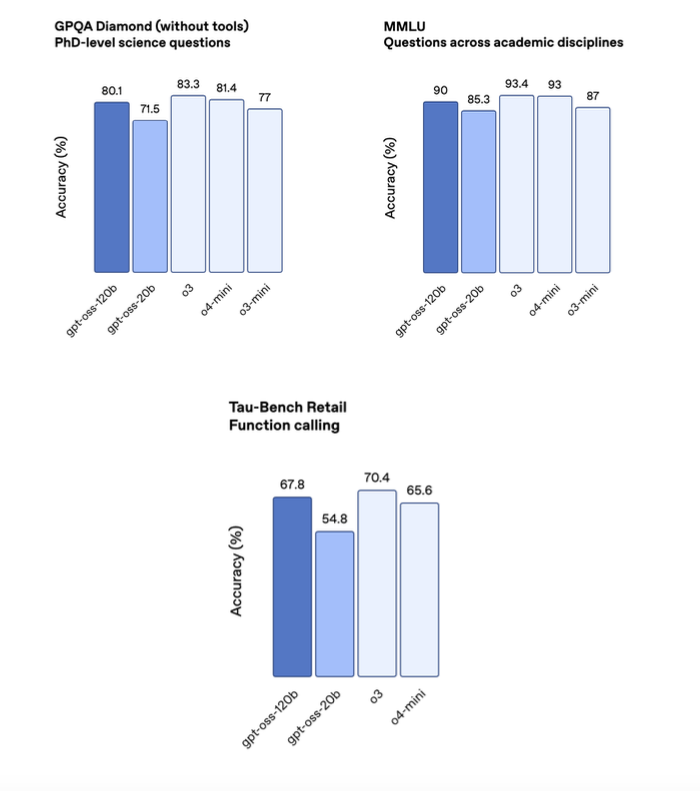

OpenAI a récemment créé la surprise en annonçant la sortie d’un nouveau modèle GPT open source, baptisé gpt-oss-20b, capable de fonctionner en local.

Et, Microsoft ne s’est pas fait attendre : le géant de Redmond intègre déjà ce modèle dans son Windows AI Foundry, facilitant ainsi son déploiement pour les utilisateurs de Windows, avec une prise en charge prévue prochainement sur macOS.

gpt-oss-20b : un modèle léger, mais puissant, pensé pour l’exécution locale

Contrairement aux modèles propriétaires d’OpenAI comme GPT-4, gpt-oss-20b est gratuit, open source, et spécialement optimisé pour les ordinateurs personnels. Il est destiné principalement à des tâches d’exécution de code, d’assistance autonome et d’intégration dans des workflows réels, y compris dans des environnements à bande passante limitée.

Selon Microsoft, ce modèle est idéal pour les développeurs qui souhaitent intégrer de l’IA dans des systèmes sans dépendre du cloud. Cela ouvre la voie à une nouvelle génération d’agents IA locaux, exécutables en toute autonomie sur des machines puissantes.

Une configuration musclée requise

Même si gpt-oss-20best allégé comparé à d’autres modèles LLM, son exécution locale demande un PC avec au moins 16 Go de VRAM. Cela signifie qu’il faudra s’équiper d’une carte graphique performante, comme une Nvidia RTX 4080 / 4090, ou certaines cartes AMD Radeon haut de gamme.

Le modèle est déjà pré-optimisé pour l’inférence locale, ce qui signifie que son déploiement est simplifié pour les développeurs et entreprises souhaitant expérimenter des applications IA sans connexion constante à Internet.

Windows AI Foundry : la plateforme qui accélère l’adoption de l’IA locale

La disponibilité de gpt-oss-20b sur Windows AI Foundry montre la volonté de Microsoft de devenir une plateforme centrale pour l’IA, en particulier l’IA localisée. Ce hub permet de télécharger, tester et déployer facilement des modèles optimisés, en supprimant les frictions habituelles liées à la configuration de LLM en local.

Microsoft a d’ailleurs laissé entendre que d’autres optimisations arriveront bientôt, notamment pour les PC Copilot+, ces nouvelles machines équipées de NPU capables d’exécuter des tâches d’IA sans consommer de ressources CPU ou GPU.

Une dynamique concurrentielle avec Amazon

Fait intéressant, Amazon a également adopté rapidement ces nouveaux modèles gpt-oss-20b dans ses services cloud, notamment via AWS. C’est la première fois que les concurrents directs de Microsoft peuvent accéder librement à un modèle OpenAI, et cela ajoute une dimension inédite au partenariat complexe entre Microsoft et OpenAI.

Rappelons que Microsoft détient des parts importantes dans OpenAI, mais que cette ouverture du modèle change la donne : l’IA générative n’est plus uniquement centralisée dans des datacenters propriétaires. Elle devient progressivement plus accessible, portable et intégrable, même sur des machines personnelles.

Vers une démocratisation de l’IA sur PC

Avec gpt-oss-20b, l’intelligence artificielle entre dans une nouvelle ère, où les utilisateurs peuvent bénéficier de puissants modèles sans dépendre du cloud. Microsoft, en intégrant rapidement ce modèle à Windows AI Foundry, s’impose comme un acteur clé de l’IA locale, tandis que la compétition avec Amazon ne fait que s’intensifier.

En parallèle, les Copilot+ PC pourraient bientôt accueillir ce type de modèle optimisé, ouvrant la voie à des assistants personnels intelligents capables de fonctionner hors ligne, de façon sécurisée et ultra-réactive.

La véritable révolution de l’IA n’est peut-être pas dans les serveurs distants… mais dans votre propre machine.