L’emblématique designer derrière les produits phares d’Apple tels que l’iPhone, Jony Ive a confirmé sa collaboration avec Sam Altman, le PDG d’OpenAI, pour le développement d’un projet d’appareil IA. Cette annonce, révélée dans le New York Times, confirme les rumeurs qui circulaient depuis près d’un an sur cette alliance potentielle entre ces deux figures majeures du monde de la technologie.

Les détails sur ce projet restent encore secrets. Jony Ive aurait rencontré Sam Altman grâce à Brian Chesky, PDG d’Airbnb, et l’entreprise est financée par Ive lui-même et l’Emerson Collective, la société de Laurene Powell Jobs.

Selon le New York Times, le projet pourrait lever jusqu’à 1 milliard de dollars de financement d’ici la fin de l’année, mais ne mentionne pas Masayoshi Son, le PDG de SoftBank, qui aurait investi 1 milliard de dollars dans le projet l’année dernière.

L’équipe, actuellement composée de seulement 10 employés, comprend Tang Tan et Evans Hankey, deux figures clés ayant travaillé avec Ive sur l’iPhone. LoveFrom, l’entreprise d’Ive, dirige la conception de l’appareil. L’équipe travaille actuellement dans un bâtiment de bureaux de près de 3 000 mètres carrés à San Francisco, faisant partie d’un ensemble immobilier de 90 millions de dollars que Ive a acquis dans un seul pâté de maisons de la ville.

Un appareil révolutionnaire grâce à l’IA générative

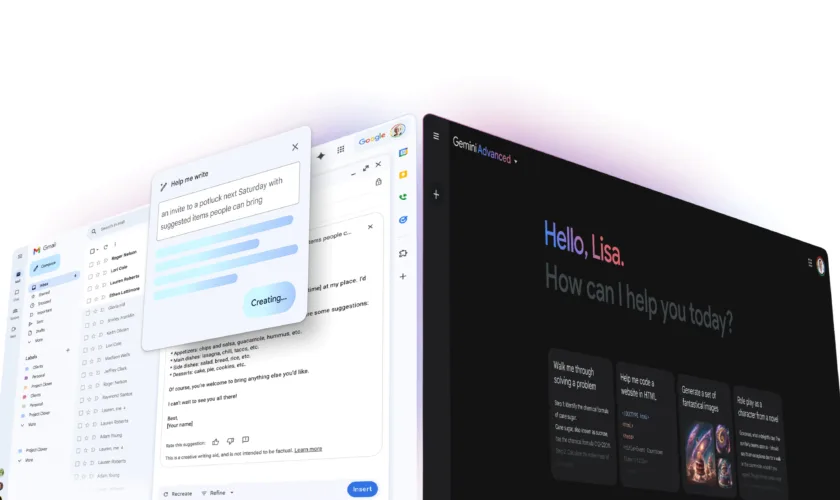

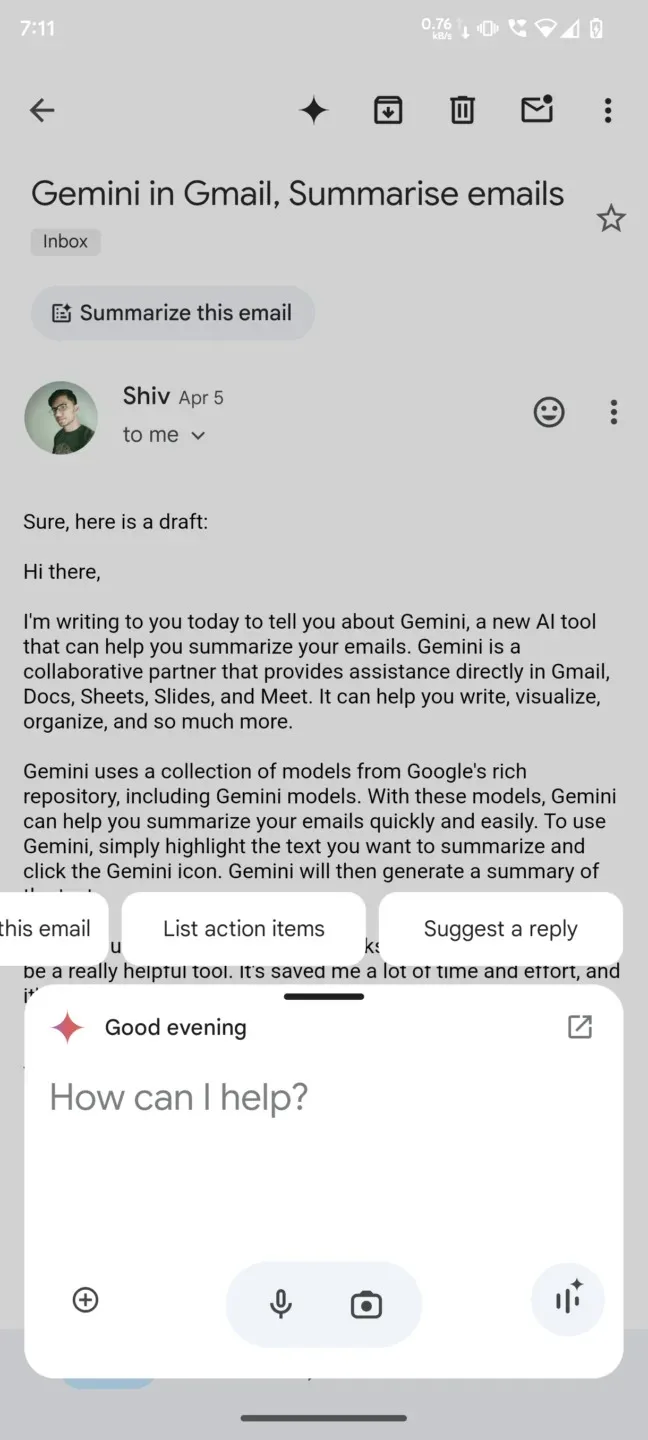

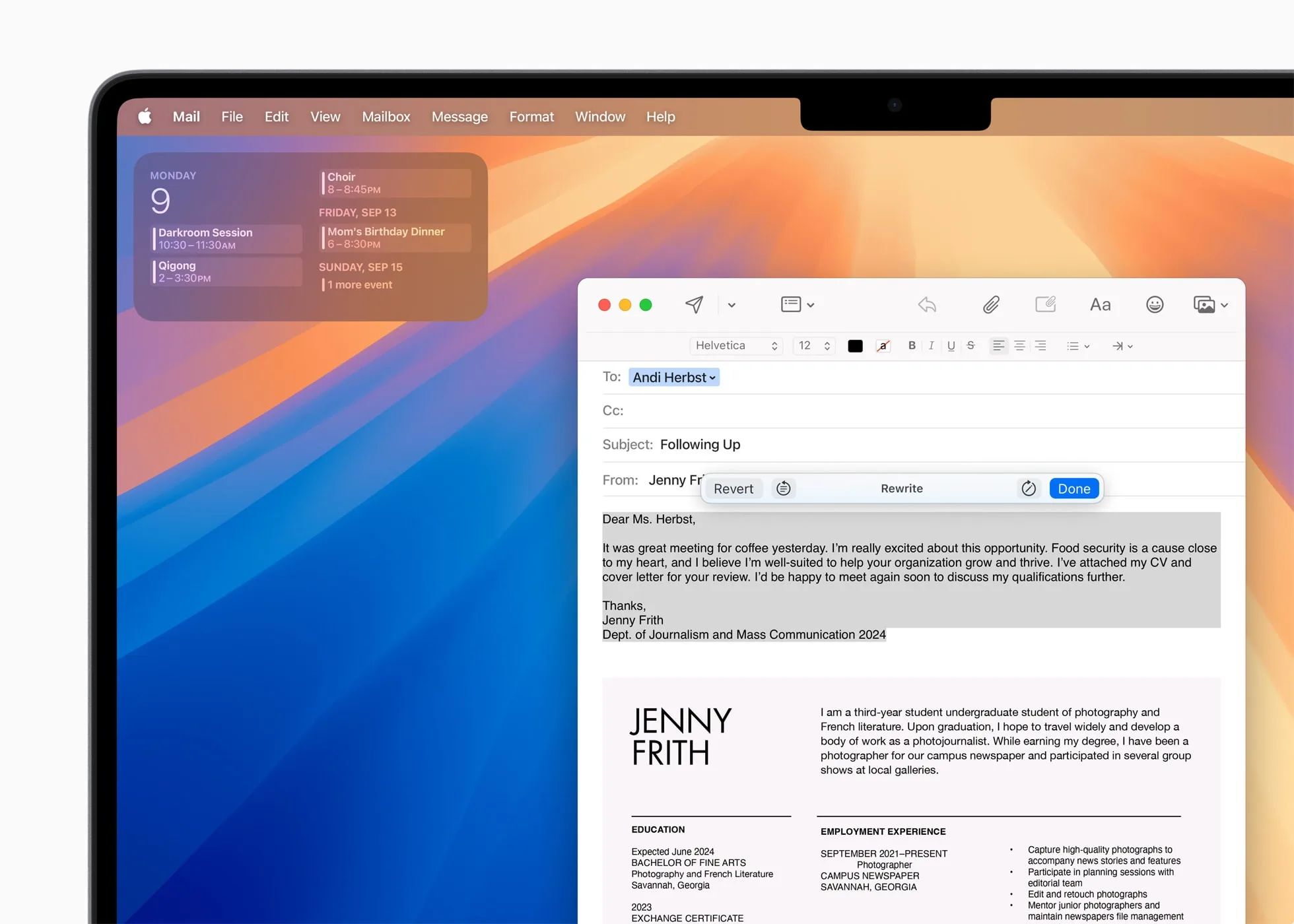

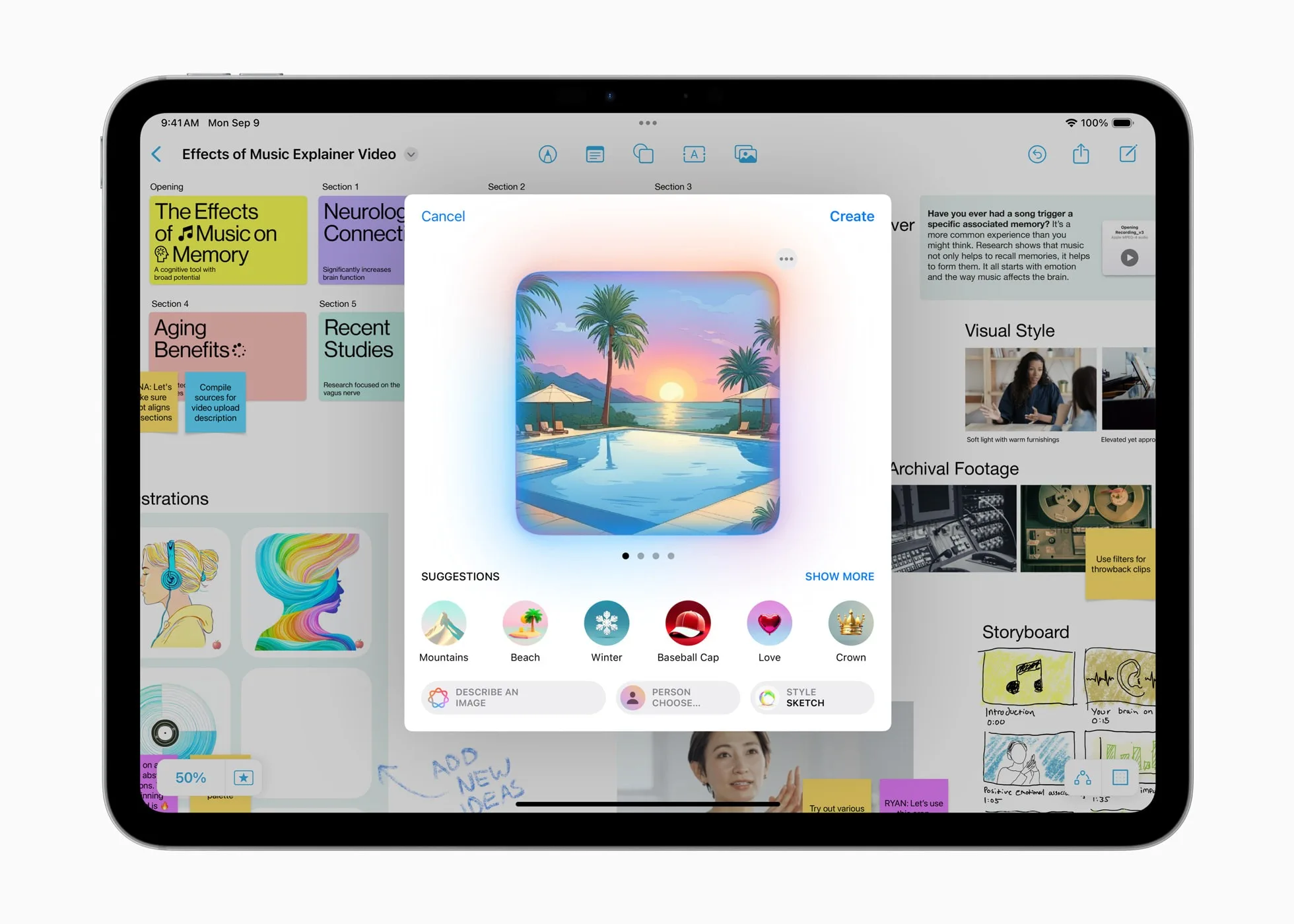

Quant à l’appareil lui-même, le New York Times révèle que Ive et Altman ont discuté de la manière dont l’IA générative permettait de créer un nouvel appareil informatique, capable d’offrir aux utilisateurs des possibilités bien plus vastes que les logiciels traditionnels grâce à sa capacité à gérer des requêtes complexes. L’année dernière, des rumeurs suggéraient que l’appareil serait inspiré de la technologie tactile et de l’iPhone original.

Cependant, peu de détails concrets ont été révélés. Marc Newson, cofondateur de LoveFrom, a déclaré au New York Times que le produit d’IA, ainsi que sa date de sortie, sont encore en cours d’élaboration.

Une collaboration prometteuse

Cette collaboration entre Jony Ive, connu pour son approche minimaliste et son souci du détail, et Sam Altman, à la tête de l’entreprise leader dans le domaine de l’IA générative, laisse présager un appareil innovant et potentiellement révolutionnaire. Cependant, il faudra patienter encore un peu avant d’en savoir plus sur ce projet mystérieux, mais l’attente risque d’être récompensée.

Un héritage incontestable

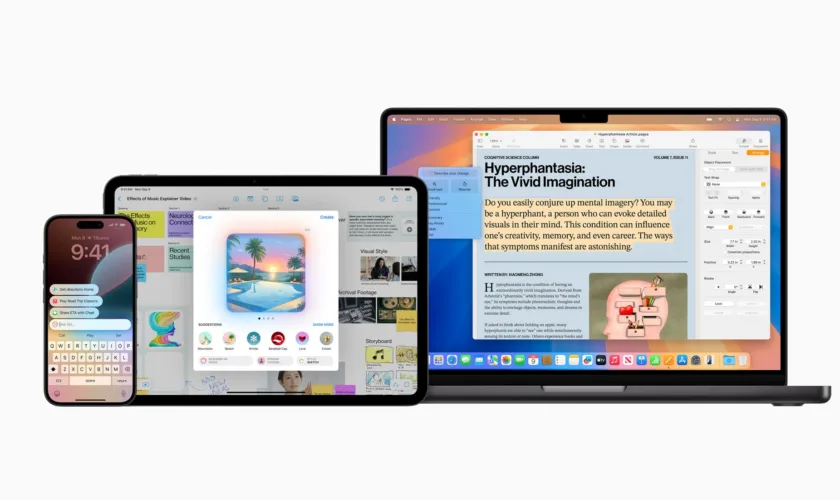

Jony Ive, qui a œuvré chez Apple pendant des décennies aux côtés de Steve Jobs, est reconnu pour avoir façonné le design de nombreux appareils emblématiques de la marque. Des gadgets colorés et originaux de la fin des années 90 et du début des années 2000 aux ordinateurs portables minimalistes d’aujourd’hui, son influence est indéniable.

Après avoir marqué l’histoire d’Apple, Ive souhaite désormais repousser les limites de l’innovation en utilisant l’IA pour créer un appareil totalement inédit. Selon lui et Sam Altman, PDG d’OpenAI, l’intelligence artificielle a le potentiel de donner naissance à une nouvelle forme d’informatique.

Si le duo souhaite réellement révolutionner le logiciel, il est fort probable qu’ils implémentent une IA capable de comprendre le contenu de l’écran et d’accéder à n’importe quelle partie du système d’exploitation, libérant ainsi l’utilisateur de toute intervention manuelle.

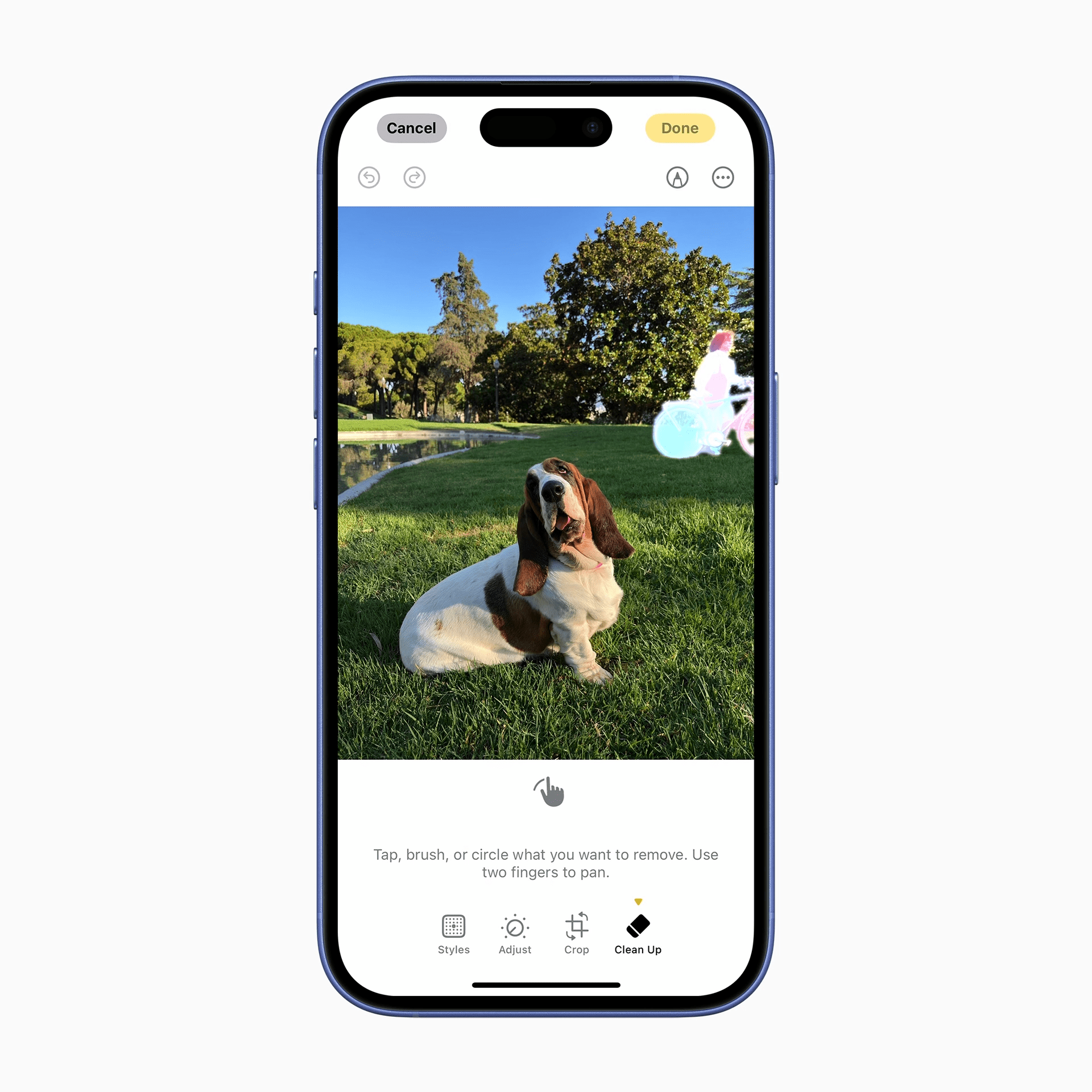

L’appareil pourrait également utiliser des caméras, des capteurs et des microphones pour comprendre le contexte en permanence. Imaginez un smartphone qui, lorsque vous envisagez d’appeler quelqu’un, compose automatiquement le numéro dès que vous prenez le téléphone en main. Ou encore, un appareil qui anticipe vos besoins en commandant un Uber dès que vous vous préparez à sortir. Les possibilités sont infinies.

Le défi de convaincre les utilisateurs

Ce projet n’est pas la première tentative de créer une nouvelle catégorie d’outils basés sur l’IA. Le Humane AI Pin et le Rabbit r1 ont ouvert la voie, mais sans grand succès. Le r1, en particulier, était un produit très dysfonctionnel à son lancement et a reçu des critiques majoritairement négatives.

De plus, l’IA suscite encore une certaine méfiance chez de nombreux consommateurs, qui la considèrent comme une mode passagère ou s’inquiètent de son impact sur l’emploi et la vie privée.