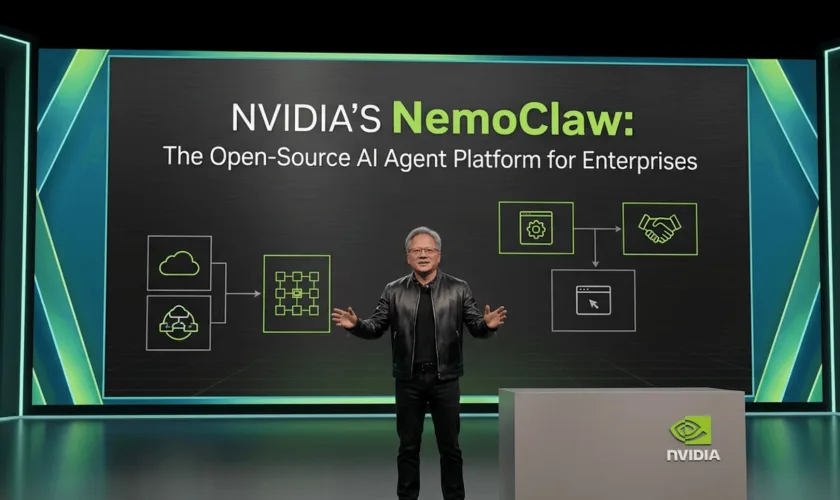

Dans la ruée vers les agents IA « always-on », Nvidia ne veut plus rester le fournisseur d’infrastructures que tout le monde utilise sans y penser. Selon Wired, le géant des GPU préparerait NemoClaw, une plateforme d’agents IA open source qu’il présenterait déjà à des partenaires avant sa conférence développeurs de la semaine prochaine.

Objectif : se positionner face à OpenClaw, devenu en quelques semaines un symbole — et un accélérateur — de l’agentique local.

NemoClaw : De l’open source « à la OpenClaw » — mais version entreprise

D’après Wired, Nvidia « pitch » NemoClaw à plusieurs grands éditeurs et acteurs enterprise (Salesforce, Cisco, Google, Adobe, CrowdStrike sont cités comme interlocuteurs potentiels), avec une promesse importante : la plateforme fonctionnerait même sur des machines sans GPU Nvidia.

Ce point n’est pas un détail technique, c’est une stratégie d’adoption : si vous voulez devenir un standard logiciel, vous évitez de vous enfermer dans votre propre matériel… tout en sachant qu’une partie des usages avancés finira, naturellement, par revenir vers les meilleures accélérations disponibles — et Nvidia est très bien placé pour en profiter.

Pourquoi OpenClaw a déclenché une réaction en chaîne ?

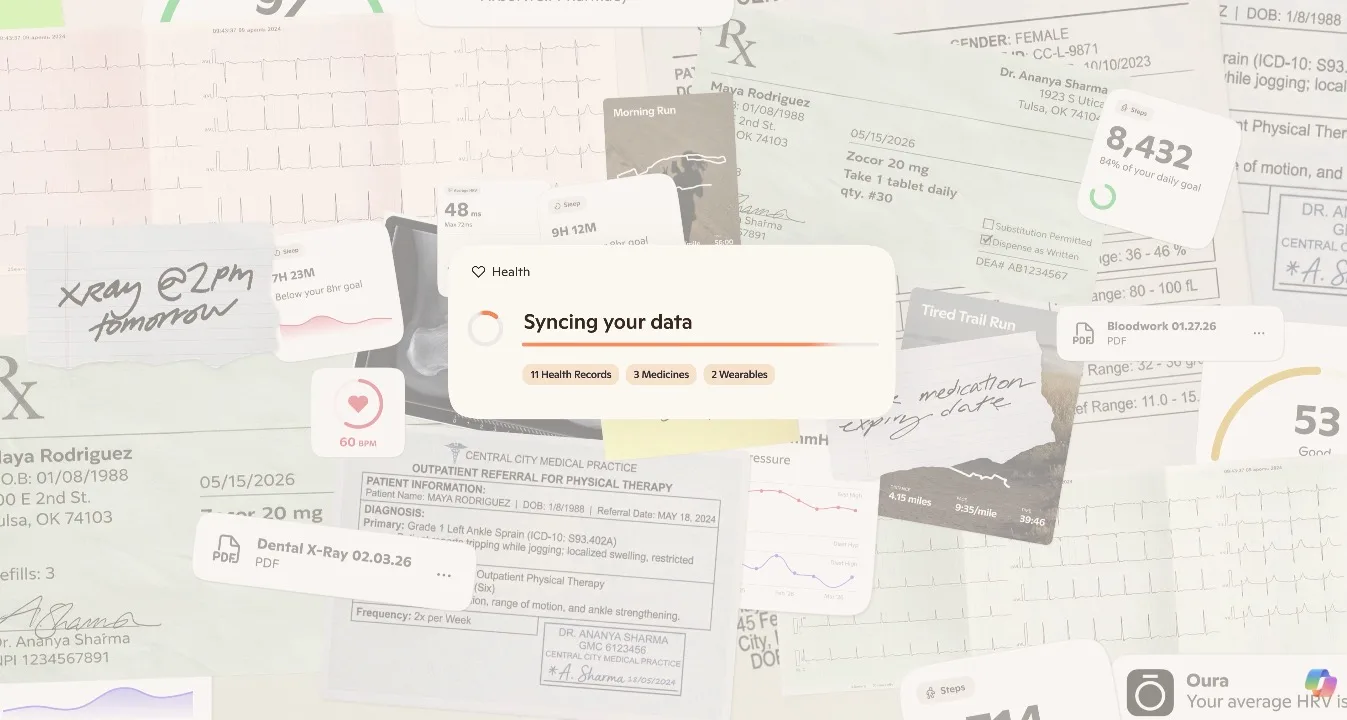

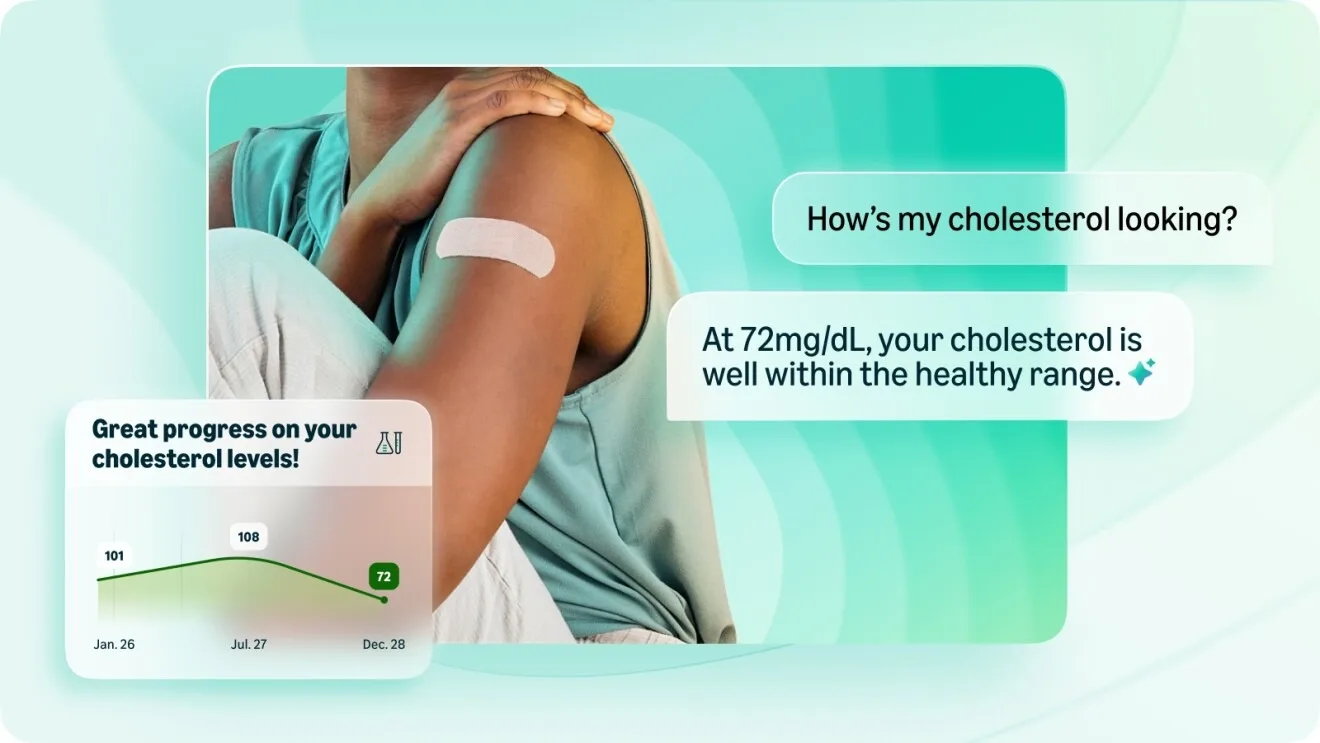

OpenClaw a capté l’attention parce qu’il matérialise une idée simple : des agents capables de travailler en continu depuis une machine personnelle, en s’appuyant sur différents modèles, et en manipulant des données locales. Le phénomène a été suffisamment visible pour que OpenAI recrute son créateur, Peter Steinberger, afin de « piloter la prochaine génération d’agents personnels », tout en laissant le projet vivre dans une fondation indépendante avec le soutien d’OpenAI.

Même les régulateurs et autorités commencent à réagir : des entités publiques et entreprises d’État en Chine ont été alertées contre l’installation d’OpenClaw sur des appareils de travail, au nom des risques de cybersécurité et de fuite de données.

C’est précisément là que Nvidia veut frapper : le passage à l’échelle entreprise ne se fait pas sur la magie des démos, mais sur la gouvernance, la conformité et les garde-fous.

Le nerf de la guerre : sécurité, permissions et confiance

Wired indique que Nvidia préparerait des outils de sécurité et de protection de la vie privée pour NemoClaw. Ce choix est quasi obligatoire : les agents « always-on » sont puissants parce qu’on leur donne des permissions (fichiers, messagerie, outils internes, CRM, tickets…). Et c’est aussi ce qui les rend dangereux. Sur ce terrain, une plateforme d’agents sans modèle de permissions strict, sans auditabilité et sans isolation sérieuse devient un cauchemar pour les RSSI.

Si Nvidia réussit, NemoClaw pourrait devenir ce que OpenClaw n’est pas encore totalement : une couche agentique acceptable par les entreprises — sans tuer l’esprit open source qui a rendu le concept viral.

L’intérêt caché de Nvidia : contrôler la couche logicielle, pas seulement la carte graphique

L’agentique a une propriété que Nvidia adore : elle consomme du calcul non pas en pics courts, mais sur des durées longues (heures, jours), avec des boucles d’outils, de navigation et de raisonnement. Autrement dit : plus les agents deviennent courants, plus la demande d’inférence et d’orchestration augmente.

Et dans un moment où Nvidia doit aussi composer avec des tensions géopolitiques et des contraintes export (comme l’arrêt rapporté de la production de H200 destinés au marché chinois, avec redirection de capacité vers la prochaine génération), renforcer son influence côté logiciel est une forme de couverture stratégique.

Ce qu’il faut surveiller à la conférence Nvidia

Trois signaux permettront de savoir si NemoClaw est une vraie offensive — ou un simple « copier-coller premium » :

- Le modèle de sécurité : permissions fines, sandboxing, logs, politique de données.

- L’interopérabilité : connecteurs, compatibilité multi-modèles, déploiement on-prem/cloud.

- La gouvernance open source : licence, contributions externes, neutralité réelle (ou open source « à géométrie variable »).

En clair : Nvidia n’a pas besoin de battre OpenClaw sur la viralité. Il lui suffit de gagner sur ce que les entreprises achètent vraiment : le contrôle.