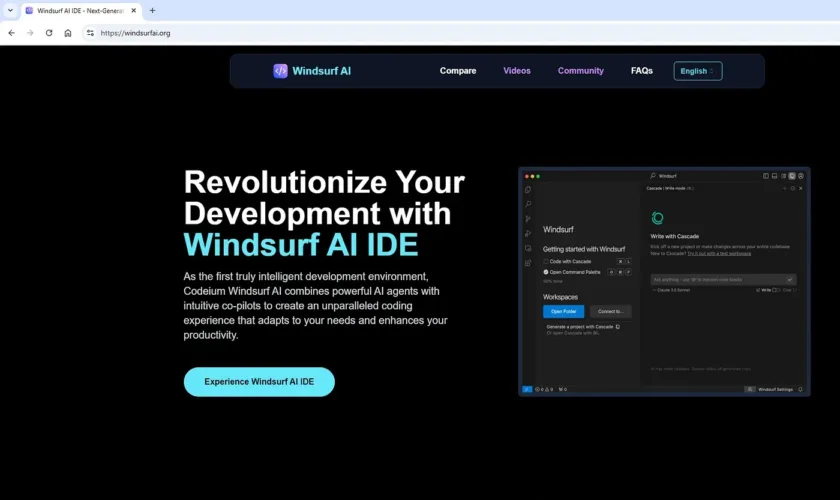

OpenAI pourrait bien signer son acquisition la plus coûteuse à ce jour avec le rachat imminent de Windsurf (anciennement Codeium), une startup emblématique du mouvement émergent du « vibe coding ».

Ce rachat, estimé à 3 milliards de dollars, vise à renforcer la position d’OpenAI dans le développement logiciel assisté par IA, en intégrant un outil complet de codage collaboratif et intuitif à son écosystème.

Le terme vibe coding, popularisé par Andrej Karpathy, cofondateur d’OpenAI, fait référence à une nouvelle approche du développement assisté par IA. Contrairement aux outils classiques de no-code ou low-code basés sur des interfaces visuelles, le vibe coding mise sur des prompts en langage naturel, une collaboration fluide entre l’humain et l’IA, et une logique centrée sur l’intention du développeur plutôt que sur l’écriture manuelle du code.

Pourquoi Windsurf attire tant OpenAI ?

Windsurf s’est rapidement imposé comme l’un des leaders dans ce domaine, aux côtés de solutions comme Cursor, Replit, Lovable ou Bolt. Sa dernière mise à jour, Wave 6, a été saluée pour son efficacité à réduire les frictions dans les workflows des développeurs.

Son succès tient notamment à :

- Une expérience fluide et rapide grâce à une boucle de retour instantanée ;

- Une interface co-créative qui permet aux développeurs d’itérer facilement avec l’IA ;

- Des fonctionnalités avancées pour guider l’IA avec des « toggles » intelligents, ajustés selon l’intuition du développeur.

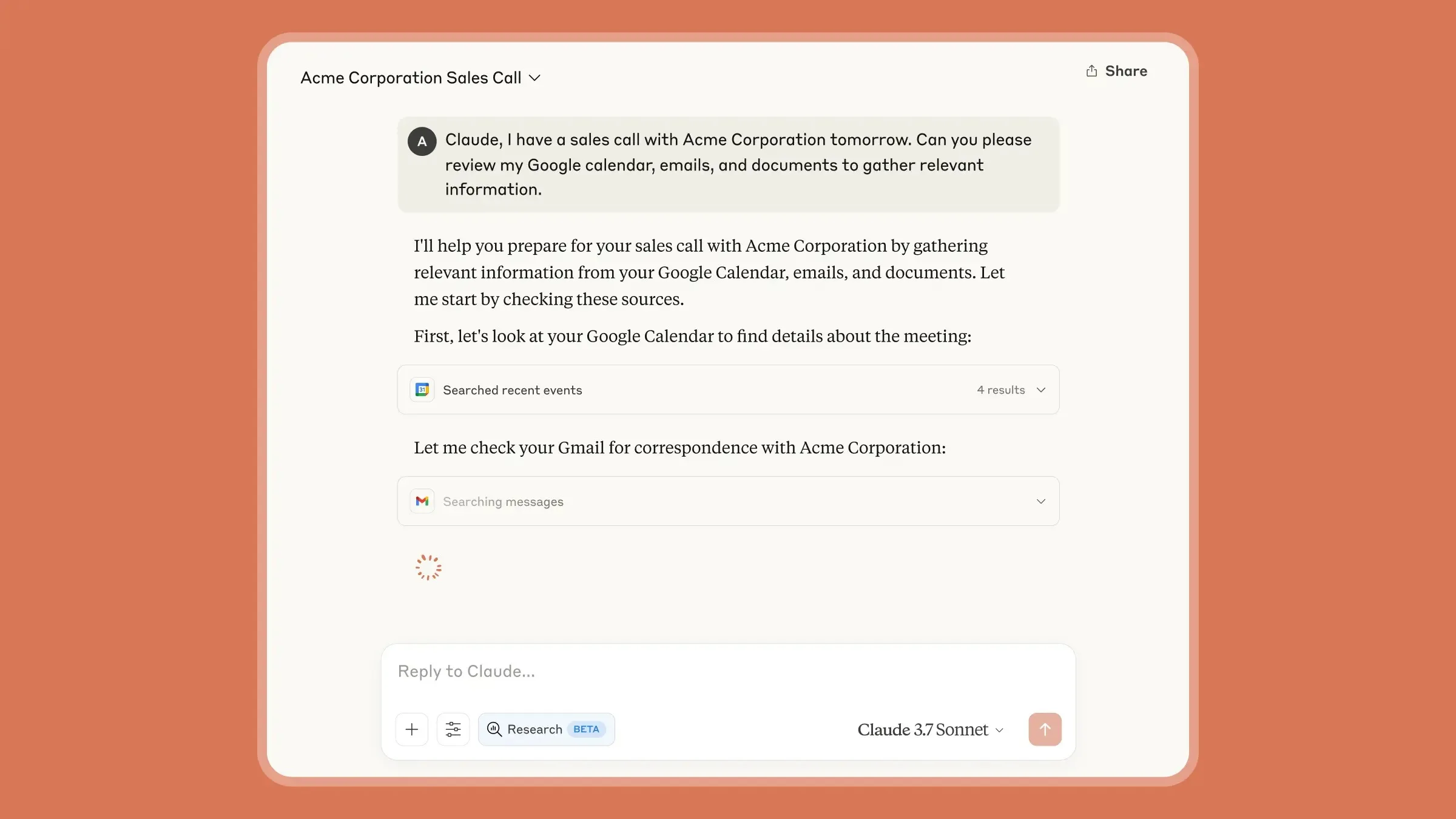

Vers une intégration verticale du stack développeur

Pour les analystes, l’acquisition de Windsurf serait un mouvement stratégique majeur pour OpenAI : « OpenAI ne veut plus seulement fournir les modèles de langage. Il veut aussi contrôler l’environnement où ils sont utilisés », déclare Arvind Rongala, fondateur de Edstellar.

L’idée ? Intégrer l’outil de codage directement à la couche d’intelligence (les modèles GPT), pour fournir une expérience de développement cohérente, unifiée et optimisée — un peu comme Apple avec ses produits et son écosystème fermé.

Certains observateurs saluent une synergie évidente entre les deux plateformes, notamment Lisa Martin de The Futurum Group, qui voit Windsurf comme « le chaînon manquant pour faire d’OpenAI le meilleur ami du développeur ». Mais d’autres soulignent le risque de verrouillage.

Si Windsurf devient trop dépendant de GPT, il pourrait perdre sa flexibilité à s’adapter à d’autres modèles IA comme Claude d’Anthropic ou des alternatives open source. Ce qui pourrait freiner l’adoption par les développeurs souhaitant rester indépendants.

Et Microsoft dans tout ça ?

Le rachat placerait également OpenAI en concurrence directe avec GitHub Copilot, propriété de Microsoft… alors même que Microsoft est l’un des plus gros investisseurs d’OpenAI. Une relation ambiguë, qui pourrait s’intensifier si OpenAI commence à chasser sur les terres de GitHub en proposant une solution intégrée, indépendante et potentiellement plus puissante.

Avec ce mouvement, OpenAI ne cherche pas seulement à acquérir une technologie, mais à changer la manière dont le code est écrit, partagé, et compris.

Le message est clair : l’avenir du développement logiciel passera par des environnements AI-first, où l’IA est un coéquipier plutôt qu’un simple assistant. Et OpenAI entend bien être à la fois le cerveau et le studio de cette nouvelle génération d’outils.

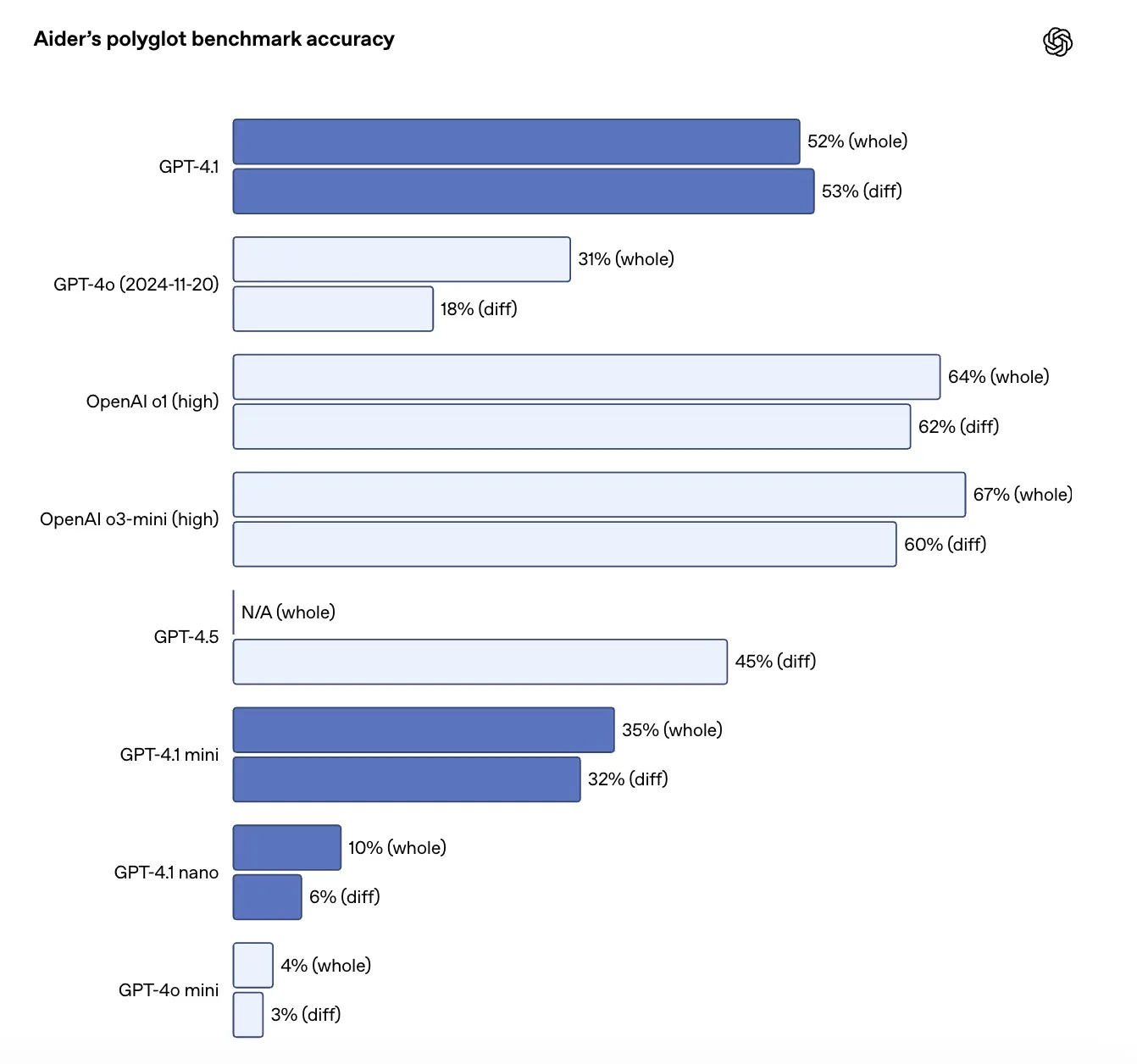

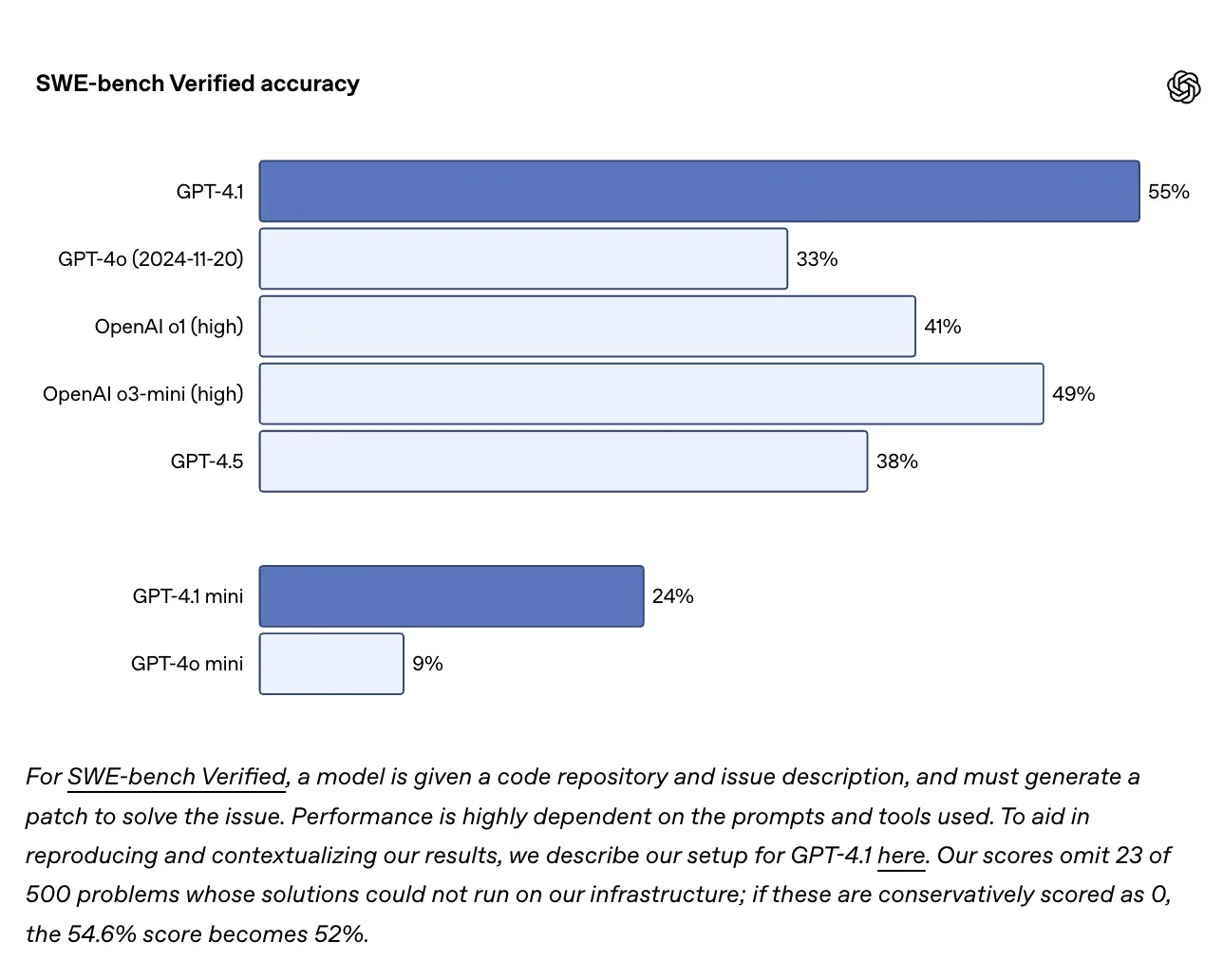

Alors, OpenAI est-il en avance ou en train de courir après Anthropic et Claude ? Peut-être un peu des deux. Mais une chose est sûre : avec Windsurf, le vibe coding prend une nouvelle dimension.