L’un des partenariats les plus emblématiques de l’ère de l’intelligence artificielle semble vaciller. Selon un rapport explosif du Wall Street Journal, OpenAI envisagerait de porter plainte pour comportement anticoncurrentiel contre Microsoft, son principal investisseur et partenaire technique depuis six ans.

Depuis 2019, Microsoft a investi des milliards dans OpenAI, en plus de fournir l’infrastructure cloud via Azure pour entraîner et faire fonctionner ses modèles d’IA. En retour, Redmond bénéficie d’un accès exclusif aux innovations de l’éditeur de ChatGPT, intégrées à Bing, Office et GitHub Copilot.

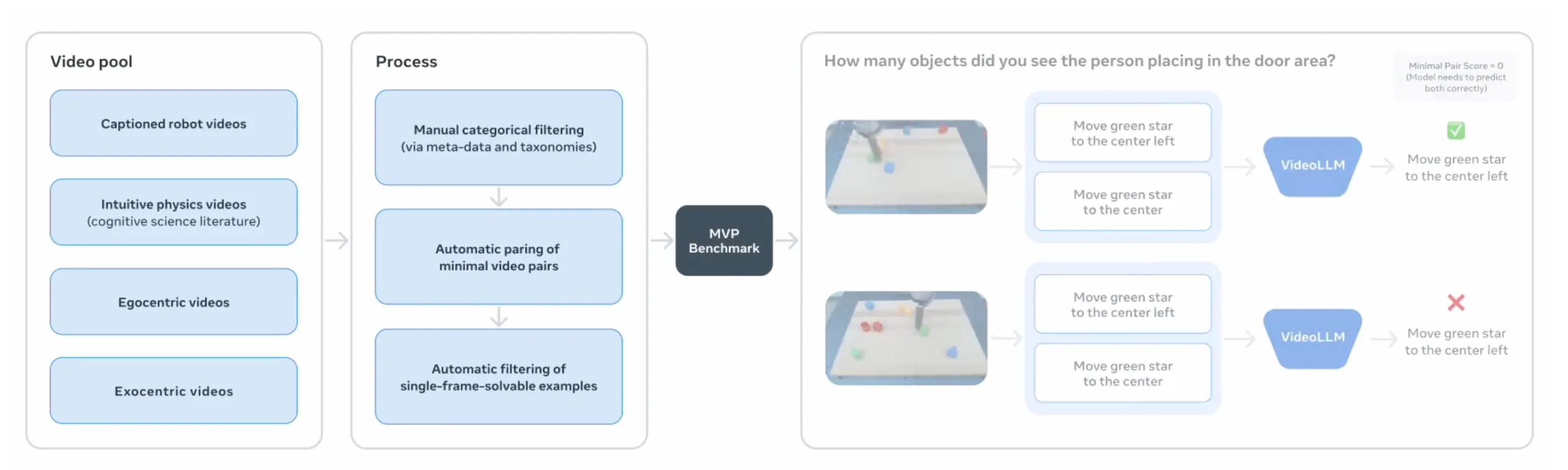

Mais derrière cette façade de coopération fructueuse, de profondes tensions sont apparues. OpenAI accuse Microsoft de vouloir imposer un contrôle excessif, notamment à travers une demande jugée intrusive : l’accès intégral à la propriété intellectuelle de Windsurf, une startup spécialisée dans l’IA de développement que OpenAI souhaite acquérir pour 3 milliards de dollars.

Le contrat Azure, l’enjeu de tous les conflits

OpenAI propose à Microsoft une révision majeure des termes du partenariat : renoncer à l’exclusivité Azure, abandonner ses droits sur les profits futurs, et exempter Windsurf du partage d’IP. En contrepartie, Microsoft obtiendrait 33 % du futur PBC (Public Benefit Corporation) qu’OpenAI prévoit de créer, en remplacement de sa structure actuelle à but lucratif.

Mais un refus de Microsoft pourrait faire capoter cette transition juridique, et OpenAI risquerait de perdre près de 20 milliards de dollars de financement.

Une diversification stratégique… sans Microsoft

En coulisses, OpenAI ne cache plus sa volonté de réduire sa dépendance vis-à-vis de Microsoft. Déjà, l’entreprise utilise désormais l’infrastructure cloud d’Oracle, malgré un contrat initial stipulant une exclusivité avec Azure. Récemment, OpenAI s’est aussi tourné vers Google Cloud pour gérer une partie de sa demande en pleine explosion.

Et ce n’est pas tout. Selon des médias taïwanais, OpenAI pourrait lancer ses propres puces d’entraînement IA, conçues avec Broadcom et fabriquées par TSMC en 3 nm, d’ici fin 2025. Sans compter le projet Stargate, une usine géante d’IA lancée avec Oracle, SoftBank et MGX… mais sans Microsoft.

L’AGI, la clause qui pourrait tout faire exploser

Une autre source de discorde majeure est la clause AGI dans leur contrat. Celle-ci permet à OpenAI de cesser tout partage technologique avec Microsoft si elle atteint l’intelligence artificielle générale. Ce scénario semble se rapprocher, et Microsoft souhaite continuer à accéder aux modèles, même en cas d’AGI… ce que refuse catégoriquement OpenAI.

Même si les deux entreprises affirment dans un communiqué vouloir « continuer à construire ensemble pour les années à venir », la confiance semble rompue. De plus en plus, OpenAI trace sa propre route, bâtit son infrastructure, diversifie ses fournisseurs et redéfinit son modèle de gouvernance.

Le divorce n’est pas encore acté, mais les tensions sont telles qu’un retournement pourrait bouleverser tout l’écosystème de l’IA. Et dans cette bataille stratégique, les enjeux dépassent de loin une simple querelle de partenaires : c’est l’avenir de l’intelligence artificielle souveraine et indépendante qui est en jeu.