Meta franchit un nouveau cap dans l’intelligence artificielle appliquée à la robotique avec V-JEPA 2, un modèle de monde (world model) auto-supervisé capable de comprendre, prédire et planifier des actions dans des environnements physiques complexes.

Avec 1,2 milliard de paramètres et un entraînement basé sur plus d’un million d’heures de vidéos, ce modèle pourrait bien redéfinir l’avenir des agents robotiques autonomes.

Qu’est-ce que V-JEPA 2 ? Un modèle d’IA formé sur la réalité

Conçu autour de l’architecture JEPA (Joint Embedding Predictive Architecture), V-JEPA 2 a pour objectif de permettre aux robots de mieux appréhender le monde qui les entoure. Il s’agit d’un modèle visuel auto-supervisé formé sans annotation humaine, capable d’analyser les interactions physiques et de prédire des conséquences futures à partir de simples observations vidéo.

Ce modèle repose sur une formation en deux étapes :

- Pré-entraînement à grande échelle sur des vidéos internet (1 million d’heures) et des images (1 million).

- Apprentissage conditionné par l’action, à l’aide d’un petit ensemble de données issues de la robotique (seulement 62 heures), permettant l’intégration de la dimension motrice dans ses prédictions.

Des performances impressionnantes en robotique

Meta a déjà testé V-JEPA 2 sur des robots dans ses propres laboratoires. Résultat : une réussite allant de 65 à 80 % pour des tâches complexes de manipulation d’objets dans des environnements inconnus.

Le modèle est capable de :

- Prédire les conséquences d’une action à partir d’une seule image ou d’un objectif visuel.

- Planifier une séquence d’actions (par exemple, déplacer un œuf avec une spatule sur une assiette).

- Utiliser des sous-objectifs visuels pour réaliser des tâches longues et complexes.

Pour les tâches simples, V-JEPA 2 évalue différents scénarios possibles et choisit celui qui maximise le succès. Pour des tâches complexes, il segmente la mission en plusieurs étapes visuelles intermédiaires.

Des capacités cognitives proches de l’intuition humaine

Ce qui distingue V-JEPA 2, c’est son intelligence physique intuitive, comparable à celle qu’on retrouve chez les enfants ou les animaux. Le modèle peut anticiper des lois physiques (comme la gravité ou les rebonds), ce qui le rend capable de naviguer dans le monde réel sans entraînement massif.

Meta affirme que le modèle est 30x plus rapide que Cosmos de Nvidia dans certaines tâches de planification, tout en utilisant uniquement une caméra RGB monoculaire, sans capteurs supplémentaires ou calibration complexe.

Benchmarks: une compréhension visuelle et temporelle avancée

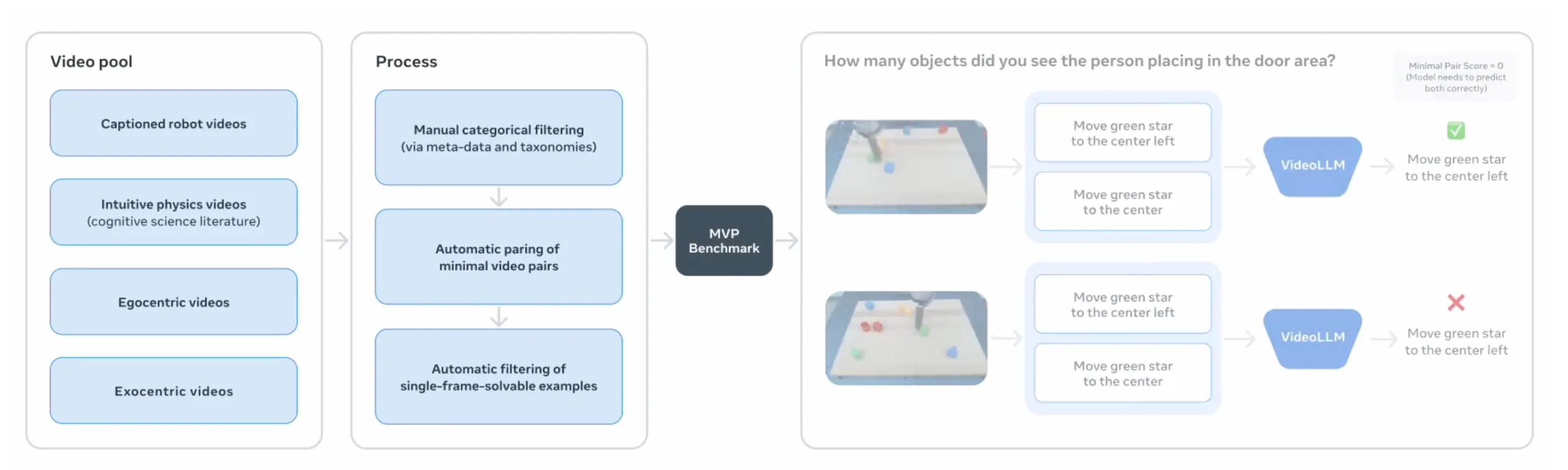

Pour mesurer les capacités de V-JEPA 2, Meta a publié trois nouveaux benchmarks :

- IntPhys 2 : évalue la capacité à distinguer des situations physiques plausibles ou non.

- MVPBench : vérifie si le modèle comprend vraiment la scène ou se contente de repérer des indices visuels.

- CausalVQA : teste la compréhension causale, l’anticipation et le raisonnement contrefactuel.

Le modèle s’est également illustré dans des épreuves de video question-answering avec des scores compétitifs, atteignant 84 % sur PerceptionTest et 76,9 % sur TempCompass, malgré l’absence d’entraînement supervisé en langage naturel.

V-JEPA 2-AC : planification robotique sans supervision

La version action-conditionnée du modèle, V-JEPA 2-AC, va encore plus loin. Entraînée avec un simple ensemble de vidéos robotiques non annotées, elle est capable de planifier des actions sans aucune récompense externe ni calibration.

Cette version atteint des performances impressionnantes :

- 100 % de réussite pour les tâches d’atteinte (reaching).

- Planification en 16 secondes par étape, contre 4 minutes pour Cosmos.

- Meilleurs résultats que les modèles comportementaux comme Octo ou les modèles de diffusion latente.

Une IA open source pour la robotique de demain

Meta met à disposition le code source et les checkpoints du modèle V-JEPA 2, dans une démarche ouverte et collaborative. L’objectif est clair : faire de ce modèle une base modulaire et généralisable pour tous les projets d’IA embarquée, de la robotique domestique à l’exploration spatiale.

Avec V-JEPA 2, Meta pose les fondations d’une nouvelle génération d’intelligences artificielles embarquées capables de comprendre le monde par elles-mêmes, sans supervision massive ni scénarios prédéfinis.

Comme le souligne Yann LeCun, directeur scientifique IA chez Meta : « Les modèles du monde seront le socle de la prochaine ère de la robotique ».