Samsung vient d’annoncer un objectif qui ressemble à une bascule industrielle : transformer l’ensemble de ses sites de production mondiaux en « usines pilotées par l’IA » d’ici 2030. On ne parle plus d’automatisation classique, mais de systèmes capables de décider, d’optimiser et d’agir dans un environnement réel — avec des robots, y compris humanoïdes, comme bras exécutifs.

Le terme est le même, mais le terrain change radicalement. Samsung explique vouloir étendre l’IA agentique à la fabrication : des agents capables de planifier et d’exécuter des tâches pour atteindre des objectifs (qualité, débit, réduction des coûts, gestion des flux).

L’entreprise parle d’un déploiement progressif, conditionné par l’intégration dans des sites très différents (produits, pays, contraintes réglementaires et supply chain).

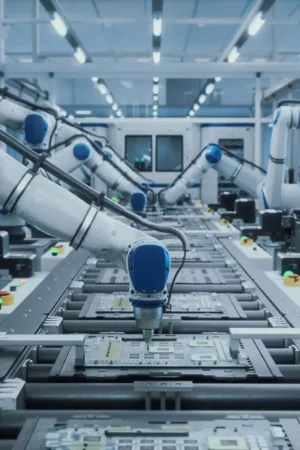

Ce que Samsung met sur la table : agents IA, digital twins et robots (dont des humanoïdes)

Dans sa feuille de route, Samsung mentionne plusieurs briques structurantes :

- Digital twins et simulation sur tout le parcours industriel (de l’entreposage matière à l’expédition)

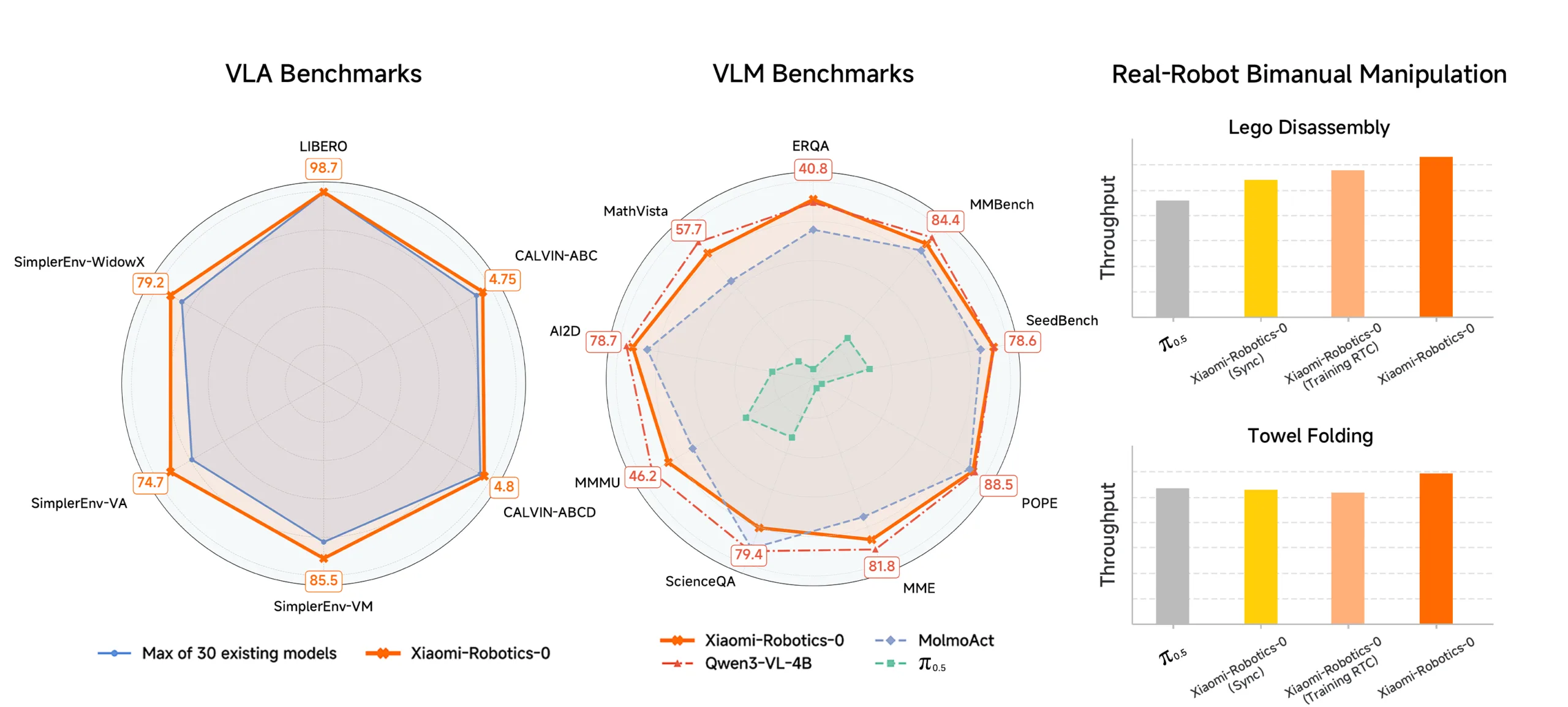

- Agents IA dédiés au contrôle qualité, à la production et à la logistique

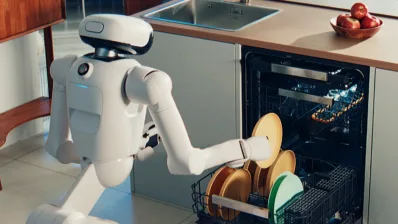

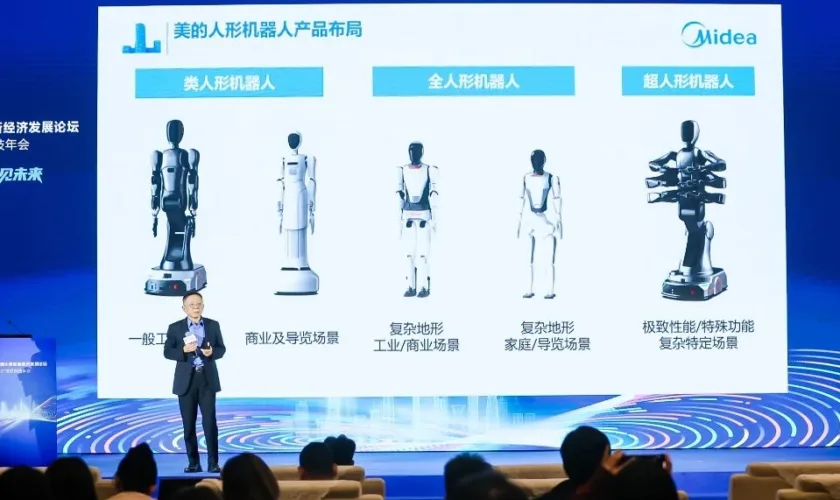

- Robots industriels en trois familles : exploitation/maintenance des lignes, logistique interne, et assemblage de précision

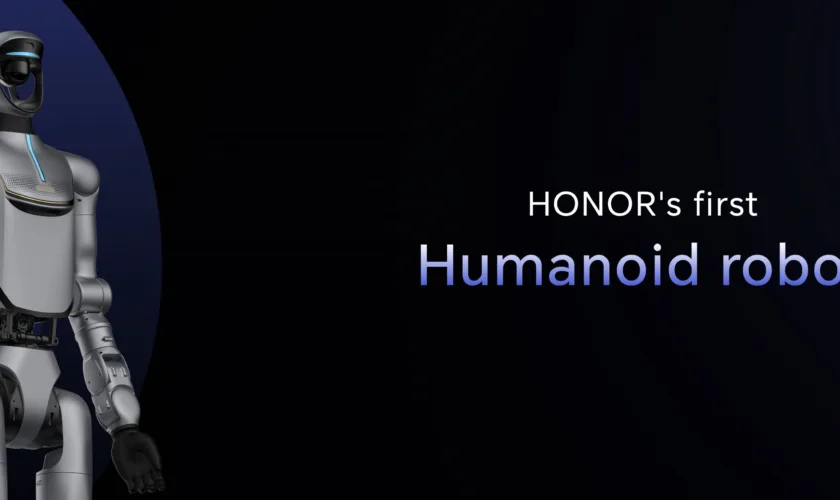

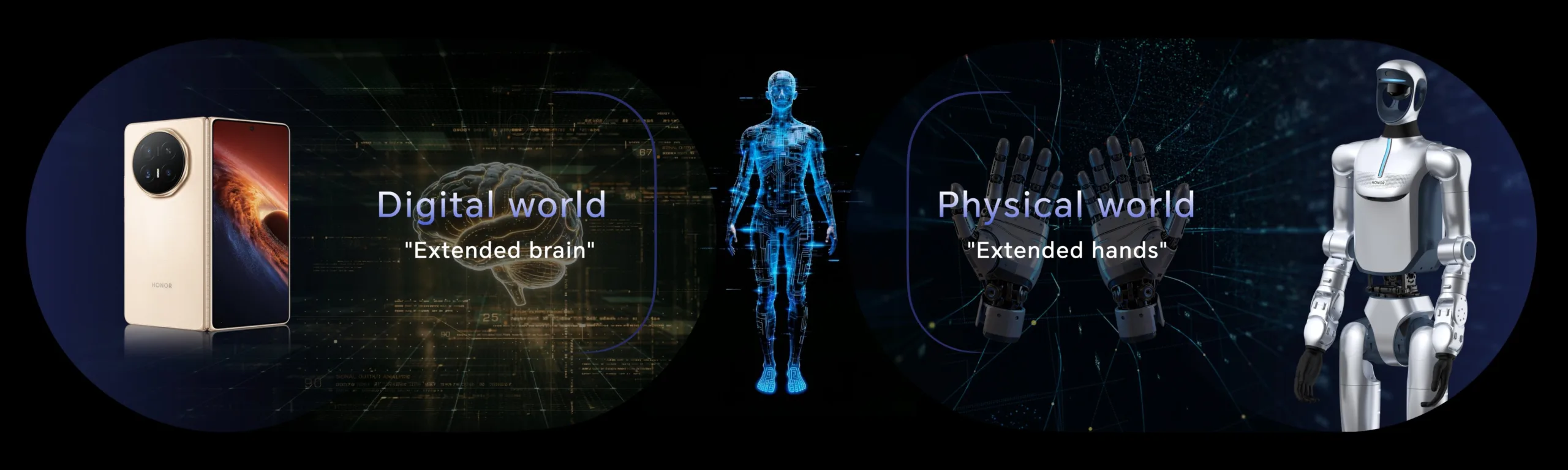

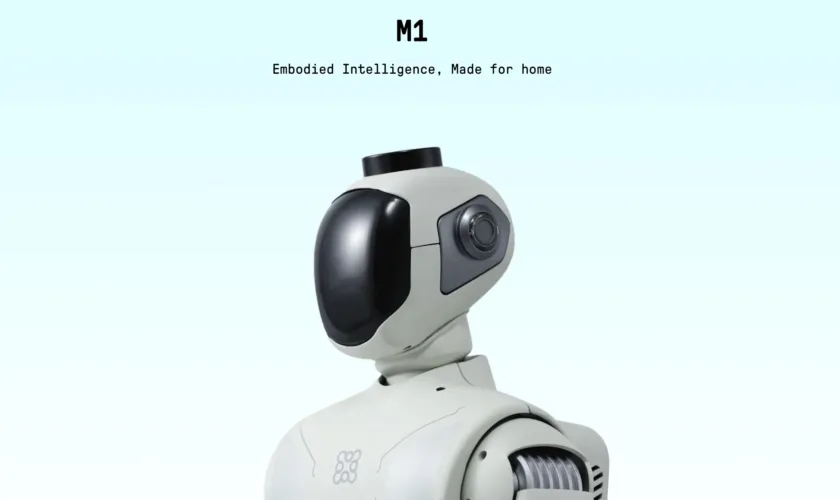

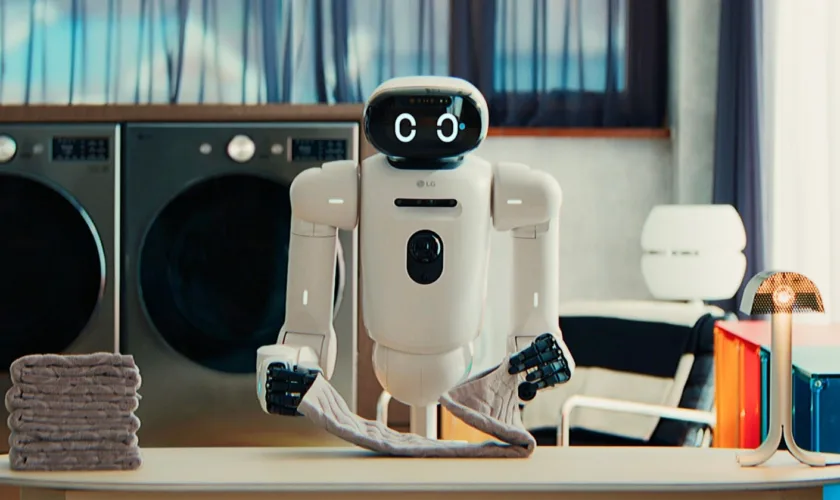

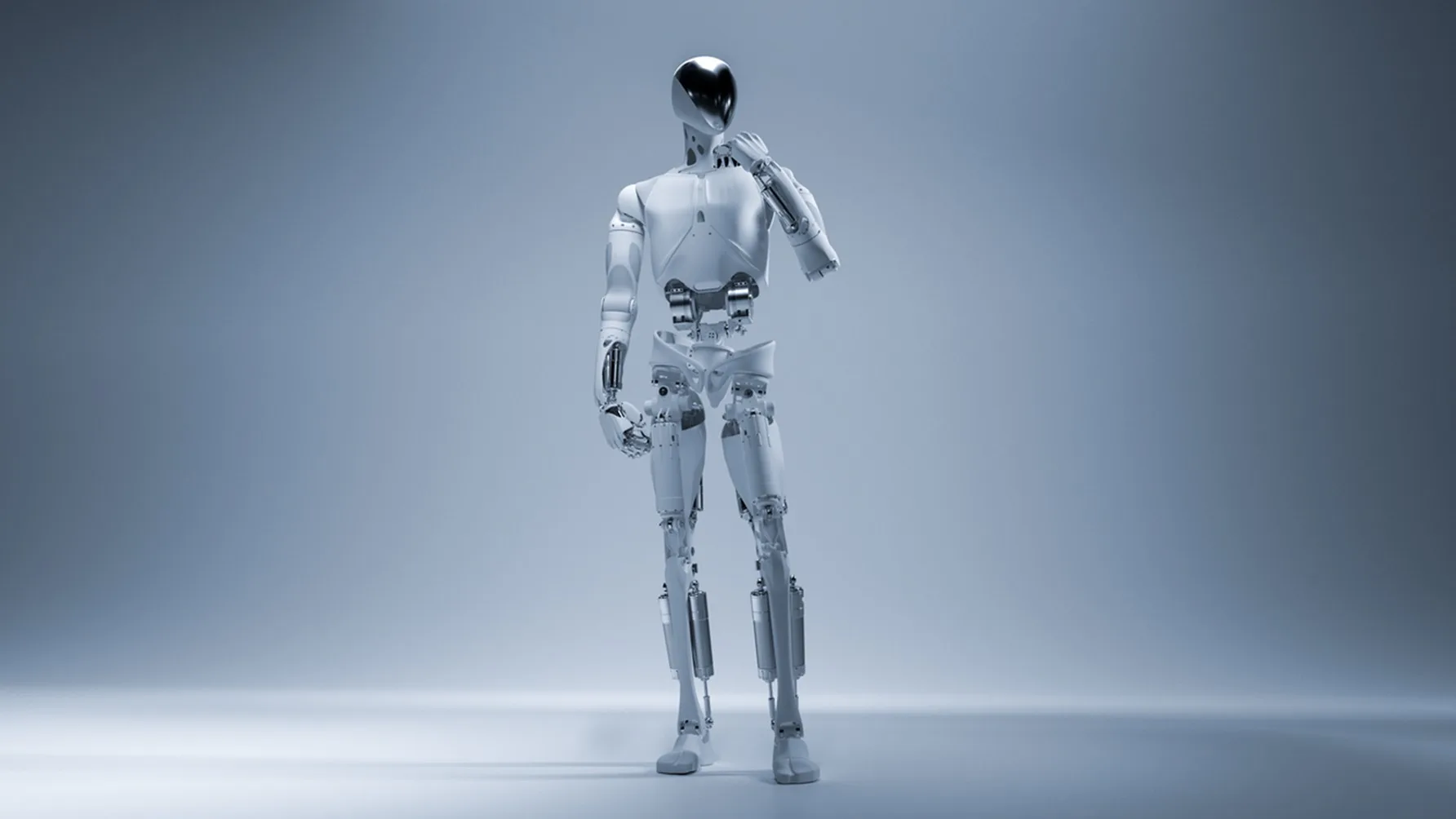

Et oui, Samsung évoque aussi des robots humanoïdes pour les opérations complexes où la dextérité et la flexibilité « type humain » restent utiles.

Samsung a préparé le terrain côté robotique en devenant le plus grand actionnaire de Rainbow Robotics (passage à 35 % annoncé fin 2024), avec l’ambition affichée d’accélérer le développement de robots, dont des humanoïdes.

Parmi les plateformes susceptibles d’entrer dans les usines : le RB-Y1, un humanoïde sur base roulante avec deux bras, présenté par Rainbow Robotics comme une plateforme mobile bi-bras.

L’ambition est claire, mais 2030 se jouera sur la fiabilité (pas sur la démo)

Le pari de Samsung n’est pas seulement technologique, il est économique. Déployer des agents IA « autonomes » dans des dizaines d’usines suppose de résoudre trois problèmes difficiles :

- La robustesse : un agent qui « décide » doit être prévisible, auditable, et sûr dans un contexte où l’erreur coûte cher (rebuts, retours, incidents).

- L’intégration au legacy : les usines vivent avec des équipements hétérogènes, des ERP/MES existants, des capteurs imparfaits, des données parfois sales.

- Le ROI : humanoïdes et agents avancés doivent prouver qu’ils font mieux (ou moins cher) que les automatismes classiques + opérateurs, à grande échelle.

Autrement dit : la vision est spectaculaire, mais la victoire se jouera sur des KPI très prosaïques — taux de défaut, temps de cycle, arrêts de ligne, consommation énergétique, et coûts de maintenance.