L’entreprise emblématique à l’origine de ChatGPT, OpenAI, vient de marquer un tournant historique dans le secteur technologique en bouclant une levée de fonds exceptionnelle de 40 milliards de dollars.

Ce tour de table, mené par le géant japonais SoftBank, porte la valorisation d’OpenAI à 300 milliards de dollars, établissant un nouveau record pour une entreprise technologique privée.

Selon les sources de Reuters et Financial Times, SoftBank injecte à lui seul 30 milliards de dollars, tandis qu’un consortium d’investisseurs comprenant Microsoft, Thrive Capital, Altimeter Capital et Coatue Management complète le reste. L’investissement sera décaissé en deux temps : 10 milliards immédiatement, et 30 milliards supplémentaires d’ici là fin de l’année, sous réserve qu’OpenAI finalise sa transition vers un statut d’entreprise à but lucratif. Sans cette conversion, une partie de l’investissement pourrait être compromise.

OpenAI : Un besoin colossal en capitaux pour concrétiser l’AGI

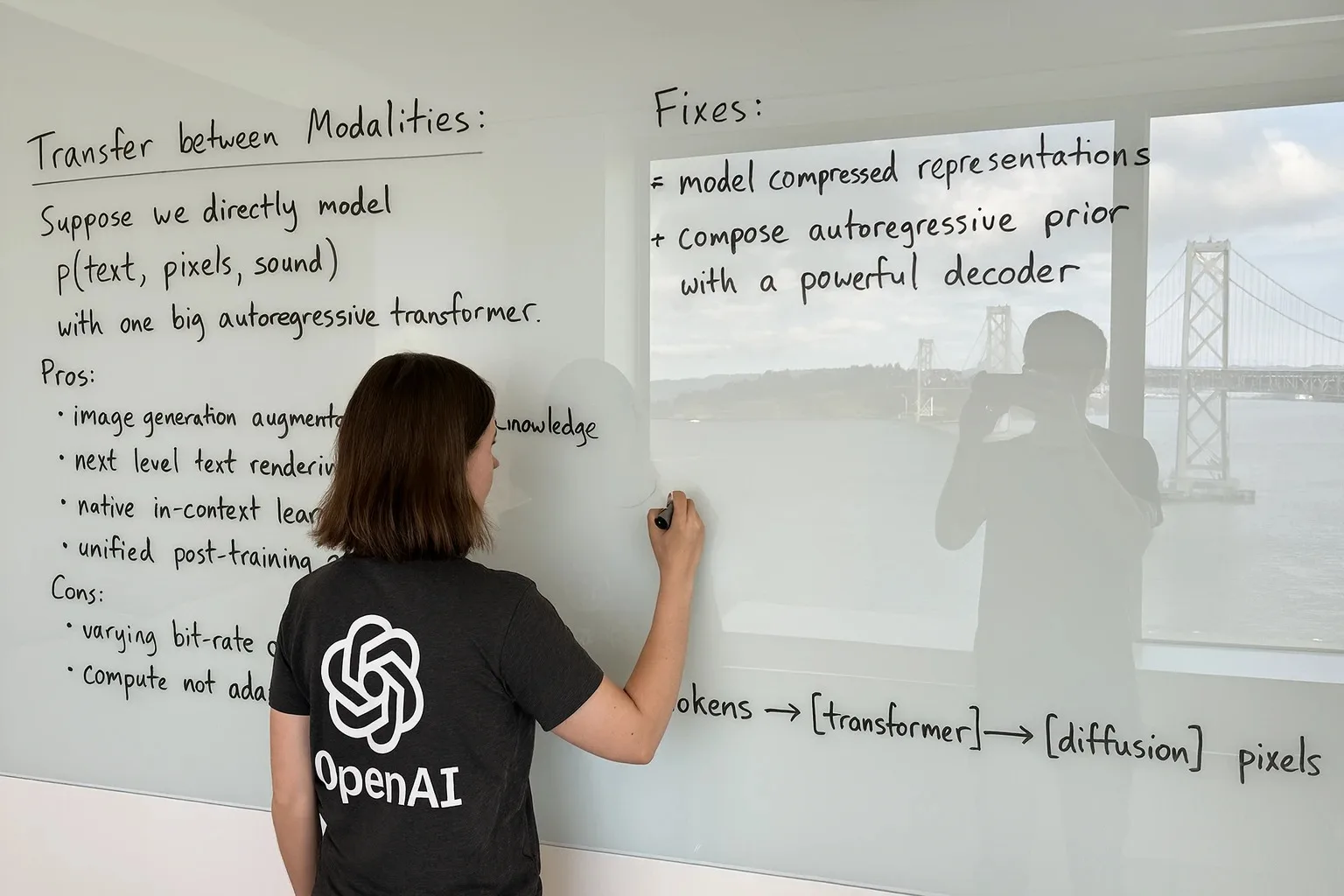

OpenAI justifie cette levée par ses ambitions d’envergure : construire une intelligence artificielle générale (AGI) bénéfique pour toute l’humanité. Pour cela, l’entreprise dit avoir besoin de capacités de calcul massives, d’infrastructures globales, d’énergie… et, bien sûr, de financements titanesques. Ce nouveau capital doit accélérer le développement de modèles toujours plus puissants, comme le futur GPT-5, et soutenir les services déjà en place, comme ChatGPT, utilisé aujourd’hui par plus de 500 millions de personnes chaque semaine.

Cette levée de fonds fait également écho au projet Stargate, un partenariat entre OpenAI, SoftBank, Oracle et le fonds souverain MGX basé à Abu Dhabi. Ce projet vise à créer des méga-centres de données en Amérique du Nord, pour un coût estimé à 500 milliards de dollars sur quatre ans. Le président Donald Trump s’est personnellement engagé à soutenir cette initiative, en la présentant comme un vecteur de souveraineté technologique et de création de plus de 100 000 emplois.

Une croissance fulgurante… mais encore loin de la rentabilité

Malgré des revenus prévus à 12,7 milliards de dollars cette année (contre 3,7 milliards en 2023), OpenAI n’anticipe pas de rentabilité avant 2029, selon les estimations internes rapportées par Bloomberg. Une perspective qui souligne la nature ultra-capitalistique de l’IA générative, où les coûts d’exploitation restent démesurés.

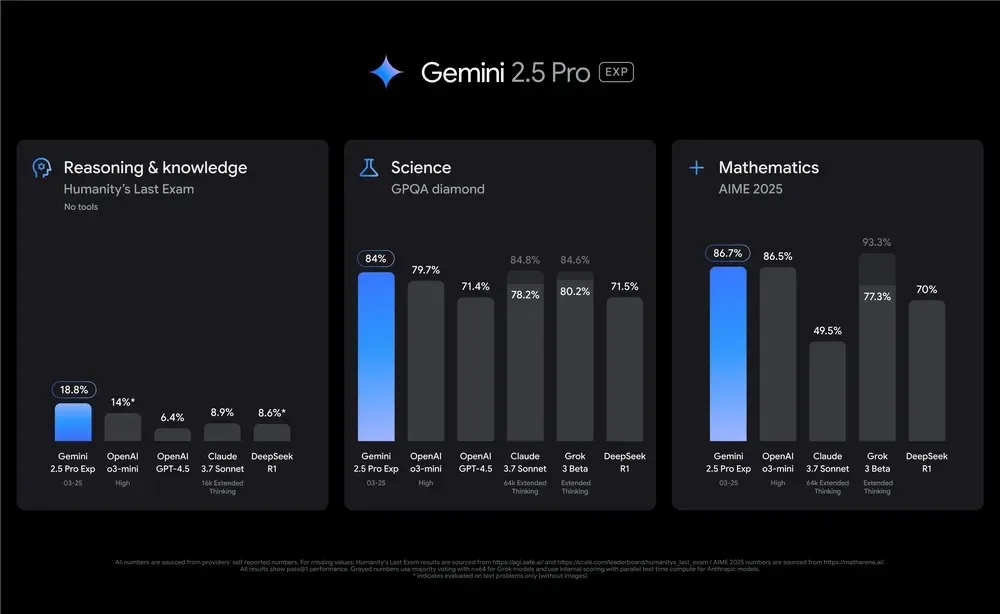

Avec cette opération, OpenAI renforce sa position de leader dans la guerre mondiale de l’IA, face à des concurrents comme Google DeepMind, Anthropic, xAI (Elon Musk) ou encore Meta. Mais elle illustre aussi les tensions croissantes entre régulation, innovation et souveraineté numérique, dans un contexte où l’IA devient un enjeu géopolitique majeur.