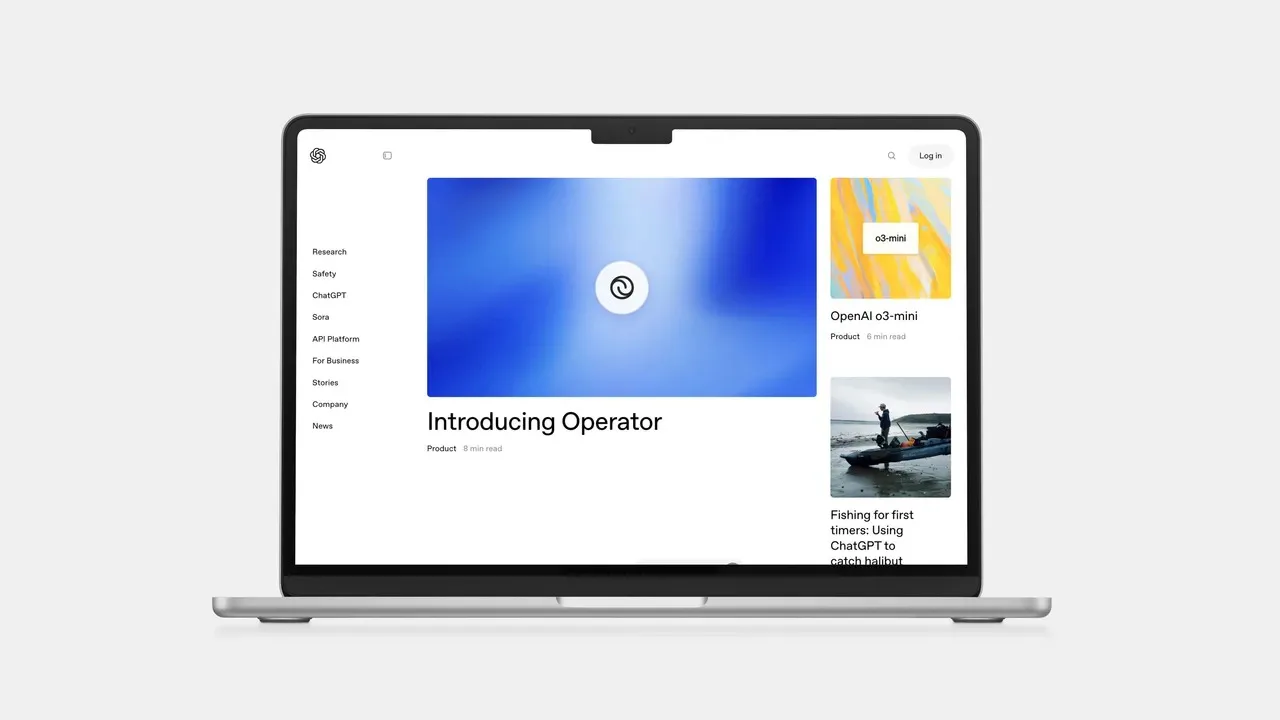

OpenAI vient de dévoiler une refonte complète de son identité visuelle, marquée par un nouveau logo, une typographie revisitée et une palette de couleurs mise à jour. Cette évolution vise à offrir une image plus cohérente et raffinée de l’entreprise, qui a connu une croissance fulgurante ces dernières années.

Il s’agit du premier rebranding de l’entreprise depuis son ascension fulgurante en 2022, portée par le succès de ChatGPT.

OpenAI, un nouveau logo pour une identité plus épurée

À première vue, le nouveau logo peut sembler identique à l’ancien, mais, en y regardant de plus près, on remarque des lignes plus nettes et un espace central légèrement agrandi. Ce subtil ajustement donne un aspect plus fluide et équilibré à l’emblématique « blossom » d’OpenAI.

Cette refonte a été réalisée en interne par l’équipe design dirigée par Veit Moeller et Shannon Jager, en collaboration avec la fonderie berlinoise ABC Dinamo pour la typographie et le studio Studio Dumbar de Rotterdam pour le motion design.

Thoughts on the “refreshed” @OpenAI brand & design language?

To me it just looks like they formalized what they already have been using, along with a new font… pic.twitter.com/uTyaGXR0pk

—Allen Djal (@allendjal) February 4, 2025

Un besoin de cohésion et d’uniformité

Lors d’une interview avec Wallpaper, les designers ont reconnu que l’identité visuelle d’OpenAI était jusqu’ici hétérogène et manquait de cohérence. Différentes polices, logos et couleurs coexistaient sans véritable stratégie. Cette refonte vise donc à unifier la communication visuelle de l’entreprise.

Selon Veit Moeller, cette réflexion a été initiée il y a plus d’un an à la demande du PDG Sam Altman, qui serait d’ailleurs l’un des concepteurs du premier logo d’OpenAI. L’objectif était d’incarner une identité plus organique et humaine, tout en conservant l’aspect technologique et scientifique qui définit la marque.

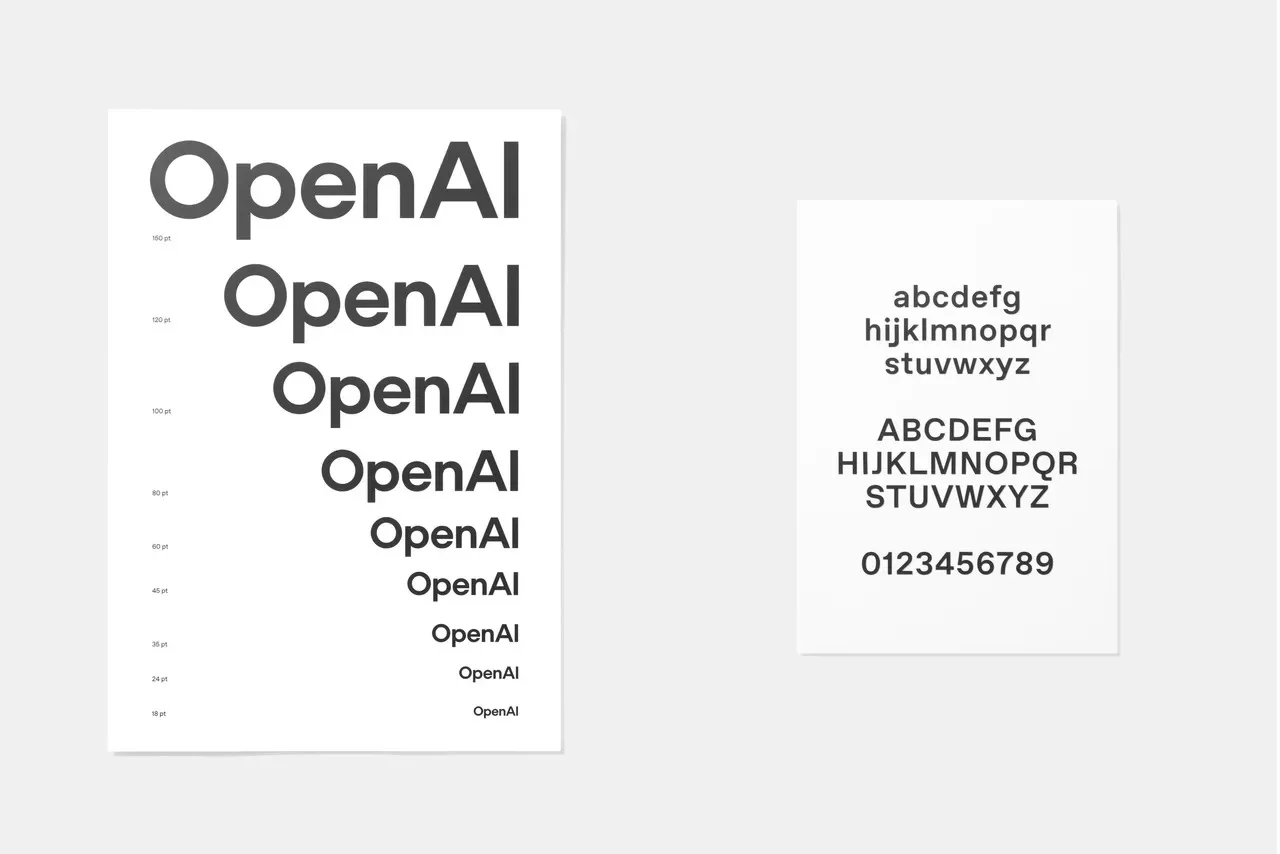

Une nouvelle police OpenAI Sans

Parmi les nouveautés, OpenAI a développé sa propre typographie, baptisée OpenAI Sans. Ce caractère typographique cherche à trouver un équilibre entre la rigueur géométrique et une touche plus accessible et chaleureuse. Le détail le plus marquant se trouve dans la lettre « O », dont l’intérieur présente de légères imperfections destinées à atténuer l’effet trop robotisé et à renforcer une dimension humaine.

Lorsqu’on leur a demandé si les outils d’IA d’OpenAI, comme ChatGPT, avaient participé à la conception de cette identité, Moeller a répondu que l’IA avait été utilisée uniquement pour calculer les différentes épaisseurs de police.

Une identité en phase avec l’évolution d’OpenAI

De simple laboratoire de recherche, OpenAI est devenu un acteur mondial incontournable de l’intelligence artificielle. Cette refonte traduit cette montée en puissance et cherche à affirmer une identité plus claire et impactante.

OpenAI’s in-house rebrand, led by Head of Design Veit Moeller and Design Director Shannon Jager. pic.twitter.com/hN9yDg4Tlf

—Design Everywhere (@dsgnevrywhr) February 5, 2025

En parallèle, la marque a déjà testé sa nouvelle identité à travers un drop de merchandising, qui a rencontré un énorme succès en interne. Selon Jager, certains employés ont même hacké le site pour pouvoir commander davantage de produits, ce qui témoigne de l’enthousiasme suscité en interne par ce nouveau design.

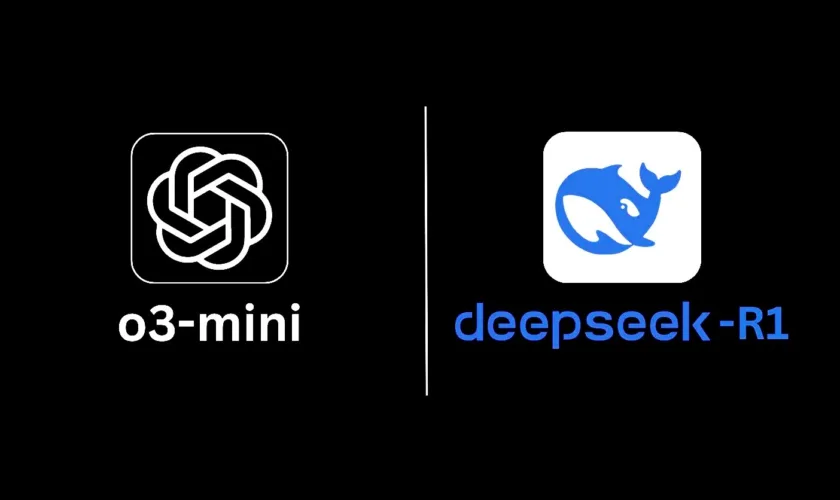

DeepSeek, la nouvelle concurrence de OpenAI

Ce changement intervient à un moment stratégique pour OpenAI, alors que l’entreprise fait face à une concurrence accrue de la part de DeepSeek, une marque chinoise d’IA open source qui vient de conclure un accord financier avec SoftBank. OpenAI est également impliqué dans une bataille judiciaire avec Elon Musk. Cependant, Moeller affirme que cette refonte était en préparation depuis longtemps. « Sam [Altman] nous a demandé de repenser l’identité visuelle il y a plus d’un an », a-t-il confié.

Avec cette évolution graphique, OpenAI se positionne comme une marque à la croisée de la technologie et de l’humain, affirmant sa vision d’une IA au service du progrès et de la créativité.