OpenAI vient de lever le voile sur GPT-5.2-Codex, présenté comme le modèle d’IA le plus avancé jamais conçu pour le développement logiciel agentique et la cybersécurité défensive.

Déployé le 18 décembre 2025, ce nouveau modèle marque une étape majeure dans l’évolution des assistants de programmation capables de gérer des projets complexes, des bases de code massives et des scénarios de sécurité réels.

Basé sur GPT-5.2, Codex bénéficie d’optimisations ciblées : meilleure gestion des contextes longs, fiabilité accrue sur Windows, performances record sur les refactorisations et migrations à grande échelle, et bond significatif en cybersécurité, selon OpenAI.

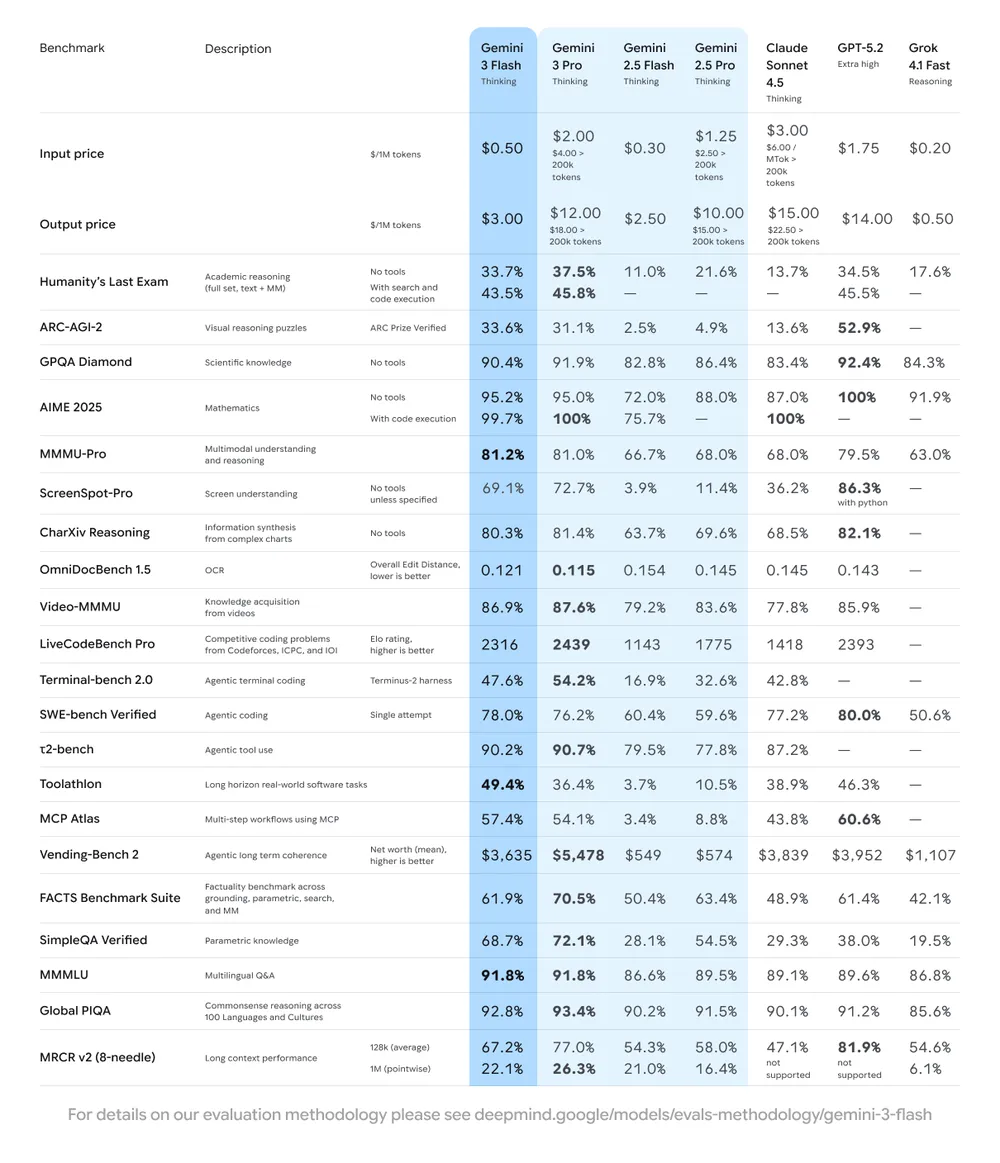

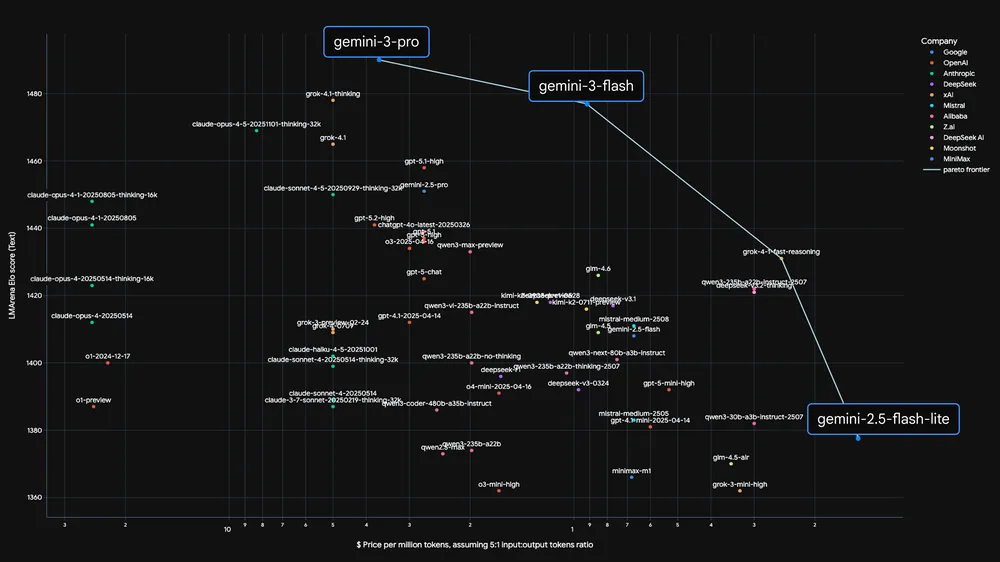

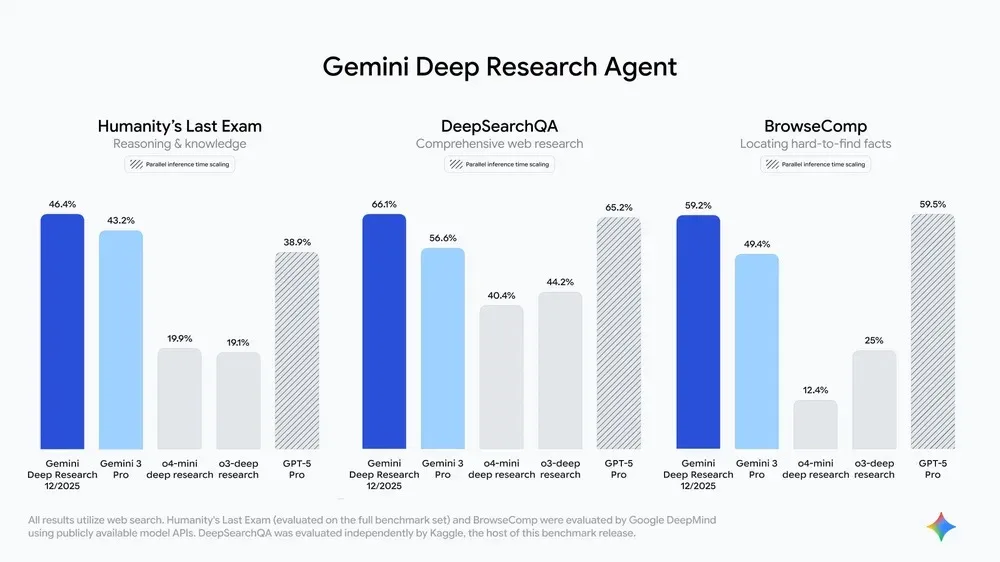

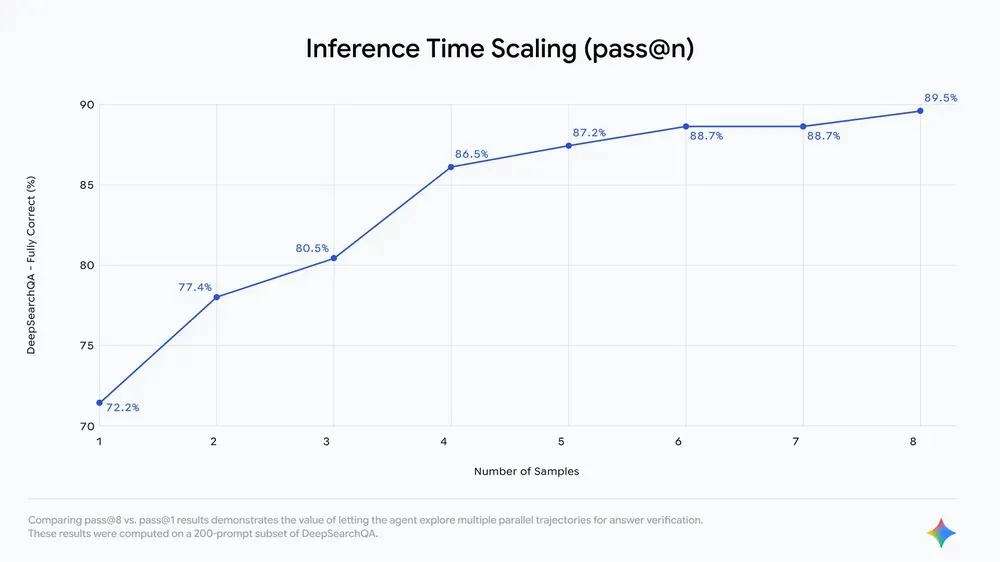

Cette sortie intervient dans un contexte de pression concurrentielle extrême, OpenAI ayant déclenché un « code red » interne face aux avancées rapides de Google Gemini 3. Le message est clair : l’ère des IA généralistes touche ses limites, place désormais aux agents spécialisés capables d’agir sur des systèmes complexes du monde réel.

GPT-5.2-Codex : Des performances record sur le génie logiciel réel

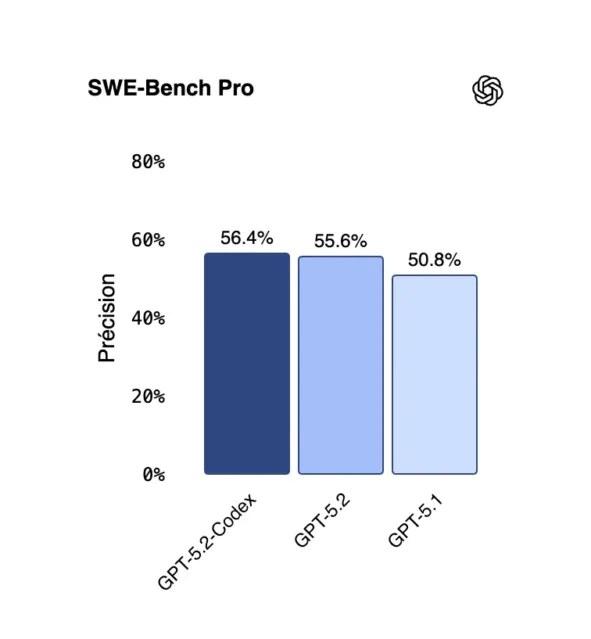

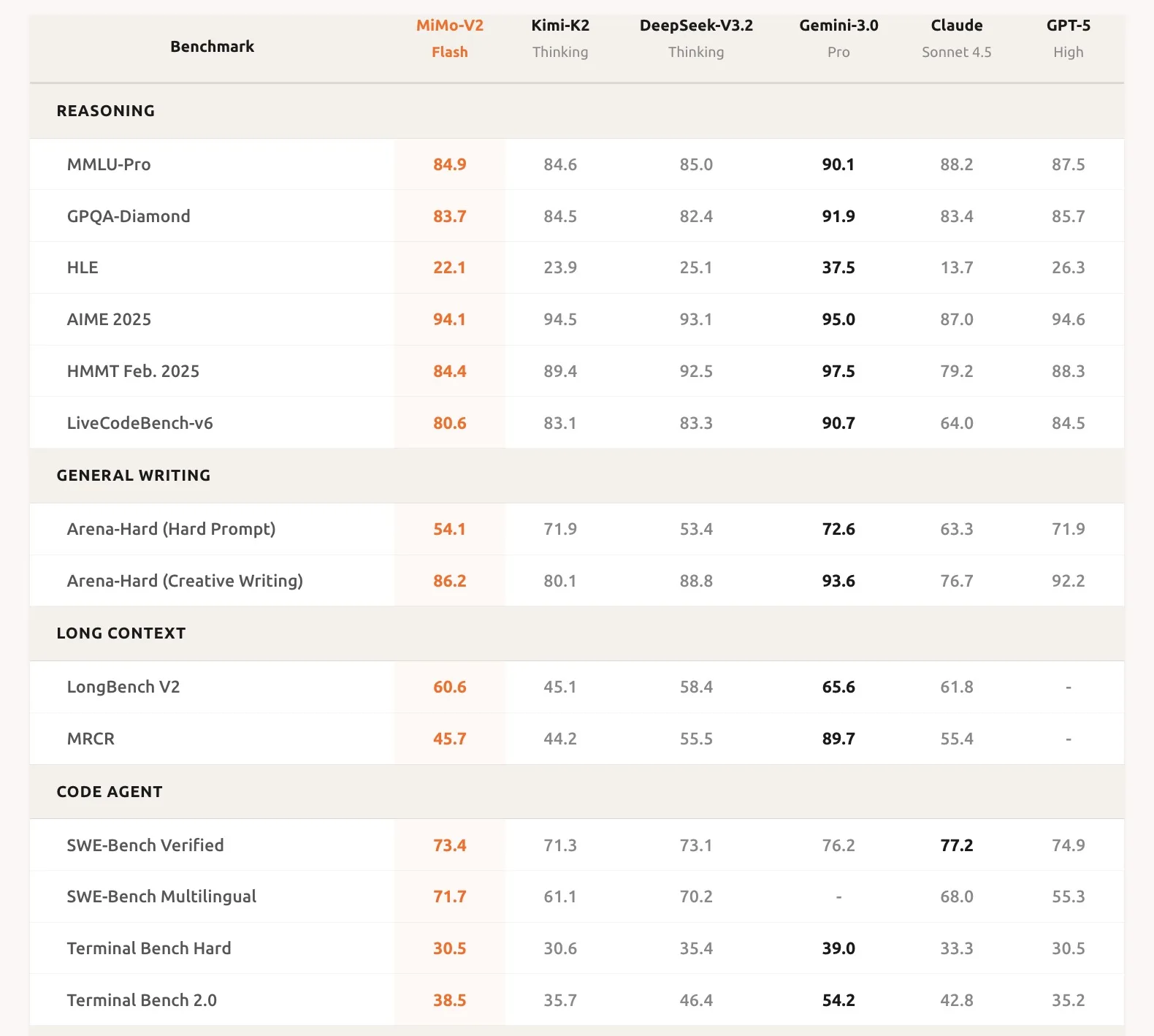

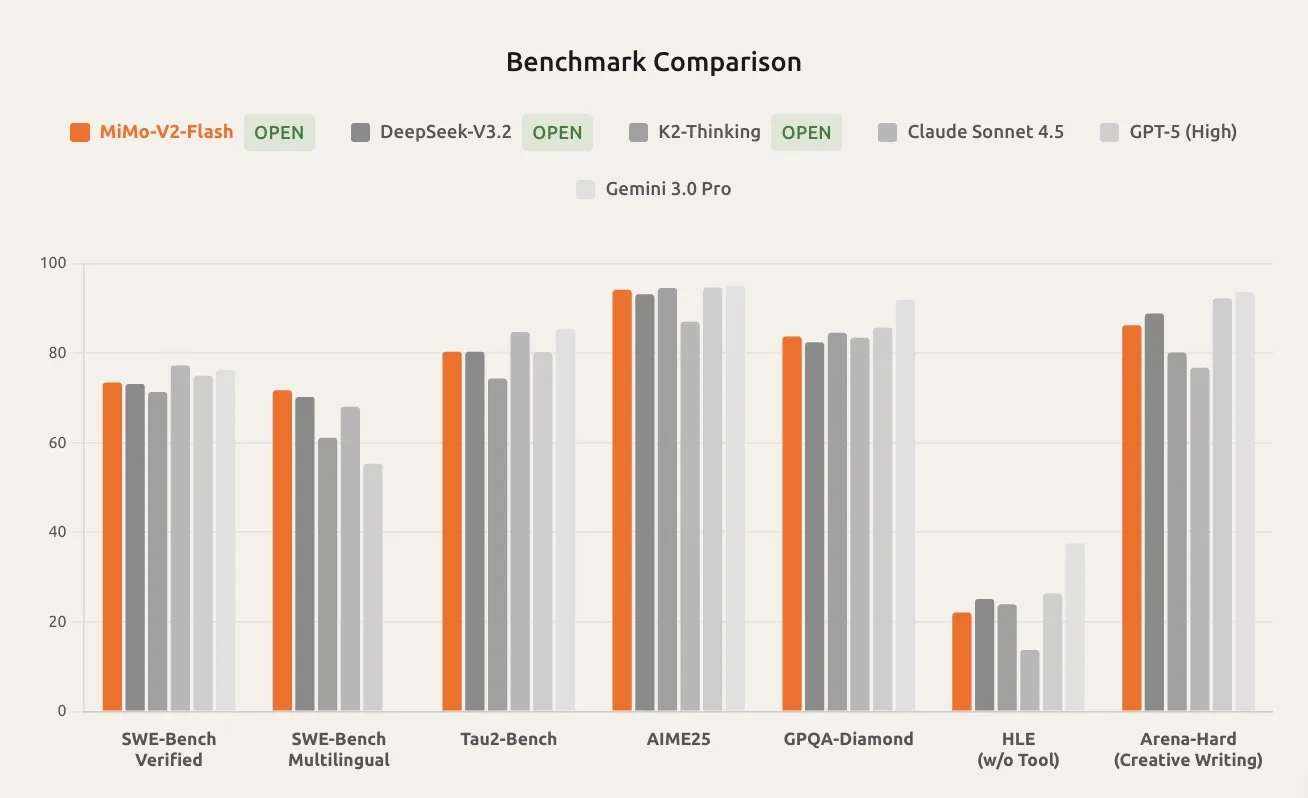

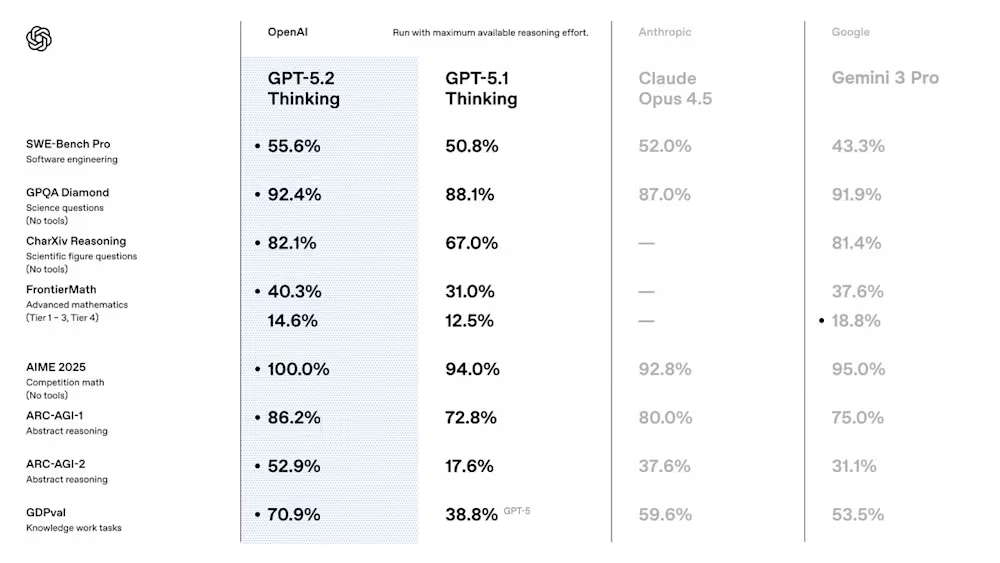

GPT-5.2-Codex établit de nouveaux standards sur les benchmarks les plus exigeants du secteur. Sur SWE-Bench Pro, référence pour l’évaluation de correctifs sur de véritables dépôts logiciels, le modèle atteint 56,4 % de réussite, dépassant : GPT-5.2 (55,6 %) et GPT-5.1 (50,8 %).

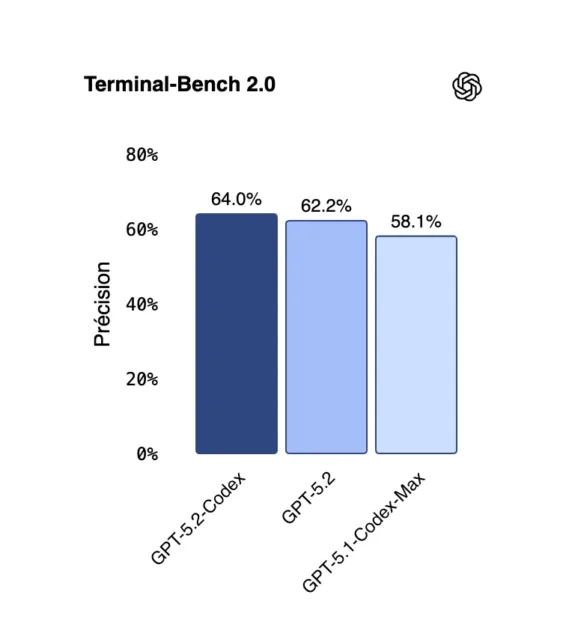

Sur Terminal-Bench 2.0, qui mesure la capacité d’un agent à travailler dans de vrais environnements système (compilation, serveurs, entraînement de modèles), GPT-5.2-Codex atteint 64 %, contre 62,2 % pour GPT-5.2.

Ces gains ne sont pas anecdotiques : ils traduisent une meilleure capacité à maintenir une cohérence sur des tâches longues, à corriger des erreurs sans perdre le fil, et à s’adapter lorsque les plans initiaux échouent — un point critique pour les projets industriels.

Conçu pour les bases de code gigantesques

L’un des apports majeurs de GPT-5.2-Codex réside dans sa compaction native du contexte. Contrairement aux générations précédentes, le modèle conserve l’essentiel des décisions, hypothèses et contraintes sur des sessions très longues, sans explosion des coûts en tokens.

Résultat : refactorisations massives plus fiables, migrations complètes de frameworks ou de langages, et ajout de fonctionnalités complexes sans perte de cohérence.

Les capacités visuelles ont également été renforcées. GPT-5.2-Codex interprète avec précision : captures d’écran, diagrammes techniques, maquettes UI, ou encore graphiques et tableaux. Il peut ainsi transformer une maquette en prototype fonctionnel, puis accompagner son passage en production.

Un saut qualitatif majeur en cybersécurité

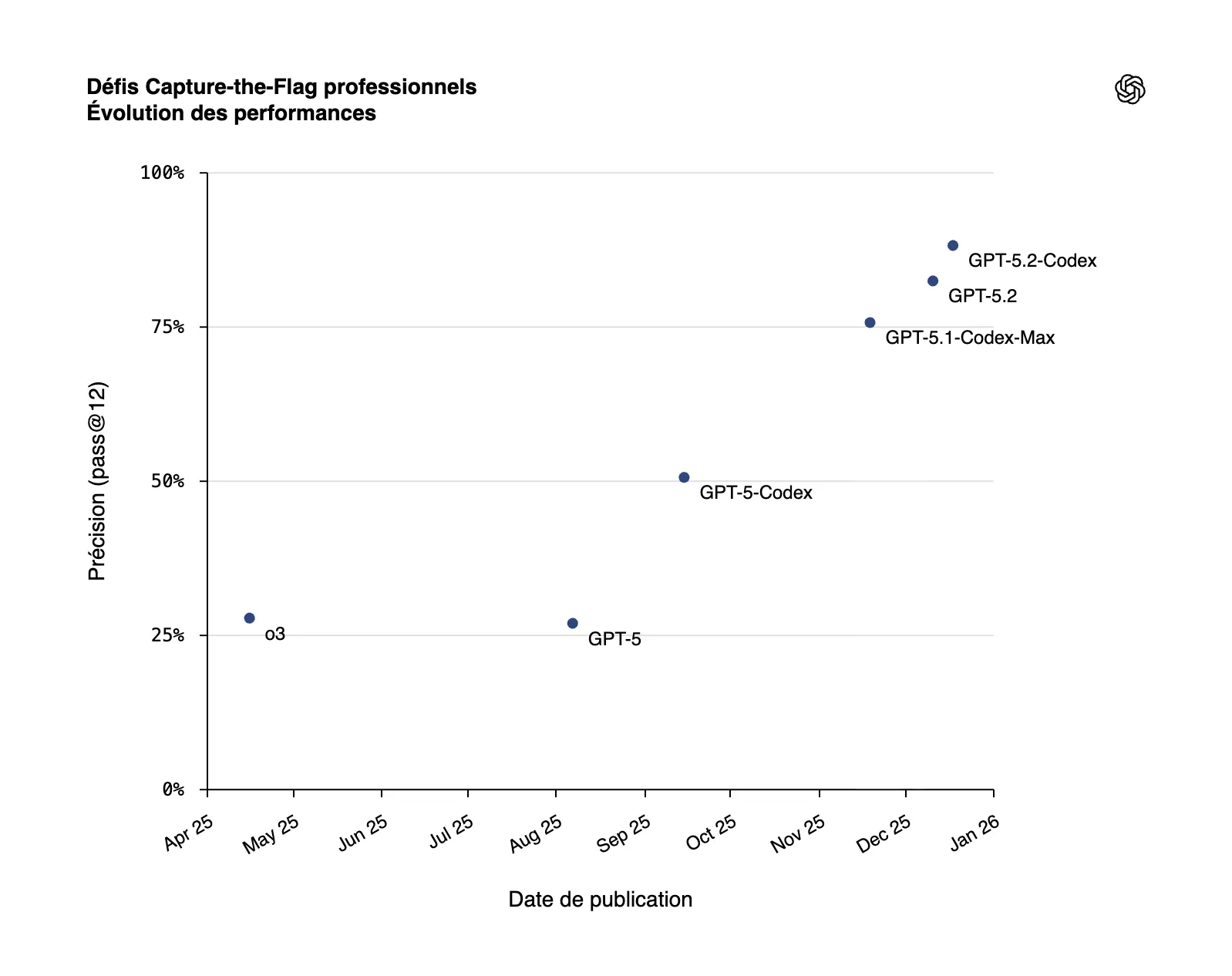

La progression la plus sensible concerne la cybersécurité défensive. GPT-5.2-Codex affiche des performances nettement supérieures lors des évaluations de type Capture-the-Flag professionnel, avec des taux de réussite très au-dessus de GPT-5, GPT-5.1-Codex-Max ou o3.

OpenAI précise toutefois que le modèle ne franchit pas encore le seuil « High » de son Preparedness Framework, justifiant le maintien de garde-fous stricts.

Un exemple concret illustre cette montée en puissance : en décembre 2025, Andrew MacPherson, ingénieur sécurité chez Privy (filiale de Stripe), a utilisé GPT-5.1-Codex-Max via Codex CLI pour analyser la vulnérabilité React2Shell. En guidant l’IA à travers des workflows défensifs classiques (fuzzing, analyse des surfaces d’attaque, environnements de test), il a mis au jour trois nouvelles failles critiques dans React Server Components, rapidement corrigées après divulgation responsable.

Ce cas démontre le potentiel de ces modèles pour renforcer la sécurité des infrastructures critiques (banques, santé, télécoms), tout en soulignant leur caractère dual-use.

Une gestion prudente des risques d’usage détourné

Consciente du danger que représente une IA aussi puissante entre de mauvaises mains, OpenAI adopte une stratégie de déploiement contrôlé.

En parallèle du lancement public pour les abonnés payants ChatGPT, l’entreprise inaugure un programme « Trusted Access » sur invitation. Celui-ci s’adresse aux chercheurs et organisations en cybersécurité disposant d’un historique de divulgation responsable, afin de leur donner accès à des capacités avancées pour :

- analyse de malwares,

- red teaming,

- tests de résilience d’infrastructures.

L’objectif : maximiser l’impact défensif tout en limitant les abus.

Un tournant stratégique pour OpenAI

GPT-5.2-Codex est désormais disponible sur l’ensemble des surfaces Codex : CLI, extensions IDE, web, mobile et revues de code GitHub. L’accès API est prévu dans les semaines à venir, après validation des derniers garde-fous de sécurité.

En interne, OpenAI utilise déjà ses propres modèles Codex pour développer et améliorer ses outils — une boucle vertueuse où l’IA contribue à construire l’IA.

Face à Gemini 3 et à l’accélération du secteur, OpenAI fait un choix clair : moins de promesses grand public, plus d’outils ultra-spécialisés pour les professionnels.

Une nouvelle ère pour le développement et la cyberdéfense

Avec GPT-5.2-Codex, l’IA ne se contente plus d’assister ponctuellement les développeurs. Elle devient un véritable agent logiciel, capable d’opérer sur des systèmes complexes, d’anticiper des failles et de sécuriser des architectures critiques.

Reste une question centrale : jusqu’où ces agents pourront-ils aller avant de redéfinir entièrement la frontière entre outil, collaborateur et risque systémique ?

GPT-5.2-Codex apporte une première réponse — impressionnante, mais encore prudemment encadrée.