Amazon pourrait bientôt sérieusement rivaliser avec Nvidia dans le domaine des puces d’IA. En effet, le géant du e-commerce ambitionne de lancer ses propres puces sur le marché, afin de réduire sa dépendance vis-à-vis de Nvidia et de renforcer sa position dans le secteur de l’intelligence artificielle.

C’est Annapurna Labs, la société qu’Amazon a acquise en 2015 pour 350 millions de dollars, qui mène ce projet. Annapurna est connue pour ses contributions à Amazon Web Services (AWS), notamment avec sa technologie de gestion des machines virtuelles, Nitro, et ses puces Graviton, une alternative ARM à faible consommation pour les processeurs de serveurs, en concurrence avec AMD et Intel.

Le dernier développement d’Annapurna, le Trainium 2, marque un tournant pour Amazon. Cette puce, dévoilée en 2023, est spécialement conçue pour accélérer l’entraînement des modèles d’IA dans l’écosystème AWS, avec des performances supposées quatre fois supérieures à celles de la première version lancée en 2020.

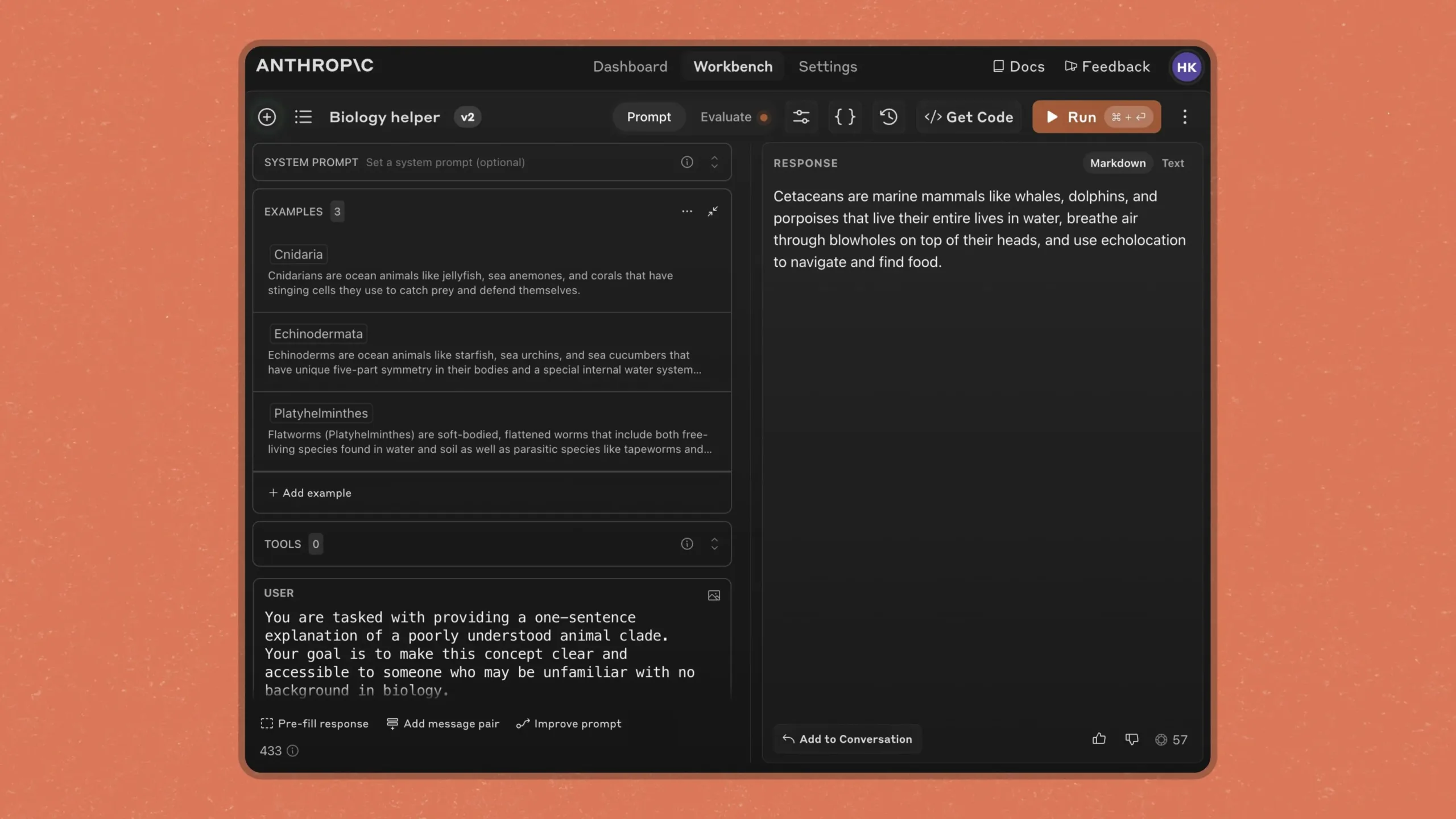

Actuellement, Anthropic, la société derrière l’IA Claude, concurrente de ChatGPT, teste le Trainium 2. Cette collaboration s’inscrit dans un partenariat de 4 milliards de dollars entre Amazon et Anthropic, visant à encourager l’utilisation des nouvelles puces d’Amazon pour l’entraînement des modèles IA, même si la préférence de l’entreprise va à Nvidia.

Amazon trying to feed its investment dollars directly back into Amazon Web Services and force Anthropic to use their chips instead of NVIDIA. Just incredible levels of financial manipulation, 100% sure they book this as revenue https://t.co/S0K97g6YIe pic.twitter.com/r0N8x02hXi

— Ed Zitron (@edzitron) November 7, 2024

Un choix stratégique d’Amazone pour réduire les coûts et gagner en autonomie

En s’affranchissant de Nvidia, Amazon espère réduire les coûts de production et d’exploitation de ses services cloud. Selon Dave Brown, vice-président des services de calcul et de mise en réseau chez AWS, les économies générées par ce changement pourraient être colossales : « Lorsque vous économisez 40 % sur quelques milliers de dollars, l’impact reste limité. Mais quand vous économisez 40 % sur des dizaines de millions de dollars, le choix est clair ».

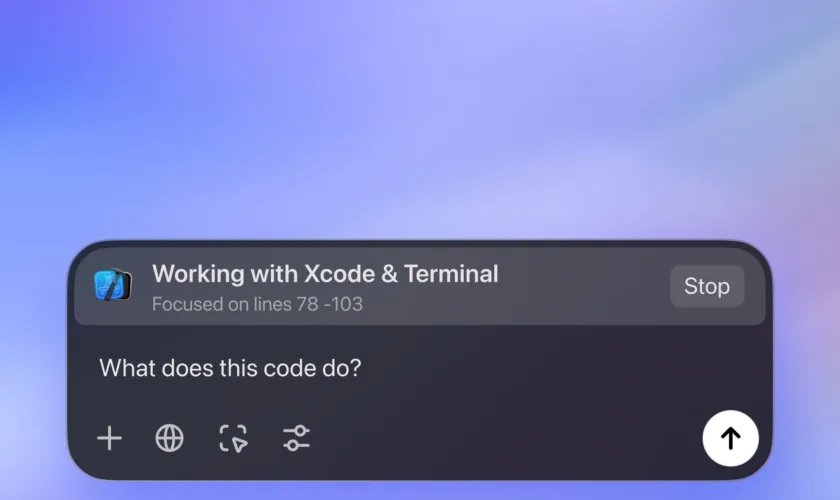

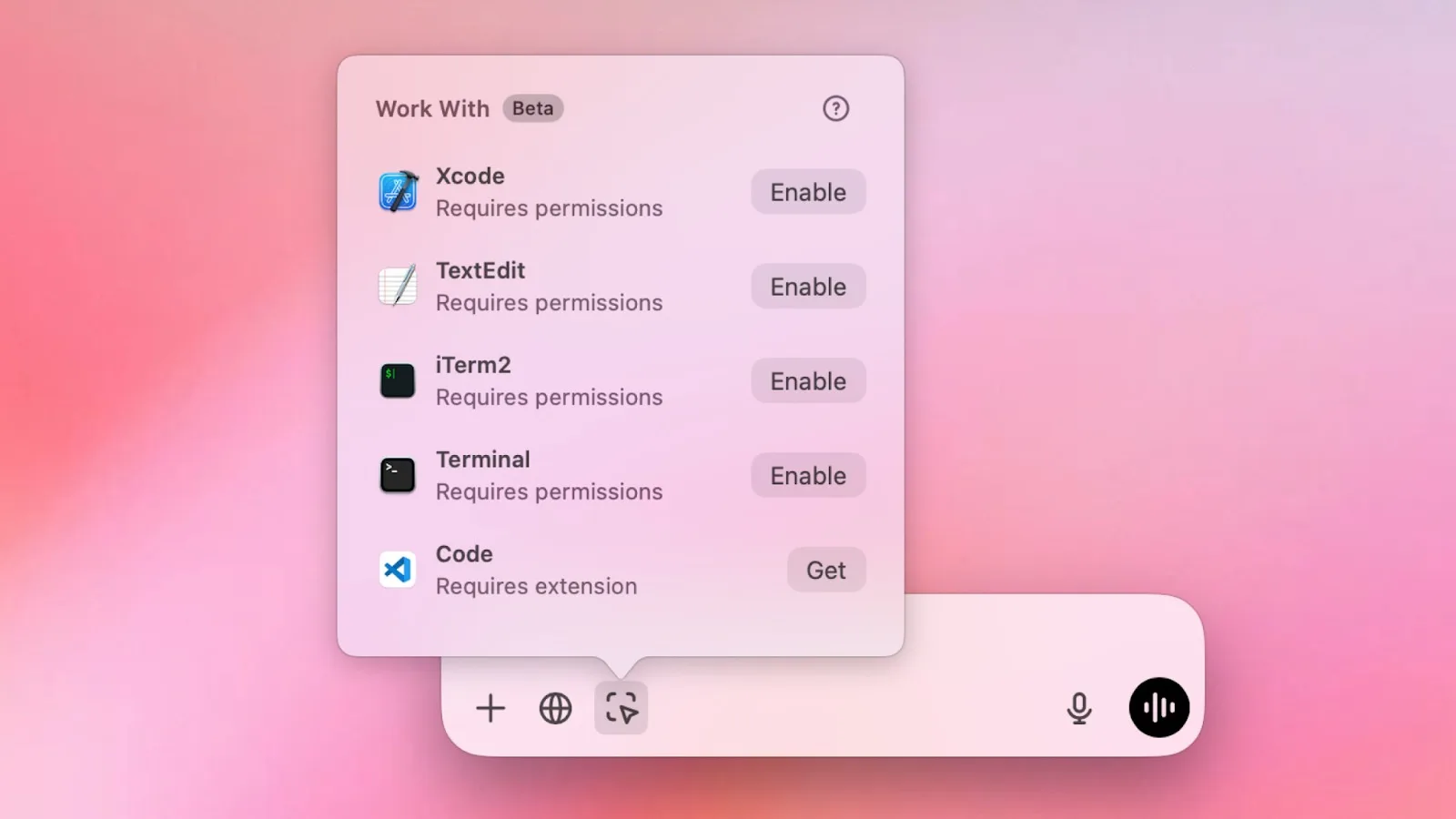

Ce mouvement s’inscrit dans une tendance observée chez plusieurs grandes entreprises technologiques qui cherchent à reprendre le contrôle sur leurs propres puces. Apple a ouvert la voie en écartant Intel de ses ordinateurs en 2020, développant ses propres processeurs de série M pour Mac. Ces puces M, conçues en interne, se sont imposées comme des références sur le marché, notamment avec le modèle M4, optimisé pour les applications d’intelligence artificielle.

Des investissements massifs dans la course à l’IA

Cependant, Amazon et ses concurrents doivent augmenter considérablement leurs dépenses pour rester compétitifs dans cette course à l’IA. En 2023, Amazon a dépensé 48 milliards de dollars, un chiffre qui pourrait atteindre 75 milliards de dollars en 2024. De son côté, Microsoft a multiplié ses dépenses pour l’infrastructure AI, passant de 10,7 milliards de dollars en 2023 à 56 milliards de dollars en août 2024.

Au-delà de la course aux meilleures puces d’IA, Amazon et les autres géants de la technologie font face aux défis d’infrastructure, notamment en matière de centres de données et de capacité énergétique. Amazon prévoit d’investir environ 150 milliards de dollars dans ses infrastructures de centres de données au cours des quinze prochaines années pour répondre aux besoins croissants de l’IA.

En s’engageant dans le développement de ses propres puces, Amazon entend non seulement gagner en efficacité mais aussi se positionner comme un leader indépendant dans l’IA, sans dépendre exclusivement de Nvidia. Avec Trainium 2, Amazon espère franchir un cap dans la performance de ses services d’IA et poursuivre son expansion dans un marché de plus en plus concurrentiel.