L’IA a besoin de puissance de calcul, donc d’électricité. Beaucoup d’électricité. Et à mesure que les datacenters deviennent le vrai nerf de la guerre, OpenAI semble regarder bien au-delà des contrats énergétiques classiques.

Selon Axios, OpenAI serait en discussions avancées avec Helion Energy pour acheter de l’électricité issue de la fusion nucléaire — à une échelle tout simplement vertigineuse.

Un projet hors norme, encore au stade des discussions

D’après Axios, le cadre discuté prévoirait pour OpenAI l’équivalent de 5 gigawatts d’ici 2030, puis 50 gigawatts à l’horizon 2035, avec une garantie initiale portant sur 12,5 % de la production d’Helion. Reuters a confirmé l’existence de discussions avancées et la structure générale du projet, tout en précisant que plusieurs conditions clés restent non remplies, notamment le choix du site où Helion produirait cette électricité. OpenAI, de son côté, n’a pas commenté publiquement.

À ce niveau, le simple ordre de grandeur suffit à mesurer l’ambition. Helion a annoncé en 2023 un accord avec Microsoft pour fournir au moins 50 MW à partir de sa première centrale, puis a indiqué en 2025 travailler avec Nucor sur une centrale de 500 MW pour les années 2030.

Le projet évoqué avec OpenAI ferait donc changer Helion de dimension, en passant du mégawatt au gigawatt.

La vraie question : Helion peut-elle livrer une telle puissance ?

Helion affirme que chacun de ses futurs réacteurs doit produire environ 50 MW. Si l’on suit cette hypothèse, atteindre 5 GW supposerait environ 100 réacteurs ; atteindre 50 GW en nécessiterait dix fois plus. C’est précisément ce qui rend ce dossier fascinant sur le plan industriel — et extrêmement fragile sur le plan de l’exécution. Cette lecture relève d’une inférence à partir des chiffres publics d’Helion, mais elle donne une idée claire du saut de production implicite.

Le verrou fondamental reste d’ailleurs inchangé : Helion n’a pas encore démontré une production commerciale nette d’électricité sur le réseau. Axios souligne que la concrétisation d’un tel accord dépendra notamment de la capacité de l’entreprise à atteindre un jalon encore non démontré autour de la production nette d’électricité. Autrement dit, OpenAI discuterait moins d’un approvisionnement classique que d’un pari sur une technologie qui n’a pas encore fait ses preuves à l’échelle commerciale.

Pourquoi Helion attire malgré tout ?

Helion n’est pas une inconnue. Fondée en 2013 à Everett, dans l’État de Washington, par David Kirtley, John Slough, Chris Pihl et George Votroubek, la société a levé plus d’1 milliard de dollars au total. Sa série F de 425 millions de dollars, annoncée en janvier 2025, l’a valorisée à 5,425 milliards de dollars post-money. Parmi les investisseurs figuraient notamment Lightspeed Venture Partners, SoftBank Vision Fund 2 et un grand endowment universitaire, aux côtés de soutiens existants comme Sam Altman.

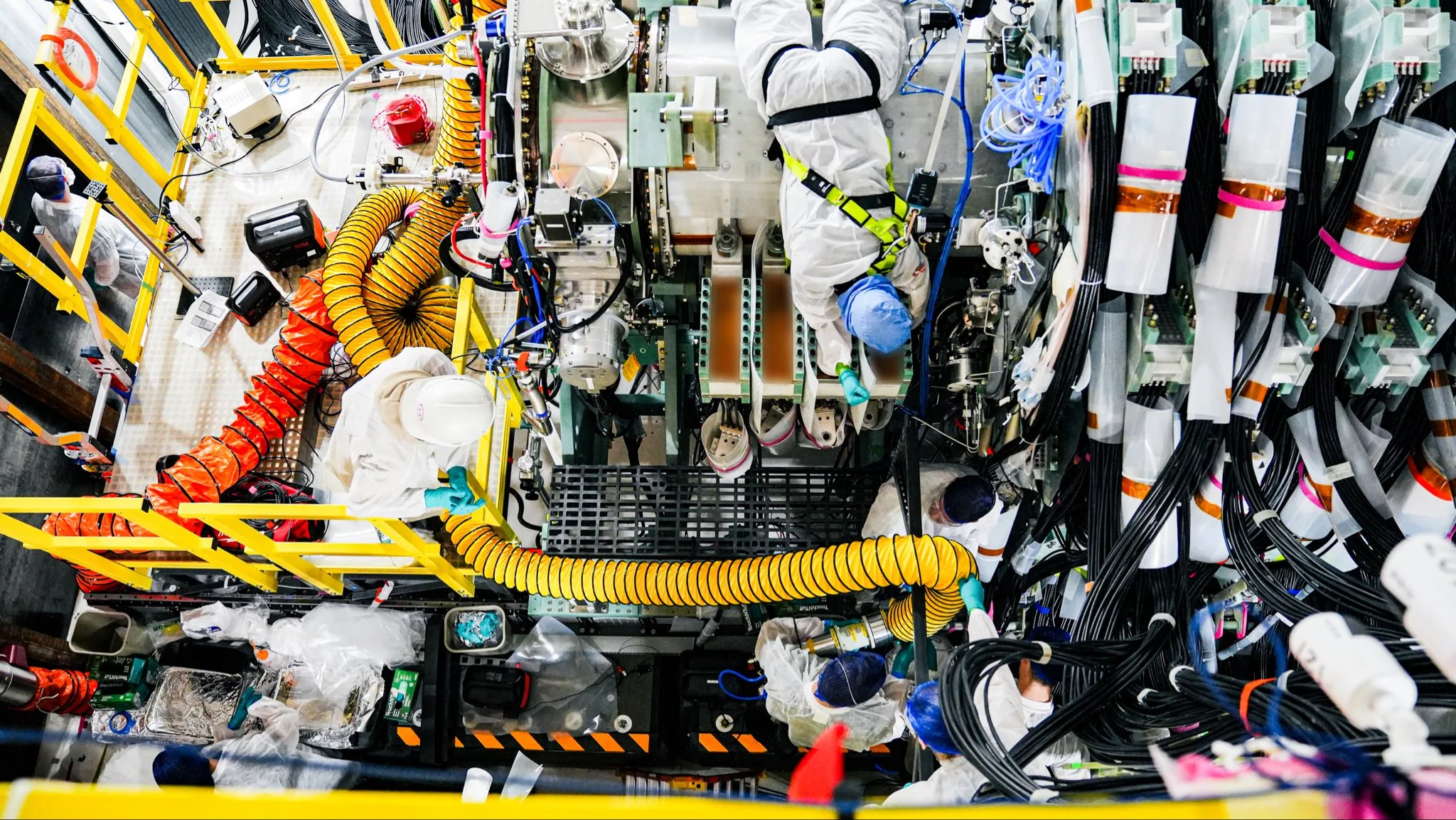

La startup a aussi revendiqué en février 2026 un nouveau jalon technique : sa machine Polaris a atteint 150 millions de degrés Celsius et est devenue, selon l’entreprise, la première machine privée de fusion à fonctionner avec du combustible deutérium-tritium. Ce n’est pas encore une validation commerciale, mais c’est le type d’avancée qui entretient la crédibilité technique du projet.

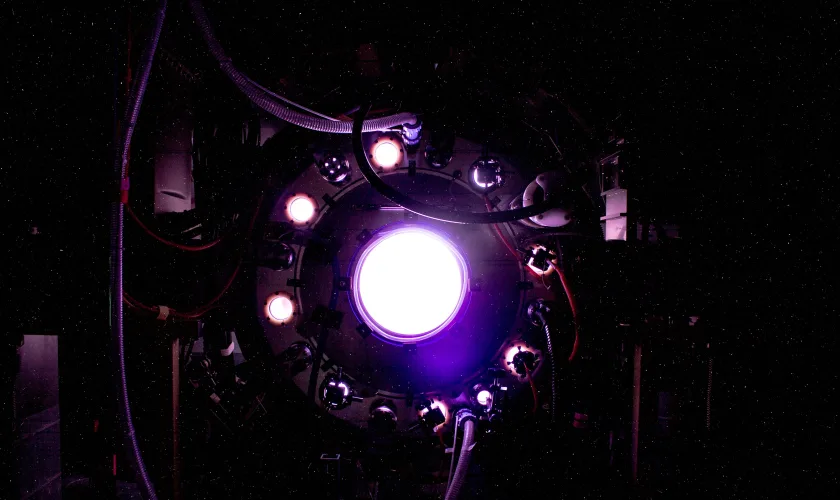

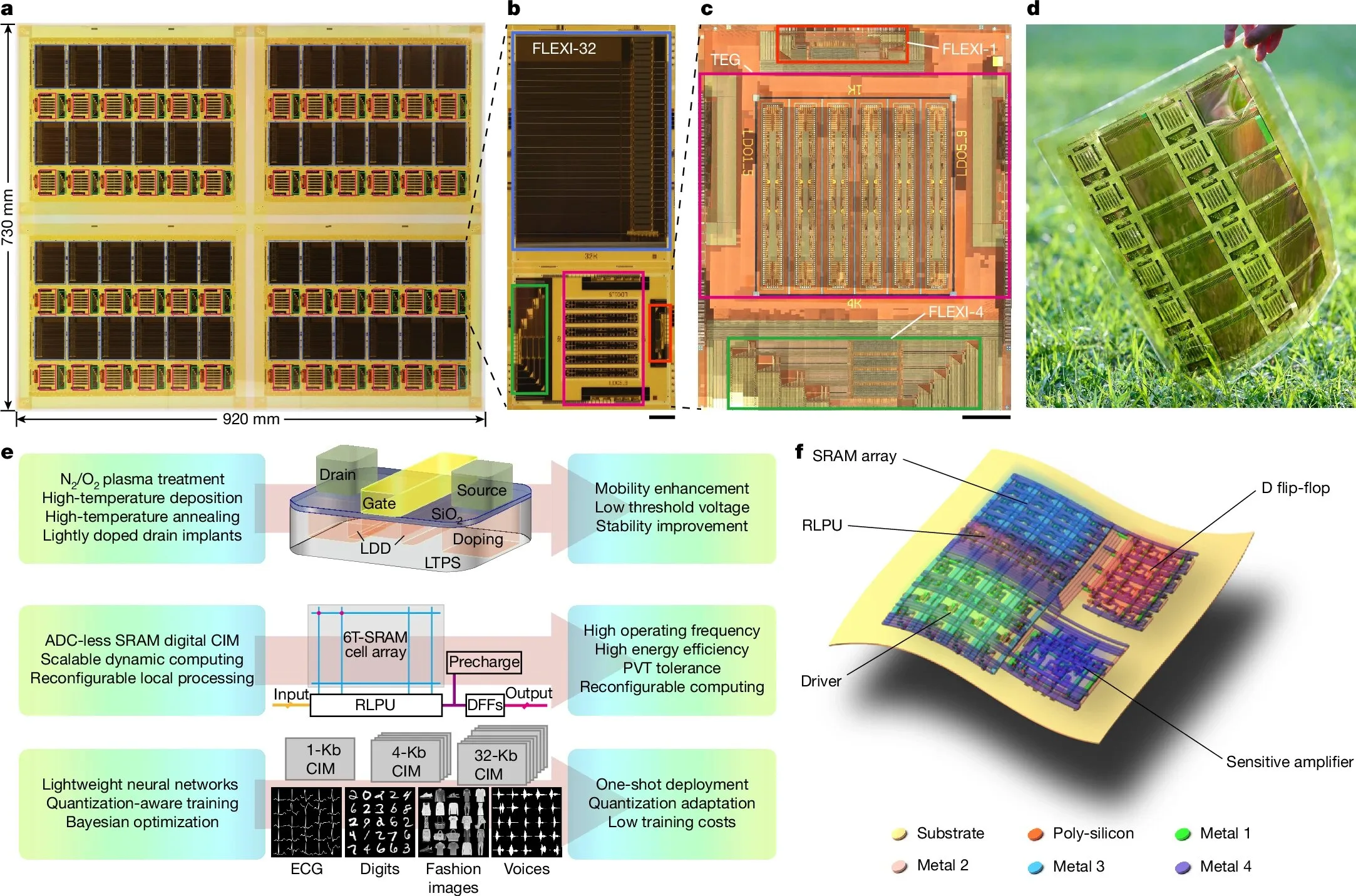

Sur le plan technologique, Helion se distingue de nombreux concurrents. Là où beaucoup de projets de fusion misent sur la chaleur produite pour alimenter une turbine à vapeur, Helion affirme vouloir récupérer directement l’électricité par induction électromagnétique, en court-circuitant le cycle thermique classique. L’entreprise présente cette architecture comme plus simple et plus efficace, avec moins de pièces mobiles.

En toile de fond, l’explosion des besoins énergétiques de l’IA

Ce dossier raconte aussi quelque chose de plus large : les entreprises d’IA ne cherchent plus seulement des puces, elles cherchent des électrons. Reuters rappelle que Microsoft, Google et Amazon ont déjà multiplié les accords avec des acteurs du nucléaire ou de la fusion, signe que l’énergie devient un actif stratégique aussi critique que le silicium. Dans ce contexte, l’intérêt d’OpenAI pour Helion n’a rien d’anecdotique : il s’inscrit dans une course plus vaste pour sécuriser des capacités électriques massives et décarbonées.

La comparaison est éclairante : Helion a déjà un accord avec Microsoft, tandis qu’Axios note que Google a signé de son côté un accord de 200 MW avec Commonwealth Fusion Systems, l’un des rivaux d’Helion. Le marché de la fusion reste embryonnaire, mais il commence déjà à se structurer autour des géants de la tech.

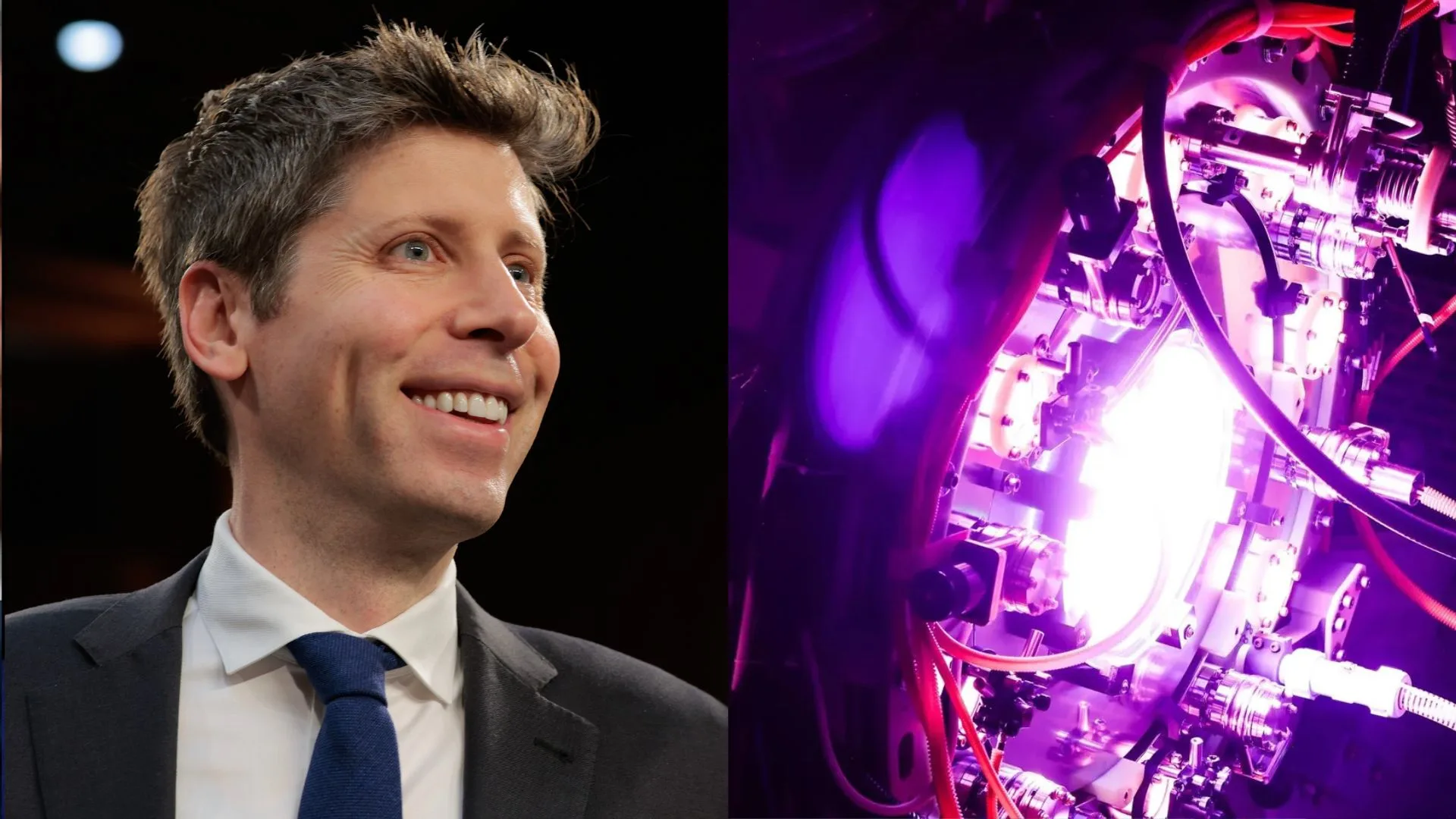

Sam Altman se retire, mais la question de gouvernance reste centrale

L’autre dimension sensible de l’affaire concerne évidemment Sam Altman. Sam Altman est présenté comme le plus grand investisseur individuel d’Helion. Il a dirigé son tour de table de 500 millions de dollars en 2021 et occupait la présidence du conseil depuis 2015. Axios et Reuters rapportent désormais qu’il a quitté le conseil d’administration d’Helion et s’est récusé des discussions entre Helion et OpenAI.

Le geste n’est pas isolé. En avril 2025, Altman avait déjà quitté la présidence d’Oklo afin d’éviter un conflit d’intérêts et de permettre à OpenAI d’explorer d’éventuels accords énergétiques avec cette autre société nucléaire. Bloomberg et Reuters avaient alors expliqué ce retrait précisément en ces termes.

Cette fois, OpenAI semble vouloir formaliser davantage la séparation entre les intérêts personnels d’Altman et ceux de l’entreprise. Le signal est important, car la question avait déjà été soulevée lors de l’accord Helion-Microsoft en 2023, alors qu’Altman se trouvait déjà au croisement de plusieurs relations commerciales potentiellement sensibles.

Un accord potentiellement historique, mais encore loin d’être acquis

Sur le papier, l’histoire est puissante : l’un des leaders mondiaux de l’IA sécuriserait une part massive de son futur approvisionnement électrique auprès d’un champion de la fusion soutenu par son propre patron. Dans les faits, on en est encore à une architecture de discussion, avec des conditions suspendues, une technologie non encore démontrée à l’échelle commerciale et des volumes qui relèvent presque de la planification industrielle d’un État.

C’est précisément ce qui rend ce dossier si révélateur de la nouvelle époque tech. L’IA ne se contente plus de réorganiser le logiciel ; elle commence à redessiner la carte de l’énergie. Et dans cette bataille, OpenAI ne cherche visiblement pas seulement à acheter de l’électricité : l’entreprise tente peut-être déjà de réserver une part du futur.