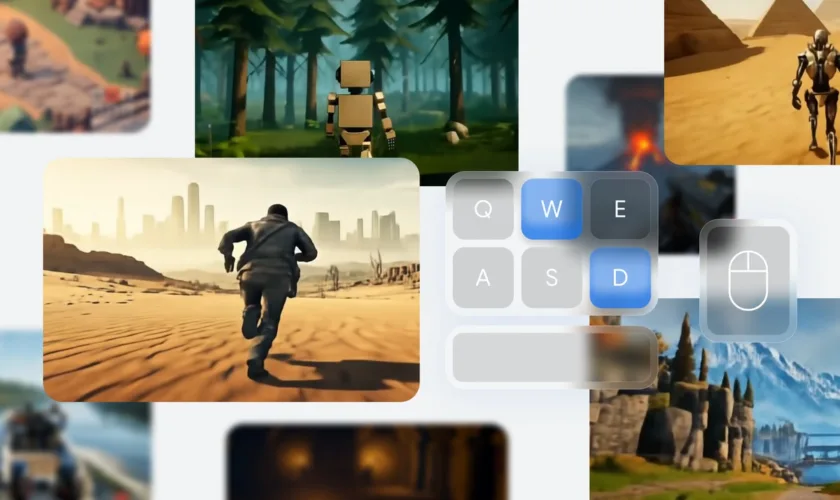

Google vient de déployer une nouvelle mise à jour de son assistant IA Gemini, et elle risque de faire beaucoup parler d’elle. Désormais, les utilisateurs abonnés aux offres Google AI Ultra et Pro peuvent transformer une simple image en clip vidéo animé, avec sons d’ambiance, dialogues et bruitages générés par IA.

Cette fonctionnalité repose sur le modèle Veo 3, déjà au cœur de l’outil de création vidéo Flow, lancé en mai dernier lors de la Google I/O 2025. Aujourd’hui, cette technologie s’invite directement dans Gemini, rendant l’animation de photos bien plus accessible.

De la photo fixe à la vidéo vivante

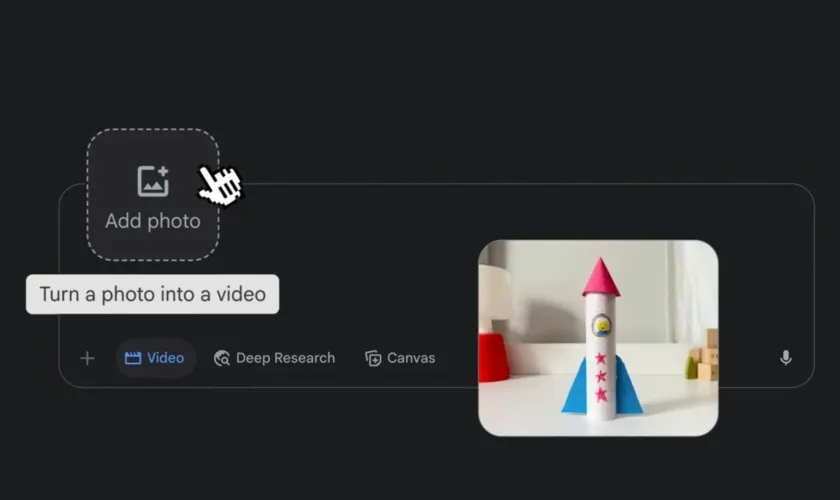

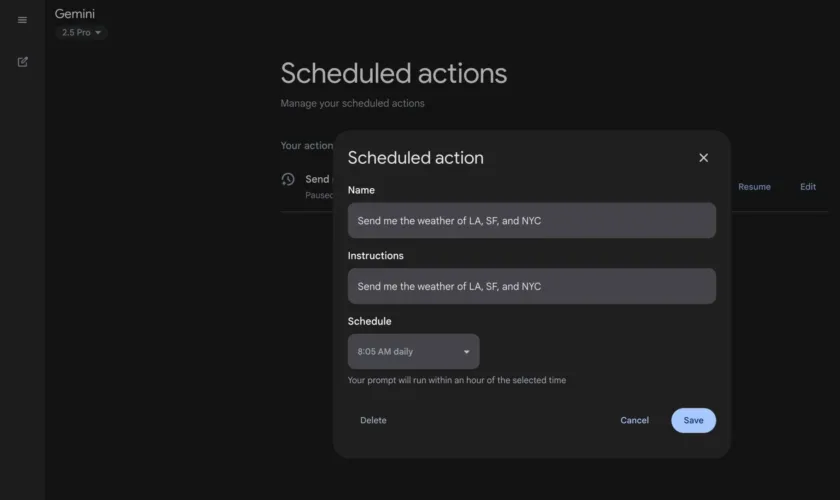

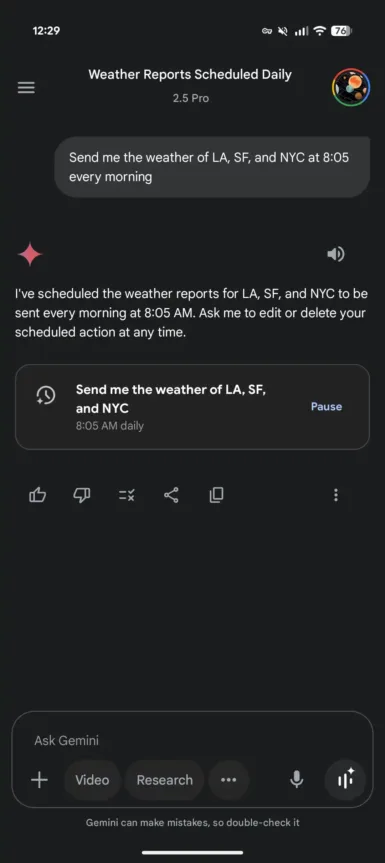

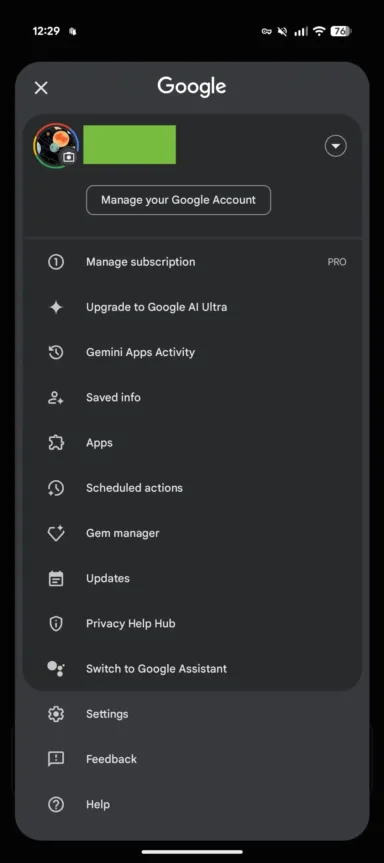

La nouvelle option de génération de vidéos à partir de photos permet de créer des clips de 8 secondes à partir d’une image et d’un prompt textuel. L’utilisateur n’a qu’à :

- Ouvrir Gemini sur le web ou mobile,

- Cliquer sur « Outils » dans la barre de prompt,

- Sélectionner « Vidéo »,

- Importer une photo,

- Ajouter une description du mouvement souhaité, et éventuellement, une ambiance sonore (voix, bruitage, musique…).

L’IA s’occupe ensuite de générer une vidéo au format MP4, en 720p et format paysage 16:9, accompagnée d’une bande-son synchronisée avec l’image.

Un son généré par IA, parfaitement synchronisé

Outre le mouvement des éléments présents sur l’image, Gemini est désormais capable de générer des sons de manière contextuelle : bruit du vent, sons de pas, dialogues ou musique d’ambiance peuvent être ajoutés selon la description fournie.

« Tous les éléments audio sont synchronisés parfaitement avec les visuels générés », précise Google dans son communiqué.

Accessibilité et conditions d’utilisation

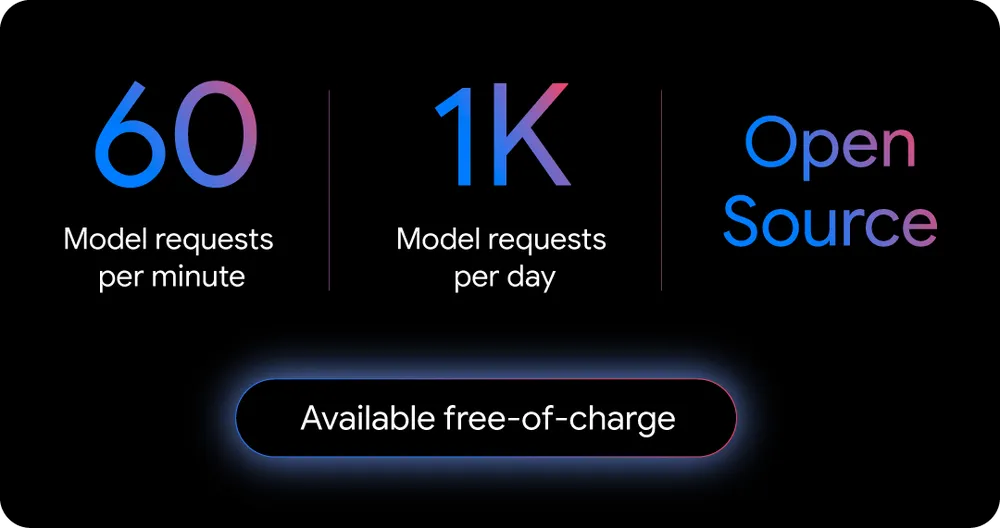

Pour le moment, cette fonctionnalité est limitée aux utilisateurs des offres payantes Gemini AI Pro et AI Ultra, dans certaines régions (la France devrait être concernée d’ici peu). Google limite également à 3 créations vidéo par jour, sans report des quotas.

Toutes les vidéos générées comprennent deux éléments d’identification :

- Un filigrane visible portant la mention « Veo » ;

- Un filigrane numérique invisible via la technologie SynthID, développée par Google DeepMind, pour identifier les contenus générés par IA.

Flow étendu à 75 nouveaux pays

En parallèle, Google annonce également que son outil de création vidéo Flow (également basé sur Veo 3) devient disponible dans 75 nouveaux pays, renforçant sa volonté de démocratiser la production vidéo assistée par IA.

Depuis son lancement il y a à peine sept semaines, plus de 40 millions de vidéos ont déjà été générées via Gemini et Flow, selon Google.

Un outil créatif pour tous

Avec cette nouvelle fonctionnalité, Google propose aux utilisateurs de donner vie à leurs photos, mais aussi à leurs dessins, peintures ou créations artistiques, ouvrant la voie à de nouvelles pratiques pour :

- les créateurs de contenus,

- les artistes numériques,

- les enseignants,

- ou encore les marketeurs à la recherche de visuels animés rapidement réalisables.

Google franchit une nouvelle étape dans l’intégration de l’IA générative au cœur des usages quotidiens. Pouvoir transformer une simple photo en une vidéo animée avec son, sans compétences techniques, est une avancée majeure pour le grand public comme pour les professionnels.

Reste à voir si ces outils resteront réservés aux abonnés payants ou s’ils seront un jour accessibles plus largement. Quoi qu’il en soit, la vidéo générative est bien là, et elle ne fait que commencer à se démocratiser.