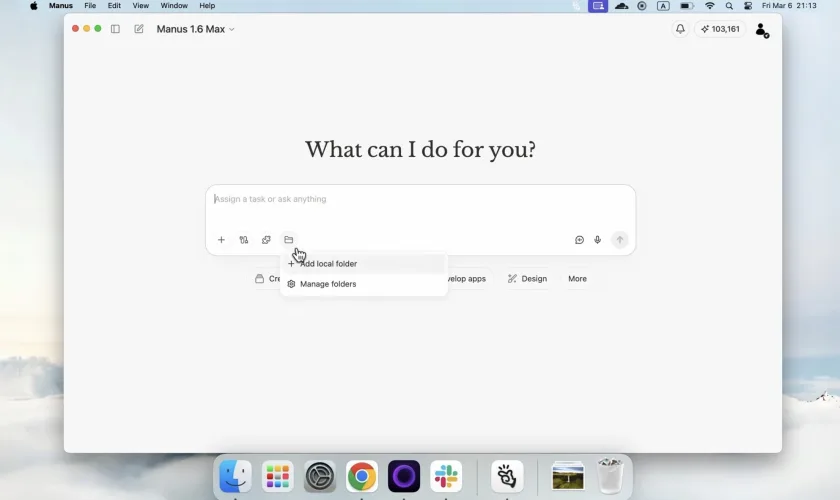

Meta pousse un peu plus loin sa stratégie agentique. Trois mois après le rachat de Manus, la startup désormais intégrée au groupe a lancé une application de bureau pour macOS et Windows, avec une fonction centrale baptisée My Computer.

Le principe est simple sur le papier, mais ambitieux dans l’exécution : décrire une tâche en langage naturel, puis laisser l’agent agir sur les fichiers, les outils et les applications locales de la machine.

Un Manus qui sort du cloud pour entrer dans le poste de travail

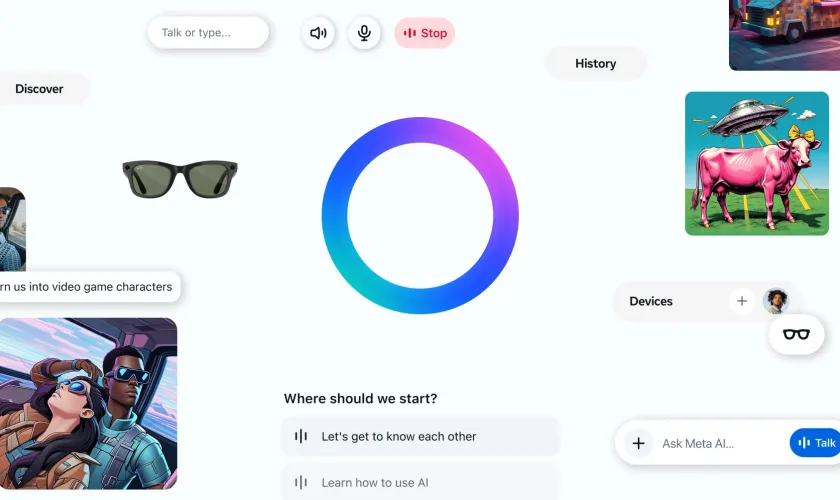

Jusqu’ici, Manus fonctionnait surtout comme un agent dans le cloud. Avec My Computer, il passe sur la machine de l’utilisateur et peut lire des fichiers locaux, exécuter des commandes Terminal, lancer des apps et interagir avec l’espace de travail directement depuis le bureau. L’interface ressemble à un chatbot classique, avec une zone de prompt et la possibilité d’ajouter des fichiers ou des dossiers, mais la promesse dépasse largement la simple conversation.

Manus explique, par exemple, qu’on peut déposer un dossier entier et demander à l’agent de l’organiser. Dans sa démo officielle, l’entreprise montre le cas d’un fleuriste qui importe des milliers de photos non triées, puis laisse l’IA les classer en catégories comme bouquets, compositions de mariage ou décorations.

L’automatisation locale devient le vrai sujet

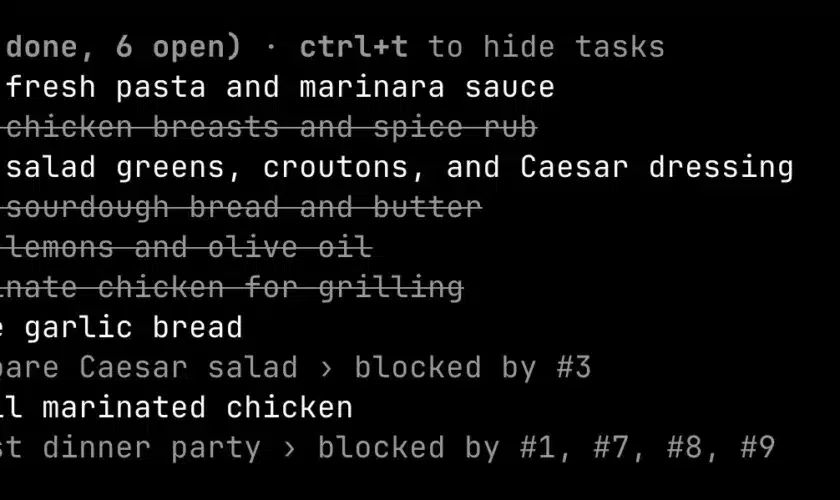

Le point le plus intéressant n’est pas seulement ce que Manus fait, mais où il le fait. En passant du cloud au poste local, l’agent se rapproche du vrai travail quotidien : dossiers, apps ouvertes, commandes système, fichiers à déplacer, documents à envoyer. Manus met aussi en avant l’intégration avec ses projets, ses agents et ses tâches planifiées, pour automatiser des routines récurrentes, comme ranger le dossier Téléchargements ou générer un rapport local chaque semaine.

Cette bascule compte, car elle transforme l’agent IA en couche d’orchestration du poste de travail, et pas seulement en assistant conversationnel.

Meta veut rassurer sur le contrôle

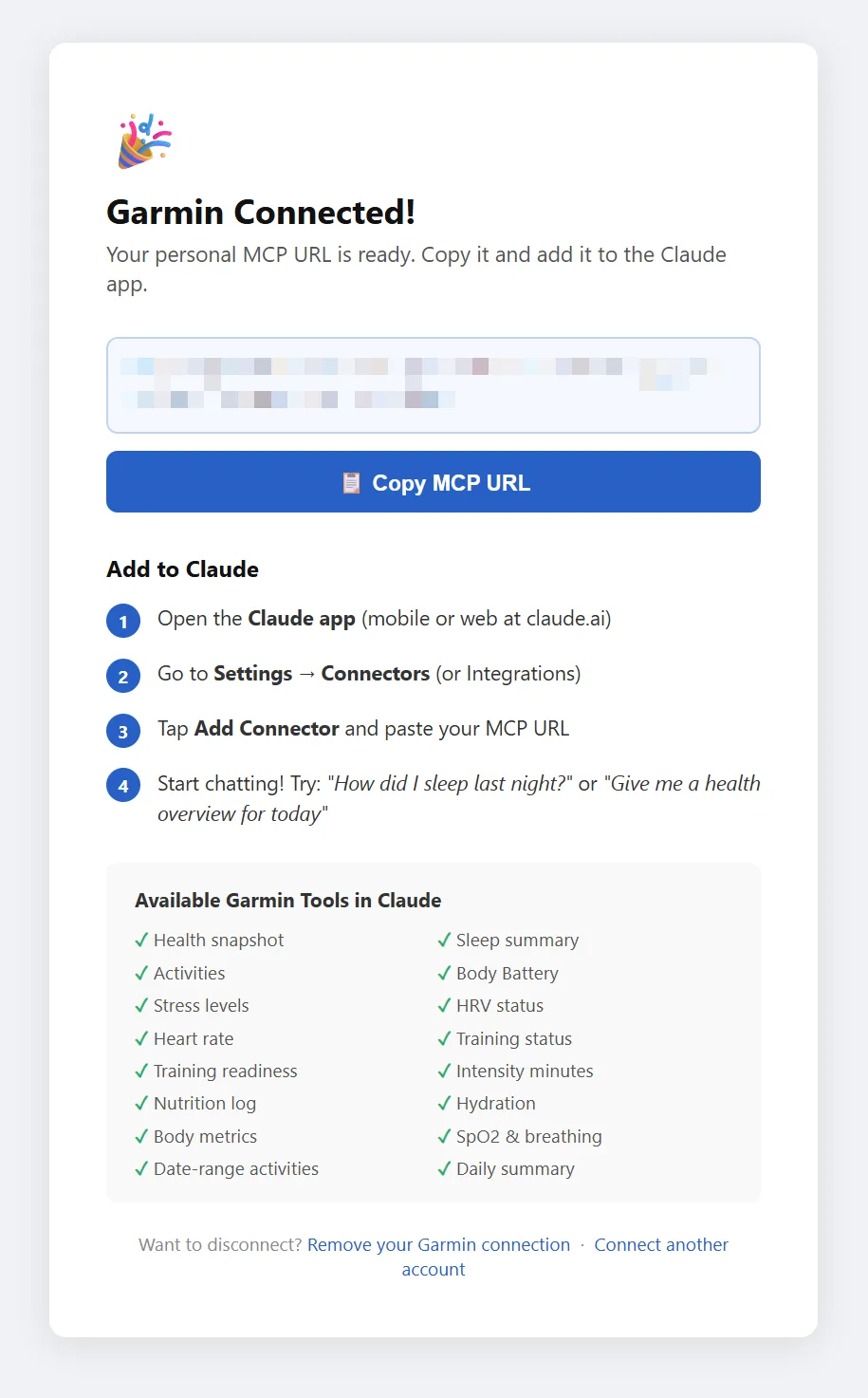

Évidemment, ce type d’outil soulève immédiatement une question de confiance. Manus insiste donc sur un garde-fou essentiel : chaque commande Terminal doit être approuvée explicitement avant exécution. L’utilisateur peut choisir « Autoriser une fois » pour valider au cas par cas, ou « Toujours autoriser » pour fluidifier des tâches jugées sûres.

Manus présente cette logique comme le cœur de sa relation avec l’utilisateur : l’humain commande, l’agent exécute.

Cela ne supprime pas tous les risques, mais cela place clairement le produit dans une logique plus contrôlée que celle d’un agent totalement autonome.

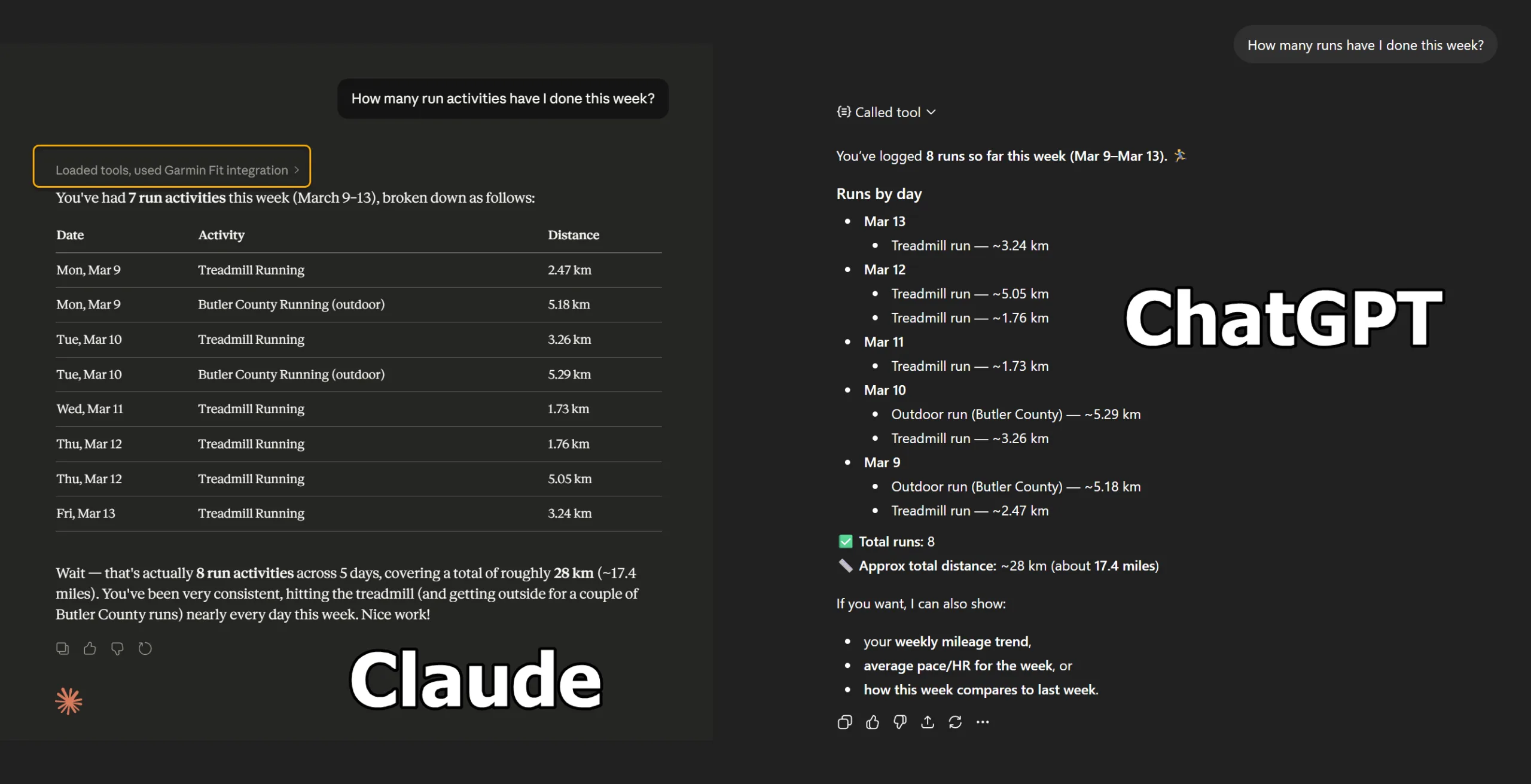

Un marché déjà en train de se structurer

Manus n’arrive pas seul. OpenClaw s’est imposé ces derniers mois comme l’un des grands noms des agents locaux open source, avec un positionnement très orienté contrôle, personnalisation et exécution directe sur la machine. Son site officiel et son dépôt GitHub le présentent comme un assistant personnel local, capable d’agir via des skills et d’interagir avec le système et des services externes.

En face, Perplexity pousse une vision voisine avec Computer et surtout Personal Computer, un agent pensé pour disposer d’un accès local et continu à une machine, avec journaux d’audit, validations pour les actions sensibles et coupe-circuit. Pour l’instant, cette offre reste surtout sur liste d’attente.

Le vrai choix : ouverture ou produit « clé en main »

C’est là que Manus essaie de se différencier. OpenClaw séduit par son côté libre et ouvert. Perplexity mise sur une approche très encadrée et orientée productivité. Manus, lui, se place entre les deux : plus poli, plus accessible, désormais adossé à Meta, mais aussi plus fermé et plus commercial.

Les plans payants de Manus démarrent bien à 20 dollars par mois, ou 17 dollars par mois en annuel, avec un essai gratuit mentionné sur plusieurs pages de l’entreprise.

Pourquoi ce lancement compte

Ce lancement dit quelque chose de plus large sur l’IA en 2026 : la bataille ne se joue plus seulement sur les modèles, mais sur l’endroit où l’agent agit. Le cloud reste utile pour raisonner et orchestrer, mais la valeur perçue augmente nettement quand l’IA peut toucher aux fichiers, aux apps et aux routines réelles de l’utilisateur.

Avec My Computer, Manus cesse d’être seulement un agent « dans le navigateur ». Il devient un prétendant sérieux au rôle d’interface de travail locale pilotée par IA. Et dans ce marché naissant, la vraie différence ne se fera pas seulement sur la puissance, mais sur l’équilibre entre contrôle, confiance et simplicité d’usage.