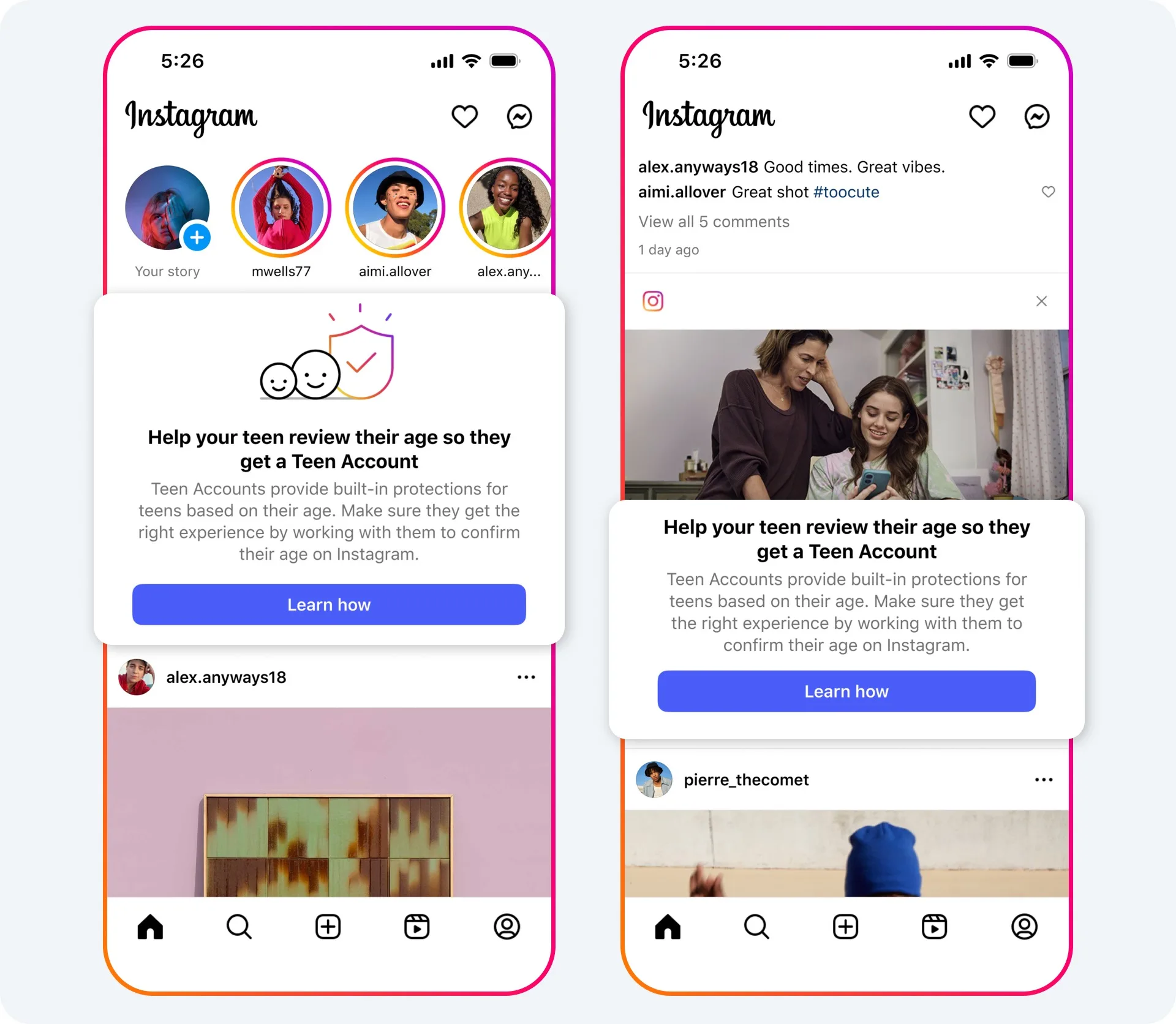

OpenAI transforme ChatGPT en un assistant d’achat intelligent, offrant désormais une expérience d’achat conversationnelle enrichie. Cette mise à jour majeure, déployée le 28 avril 2025, permet aux utilisateurs de rechercher, comparer et acheter des produits directement depuis l’interface de ChatGPT, sans quitter la conversation.

Malheureusement, cette fonctionnalité est déployée aux États-Unis, mais pas encore en France.

ChatGPT : Une expérience d’achat intégrée et visuelle

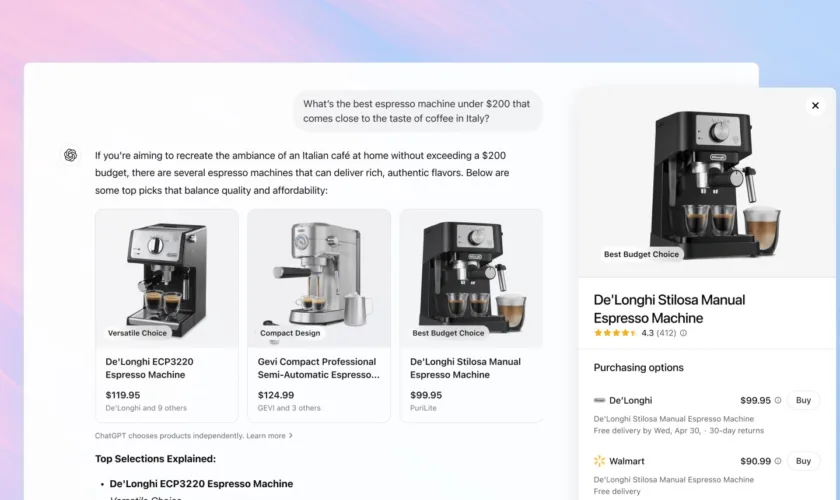

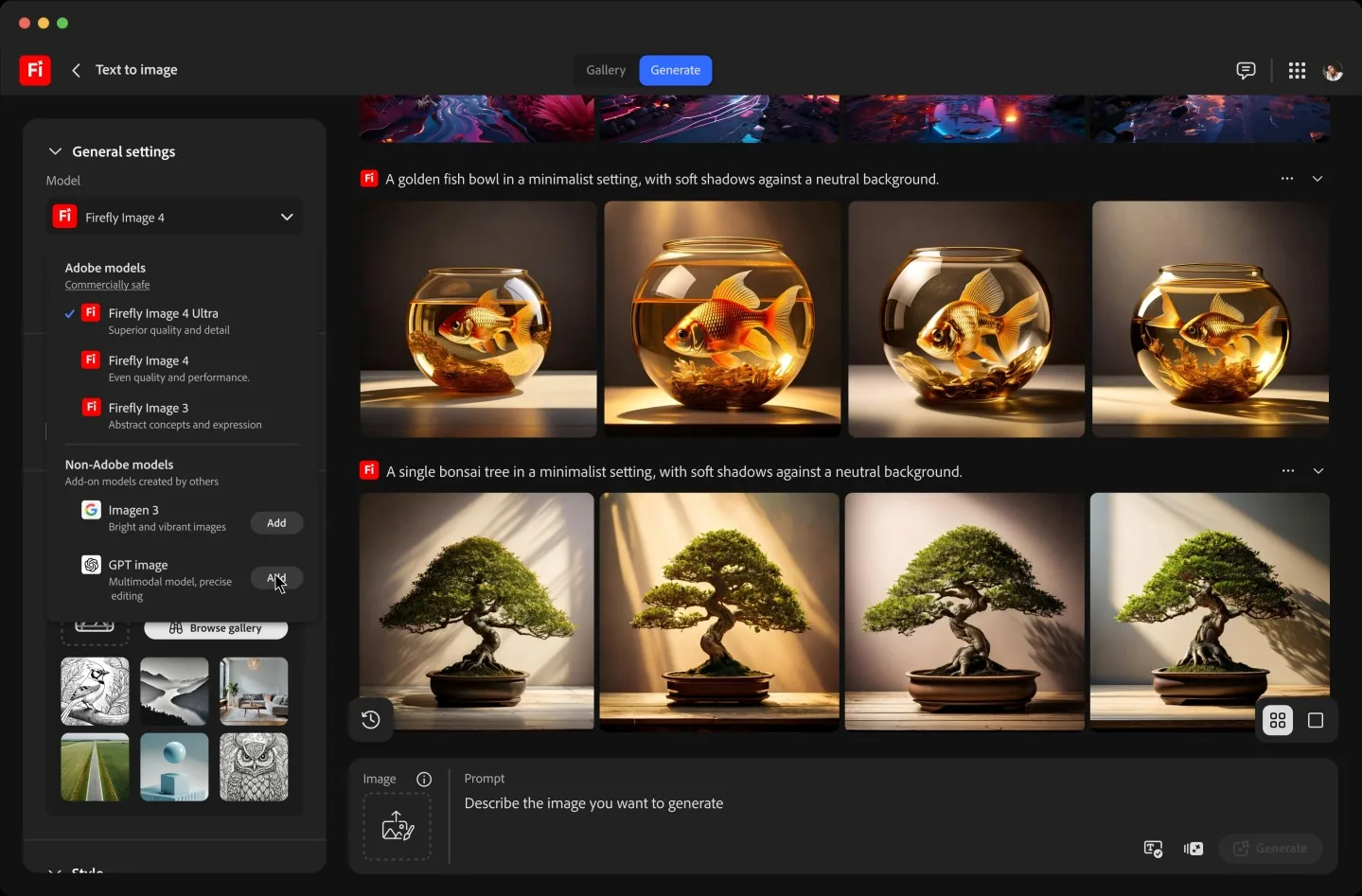

Désormais, lorsqu’une requête indique une intention d’achat (par exemple, “meilleures machines à espresso sous 200 €”), ChatGPT affiche des cartes produits détaillées comprenant :

- Images des produits

- Descriptions simplifiées générées par l’IA

- Prix actualisés

- Évaluations par étoiles et avis clients

- Liens directs vers les sites marchands pour finaliser l’achat

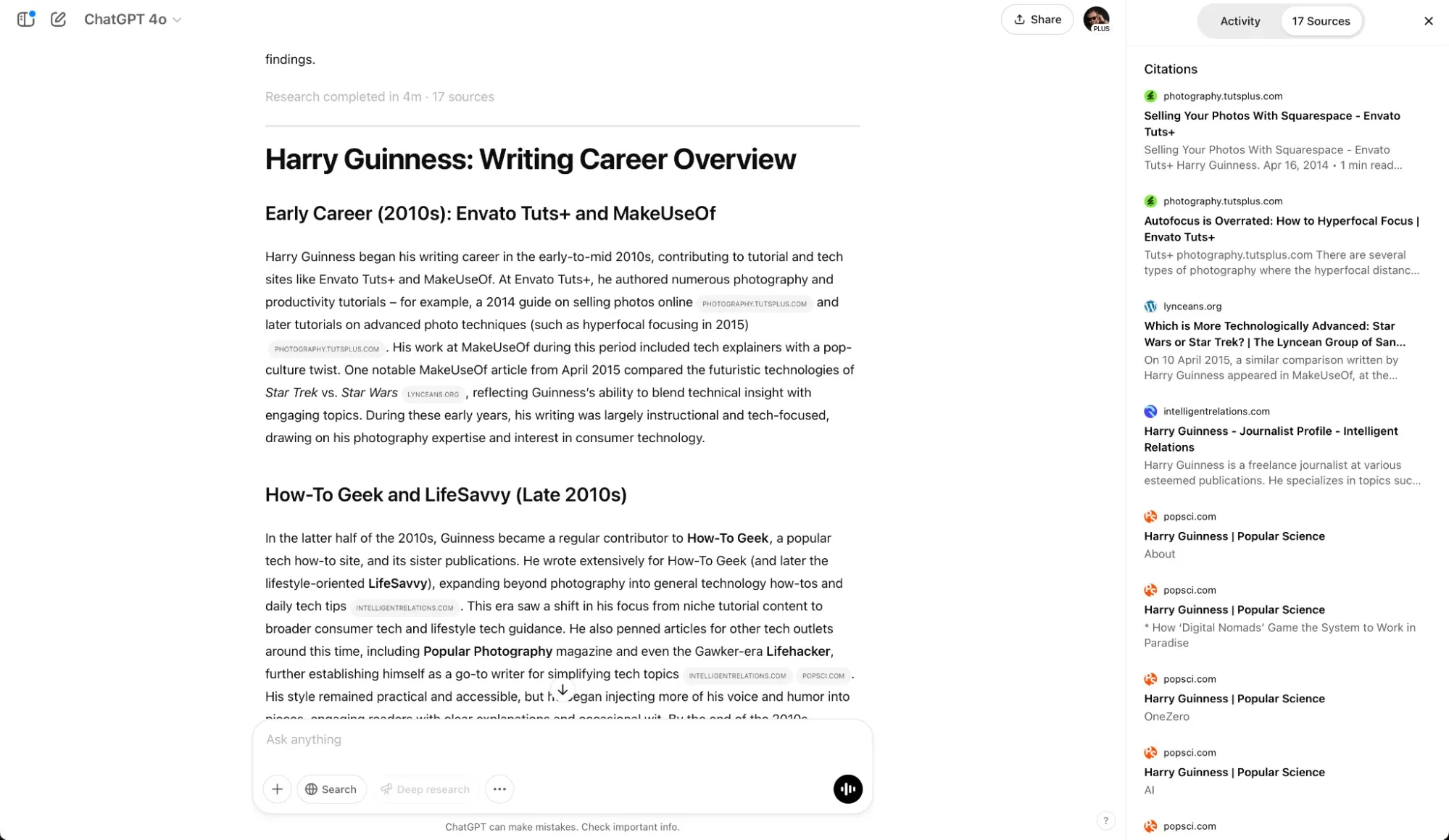

En cliquant sur une carte produit, une fenêtre latérale s’ouvre, fournissant des informations supplémentaires telles que des critiques détaillées provenant de sites comme Amazon, ou Reddit. Un bouton “Poser une question” permet également d’interagir davantage avec ChatGPT pour obtenir des précisions sur le produit.

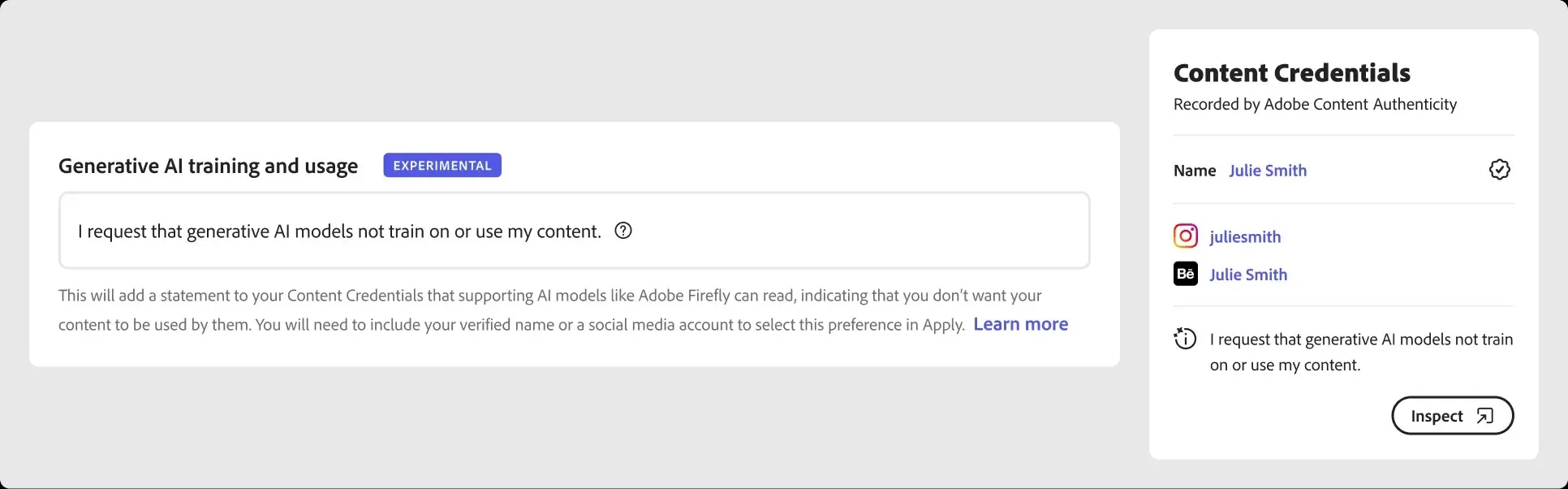

Des recommandations personnalisées et sans publicité

OpenAI insiste sur le fait que ces suggestions de produits sont générées de manière organique, sans publicité ni contenu sponsorisé. Les recommandations s’appuient sur des métadonnées structurées provenant de sources tierces, incluant les prix, descriptions et avis clients.

L’IA prend en compte les préférences exprimées par l’utilisateur, telles que le budget, les caractéristiques souhaitées ou les marques favorites, pour affiner les suggestions.

Dans les mois à venir, OpenAI va ajouter une fonctionnalité “mémoire” à ses recommandations d’achat.

Disponibilité et accessibilité

Ces nouvelles fonctionnalités sont disponibles pour tous les utilisateurs de ChatGPT, qu’ils soient sur les plans Free, Plus ou Pro, et même pour ceux non connectés. Elles sont intégrées au modèle par défaut GPT-4o et couvrent diverses catégories de produits, notamment la mode, la beauté, l’électronique et les articles pour la maison.

Parallèlement, OpenAI a étendu les capacités de ChatGPT en permettant aux utilisateurs d’effectuer des recherches Web via WhatsApp en envoyant un message au 1-800-CHATGPT (uniquement outre-Atlantique). De plus, les résultats de recherche dans ChatGPT bénéficient désormais de citations multiples, offrant une meilleure transparence sur les sources d’information, et d’autocomplétion pour faciliter la saisie des requêtes.

Une alternative sérieuse aux moteurs de recherche traditionnels

Shopping

We’re experimenting with making shopping simpler and faster to find, compare, and buy products in ChatGPT.

✅ Improved product results

✅ Visual product details, pricing, and reviews

✅ Direct links to buyProduct results are chosen independently and are not ads.… pic.twitter.com/PkZwsTxJUj

— OpenAI (@OpenAI) April 28, 2025

Avec plus d’un milliard de recherches Web effectuées via ChatGPT la semaine précédant le déploiement, OpenAI positionne clairement son chatbot comme une alternative crédible aux moteurs de recherche traditionnels, en particulier dans le domaine du shopping en ligne. L’absence de publicités et la personnalisation des résultats offrent une expérience utilisateur centrée sur les besoins réels, contrastant avec les résultats souvent influencés par des placements payants sur d’autres plateformes.

Bien que OpenAI affirme ne pas percevoir de commissions sur les achats effectués via ChatGPT, l’entreprise explore de potentiels modèles économiques, tels que les frais d’affiliation, tout en veillant à maintenir une expérience utilisateur de qualité. Des améliorations sont également prévues pour intégrer la mémoire de ChatGPT, permettant des recommandations encore plus personnalisées basées sur les interactions passées de l’utilisateur.

En résumé, ChatGPT évolue vers un assistant d’achat intelligent et conversationnel, offrant une expérience d’achat fluide, personnalisée et sans publicité, marquant une étape significative dans l’intégration de l’IA dans le commerce en ligne.