Selon les informations de Bloomberg, Anthropic, l’entreprise derrière le chatbot Claude AI, prépare le lancement d’un mode vocal pour son assistant conversationnel. Cette fonctionnalité, déjà attendue depuis plusieurs semaines, pourrait commencer à être déployée dès ce mois-ci, positionnant Claude comme un concurrent direct de ChatGPT Voice.

Claude Voice: Trois voix, trois ambiances : Airy, Mellow et Buttery

D’après le rapport, Claude proposera dans un premier temps trois voix anglaises distinctes :

- Airy: probablement légère et fluide

- Mellow: douce et apaisante

- Buttery: chaleureuse et enveloppante

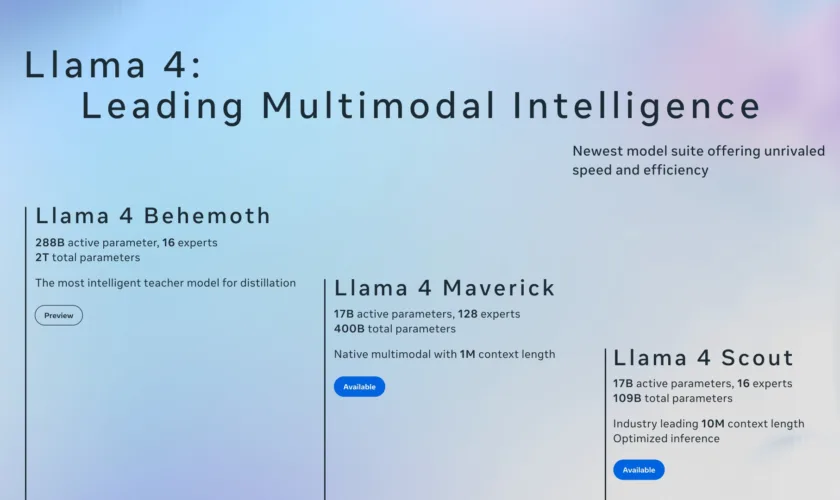

Ces voix permettront aux utilisateurs de dialoguer oralement avec l’IA, une avancée majeure dans l’évolution des assistants conversationnels, qui devient de plus en plus multimodale.

Une fonctionnalité déjà en test interne

La fonctionnalité avait déjà été évoquée par Mike Krieger, Chief Product Officer d’Anthropic, dans une interview accordée au Financial Times en mars dernier : « Nous allons également travailler la voix en interne, c’est une modalité utile à posséder. Nous avons des prototypes ».

Des indices de cette nouveauté ont été repérés dans l’application iOS de Claude par le chercheur M1Astra, avant d’être confirmés par Bloomberg. Anthropic n’a pas encore officiellement réagi.

Une IA qui parle, pour une interaction plus naturelle

Cette évolution est dans la lignée de ce qu’a proposé OpenAI avec ChatGPT Voice, permettant des conversations vocales naturelles via smartphone. Le mode vocal de Claude pourrait transformer l’outil en véritable assistant personnel IA, capable d’assister l’utilisateur dans des tâches quotidiennes sans avoir à taper le moindre texte.

Cela ouvre la porte à des cas d’usage plus dynamiques :

- Conduite mains libres

- Assistance vocale au travail

- Accessibilité améliorée pour les personnes ayant des difficultés à écrire

Un sérieux concurrent face à ChatGPT

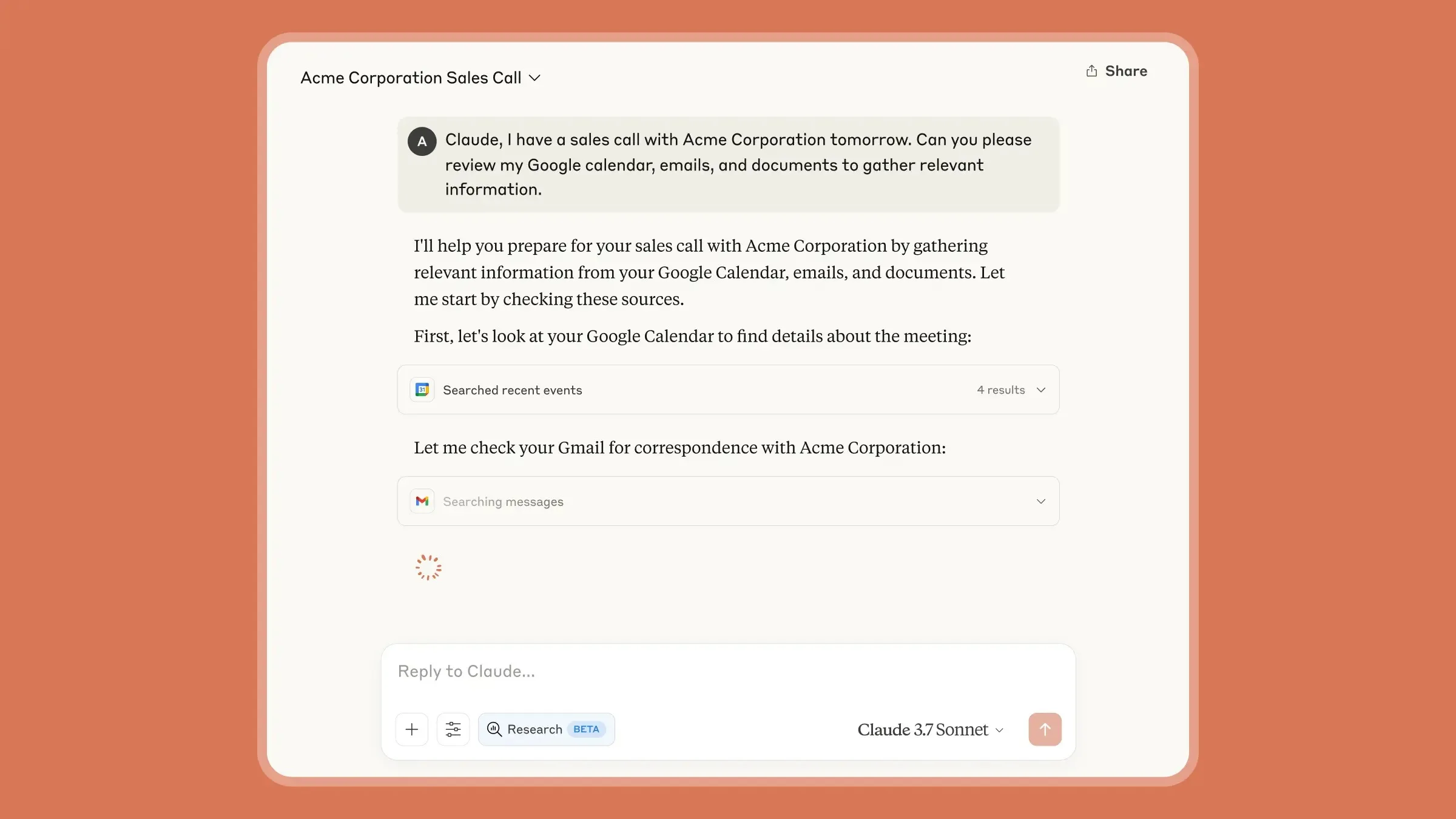

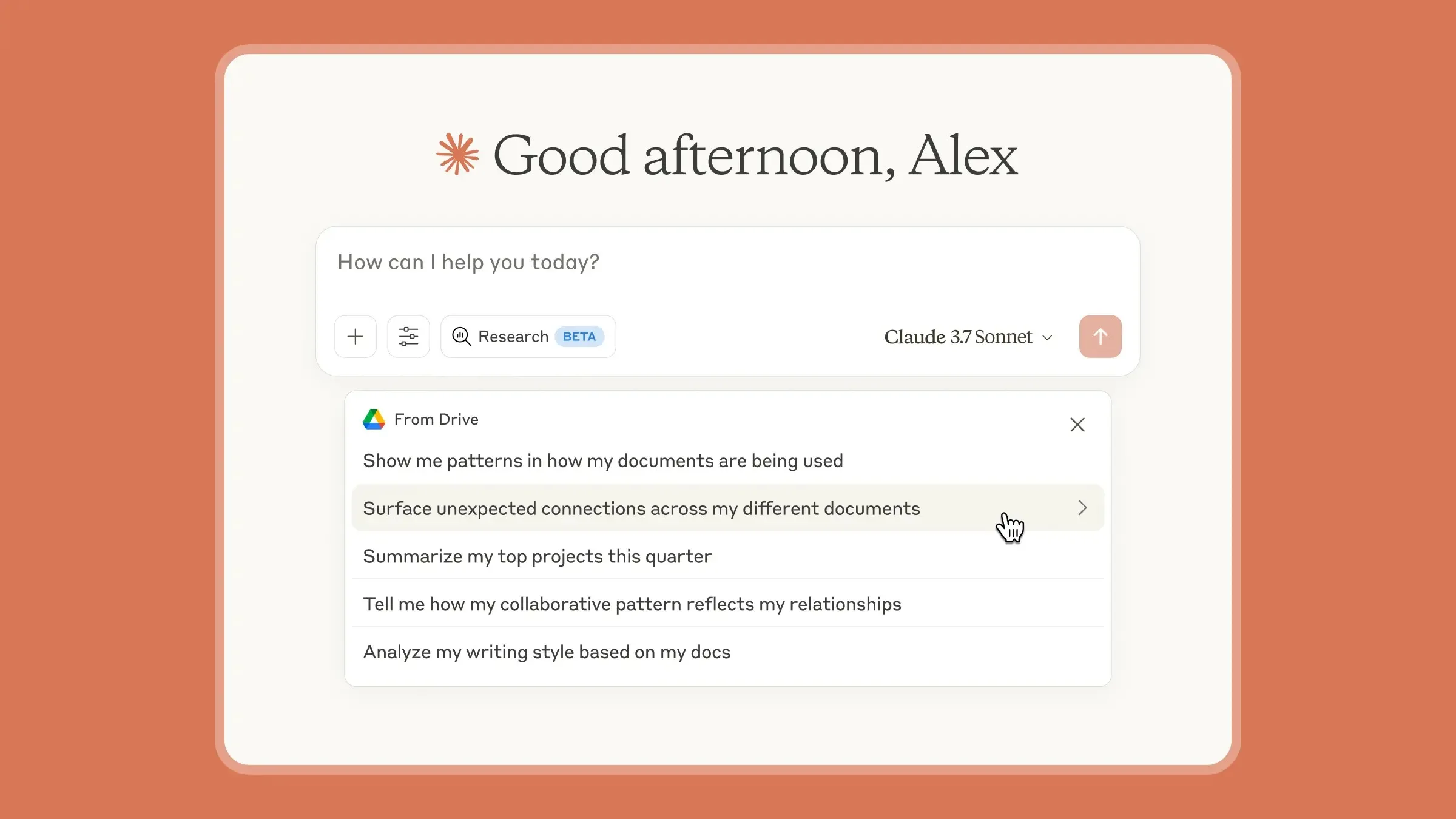

Fondée par d’anciens employés d’OpenAI, Anthropic s’impose comme un acteur majeur dans la course à l’IA générative. Le mois dernier, l’entreprise a lancé un nouveau forfait à 200 dollars/mois pour les utilisateurs intensifs, et a récemment introduit Claude Research, un outil d’analyse Web avancée pour les chercheurs.

Avec ce mode vocal, Claude continue son ascension et se rapproche encore un peu plus du modèle conversationnel « humain » tant recherché dans l’IA moderne.