Adobe vient de dévoiler une évolution majeure de sa plateforme d’intelligence artificielle créative avec le lancement de Firefly Image Model 4, accompagné d’un arsenal de nouveaux outils pour la génération d’images, de vidéos, de contenus vectoriels et d’expériences collaboratives.

Le tout est désormais accessible via une nouvelle application Web centralisée, avec une version mobile actuellement en développement pour iOS et Android.

Firefly Image Model 4 et Ultra : entre précision extrême et vitesse de génération

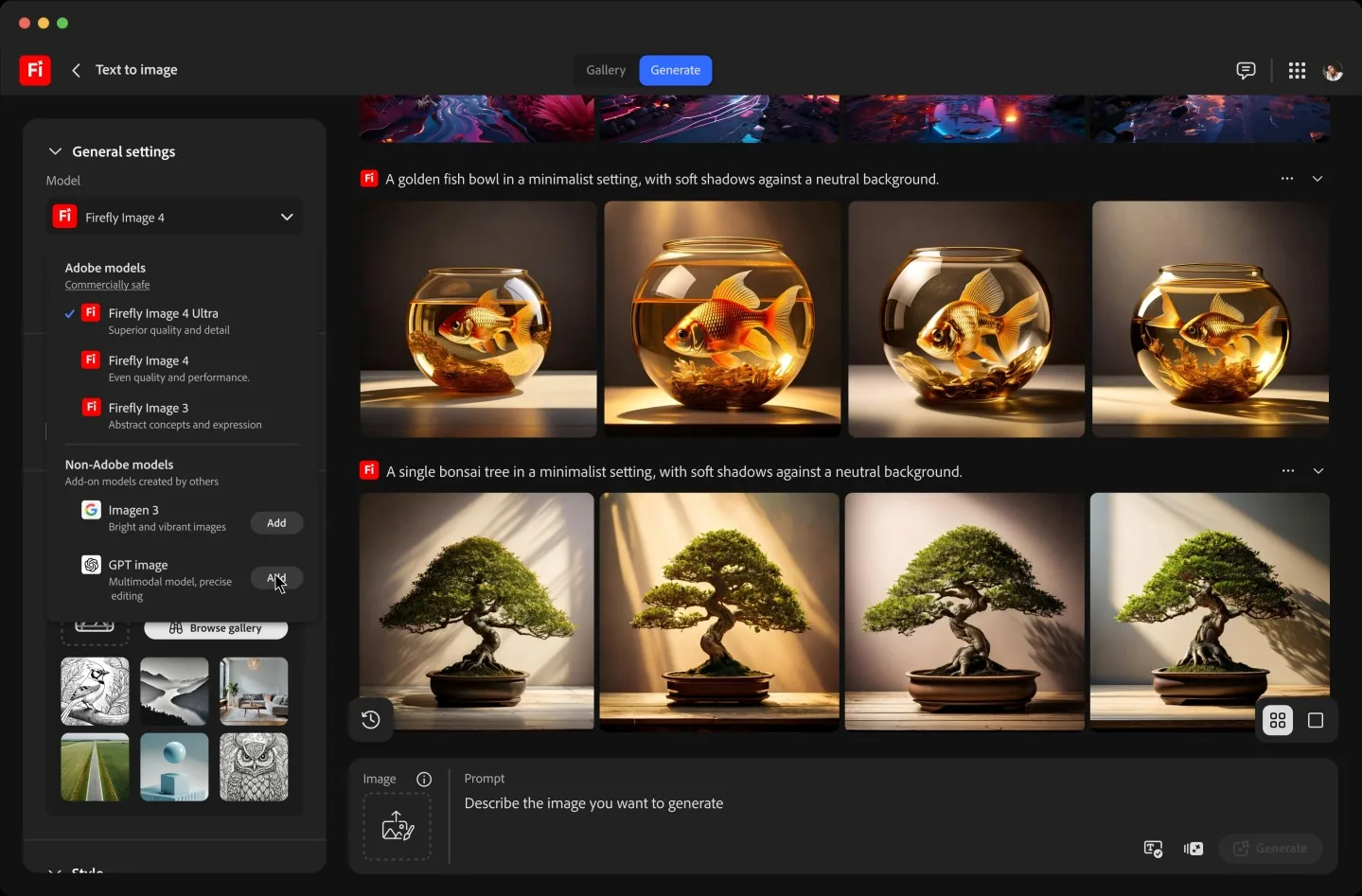

Le modèle Firefly Image Model 4 offre une nette amélioration en termes de qualité d’image, de rapidité d’exécution et surtout de contrôle sur la structure des rendus, les styles visuels, les angles de caméra ou encore les formats de sortie. Il est capable de générer des images en résolution jusqu’à 2K, avec une finesse de détails inédite. Adobe propose également une variante plus puissante appelée Image Model 4 Ultra, spécifiquement conçue pour la génération de scènes riches en structures complexes et en éléments détaillés.

Selon Alexandru Costin, vice-président en charge de l’IA générative chez Adobe, ces modèles ont été entraînés à l’aide d’une puissance de calcul bien supérieure aux générations précédentes. Ils intègrent également des fonctions avancées, comme la possibilité d’utiliser des images de référence pour générer du contenu dans un style précis, ou encore une meilleure capacité à intégrer du texte dans les visuels.

Génération vidéo à partir de texte : Firefly passe à l’image animée

Lancé en bêta l’an dernier, le Firefly Video Model est désormais ouvert à tous les utilisateurs. Ce modèle permet de générer des clips vidéo directement à partir d’un prompt textuel ou d’une image, avec la possibilité de spécifier les angles de caméra, les cadres de début et de fin, les éléments atmosphériques ou encore le style des mouvements.

Les vidéos générées peuvent atteindre une qualité de 1080p, avec un rendu dynamique particulièrement adapté aux réseaux sociaux et aux contenus publicitaires.

Le modèle vectoriel : de l’IA au design graphique

Adobe introduit également un tout nouveau Firefly Vector Model, capable de générer des visuels vectoriels éditables à la volée. Ce modèle est pensé pour les professionnels du design graphique : il peut créer ou décliner des logos, des packagings, des icônes, des motifs ou encore des scènes stylisées, tout en restant pleinement compatible avec Illustrator.

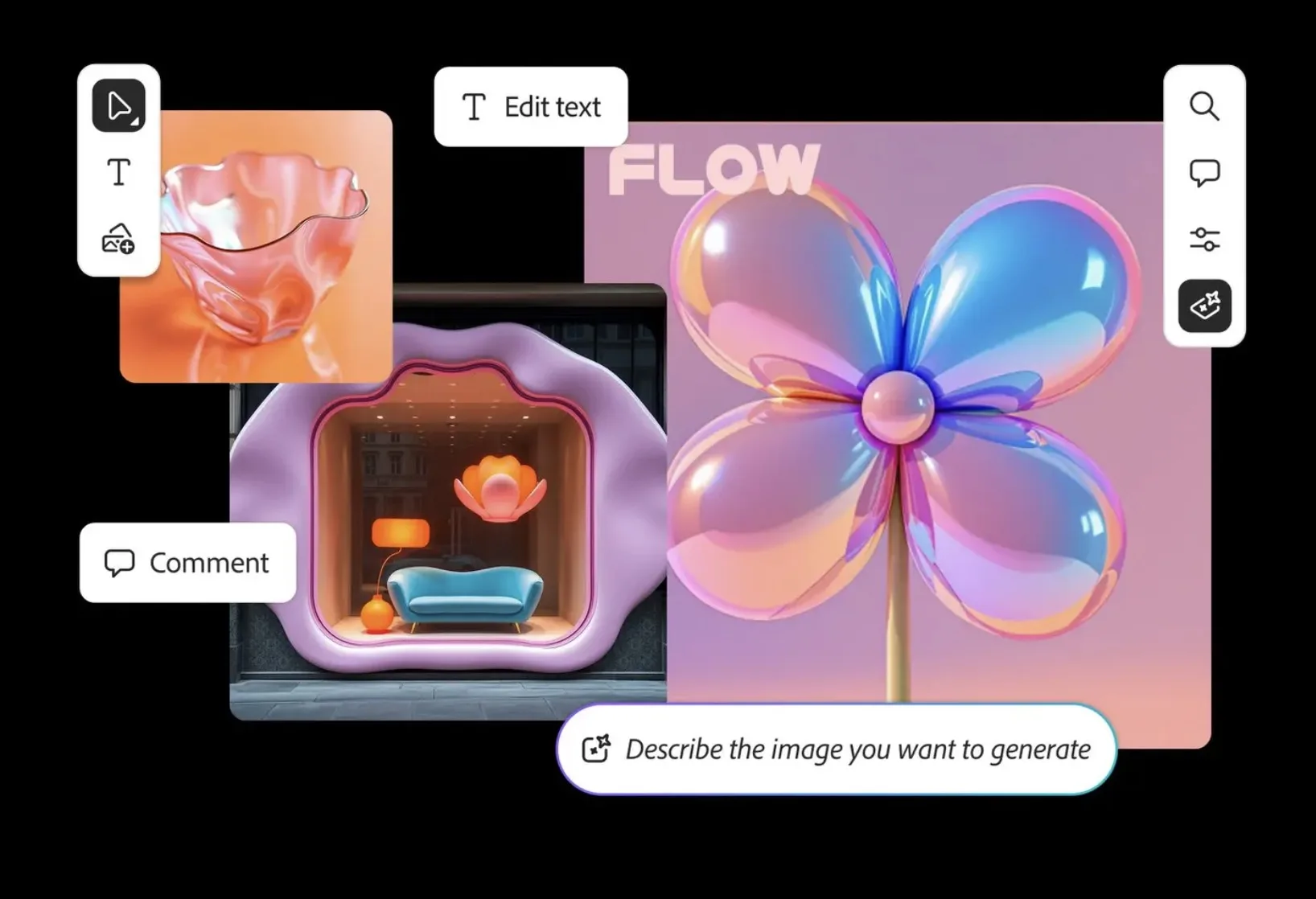

Firefly Boards: la collaboration créative réinventée

Parmi les nouveautés les plus marquantes, on retrouve également Firefly Boards, un espace collaboratif pour générer des idées et construire des moodboards. Disponible en version bêta via l’application Firefly, cet outil permet de générer ou importer des images, les organiser visuellement, les remixer et collaborer avec d’autres membres de l’équipe — une solution proche de FigJam ou Visual Electric, mais boostée à l’IA.

Une plateforme ouverte aux IA concurrentes

L’application Web Firefly devient désormais un hub central qui permet aux utilisateurs d’alterner entre les modèles Adobe et ceux d’acteurs tiers. On peut ainsi générer des images via GPT Image d’OpenAI, Imagen 3 ou Veo 2 de Google, ou encore Flux 1.1 Pro. Adobe précise toutefois que ces modèles externes sont proposés à titre exploratoire, et ne sont pas destinés à des usages commerciaux. Toutes les créations génèrent des credentials de contenu intégrés, assurant leur traçabilité et leur origine.

Des outils pour une IA éthique et responsable

Dans une démarche de transparence et de responsabilité, Adobe teste actuellement une nouvelle application Web nommée Adobe Content Authenticity. Cet outil permet d’attacher des métadonnées de propriété aux œuvres créées, mais aussi de signaler si un fichier peut ou non être utilisé pour l’entraînement de modèles d’IA. Par ailleurs, Adobe garantit que ses modèles Firefly sont entraînés uniquement à partir de contenus sous licence ou libres de droits, contrairement à d’autres acteurs du secteur.

Avec cette nouvelle génération Firefly, Adobe ne se contente pas de suivre les tendances : l’entreprise redéfinit les standards de la création visuelle assistée par IA, en intégrant performance, contrôle créatif, collaboration et responsabilité. Que vous soyez artiste, designer, vidéaste ou développeur de contenu, cette suite d’outils vous offre une flexibilité sans précédent, avec une qualité professionnelle et une attention particulière aux droits d’auteur. Et ce n’est que le début.