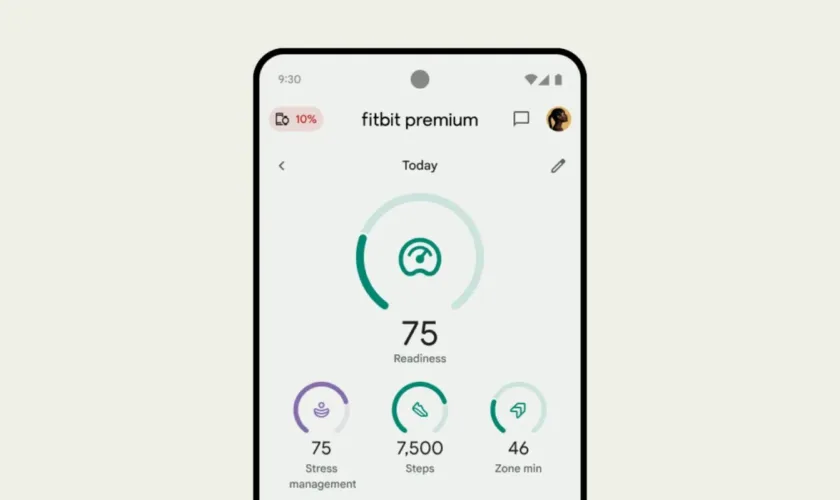

Fitbit, la filiale de Google spécialisée dans les objets connectés santé, vient de franchir une nouvelle étape ambitieuse. Depuis ce 13 mai, les utilisateurs éligibles aux États-Unis, sur Android et iPhone, peuvent accéder à trois nouvelles expériences expérimentales proposées par Fitbit Labs, toutes alimentées par l’IA Gemini de Google.

L’objectif ? Aller bien au-delà du simple suivi de pas ou de sommeil et faire de votre bracelet Fitbit un véritable compagnon santé proactif.

Fitbit Labs : des expériences de santé pilotées par l’IA

Fitbit Labs est un programme lancé il y a seulement 7 mois, et qui permet aux utilisateurs volontaires de tester en avant-première des fonctionnalités innovantes. Après le succès du premier projet « Insight Explorer », voici maintenant trois nouveaux outils expérimentaux conçus pour interpréter les données de santé avec intelligence.

Voici ce que propose cette nouvelle vague d’expériences :

1. Navigateur de dossiers médicaux

Grâce à cette fonctionnalité, vous pouvez importer vos résultats d’analyses médicales (prise de sang, bilan de santé, etc.). L’IA Gemini se charge de scanner les documents, vulgariser les termes médicaux souvent incompréhensibles, et vous orienter vers des ressources explicatives. Une façon simple de mieux comprendre sa santé sans avoir besoin d’un dictionnaire médical sous la main.

2. Assistant Symptômes

Inspiré des agents conversationnels, ce chatbot médical vous permet de décrire un symptôme inhabituel (fatigue, douleurs, nausées…). L’IA vous posera quelques questions supplémentaires pour ensuite proposer des hypothèses plausibles, vous aidant à juger si une consultation est nécessaire. Ce n’est pas un outil de diagnostic, mais un premier filtre rassurant pour orienter vos décisions.

3. Détection de tendances inhabituelles

Basé sur l’analyse de vos métriques physiologiques (fréquence cardiaque au repos, variabilité, respiration nocturne), cet outil apprend ce qui est « normal » pour vous. En cas d’écart soudain, vous serez alerté automatiquement, bien avant que les symptômes n’apparaissent. Une approche préventive, à la manière de ce que propose déjà Whoop ou les Galaxy Watch.

Confidentialité, limites et éthique

Fitbit précise que ces outils sont purement exploratoires. Ils ne remplacent en aucun cas un avis médical, ne peuvent poser de diagnostic, et ne sont pas validés par les autorités de santé. Vous pouvez quitter une expérimentation à tout moment, vos données sont alors supprimées.

Alors qu’Apple travaille sur un assistant santé basé sur l’IA pour son application Santé, et que Samsung prépare l’intégration de Galaxy AI dans Samsung Health (et bientôt Galaxy Ring), Fitbit prend une longueur d’avance avec des fonctions concrètes déjà testables.

Google semble miser gros sur l’IA contextuelle et personnalisée avec sa gamme d’outils Gemini, et Fitbit Labs en est une vitrine. L’approche de Fitbit est claire : transformer les données passives en conseils actifs, pour anticiper les problèmes de santé avant qu’ils ne deviennent visibles.

Fitbit Labs ne se contente plus de suivre vos efforts physiques. Avec ces trois nouvelles expériences, l’entreprise entre dans une nouvelle dimension proactive, où l’IA devient un outil de compréhension, de prévention, et d’assistance. Sans prétendre remplacer les médecins, ces fonctions pourraient jouer un rôle clé dans l’accompagnement quotidien des utilisateurs, notamment ceux qui vivent avec des pathologies chroniques ou souhaitent surveiller leur santé plus finement.

Les possesseurs de Fitbit aux États-Unis peuvent dès aujourd’hui s’inscrire sur liste d’attente depuis l’onglet Fitbit Labs de l’application. Espérons que ce déploiement s’élargira rapidement à l’international.