Elon Musk a annoncé que sa startup spécialisée dans l’IA, xAI, pousserait cette semaine Grok en open source, le Large Language Model de l’entreprise. Grok a été dévoilé en novembre de l’année dernière et est actuellement disponible pour les abonnés Premium+ (201,60 euros par an) sur X (anciennement Twitter).

Le chatbot Grok a été lancé en réponse directe au ChatGPT d’OpenAI, mais le modèle n’a pas encore montré de grandes promesses.

Elon Musk s’est ouvertement prononcé contre les garde-fous agressifs qui obligent les modèles d’IA à éviter les sujets sensibles. Grok est donc considéré comme l’aboutissement de la vision de Musk, où le chatbot d’IA n’hésite pas à répondre à des questions politiques ou sensibles.

Cela dit, Grok a beaucoup halluciné sur de nombreux sujets, et même sur l’échiquier politique, il s’est aligné plus à gauche, ce contre quoi Musk s’est élevé. Maintenant, avec la stratégie open source, xAI fait confiance à la communauté open source pour piloter le modèle et l’améliorer de manière significative.

Meta a été le premier à proposer des modèles d’IA en libre accès. Nous avons récemment vu la publication de Llama 2 par Meta AI, et Google a également publié un petit modèle d’IA appelé Gemma. Si xAI choisit de publier les poids du modèle Grok AI sous une licence open source relativement raisonnable, cela pourrait inciter la communauté à travailler et à améliorer le modèle pour différents cas d’utilisation.

This week, @xAI will open source Grok

— Elon Musk (@elonmusk) March 11, 2024

Je ne sais pas si xAI publiera Grok avec des restrictions minimales pour un usage commercial. Bien que Llama 2 soit open source, il exige que les applications et les services obtiennent une licence spéciale si la base d’utilisateurs dépasse les 700 millions d’utilisateurs mensuels. De même, xAI pourrait ajouter des restrictions analogues pour l’utilisation commerciale.

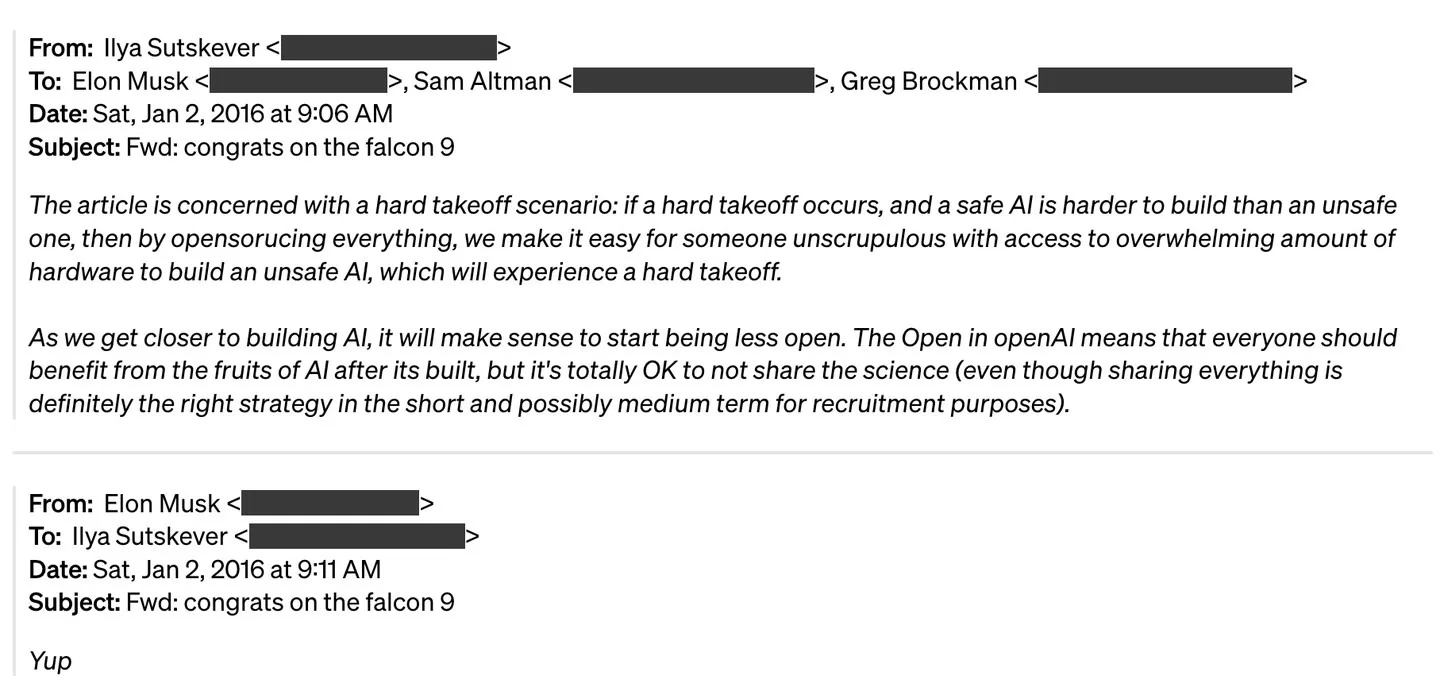

Par ailleurs, Elon Musk a récemment intenté un procès à OpenAI et à Sam Altman en raison de la volte-face d’OpenAI, qui est devenue une société à code source fermé. Musk a déclaré par la suite qu’il abandonnerait les poursuites si OpenAI changeait son nom en “ClosedAI”. C’est peut-être dans cet esprit qu’Elon Musk met Grok en open source, ce qui pourrait consolider sa position sur l’open-sourcing des futures technologies d’IA.

Change your name

— Elon Musk (@elonmusk) March 6, 2024