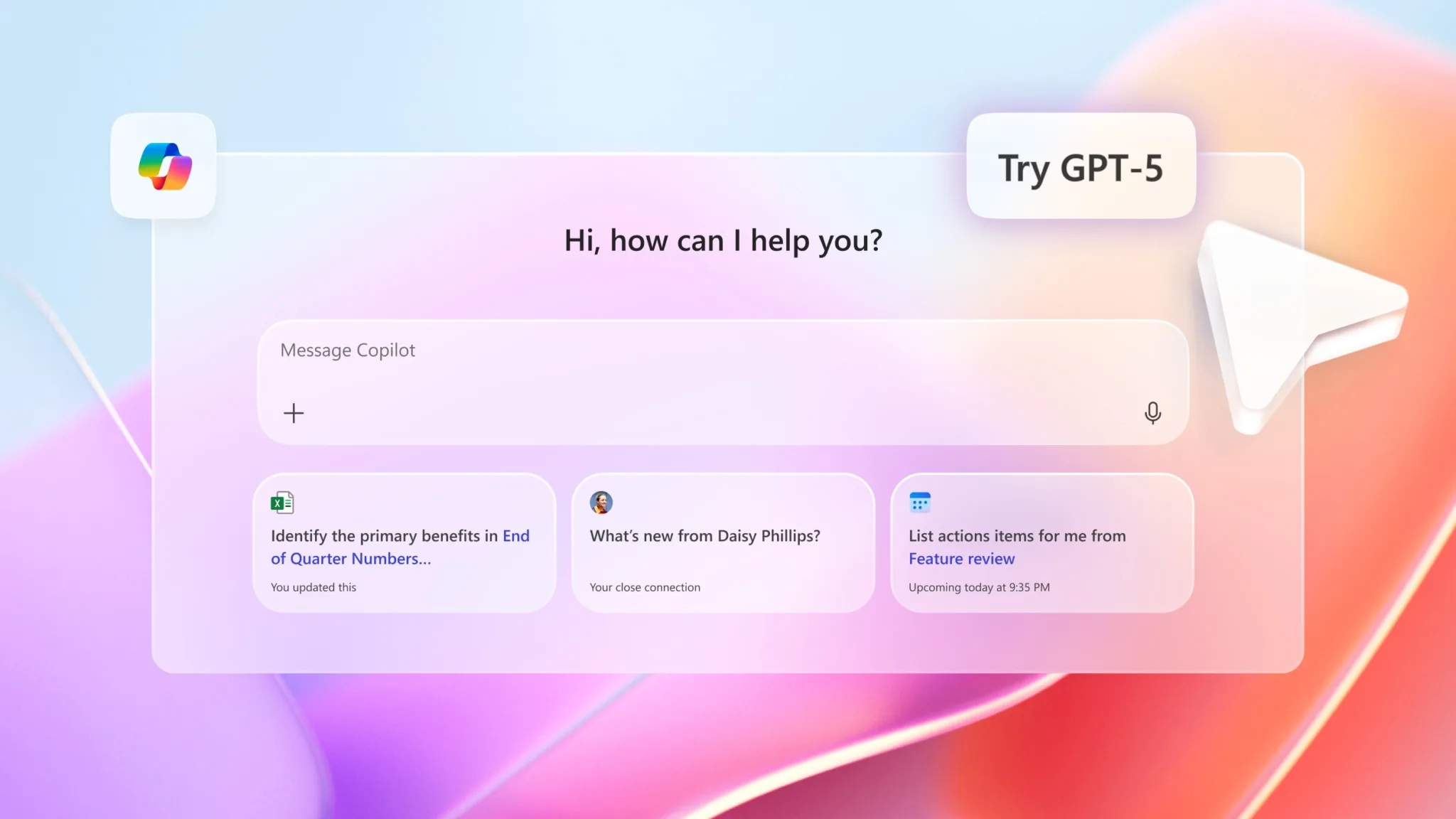

Le lancement officiel de GPT-5 par OpenAI marque un tournant majeur dans l’intelligence artificielle, et Microsoft n’a pas perdu de temps pour déployer ce nouveau modèle dans l’ensemble de son écosystème.

Dès aujourd’hui, GPT-5 est disponible dans Copilot, Microsoft 365 Copilot, Azure AI Foundry, GitHub Copilot et Copilot Studio.

GPT-5 : la nouvelle intelligence derrière Copilot

Grâce à cette mise à jour, Copilot bénéficie désormais d’un « mode intelligent ». Ce mode permet à l’assistant IA de basculer automatiquement entre les différents modèles en fonction du contexte : GPT-5 pour les tâches complexes nécessitant du raisonnement approfondi, ou des modèles plus légers pour des réponses rapides.

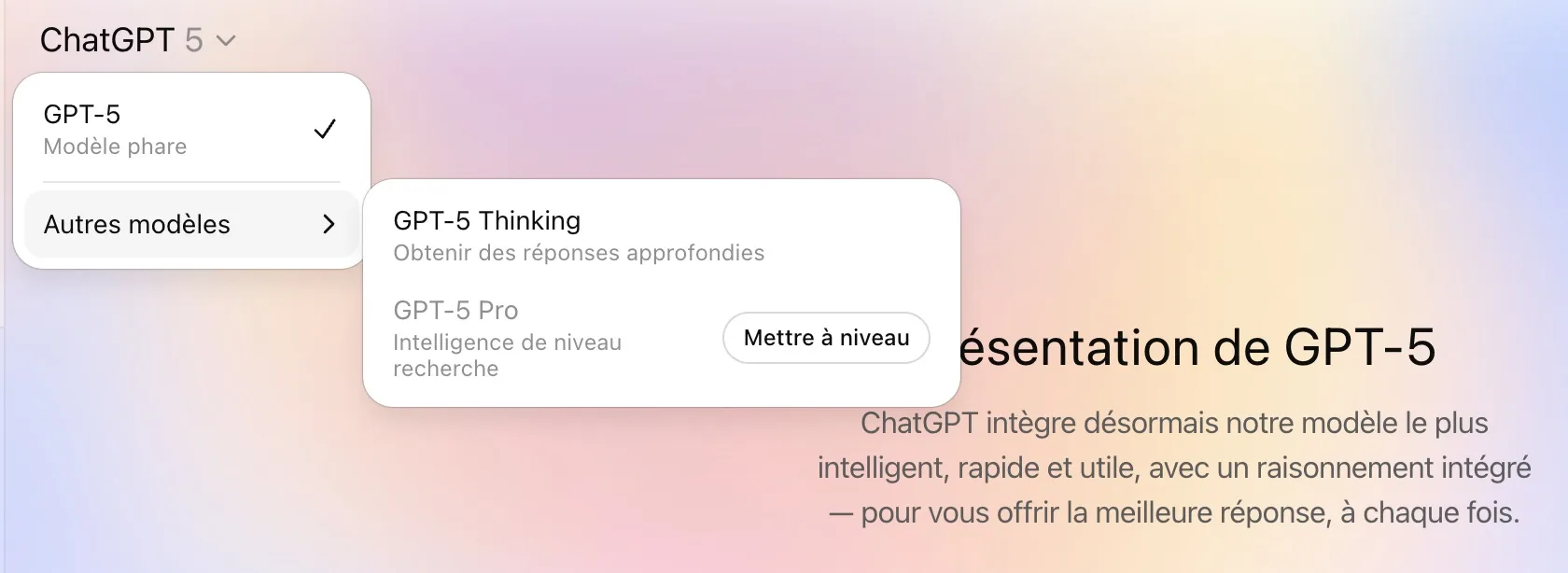

Cette approche dynamique reflète la stratégie d’OpenAI, qui intègre également GPT-5 dans ChatGPT, y compris pour les utilisateurs gratuits.

Microsoft 365 Copilot devient plus intelligent

Les utilisateurs de Microsoft 365 Copilot bénéficient dès maintenant des améliorations de raisonnement et de compréhension contextuelle offertes par GPT-5.

Selon un article officiel de Microsoft : « Grâce à GPT-5, Microsoft 365 Copilot est plus performant pour répondre à des questions complexes, maintenir le fil des conversations longues, et mieux comprendre le contexte utilisateur ».

Les bénéfices se feront sentir dans les outils du quotidien, comme Word, Excel, Outlook ou Teams, rendant l’automatisation des tâches, la rédaction de documents ou l’analyse de données encore plus puissantes et précises.

Copilot Studio adopte GPT-5

Copilot Studio, l’environnement de création personnalisé d’assistants IA, bénéficie lui aussi de GPT-5 dès aujourd’hui. Cela ouvre la voie à des conversations multimodales plus naturelles, une meilleure compréhension du langage, et des scénarios d’usage plus poussés.

Les développeurs peuvent ainsi créer des flux IA plus dynamiques, reposant sur les capacités étendues de GPT-5.

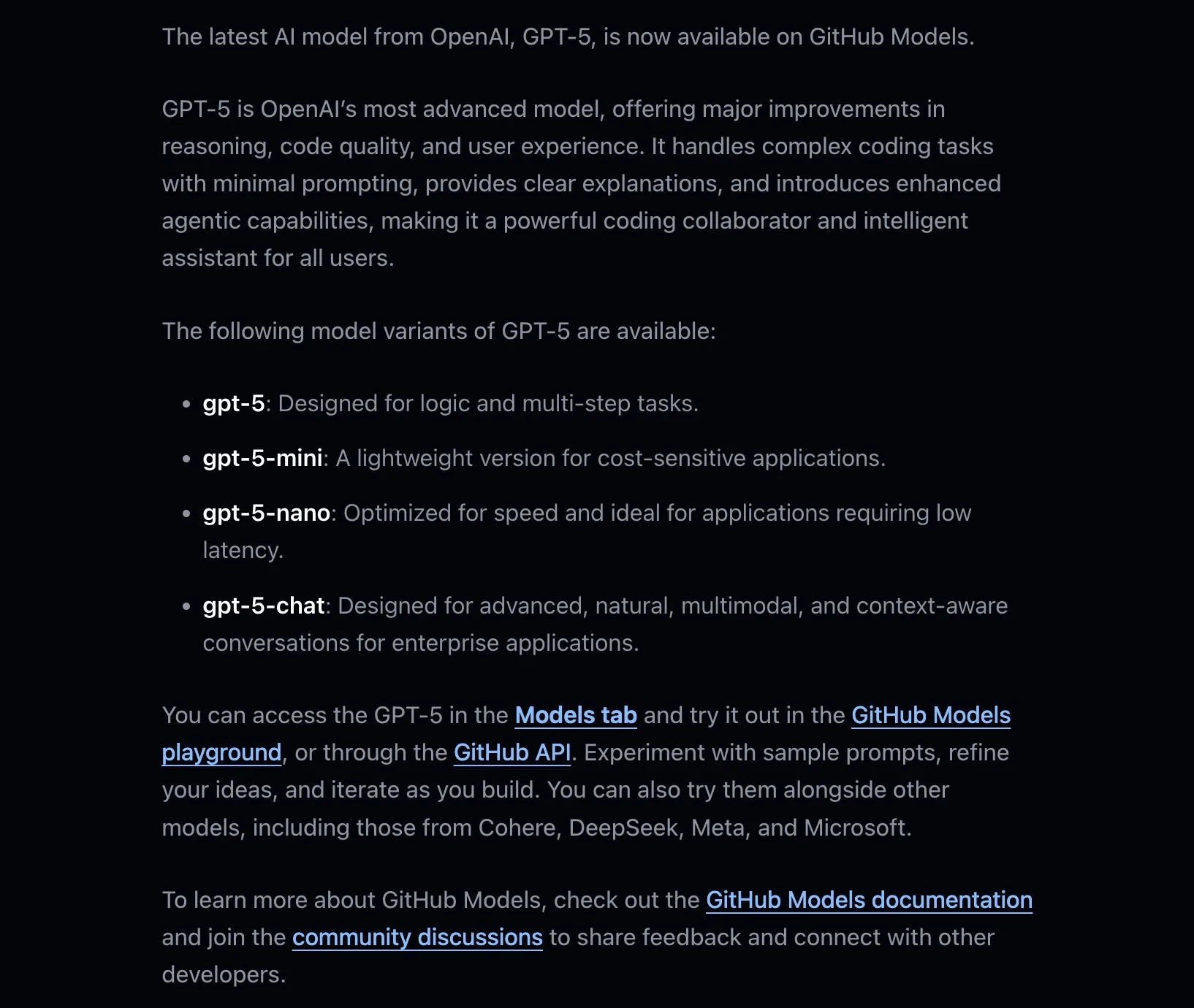

GitHub Copilot passe à la vitesse supérieure

Autre annonce phare : GitHub Copilot déploie GPT-5 sur tous ses plans payants. Les développeurs pourront ainsi profiter des améliorations significatives dans la génération de code, la compréhension des erreurs, et la résolution de problèmes complexes.

GPT-5 est réputé pour sa capacité à traiter des tâches multi-étapes, une qualité essentielle pour la programmation et les workflows DevOps.

GPT-5 aussi disponible sur Azure AI Foundry

Microsoft met également GPT-5 à disposition via Azure AI Foundry, sa plateforme de développement d’applications IA.

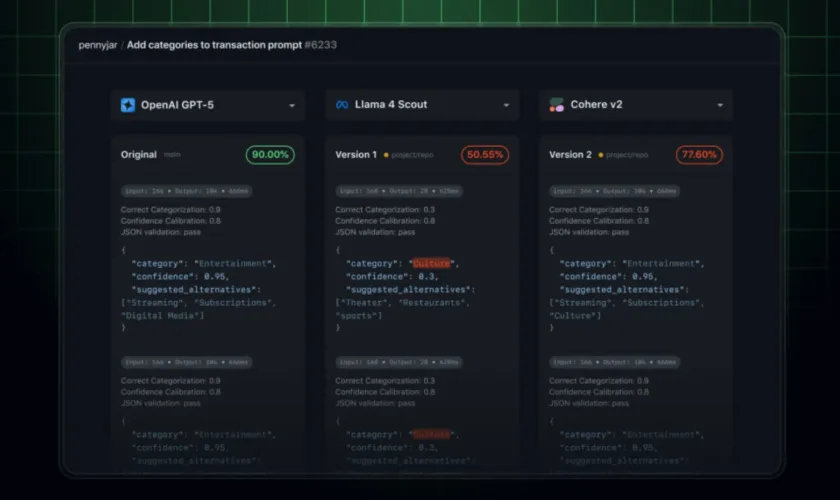

Les développeurs auront accès à un « routeur de modèles », capable de sélectionner automatiquement le modèle le plus adapté (gpt-5, gpt-5 mini, ou gpt-5 nano) en fonction de la requête. Cela garantit une optimisation des performances et des coûts dans les applications IA d’entreprise.

Une intégration cohérente avec la stratégie OpenAI

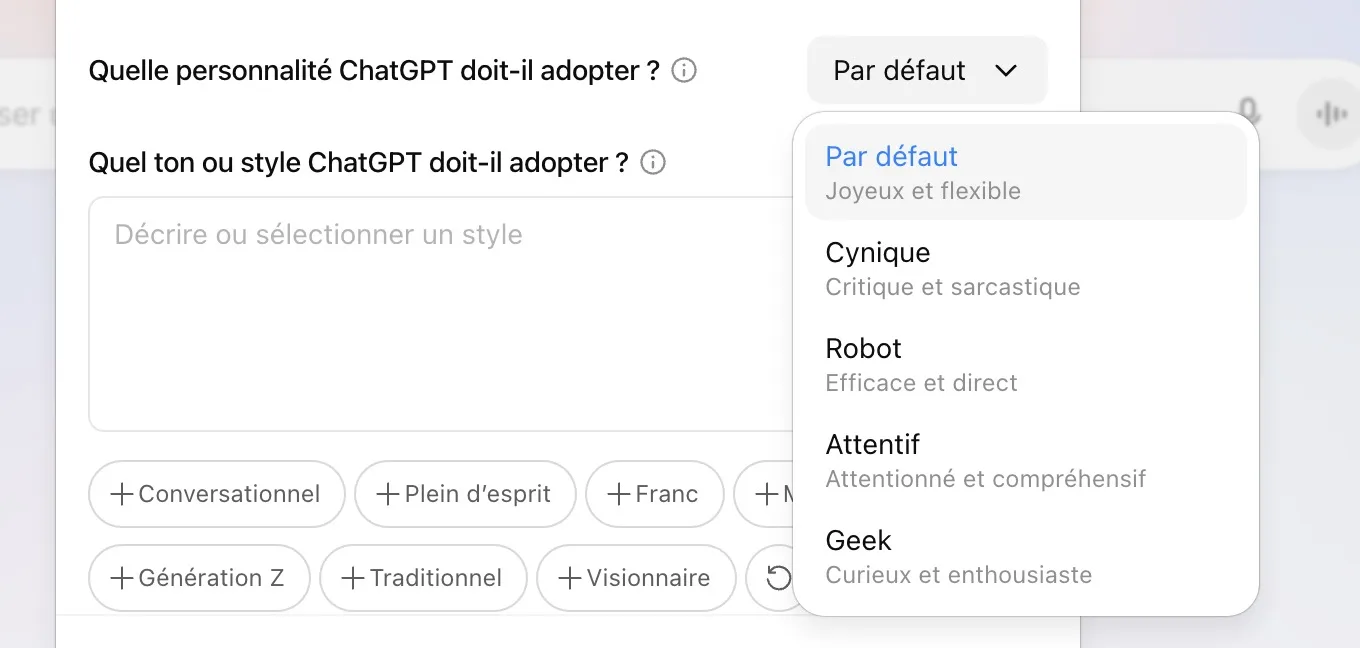

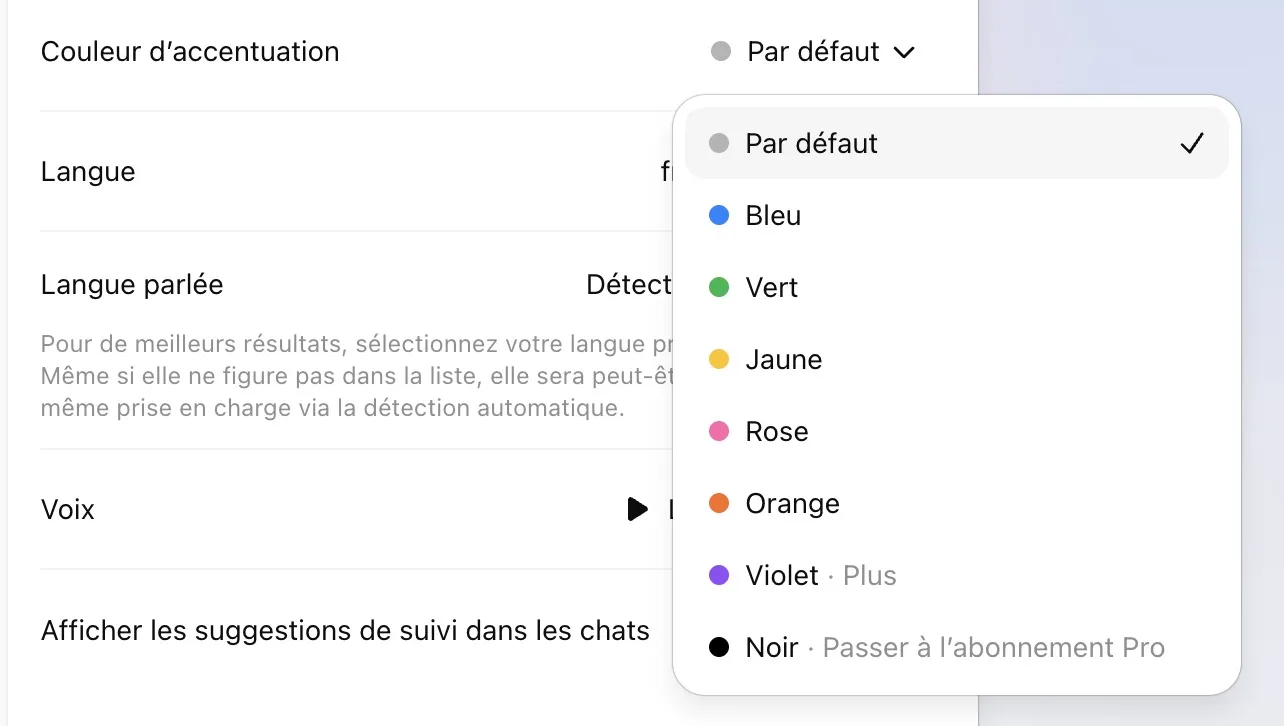

Cette extension de GPT-5 à tout l’écosystème Microsoft reflète la stratégie commune avec OpenAI : rendre l’intelligence artificielle plus accessible, plus puissante et plus fluide, sans intervention manuelle de l’utilisateur.

Tout comme dans ChatGPT, l’activation du modèle GPT-5 dans Copilot se fait automatiquement, via un système de routage intelligent. Cela garantit la meilleure expérience possible sans devoir choisir manuellement le bon modèle.

Microsoft & GPT-5, une synergie naturelle

Avec cette intégration, Microsoft démontre une nouvelle fois sa position de leader dans l’adoption de l’IA générative à grande échelle. GPT-5, déjà salué pour ses capacités de raisonnement et sa production de code de haute qualité, vient renforcer chaque outil de productivité et de développement de la firme.

Des applications bureautiques à la programmation, en passant par l’IA d’entreprise, GPT-5 devient le nouveau moteur de l’efficacité augmentée chez Microsoft.