OpenAI continue de pousser les limites de l’intelligence artificielle en lançant HealthBench, un tout nouveau benchmark pensé pour évaluer la performance des modèles d’IA dans des scénarios médicaux réalistes.

Objectif : garantir que ces technologies puissent non seulement aider les professionnels de santé, mais aussi favoriser l’accès global à une information médicale fiable, sans nuire à la sécurité des patients.

HealthBench : un outil conçu avec 262 médecins du monde entier

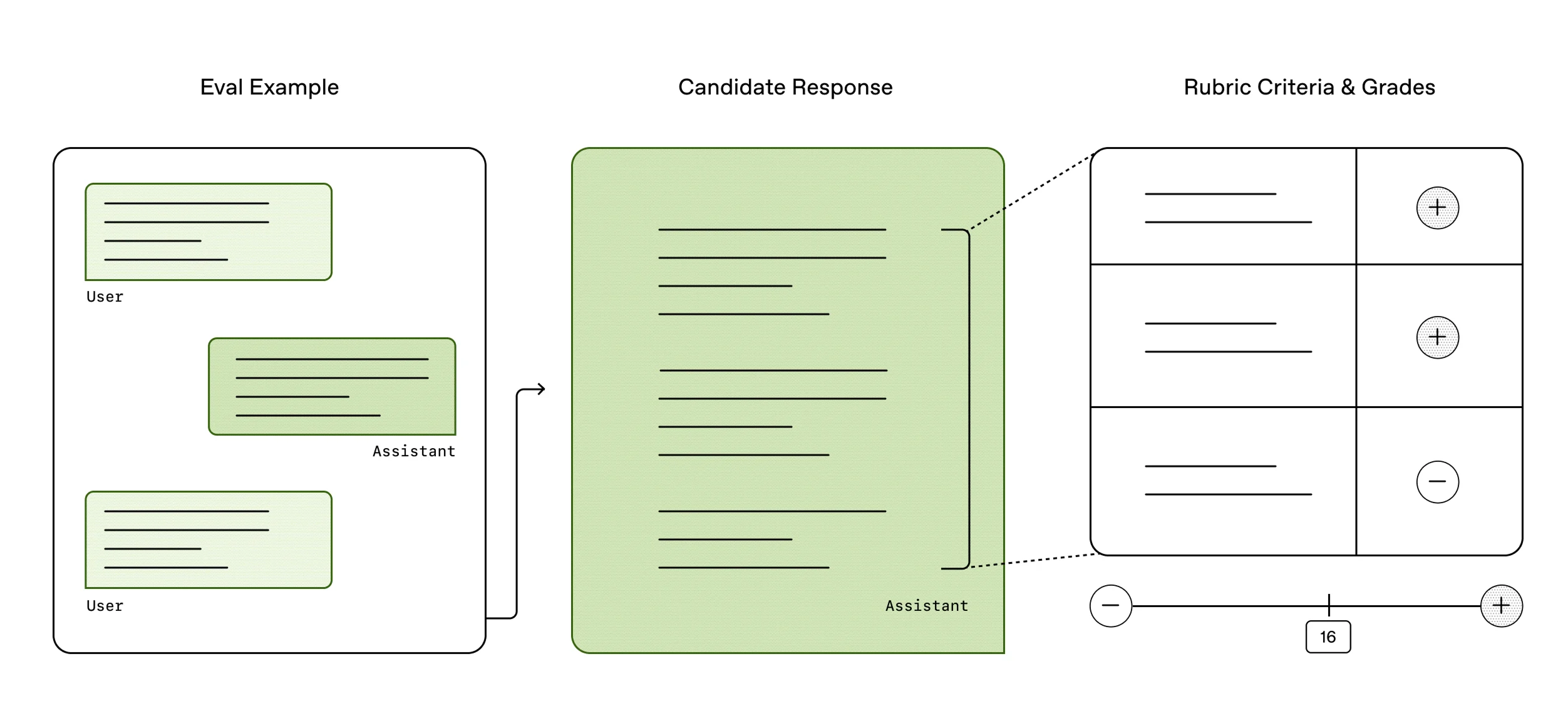

HealthBench ne sort pas de nulle part. Ce benchmark a été co-développé avec 262 médecins répartis dans 60 pays, parlant 49 langues et experts dans 26 spécialités médicales. Ensemble, ils ont contribué à créer 5 000 conversations de santé réalistes, censées simuler des interactions entre patients, professionnels de santé et IA.

Chaque conversation suit une structure multi-turn (à plusieurs échanges), intégrant des subtilités comme :

- des différences culturelles ou linguistiques,

- des situations d’urgence,

- des incertitudes cliniques,

- ou encore des données de santé à interpréter.

48 562 critères médicaux pour évaluer l’intelligence

Ce qui distingue HealthBench, c’est sa rigueur clinique. Chaque échange IA est évalué à l’aide de rubriques rédigées par des médecins, intégrant 48 562 critères uniques portant sur :

- la précision médicale,

- la qualité de la communication (adaptée au profil utilisateur),

- la gestion du contexte (urgence, incertitude, etc.),

- la capacité à reconnaître les limites de l’IA.

Les réponses des modèles sont notées automatiquement par GPT-4.1, selon ces grilles, avec une pondération en fonction de la gravité ou de l’importance du critère (ex. : inclure un avertissement en cas de doute vital).

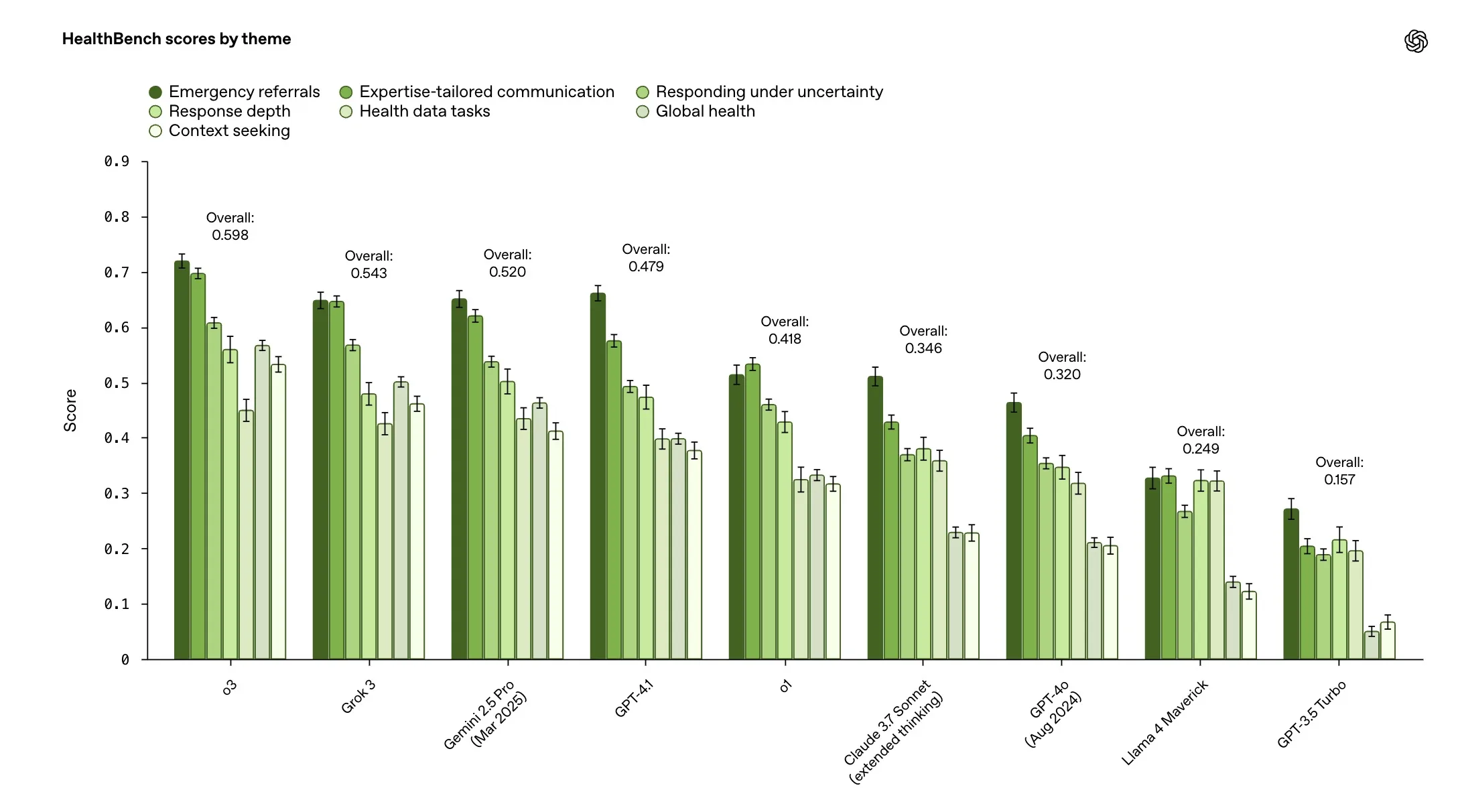

Sept axes d’évaluation pour tester les IA en santé

HealthBench explore les réponses de l’IA selon sept grands thèmes cliniques :

- Communication adaptée selon l’expertise perçue de l’utilisateur (patient, médecin…)

- Profondeur des réponses (détail, nuances, recommandations)

- Référencement d’urgences médicales

- Analyse et interprétation de données de santé

- Santé globale et contextes internationaux

- Réponse en situation d’incertitude

- Recherche de contexte supplémentaire face à des informations incomplètes

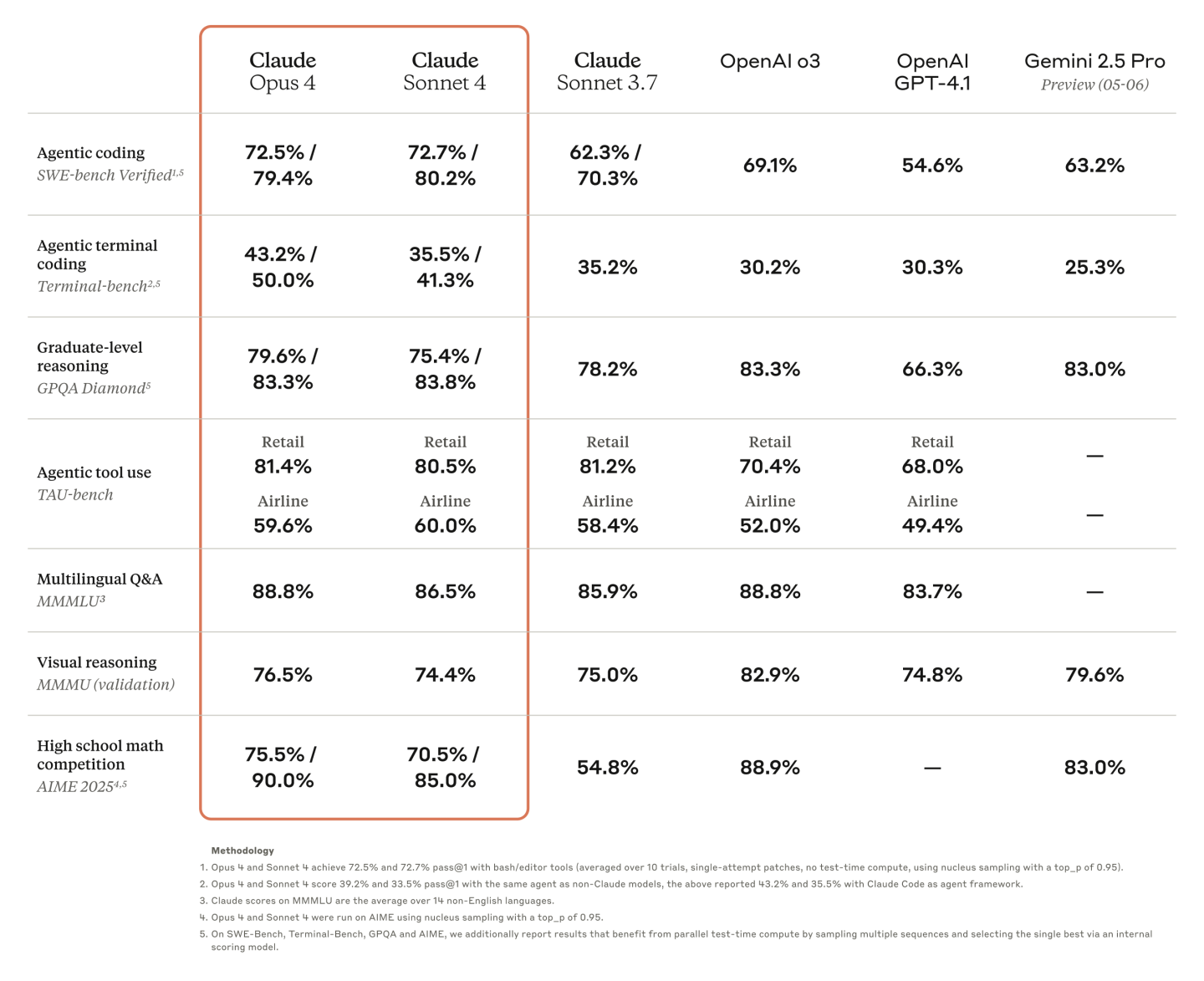

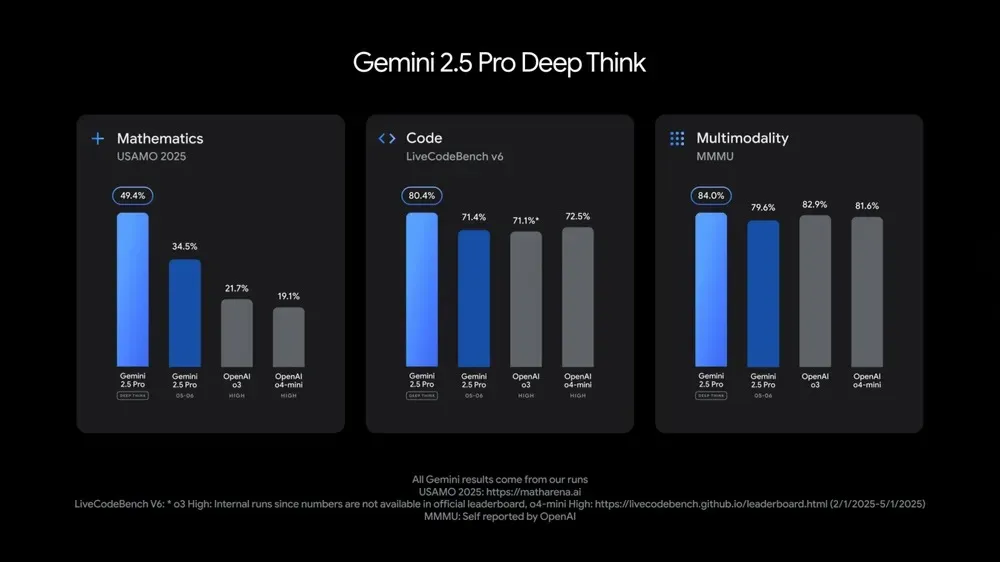

Les IA dépassent déjà certains experts… mais restent perfectibles

OpenAI annonce que les modèles IA testés sur HealthBench, notamment ceux de dernière génération comme GPT-4.1, dépassent parfois des experts humains dans la rédaction de réponses médicales types. Toutefois, les lacunes restent notables, notamment sur la gestion des cas sous-spécifiés, la recherche active de contexte, ou encore la fiabilité dans les scénarios à fort risque.

L’ensemble de HealthBench — données, rubriques, scripts d’évaluation — est mis à disposition en open source sur GitHub. OpenAI espère ainsi stimuler la recherche en éthique de l’IA, en fiabilité médicale, et en développement responsable de modèles utilisés dans des domaines critiques comme la santé.

Vers une santé augmentée par l’IA… et un projet Stargate controversé

Cette annonce s’inscrit dans un contexte plus large : le projet Stargate, présenté comme un méga-chantier de 500 milliards de dollars pour créer l’infrastructure de l’IA dans la santé, réunit Sam Altman (OpenAI), Larry Ellison (Oracle) et Masayoshi Son (SoftBank). L’ambition ? Accélérer la découverte de vaccins, développer des outils de diagnostic IA et transformer le système de santé.

Mais selon les rumeurs, Stargate rencontre déjà des obstacles majeurs : retards dus aux droits de douane américains, incertitudes économiques, manque de financement concret côté SoftBank.

HealthBench ne transforme pas encore l’IA en docteur — et ce n’est pas son but. Mais il marque un tournant stratégique dans l’évaluation de ces outils. À terme, un modèle comme GPT-5 ou Claude Opus pourrait être utilisé pour aider les médecins en temps réel (triage, conseil clinique), éduquer les patients (réponses vulgarisées, contextualisées), ou remplir des fonctions dans les zones sous-médicalisées.

L’IA médicale n’est pas infaillible, mais avec des outils comme HealthBench, elle se rapproche d’un futur où elle complétera l’humain au lieu de le remplacer.