Apple semble déterminé à ne pas rester en retrait dans la course à l’intelligence artificielle générative. Selon plusieurs sources, dont Bloomberg, la firme de Cupertino développe actuellement un moteur de recherche intelligent capable de fournir des réponses conversationnelles en s’appuyant sur l’intelligence artificielle, à la manière de ChatGPT.

Derrière ce projet ambitieux, un nouveau groupe interne nommé « Answers, Knowledge and Information » (Réponses, Connaissance et Information) travaille à l’élaboration d’un moteur de recherche IA avancé, pensé pour s’intégrer en profondeur à Siri, Safari, Spotlight, et potentiellement à d’autres services de l’écosystème Apple.

Une stratégie IA ambitieuse, mais centrée sur la confidentialité

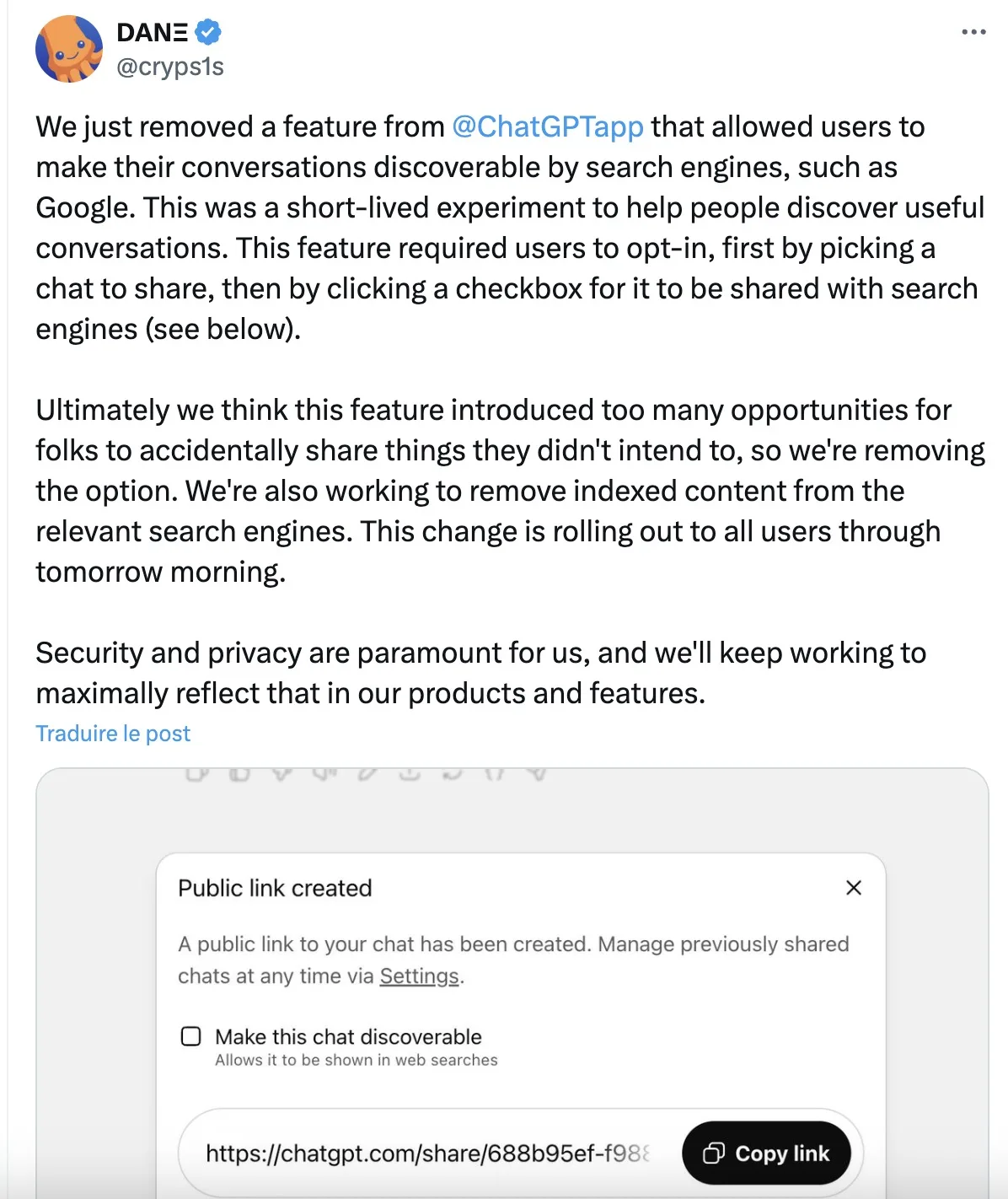

Apple a toujours mis en avant la protection des données personnelles comme l’un de ses principaux différenciateurs par rapport à Google ou Meta. Ce nouveau moteur de recherche ne fait pas exception à la règle : le traitement local des données (on-device) restera au cœur de la stratégie, garantissant que les requêtes utilisateurs ne transitent pas systématiquement par des serveurs distants.

Cette approche permettrait à Apple de se démarquer dans un contexte où les assistants IA existants, comme Gemini de Google ou Copilot de Microsoft, sont souvent critiqués pour leur collecte massive de données.

Safari et Spotlight transformés en moteurs intelligents ?

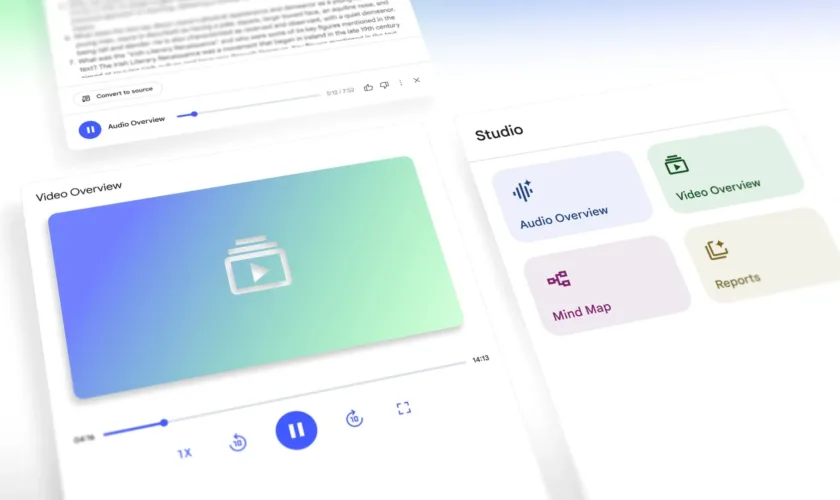

Au-delà de l’amélioration de Siri, les équipes d’Apple souhaiteraient étendre les capacités conversationnelles de l’IA à Safari et Spotlight. L’objectif ? Transformer ces outils de recherche traditionnels en véritables moteurs intelligents capables de répondre à des questions complexes, générer des résumés, et s’appuyer sur le contexte utilisateur (localisation, historique, préférences…).

Cette vision s’inscrit dans la continuité des travaux déjà amorcés autour d’Apple Intelligence, la suite d’outils IA dévoilée lors de la WWDC 2024, mais encore peu aboutie dans ses premières versions, notamment au niveau de Siri.

Une réponse à la concurrence et à la pression réglementaire

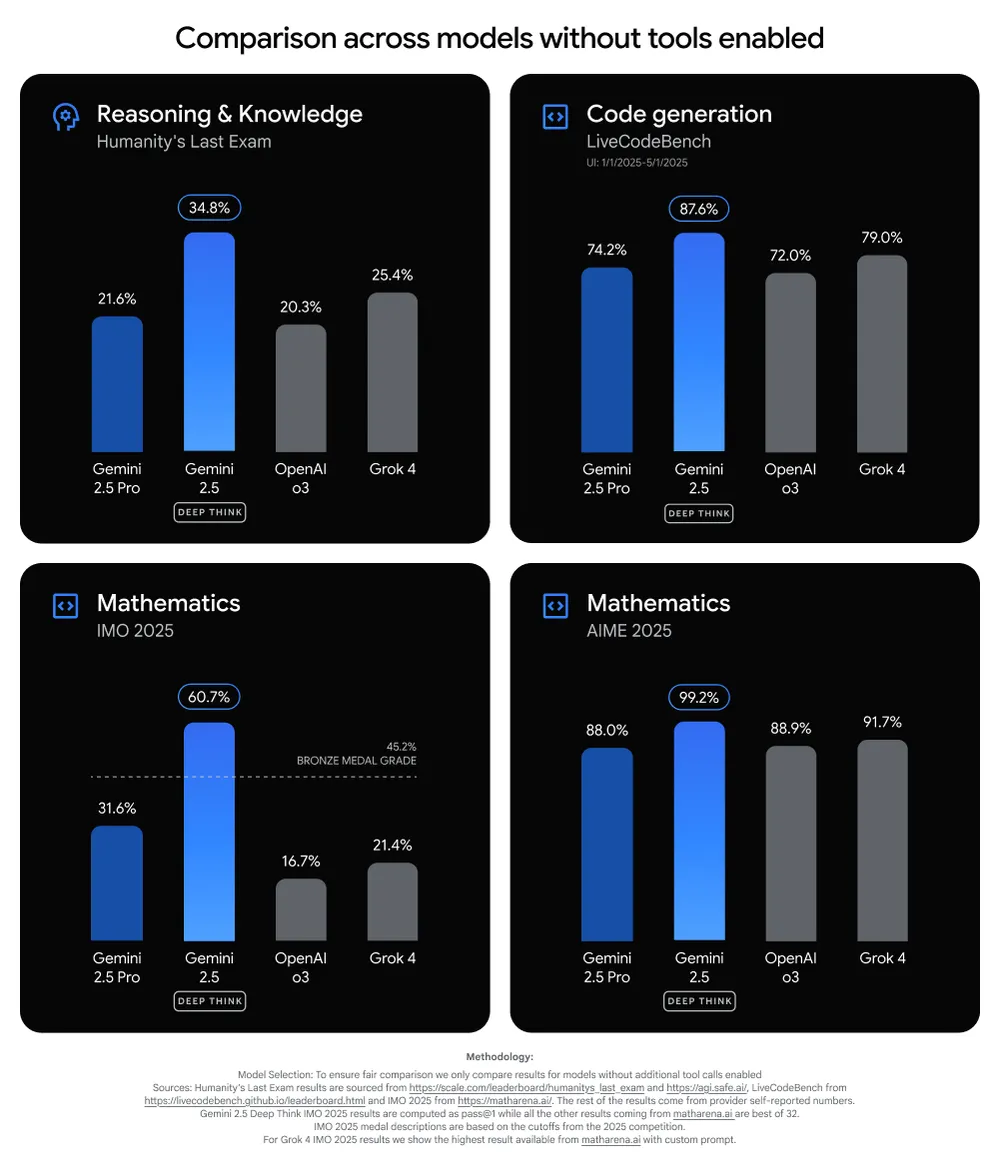

Face à la montée en puissance de Google avec Gemini, de Microsoft avec Copilot, et de ChatGPT via OpenAI, Apple n’a plus le luxe de prendre du retard. Les récentes annonces montrent une volonté claire de combler le fossé technologique, tout en évitant les erreurs du passé.

Par ailleurs, l’intégration de cette IA maison pourrait alléger la dépendance d’Apple à Google Search, une dépendance qui pourrait être remise en question dans le cadre des procédures antitrust en cours. Une rupture avec Google sur la recherche par défaut pourrait ainsi se solder par le lancement d’un moteur Apple basé sur l’IA.

Recrutements en cours et objectifs à 2026

Pour soutenir cette ambition, de nombreuses offres d’emploi sont apparues sur le site carrière d’Apple, ciblant des experts en recherche algorithmique, NLP (traitement du langage naturel), IA générative, et systèmes embarqués. Plusieurs fuites évoquent une mise en production en 2026, potentiellement en parallèle du lancement d’iOS 26 ou d’un futur iPhone 17 doté de fonctions IA natives.

Le projet serait dirigé par Robby Walker, ancien responsable de Siri, ce qui suggère une volonté d’unifier toutes les briques IA de l’entreprise sous une vision cohérente.

Une IA maison taillée pour l’écosystème Apple

Cette offensive IA pourrait repositionner Apple comme un acteur sérieux de l’intelligence artificielle privée et éthique. À terme, l’intégration d’un moteur de réponse intelligent dans tous les produits Apple — iPhone, Mac, iPad, Vision Pro — pourrait transformer la manière dont les utilisateurs interagissent avec leurs appareils.

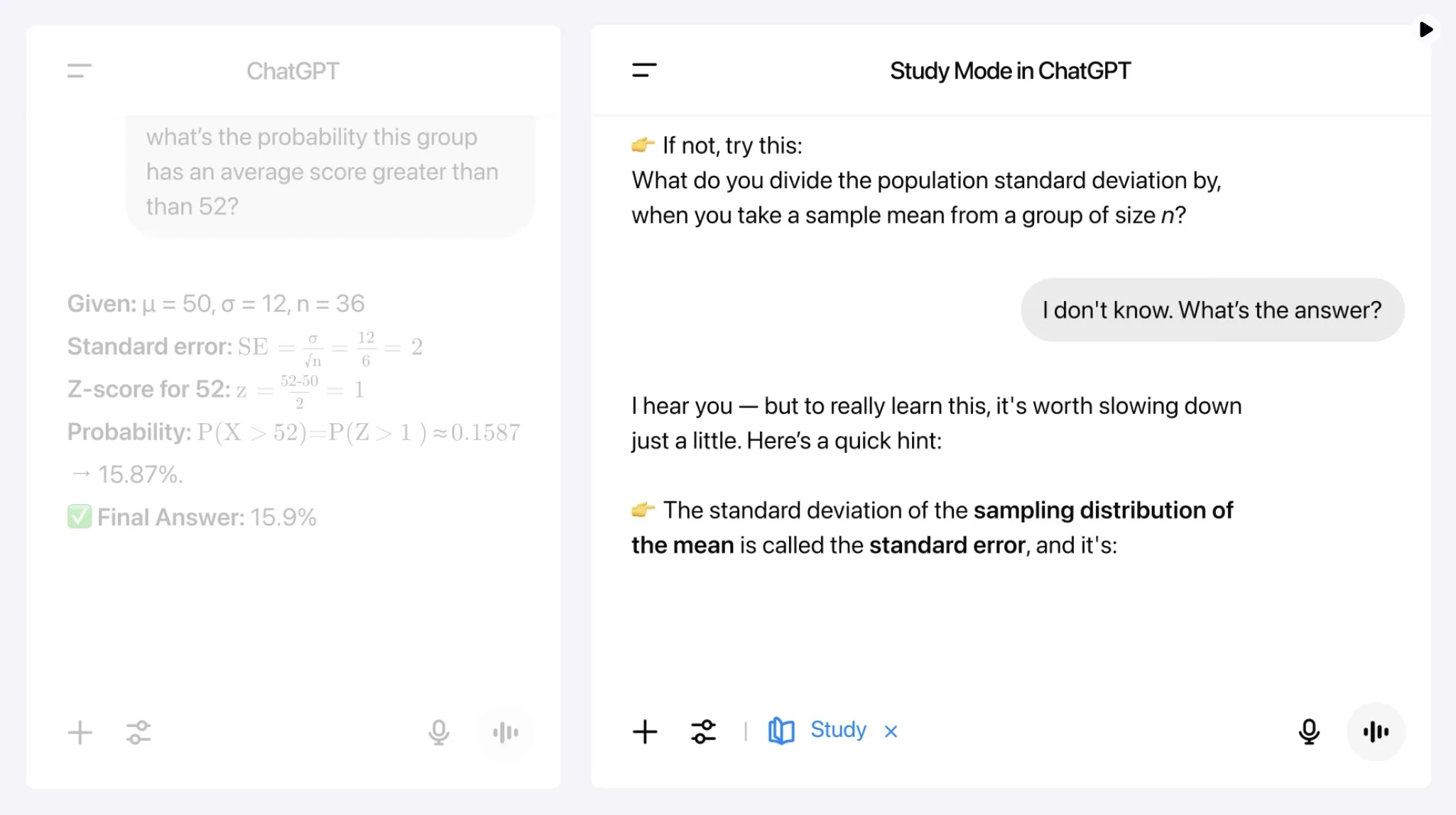

Contrairement à ChatGPT, qui reste une app tierce pour l’instant, l’IA d’Apple serait omniprésente, mais discrète, fluide, et parfaitement intégrée à l’écosystème. Une promesse qui, si elle est tenue, pourrait réellement bouleverser l’équilibre des forces dans la tech.

Apple prépare une riposte ambitieuse face à OpenAI, Microsoft et Google. En développant une IA propriétaire, intégrée, et centrée sur la confidentialité, la firme veut reprendre le contrôle de l’expérience utilisateur. Si le pari est réussi, cette stratégie pourrait repositionner Siri, Safari et Spotlight comme des outils à la fois puissants, respectueux de la vie privée, et à la pointe de l’innovation.