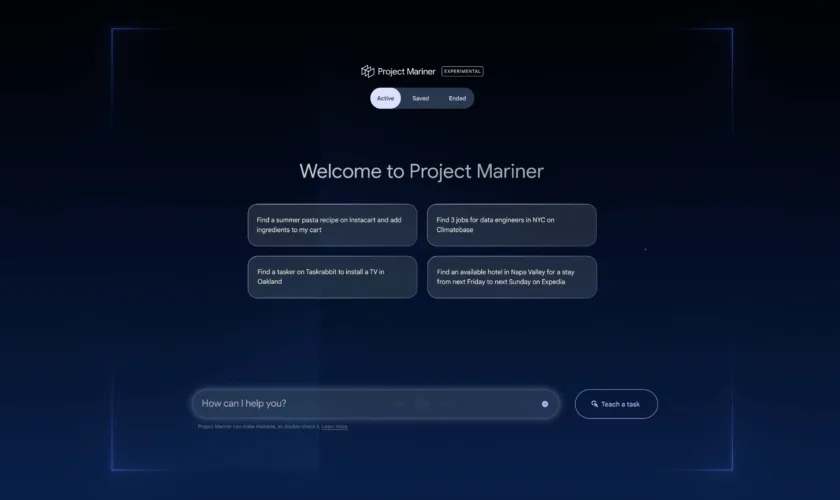

Lors de la conférence Google I/O 2025, le géant de Mountain View a officialisé le déploiement élargi de Project Mariner, son agent IA capable de naviguer sur le web et d’interagir avec des sites à la place de l’utilisateur. Une mise à jour majeure qui marque un tournant dans la manière dont nous pourrions bientôt utiliser internet.

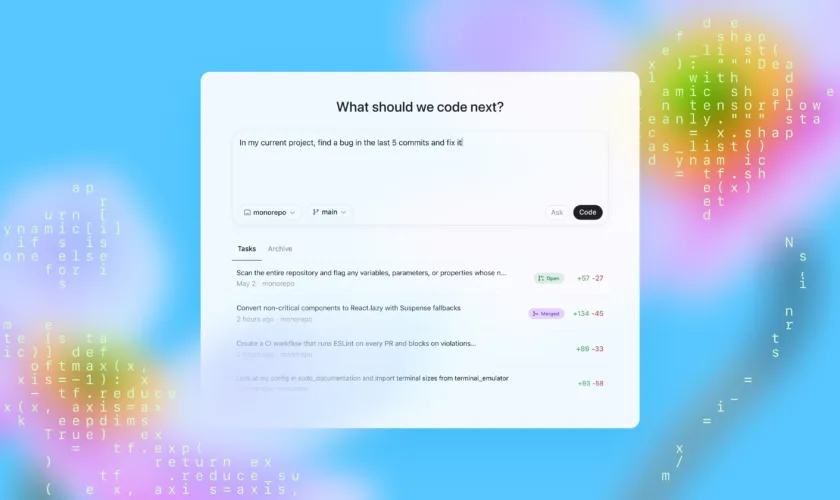

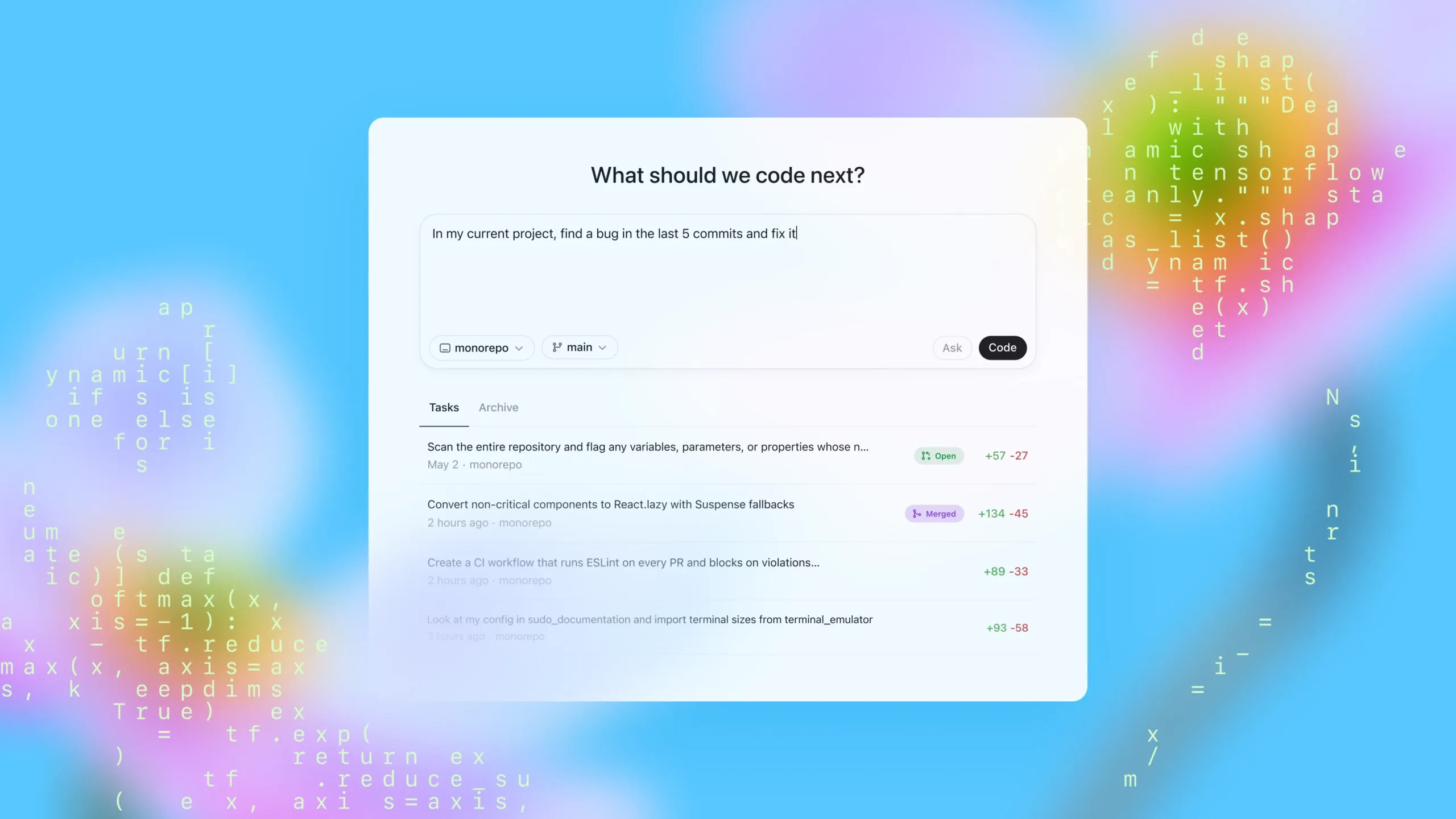

Project Mariner: un assistant Web multitâche

Initialement présenté fin 2024, Project Mariner permet à un utilisateur de déléguer des actions entières à une IA, sans jamais avoir à se rendre manuellement sur un site. Acheter des billets de concert, réserver une table, faire les courses en ligne : autant de tâches que Mariner peut gérer de bout en bout, uniquement via une conversation.

Jusqu’ici limité à un petit groupe de testeurs, Mariner s’ouvre désormais aux abonnés américains du nouveau forfait Google AI Ultra, proposé à 249,99 dollars/mois. Ce plan premium offre également l’accès aux dernières capacités de l’IA Gemini et à d’autres outils expérimentaux.

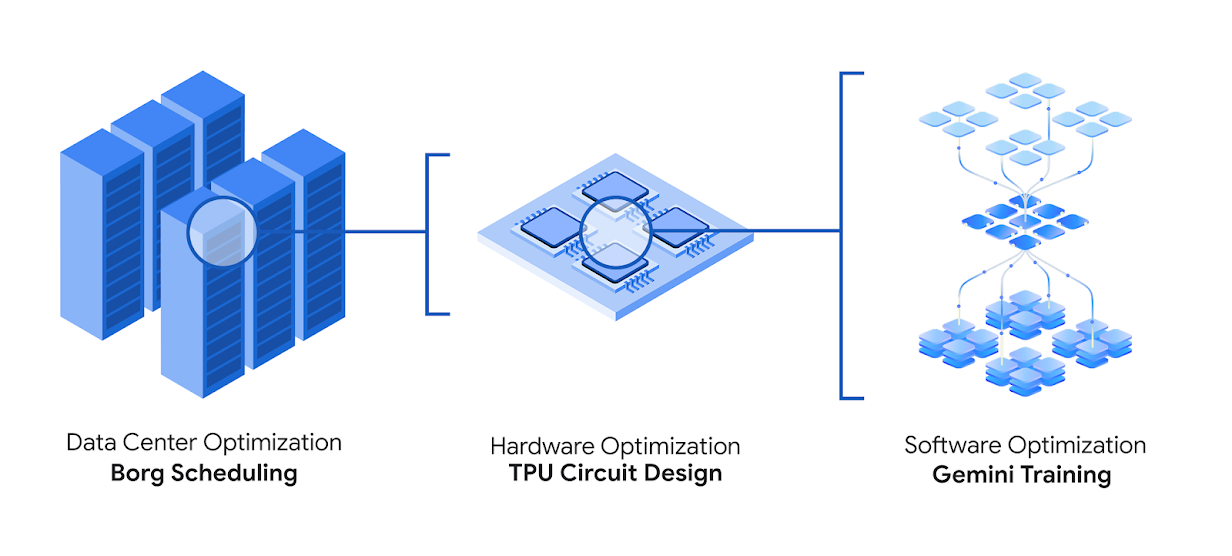

Mais surtout, Google annonce que Project Mariner fonctionne désormais dans le cloud, via des machines virtuelles. Cette amélioration technique majeure permet à l’agent de :

- Traiter jusqu’à 10 tâches simultanément

- Travailler en arrière-plan, pendant que l’utilisateur fait autre chose

- Réduire l’impact sur les performances locales de l’appareil

Un changement essentiel, car dans sa version initiale, l’agent opérait directement dans le navigateur de l’utilisateur, rendant toute autre activité impossible pendant son exécution.

Une intégration poussée dans l’écosystème Google

Google ne se contente pas de rendre Mariner plus performant : le géant l’intègre plus profondément dans son écosystème IA. L’agent devient ainsi accessible via :

- Gemini API : pour permettre aux développeurs de créer leurs propres services propulsés par Mariner

- Vertex AI : la plateforme cloud IA de Google destinée aux entreprises

- AI Mode (Search Labs) : une version expérimentale de la recherche Google boostée à l’IA, où Mariner pourra exécuter des actions en direct

Google travaille déjà avec des partenaires comme Ticketmaster, StubHub, Resy ou Vagaro pour permettre à Mariner de gérer des tâches spécifiques sur leurs plateformes.

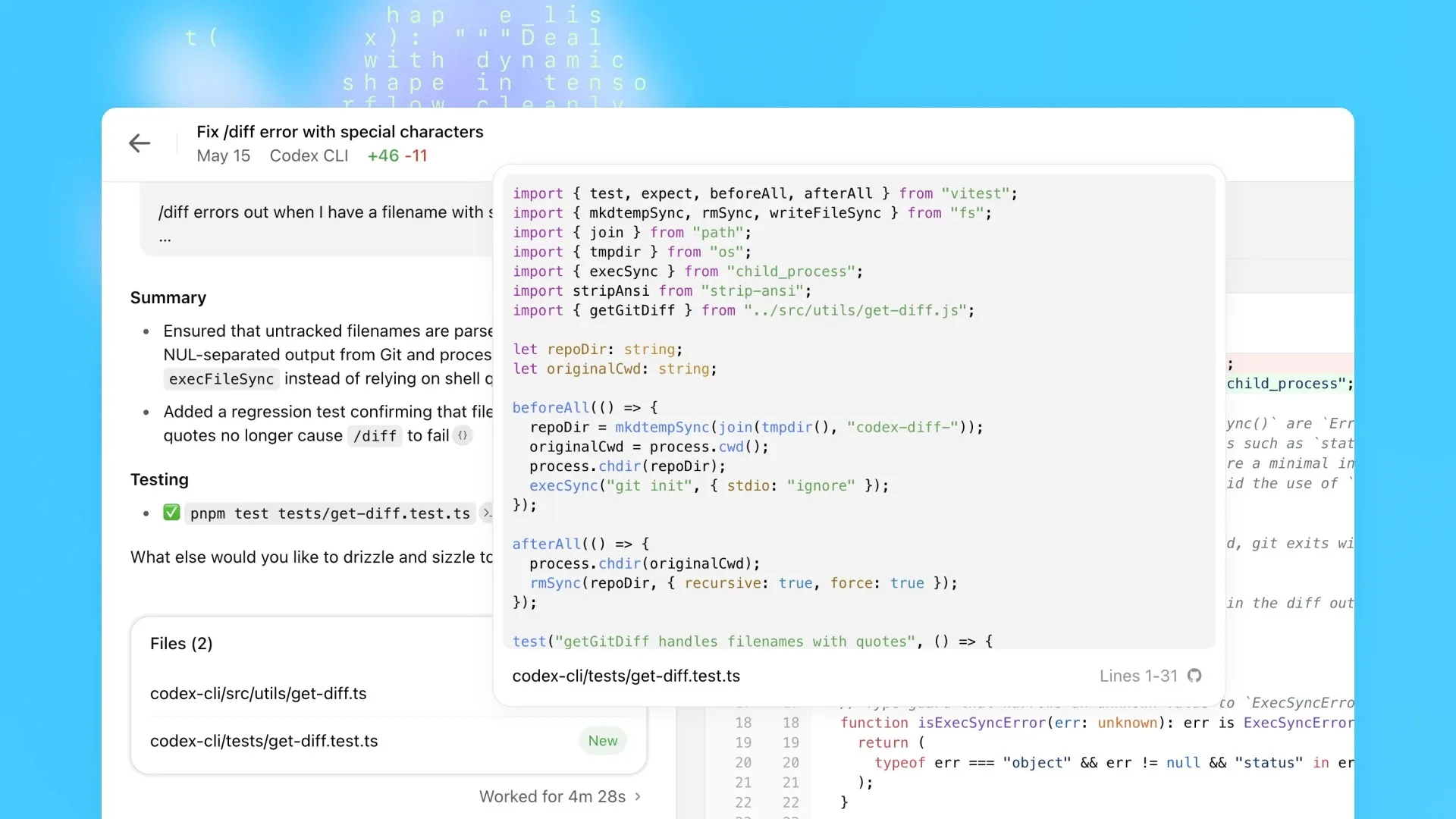

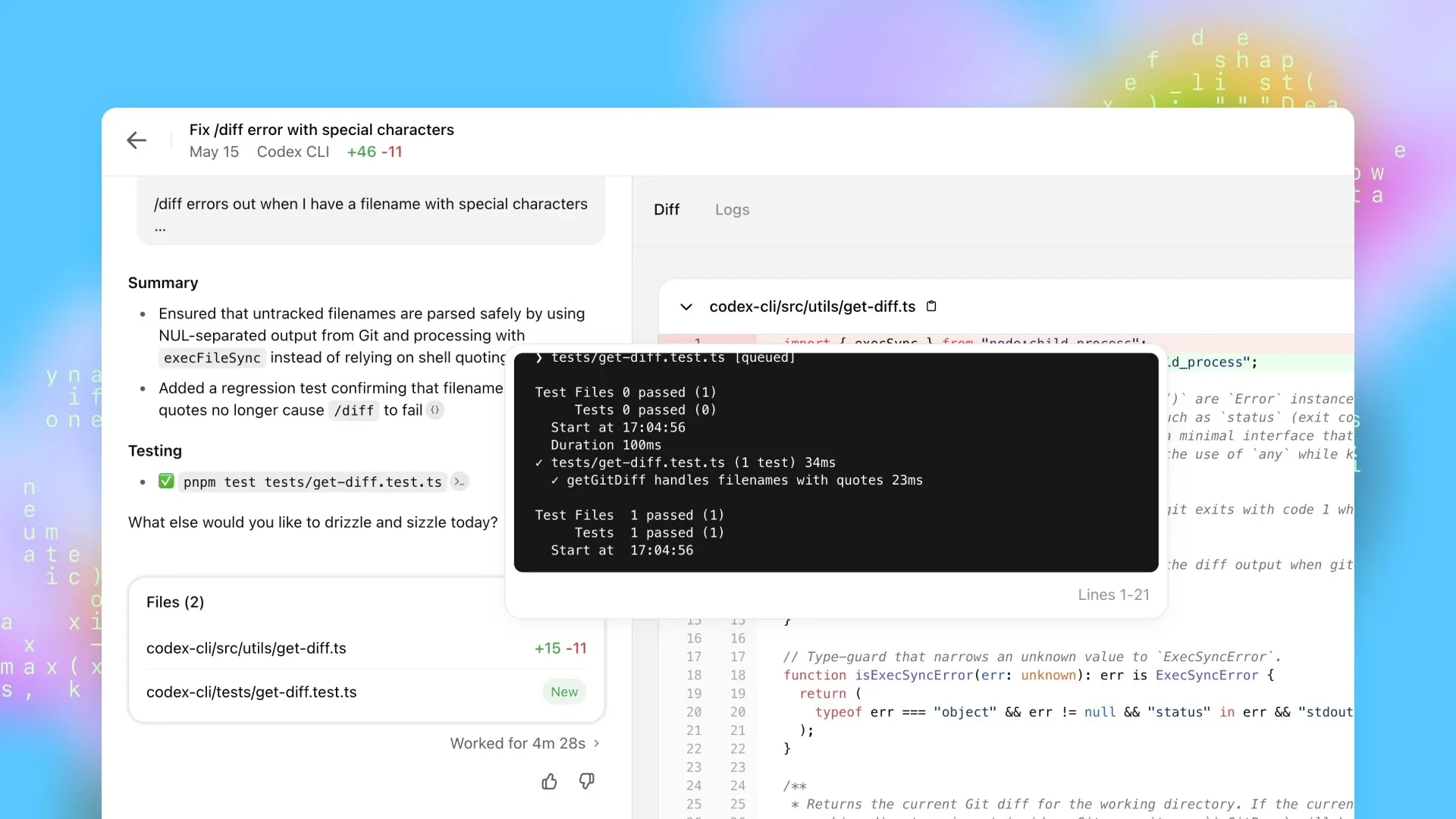

Agent Mode : l’étape suivante vers la navigation automatisée

En parallèle, Google a présenté un nouveau mode appelé « Agent Mode ». Ce dernier combine la navigation sur le Web, la recherche contextuelle et des intégrations avec les applications Google. Une approche hybride, entre navigateur classique et agent intelligent.

Ce mode sera disponible en avant-première pour les abonnés AI Ultra, sur desktop dans un premier temps.

Une guerre des agents IA en pleine ébullition

Project Mariner entre en concurrence directe avec d’autres projets similaires chez les géants du secteur :

- Operator (OpenAI)

- Nova Act (Amazon)

- Computer Use (Anthropic)

Ces agents visent tous à remplacer la navigation manuelle par des interactions naturelles avec une IA. Toutefois, la plupart sont encore en phase expérimentale et souffrent de lenteurs, d’erreurs et d’un manque de fiabilité. Google affirme avoir pris en compte ces faiblesses pour améliorer Mariner.

Vers un futur « agentique » du Web ?

Avec Project Mariner, Google donne un avant-goût du futur de la navigation Internet. Un futur où :

- On ne tape plus une requête sur Google, on commande une action à une IA.

- Les sites ne sont plus visités par les utilisateurs, mais par des agents IA en leur nom.

- Le rôle de l’interface utilisateur sur les sites s’amenuise, au profit d’APIs dédiées aux agents.

« Nous assistons à une bascule dans l’expérience utilisateur sur le Web », annoncent les responsables de la Search Team chez Google. « Les gens n’auront plus besoin de visiter un site pour accomplir une tâche. Ils parleront à une IA ».

En associant autonomie, fluidité et intégration, Project Mariner incarne la vision la plus aboutie du « web agentique » portée par Google. Il ne s’agit plus simplement de chercher une information, mais de confier une intention à une intelligence artificielle, capable d’agir dans un environnement numérique à votre place.

Entre Project Mariner, AI Mode, Agent Mode, et l’intégration dans l’écosystème Gemini/Vertex, Google semble déterminé à transformer en profondeur notre rapport au web. Une révolution à suivre de très près — pour les utilisateurs comme pour les éditeurs de sites.